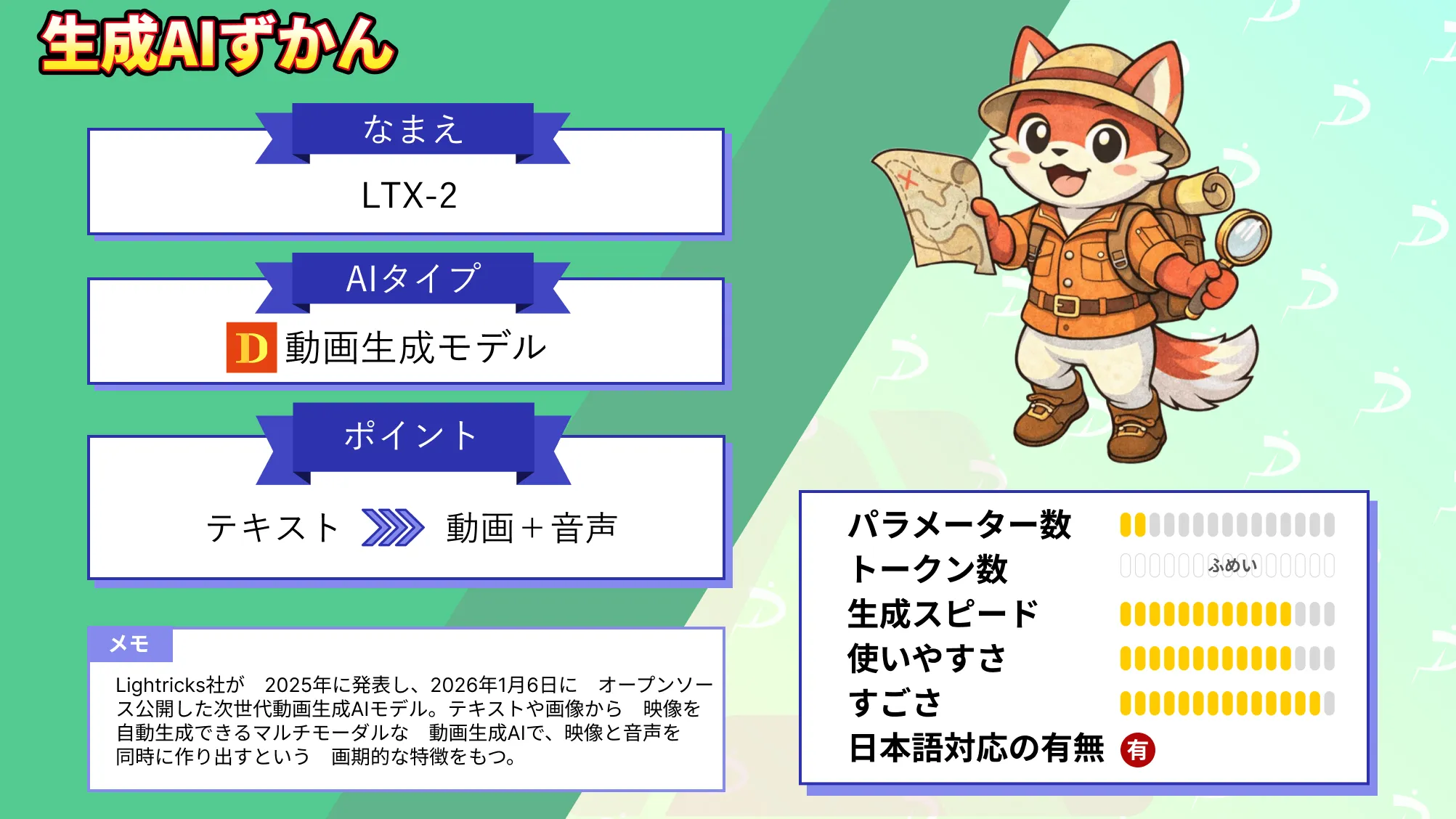

【LTX-2】Lightricks発の音付き動画生成AIがオープンソース化!特徴・性能・使い方を徹底解説

- Lightricks社が2025年に発表し、2026年1月6日にオープンソース公開した次世代動画生成AIモデル

- テキストや画像から映像を自動生成できるマルチモーダルな動画生成AIで、映像と音声を同時に作り出すという画期的な特徴をもつ

- 音付き動画を一体で生成できる初の本格的なオープンソースモデル

Lightricks社が2025年に発表し、2026年1月6日にオープンソース公開した次世代動画生成AIモデル「LTX-2」が、クリエイターや開発者の間で大きな注目を集めています!

LTX-2は、テキストや画像から映像を自動生成できるマルチモーダルな動画生成AIで、映像と音声を同時に作り出すという画期的な特徴を持っています。

しかも、最大で4K解像度・毎秒50フレームという高精細かつ滑らかな映像を生成できて、プロの映像制作にも匹敵するクオリティを実現しているとのこと。

これまで静止画AIや無音の動画生成AIは存在しましたが、LTX-2は、音付き動画を一体で生成できる初の本格的なオープンソースモデルとして、AI映像表現の新時代を切り開きつつあります。

そこで本記事では、LTX-2の概要や性能、料金情報や使い方まで徹底的に解説します。

ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

LTX-2の概要

LTX-2は、画像編集アプリ「Facetune」などで知られるイスラエル発の企業Lightricksが開発したAI動画生成の基盤モデルです。

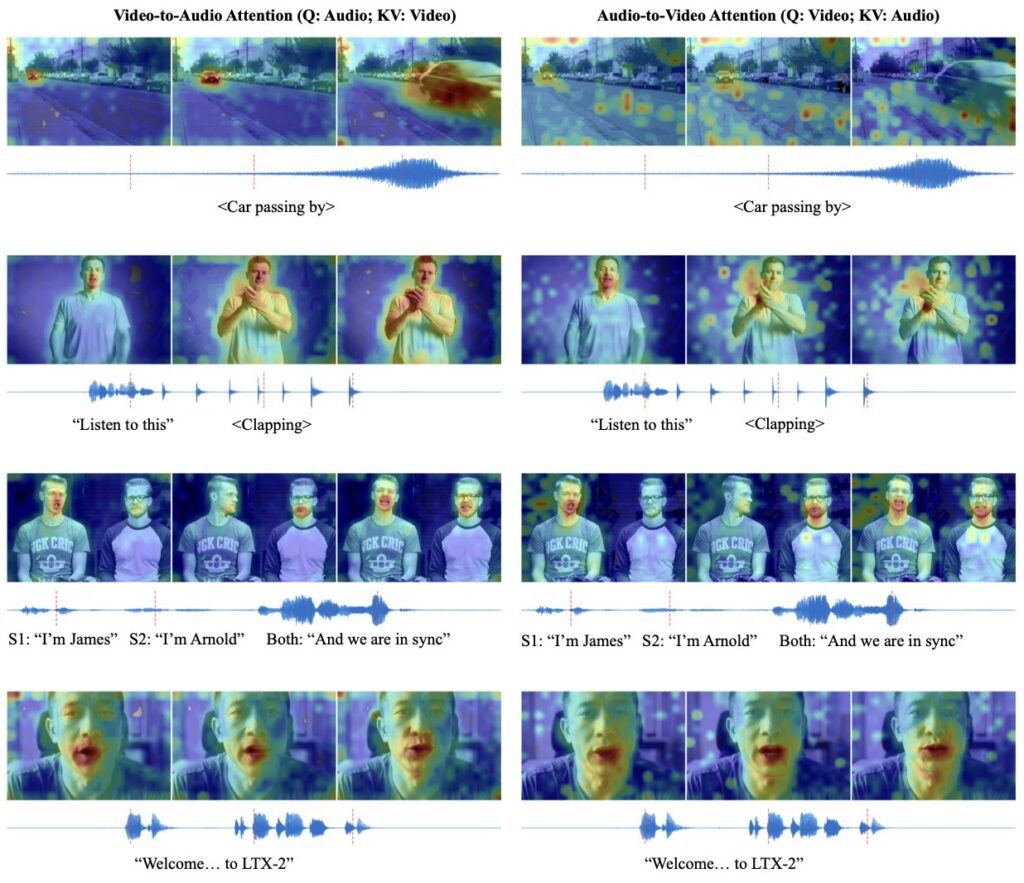

単に動画を作るだけでなく、「映像」と「音声」を一本化した形で生成できるのが最大の特徴で、映像内の人物の発話や動作と、周囲の音響(セリフや環境音、音楽)がしっかりと同期した動画クリップを出力します。

LTX-2は、生成した動画の解像度がネイティブで最大4K (3840×2160ピクセル) に達し、フレームレートも最大50fpsに対応しており、映画や映像業界の要求水準に応えられる高い表現力を備えています。

一度に生成できる動画の長さは現在10秒程度ですが、将来的に15秒や20秒へ延長する計画もあるようです。

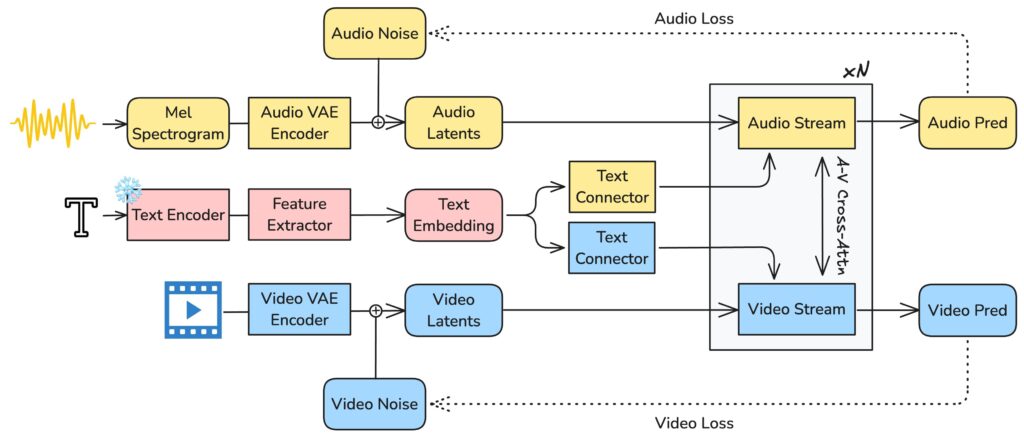

LTX-2は、合計約190億パラメータにも及ぶ巨大モデルで、映像生成用のビデオストリーム(約140億パラメータ)と音声生成用のオーディオストリーム(約50億パラメータ)を組み合わせた独自のトランスフォーマーアーキテクチャを採用しています。

また、テキスト指示の理解には、多言語対応の埋め込みモデルを活用し、映像と音声の両方を効率よく扱う工夫が凝らされています。

これによって、LTX-2はプロのような品質を維持しながらも、社内ツールやエンタープライズ用途だけに留まらず幅広いユーザーコミュニティに開かれたモデルとなっています。

LTX-2の性能

LTX-2の性能面について、具体的な数字とトピックをいくつか見てみましょう。

解像度・フレームレート

ネイティブで4K (2160p) 解像度・最大50fpsの動画出力が可能です。高精細かつ滑らかな映像生成は、他の多くのモデルが720pや1080p止まりである中で際立った強みです。

また現在は、1クリップあたり最長10秒まで生成可能で、将来的により長尺の対応も予定されています。

要求スペックと効率

高性能なモデルでありながら、動作効率が非常に優れている点も特徴です。

Lightricks社によれば、LTX-2は同等の能力を持つ他のモデルに比べて、推論に必要な計算資源が最大50%も削減されており、半分程度のコストで同品質の生成が可能です。

これは、独自の最適化やマルチGPU並列実行による効果で、長尺動画の生成時にも効果があります。

社外評価においても「オープンソースの中では現状トップクラスの映像・音声品質とプロンプト忠実度を示し、専有モデル(商用のクローズドモデル)にも匹敵する成果を、より短い処理時間と少ない計算資源で達成した」とLightricks社のレポートで報告されています。(※1)

ハードウェア要件

開発元は、コンシューマーグレードのGPUで動作可能と謳っています。

推奨環境としては、NVIDIAのハイエンドGPU(例: 80GBメモリのA100や次世代H100など)が挙げられていますが、工夫次第では一般的なゲーミングPC向けGPUでも動かせるかと思います。

公式の最低要件は、VRAM 32GB以上とされていますが、モデルの量子化版(FP8/FP4精度)や縮小版(蒸留モデル)を使えば、24GBクラスでもより短い秒数・低解像度で生成を試すことが可能です。

LTX-2のライセンス

LTX-2はオープンソースで公開されていますが、一般的なMITやApacheライセンスとは異なり、独自の「LTX-2 Community License」というライセンス形態を採用しています。

このライセンスは、商用利用に一定の条件を課しつつも、研究目的や個人利用、非営利プロジェクトなどでの広い活用を可能にするバランス型のものです。

| 利用用途 | 可否 | 備考 |

|---|---|---|

| 商用利用 | ⭕️ | ・年間収益1,000万ドル以上の企業は別途商用ライセンス契約が必要 ・それ未満の個人・中小規模なら追加契約なしで利用可能 |

| 改変 | ⭕️ | |

| 配布 | ⭕️ | |

| 特許使用 | ⭕️ | |

| 私的使用 | ⭕️ |

LTX-2の料金

LTX-2そのものはオープンソースモデルのため、ライセンス範囲内であれば基本無料で利用できます。

しかし、開発元の提供する公式サービス「LTX Studio」プラットフォーム上でLTX-2を利用する場合や、API経由でクラウド生成を行う際には、使用時間に応じた課金体系が設けられています。

用途や求める品質に合わせて選べる3つの実行モード(Fast・Pro・Ultra)があり、それぞれで料金が異なります。

| モード | 特徴と用途 | 料金(API利用時) |

|---|---|---|

| Fast | ・ブレインストーミング向けの高速プレビュー ・解像度や精細さよりスピード重視でプロンプトのアイデア出しやモバイル環境での素早い生成に適するモード | $0.04/秒〜 (約5円/秒) |

| Pro | ・日常利用向けのバランス型 ・ある程度の高品質を保ちつつ効率も良いモード ・社内プレゼン用動画やマーケティング素材の作成など、日常の制作ワークフローで標準的に使える設定 | $0.08/秒〜 (約10円/秒) |

| Ultra | ・最高品質のシネマティック向け ・4K解像度・50fps・10秒のフルスペック生成に対応し、映画やCM、VFX用途など最大限のクオリティが要求される場面に投入できるモード | $0.16/秒〜 (約20円/秒) |

公式によると、Fastモードは高速で安価なため初回のテスト利用は無料枠として提供される場合もあるようです。

Pro・Ultraは、本格利用向けの有料プランですが、その分出力品質が上がります。またエンタープライズ向けには、別途定額の法人プランも用意されており、使い放題や追加機能を含めた契約も可能とのことです。

LTX-2の使い方

LTX-2の利用方法は主に、①Web版、②ローカル版の2通りがあります。

①Web版

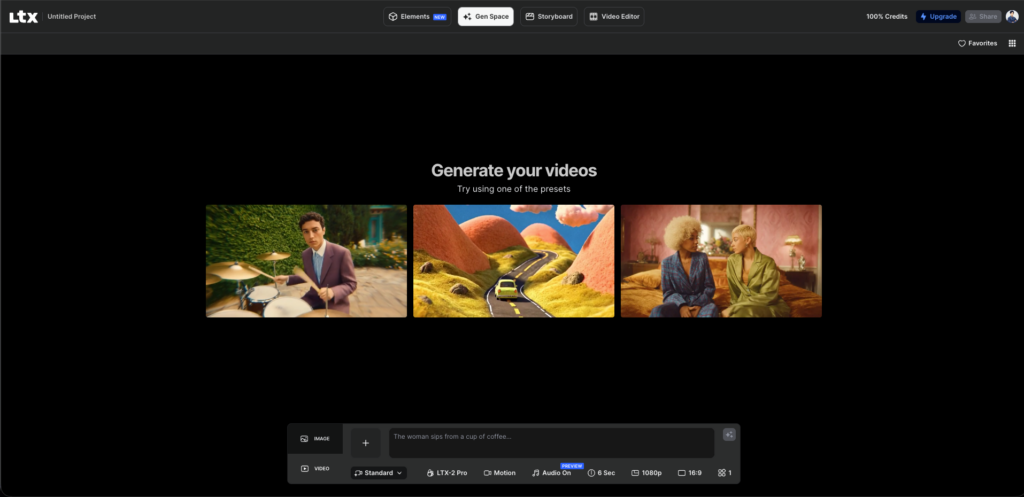

ブラウザでLTX Studioにアクセスしてログインし、コンソール画面の「Generate Video」ボタンをクリックすると生成画面へ遷移します。

あとは、プロンプトを送信するだけで動画生成がスタートします。

なお、生成した各ショットはタイムラインでつなげて長尺化することもできて、書き出しはそのまま共有できるMP4か、編集ソフト取り込み前提のXMLを選べます。

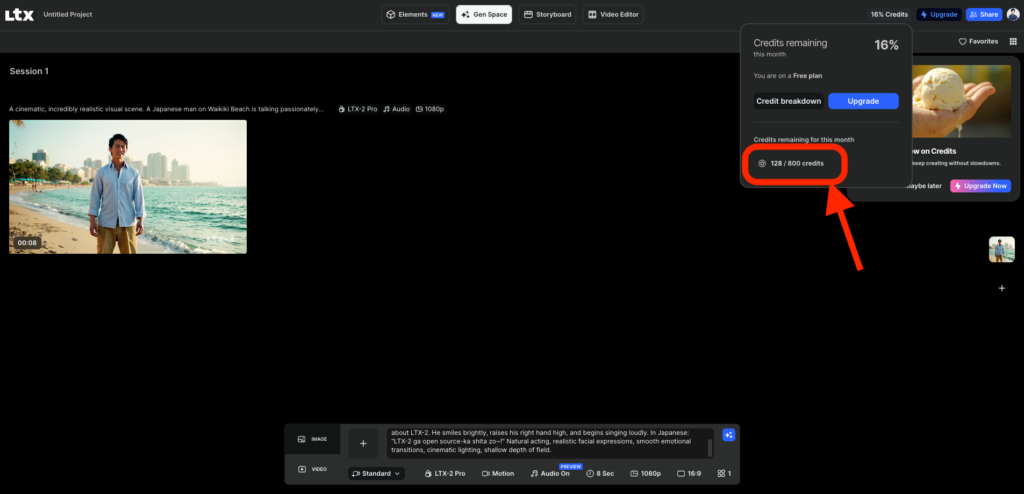

無料プランは、初回800 Credits(1回限り)で、個人利用のみという位置づけになっています。

②ローカル版

公式によると動作環境は、「NVIDIA GPU(VRAM 32GB以上)+空き容量100GB以上+CUDA 11.8以上+Python 3.10以上」が推奨されています。

まずは、LTX-2のコードと学習済みモデルデータを入手します。

公式GitHubリポジトリ(Lightricks/LTX-2)からコード一式をクローンし、必要なモデル重みファイルをダウンロードします。

モデル重みはHugging Face上で公開されていて、19億パラメータのフルモデルや蒸留版モデル、アップスケーラーなど複数のファイルに分かれています。公式ドキュメントの指示に従い、これらのファイルを所定のフォルダに配置してください。

リポジトリをクローンしたディレクトリで実行環境を構築します。ターミナルで以下のコマンドを順に実行してください。

git clone https://github.com/Lightricks/LTX-2.git

cd LTX-2

uv sync --frozen # 依存パッケージのインストール

source .venv/bin/activate # 仮想環境を有効化動画生成実行ツールとしては、オープンソースのGUIツールComfyUIを使う方法が推奨されています。

ComfyUIを起動し、内蔵の「ComfyUI Manager」からLTXVideoという拡張ノードを検索してインストールします。

これでLTX-2用の専用ノード群がComfyUI上で使えるようになります。インストール後、一度ComfyUIを再起動してください。

あとは、テキスト入力ノード(Prompt入力用のノード)に生成したい映像の内容を日本語または英語で入力すれば動画生成ができます。

LTX-2を使ってみた

それでは実際に、LTX-2をWeb版で試してみましょう。

Text-to-Video、Proモードで実行していきます。

A cinematic, incredibly realistic visual scene.

A Japanese woman wearing glasses crosses Shibuya's scramble intersection.

She smiles brightly, spreads her arms wide, and begins singing in a musical style.

In Japanese:

「LTX-2が登場した〜!」

After a brief pause, her expression slowly changes.

Natural acting, realistic facial expressions, smooth emotional transitions, cinematic lighting, shallow depth of field.

(日本語訳)

映画のように非常にリアルな映像シーン。 メガネをかけた日本人女性が、渋谷のスクランブル交差点を渡っている。

彼女は晴れやかな笑顔で両腕を大きく広げ、ミュージカル調に歌い始める。

日本語のセリフ: 「LTX-2が登場した〜!」

一瞬の間をおいて、彼女の表情がゆっくりと変化していく。

自然な演技、リアルな顔の表情、スムーズな感情の移り変わり、映画的なライティング、浅い被写界深度。プロンプトの追従性はかなり高いですね!ただ、現段階では日本語については得意ではなさそうです。

とはいえ、テキストプロンプトだけで、音声付き動画を1発で生成してくれるのは素晴らしいですよね。

A cinematic, incredibly realistic visual scene.

A Japanese man on Waikiki Beach is talking passionately about LTX-2.

He smiles brightly, raises his right hand high, and begins singing loudly.

In Japanese:

"LTX-2 ga open source-ka shita zo~!"

Natural acting, realistic facial expressions, smooth emotional transitions, cinematic lighting, shallow depth of field.

(日本語訳)

映画のように非常にリアルな映像シーン。ワイキキビーチで日本人男性がLTX-2について熱心に話している。

彼は晴れやかな笑顔で右手を高く上げて声高らかに歌い始める。

日本語のセリフ:「LTX-2がオープンソース化したぞ〜!」

自然な演技、リアルな顔の表情、スムーズな感情の移り変わり、映画的なライティング、浅い被写界深度。こちらもプロンプト追従性は素晴らしいです。

日本語セリフ部分をローマ字で指示してみましたが、先ほどよりは自然な日本語になっている気がします。

なお、6秒動画と8秒動画を生成しましたが、2つで672クレジット消費でした。

無料プランでは、概ね2つほど動画生成を試すことができるかと思います。

まとめ

LTX-2は、音付き動画を一体で生成できる初の本格的なオープンソースモデルです。

LTX Studioで簡単に試すことができますので、気になった方は、ぜひ一度試してみてください!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。