【GPT-5.4 mini・GPT-5.4 nano】高速かつ低コストなOpenAIの小型モデルを徹底解説!

2026年3月18日、OpenAIが新たに「GPT-5.4 mini」と「GPT-5.4 nano」の2モデルを公開しました!

これらは、2026年3月上旬にリリースされたフラッグシップモデル「GPT-5.4」の性能を、より小型で高速なモデルに落とし込んだバリエーションです。GPT-5.4 miniはChatGPTの無料ユーザーでも利用可能で、GPT-5.4 nanoはAPI経由で驚異的なコストパフォーマンスを実現しています。

コーディング、マルチモーダル理解、ツール操作、そしてサブエージェントとしての活用まで、幅広い場面での導入が見込まれる注目のモデルです。

そこで本記事では、両モデルの概要・料金・使い方・活用シーンまでを徹底的に解説しますので、ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

GPT-5.4 mini・GPT-5.4 nanoとは?

GPT-5.4 miniとGPT-5.4 nanoは、OpenAIが公開した高速・低コスト志向の小型言語モデルです。どちらもフラッグシップモデルであるGPT-5.4の能力を継承しつつ、速度やコスト面で大きなアドバンテージを持っています。

GPT-5.4 miniは、前世代のGPT-5 miniと比較して、コーディング・推論・マルチモーダル理解・ツール利用のすべてにおいて大幅に性能が向上しており、さらに2倍以上高速に動作します。SWE-Bench ProやOSWorld-Verifiedといった複数のベンチマークで、フルサイズのGPT-5.4に迫るスコアを記録しています。ChatGPT上では無料(Free)プランおよびGoプランのユーザーに対し、「Thinking」機能として提供されています。また、OpenAIのAPI、Codexでも利用可能です。

GPT-5.4 nanoは、GPT-5.4ファミリーの中で最も小型かつ低価格なモデルです。分類・データ抽出・ランキング・コーディングサブエージェントなど、比較的シンプルなタスクでスピードとコストが重視される場面に最適化されています。API経由でのみ利用可能で、入力100万トークンあたりわずか0.20ドルという圧倒的なコストパフォーマンスが魅力です。

なお、GPT-5.4について、詳しく知りたい方は以下の記事も参考にしてみてください。

GPT-5.4 mini・GPT-5.4 nanoの仕組み

GPT-5.4 miniとGPT-5.4 nanoの詳細なアーキテクチャについて、OpenAIは現時点で内部構造を公開していません。ただし、公式情報や関連ドキュメントから判明している技術的な特徴を整理していきましょう。

両モデルは、GPT-5.4の能力を蒸留した小型モデルであり、推論トークンをサポートしています。GPT-5.4 miniでは推論努力レベルをnone・low・medium・high・xhighの5段階で制御でき、タスクの難易度に応じて推論の深さを調整できます。

OpenAIが特に強調しているのがサブエージェントアーキテクチャでの活用です。GPT-5.4などの大規模モデルが全体の計画立案を担い、miniやnanoがサブタスクを処理するという階層構造を想定しています。この構成によって、GPT-5.4 miniはフルモデルの約30%のクォータでサブタスクをこなせるため、コストを大幅に削減できます。

対応している機能としては、関数呼び出し(Function Calling)、構造化出力(Structured Outputs)、Web検索、ファイル検索、コンピュータ操作(Computer Use)、MCP(Model Context Protocol)などが挙げられます。

GPT-5.4 mini・GPT-5.4 nanoの特徴

こちらでは、概要のセクションでは触れきれなかった性能面の詳細やベンチマークスコアを中心に、両モデルの特徴を確認していきましょう。

_Accuracy-vs-Latency-992x1024.png)

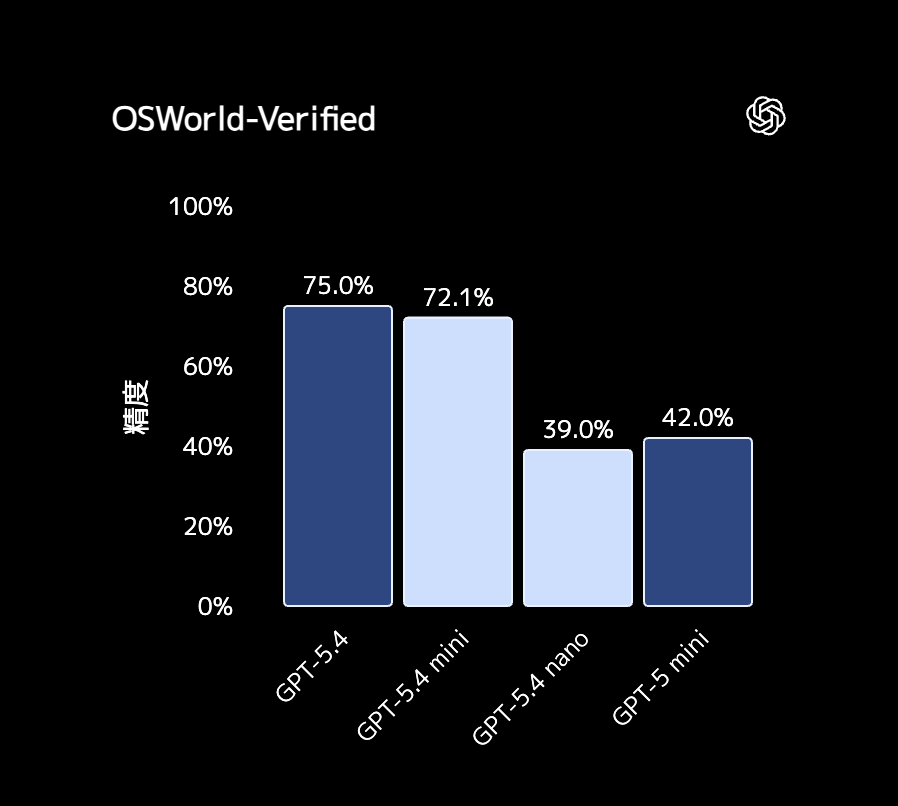

OpenAI公式ページで公開されているベンチマーク結果は以下の通りです。

| ベンチマーク | GPT-5.4 | GPT-5.4 mini | GPT-5.4 nano | GPT-5 mini |

|---|---|---|---|---|

| SWE-Bench Pro(コーディング) | 57.7% | 54.4% | 52.4% | 45.7% |

| OSWorld-Verified(コンピュータ操作) | 75.0% | 72.1% | — | 42.0% |

| GPQA Diamond(推論) | 93.0% | 88.0% | 82.8% | — |

| tau2-bench(通信業務) | — | 93.4% | — | 74.1% |

| Terminal-Bench 2.0 | — | — | 46.3% | — |

注目すべき指標は、GPT-5.4 miniのOSWorld-Verifiedスコアです。GPT-5 miniの42.0%から72.1%へと大幅に向上しており、スクリーンショットを解析してUIを操作する「コンピュータ操作」能力が劇的に向上しています。

GPT-5.4 nanoも、SWE-Bench Proで52.4%というスコアを記録しており、miniの4分の1の価格でありながら実用的なコーディング能力を持っていることが確認できます。

また、GPT-5.4 miniは前世代のGPT-5 miniと比較して2倍以上の処理速度を実現しています。

レイテンシが重視されるチャットボットやリアルタイム解析、エージェント系アプリケーションにおいて、この速度向上は大きなメリットとなるでしょう。

GPT-5.4 mini・GPT-5.4 nanoの安全性・制約

OpenAIは、GPT-5.4ファミリーの安全性評価について、Deployment Safety Hubにてシステムカードの補遺を公開しています。

GPT-5.4は、OpenAIとして初めてサイバーセキュリティ対策の緩和措置を組み込んだ汎用モデルとして位置づけられています。miniおよびnanoもこの安全性設計がなされていて、レッドチーミングでは、400名以上の外部テスターが5,000時間以上をかけて安全性を検証したとされています。

GPT-5.4 mini・GPT-5.4 nanoの料金

GPT-5.4 miniとGPT-5.4 nanoの料金は、いずれもトークン単位の従量課金です。前世代のGPT-5 mini・GPT-5 nanoから大幅に性能が向上した一方で、価格もそれぞれ引き上げられているので、用途に応じたモデル選択が重要になってきます。

| 項目 | GPT-5.4 mini | GPT-5.4 nano |

|---|---|---|

| 入力(100万トークンあたり) | $0.75 | $0.20 |

| キャッシュ入力(100万トークンあたり) | $0.075 | $0.02 |

| 出力(100万トークンあたり) | $4.50 | $1.25 |

| コンテキストウィンドウ | 400Kトークン | 400Kトークン |

| 最大出力トークン | 128Kトークン | — (公式未公開) |

| 地域データレジデンシ処理 | +10%の追加料金 | +10%の追加料金 |

GPT-5 miniは入力0.25・出力0.25・出力2.00でしたので、GPT-5.4 miniは入力で約3倍、出力で約2.25倍の値上げとなっています。

GPT-5 nanoは入力0.05・出力0.05・出力0.40だったため、GPT-5.4 nanoは入力で約4倍、出力で約3.1倍です。性能向上に伴う価格上昇ではありますが、Gemini 3.1 Flash-Liteと比較すると、GPT-5.4 nanoは入力コストでは下回っており、高コスパモデルとしての競争力は十分にあると考えられます。

なお、Gemini 3.1 Flash-Liteについて、詳しく知りたい方は以下の記事も参考にしてみてください。

GPT-5.4 mini・GPT-5.4 nanoのライセンス

GPT-5.4 mini・GPT-5.4 nanoは、OpenAIのAPIおよびChatGPTを通じて提供されるクローズドモデルであり、オープンソースモデルのようなライセンスの概念とは異なります。

利用にあたっては、OpenAIの利用規約(Terms of Use)およびサービス規約(Service Terms)が適用されます。

| 項目 | 可否 | 備考 |

|---|---|---|

| 商用利用 | ⭕️ | |

| 出力の改変 | ⭕️ | |

| 出力の再配布 | ⭕️ | |

| モデル自体の再配布 | ❌️ | クローズドモデルのため不可 |

| モデルの改変(ファインチューニング) | ❌️ | GPT-5.4 mini/nanoはファインチューニング非対応 |

| 私的利用 | ⭕️ |

GPT-5.4 mini・GPT-5.4 nanoの使い方

GPT-5.4 miniとGPT-5.4 nanoは、それぞれ利用方法が少し異なっています。miniはChatGPT・Codex・APIの3つの方法で利用でき、nanoはAPI経由のみです。それぞれの使い方をご紹介していきます。

ChatGPTでGPT-5.4 miniを使う方法

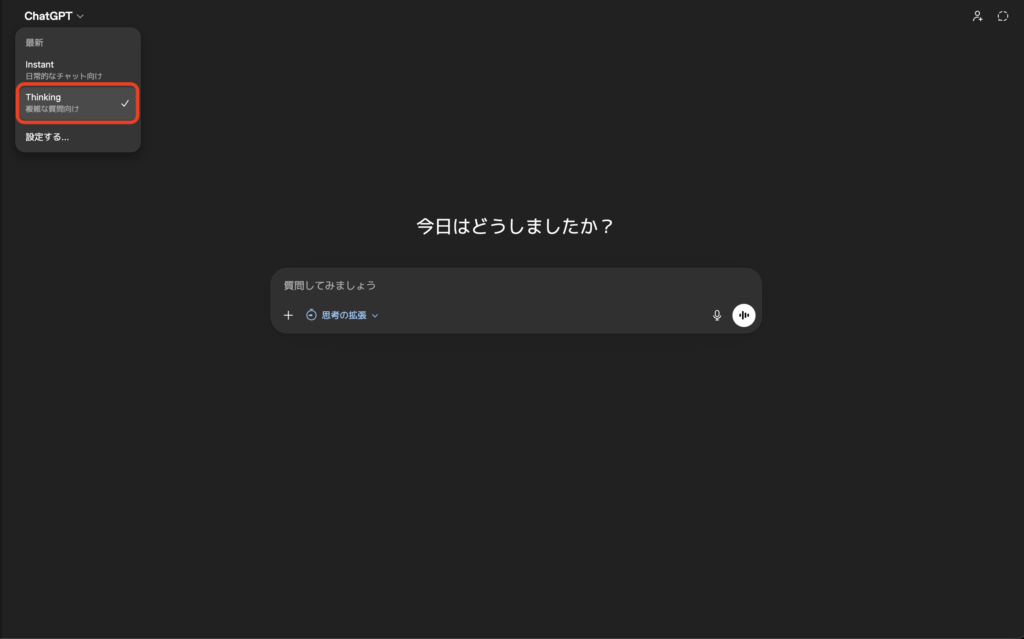

ChatGPT上では、Free(無料)プランおよびGoプランのユーザーはデフォルトでGPT-5.4 miniを利用でき、Plus以上のユーザーはGPT‑5.4 Thinking がレート制限に達した場合、GPT‑5.4 mini がフォールバックとして使用されるようです。

ブラウザで https://chat.openai.com にアクセスし、OpenAIアカウントでログインします。アカウントをお持ちでない場合は、無料で作成しましょう。

チャット入力欄の左上にあるモデル選択メニューをクリックし、「Thinking」機能を選択します。これによってGPT-5.4 miniが推論モードで動作します。

モデル選択ができたら、通常どおりプロンプトを入力して送信すれば、GPT-5.4 miniが応答を返します。コーディング、画像の解析、複雑な質問への回答など、幅広いタスクに活用できます。

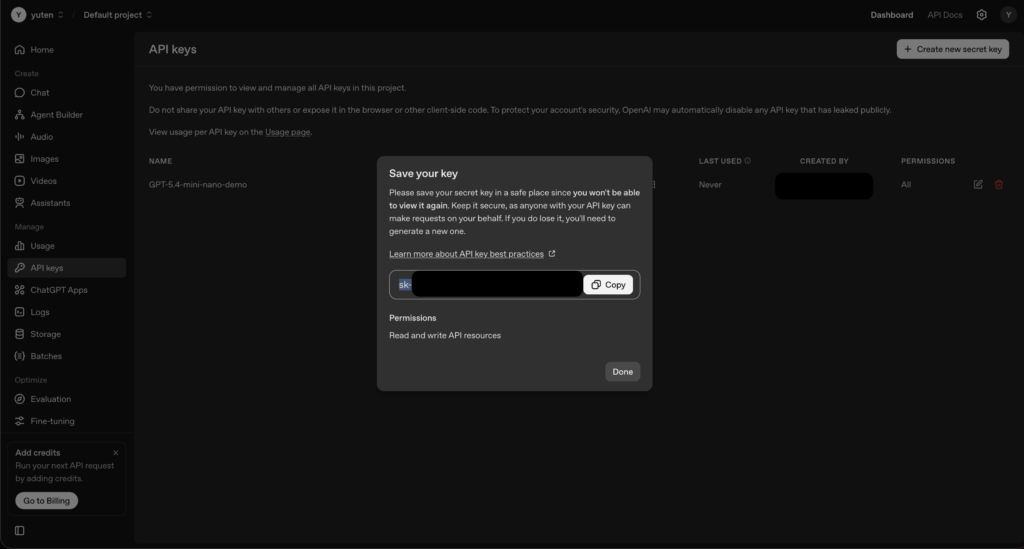

OpenAI APIでGPT-5.4 miniを使う方法

API経由では、より柔軟な制御が可能です。Python(OpenAI公式SDKv1系)を使った基本的な呼び出し方法を紹介します。

Python SDKをインストールする

pip install openaiAPIを呼び出す

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[

{"role": "user", "content": "Pythonでクイックソートを実装してください"}

]

)

print(response.choices[0].message.content)モデル名を gpt-5.4-mini と指定するだけで利用できます。推論努力レベルを制御したい場合は、reasoning_effort パラメータに low・medium・high などを指定します。

OpenAI APIでGPT-5.4 nanoを使う方法

nanoの呼び出し方法もminiとほぼ同じです。モデル名を変更するだけで切り替えられます。

from openai import OpenAI

client = OpenAI()

response = client.chat.completions.create(

model="gpt-5.4-nano",

messages=[

{"role": "user", "content": "以下のテキストを「ポジティブ」「ネガティブ」「中立」に分類してください:今日の天気は最高でした"}

]

)

print(response.choices[0].message.content)nanoは分類・抽出・ランキングなど、構造化された短いタスクに特に適しています。コストを最小限に抑えたい大量バッチ処理にも向いています。

サブエージェント構成で使う方法

OpenAIが推奨するサブエージェントアーキテクチャでは、GPT-5.4をオーケストレーター、miniやnanoをワーカーとして配置します。

from openai import OpenAI

client = OpenAI()

# 1. GPT-5.4で計画を立てる

plan = client.chat.completions.create(

model="gpt-5.4",

messages=[

{"role": "user", "content": "このコードベースのリファクタリング計画を立ててください: ..."}

]

)

# 2. 個別タスクをminiに委任する

result = client.chat.completions.create(

model="gpt-5.4-mini",

messages=[

{"role": "system", "content": "あなたはコードリファクタリングの実行担当です。"},

{"role": "user", "content": f"以下の計画に基づいてリファクタリングしてください: {plan.choices[0].message.content}"}

]

)この構成によって、高い品質を維持しつつも、コストを約3分の1に削減できるとOpenAIは説明しています。

【業界別】GPT-5.4 mini・GPT-5.4 nanoの活用シーン

GPT-5.4 miniとGPT-5.4 nanoは、速度とコストのバランスに優れた小型モデルとして、さまざまな業界での導入が見込まれます。こちらでは業界ごとに想定される活用シーンを整理していきます。

ソフトウェア開発・IT業界

GPT-5.4 miniはSWE-Bench Proで54.4%、OSWorld-Verifiedで72.1%という高スコアを記録しており、コーディング支援に最適です。

GitHub CopilotにもGPT-5.4 miniが統合されており、コード補完・デバッグ・ターゲットエディットの品質が向上しています。nanoはCI/CDパイプラインでのコードレビューや静的解析の補助など、シンプルなサブタスクに活用できます。

ソフトウェア関連については下記の記事もおすすめです

カスタマーサポート・コールセンター業界

tau2-bench(通信業務ベンチマーク)で93.4%というスコアが示すように、GPT-5.4 miniは顧客対応の自動化に強みを持ちます。

チャットボットやFAQ応答システムに組み込むことで、低レイテンシかつ高品質な応答を実現できます。nanoは問い合わせ内容の分類やルーティングに適しています。

コールセンターにおける生成AIの活用は下記で解説

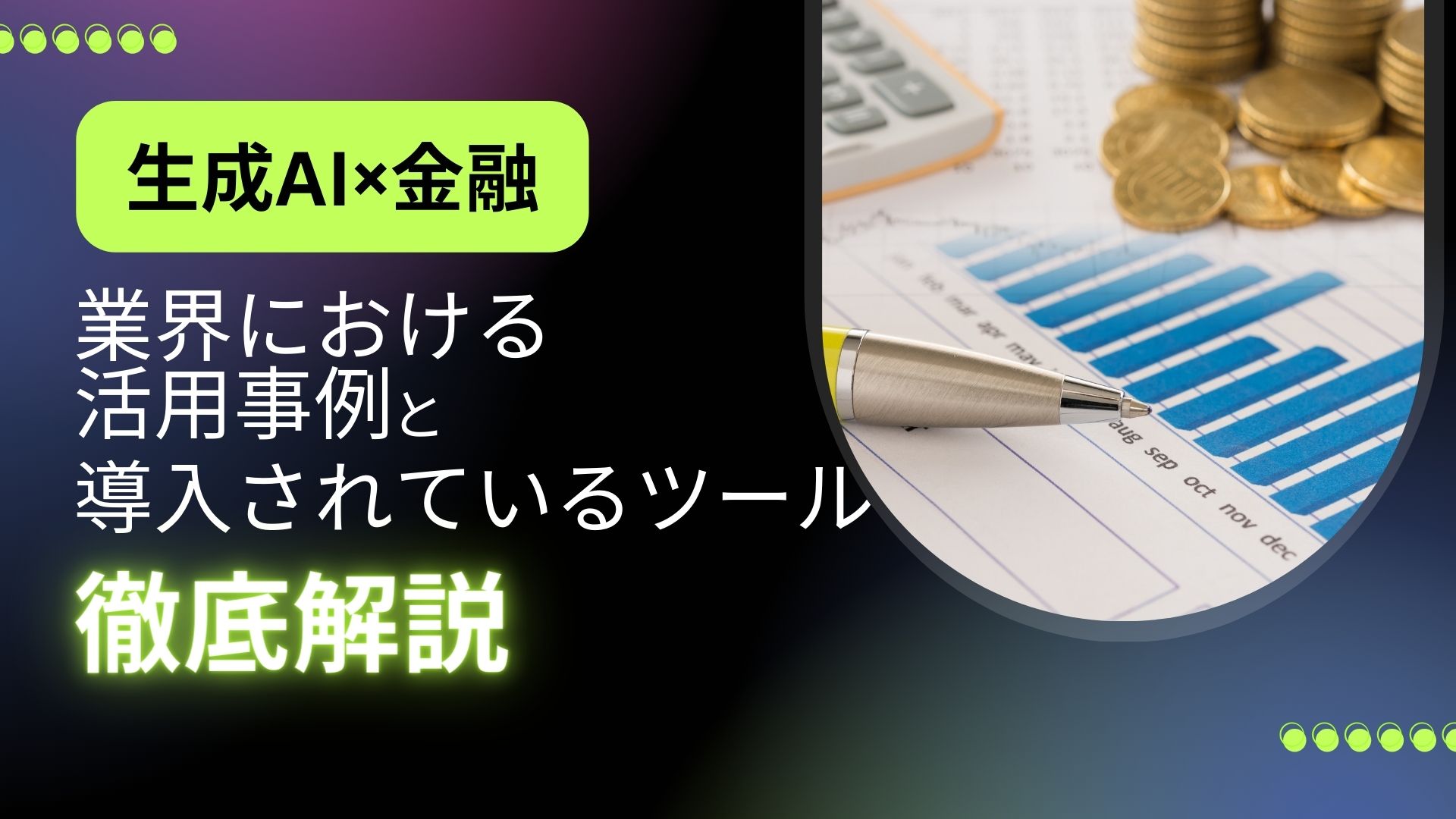

金融・保険業界

大量のドキュメントからのデータ抽出や分類は、GPT-5.4 nanoの得意領域です。

契約書のチェック、リスク分類、レポートの自動要約などに低コストで導入することができます。より複雑な分析やレポート作成にはminiが適しています。

金融業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】GPT-5.4 mini・GPT-5.4 nanoが解決できること

特定の業界に限らず、多くの組織が共通して抱える課題に対して、これらのモデルがどう役立つかを課題別に整理していきましょう。

AIの利用コストを抑える

フラッグシップモデルのGPT-5.4はAPI利用料金が高く、大量処理には向きません。

GPT-5.4 nanoは入力100万トークンあたりわずか$0.20で、分類や抽出といった定型タスクなら品質を維持したまま大幅にコストを削減することができます。サブエージェント構成でminiやnanoにタスクを委任すれば、全体コストを約3分の1に圧縮することも可能です。

大量データの分類・抽出を自動化

メールの仕分け、問い合わせのカテゴリ分類、ドキュメントからの情報抽出など、定型的だが量が多い作業にはGPT-5.4 nanoが最適です。

構造化出力に対応しているので、JSON形式で一貫した出力を得ることができます。

エージェント構成のコスト最適化

複数のAIモデルを組み合わせたエージェントシステムでは、すべてのタスクにフラッグシップモデルを使うとコストが膨大になります。

OpenAIが提唱するサブエージェントアーキテクチャでは、計画立案をGPT-5.4に、実行をminiやnanoに任せることで、品質とコストの最適なバランスを実現できます。

GPT-5.4 miniをCodexアプリで使ってみた

筆者が登録しているPlusプランだと、デフォルトで意図的にGPT-5.4-miniを使うことができませんので、今回はOpenAIが提供する開発者向けクラウドエージェント「Codexアプリ」でGPT-5.4 miniを使っていきます。

Codexアプリ上でGPT-5.4-Miniを選択し、コーディングタスクを試していきます。

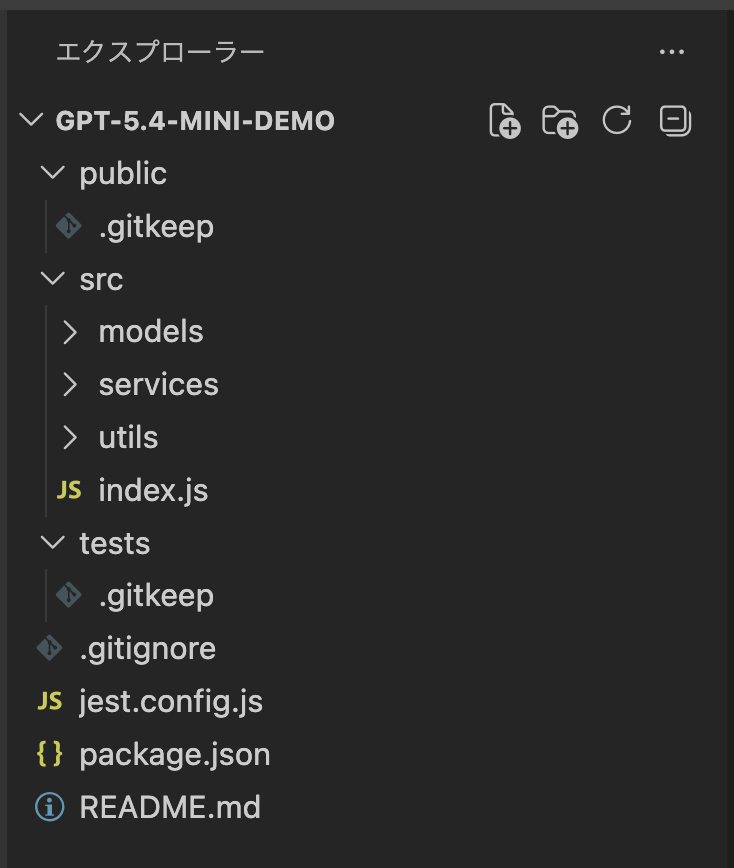

検証①:リポジトリ全体のリファクタリング提案

今回は、上記のようなデモ用リポジトリを作成し、「このリポジトリ内で重複しているロジックを洗い出して、共通ユーティリティに切り出すリファクタリング案を作成して」と指示してみました。

GPT-5.4-Miniは推論ステップを踏みながら、リポジトリ内の複数ファイルを横断的にスキャンし、20秒ほどで重複パターンを特定したうえで具体的な共通化案を提示してくれました。

洗い出した結果、重複はかなり明確で、主に「日付・文字列・金額の純粋関数」「注文/ユーザーのドメイン計算」「サービス内の補助ロジック」に分かれます。

重複クラスター 該当箇所 共通化候補 優先度

入力検証 src/services/userService.js (line 12), src/utils/validate.js (line 6), src/models/user.js (line 51) validateEmail, validatePhoneNumber, validatePostalCode, validateName, validateAmount をサービス/モデルから直接利用 P0

日付・日時・年齢 src/utils/format.js (line 6), src/utils/validate.js (line 38), src/models/user.js (line 16), src/models/order.js (line 37), src/services/userService.js (line 84) formatDate, formatDateTime, isValidDateString, getAge を date 系ユーティリティに集約 P0

電話番号・郵便番号・通貨 src/utils/format.js (line 25), src/models/user.js (line 38), src/models/order.js (line 28), src/services/orderService.js (line 72) formatCurrency, formatPhoneNumber, formatPostalCode を単一実装に統一 P0

注文計算 src/models/order.js (line 14), src/services/orderService.js (line 61) getTotalAmount, getTaxAmount, getGrandTotal を Order を唯一の計算元にする P0

ソートとID生成 src/services/orderService.js (line 42), src/services/orderService.js (line 79), src/services/userService.js (line 37), src/services/orderService.js (line 23) sortByCreatedAtDesc, createEntityId(prefix) を共通化 P1

テキスト整形 src/utils/validate.js (line 52), src/utils/format.js (line 51), src/services/userService.js (line 68) sanitizeInput, truncateText, includesIgnoreCase を文字列ユーティリティに寄せる P1

リファクタリング案

最小の変更で効果が大きい順にやるなら、こうです。

src/utils/date.js を新設して、formatDate, formatDateTime, isValidDateString, getAge を集約する

src/utils/money.js を新設して、formatCurrency と注文金額計算のフォーマットを集約する

src/utils/string.js を新設して、sanitizeInput, truncateText, includesIgnoreCase を集約する

src/utils/validation.js にメール・電話・郵便番号・金額の検証を寄せ、UserService と User から直接参照する

Order を計算の単一ソースにして、OrderService は order.getTotalAmount() / getTaxAmount() / getGrandTotal() を使う

src/utils/id.js に createEntityId(prefix) を置いて、UserService と OrderService の乱数ID生成を統一する

src/utils/array.js か collection.js に sortByCreatedAtDesc() を置いて、注文一覧のソートを共通化する

実装方針

おすすめは「共通ユーティリティを増やす」よりも、「純粋関数を utils/ に集約し、モデルとサービスはそれを使うだけ」にする形です。

今のコードはモデル・サービス・ユーティリティの3箇所に同じロジックが散っているので、どこか1箇所を修正しても他が残る状態になっています。

特に優先度が高いのはこの3つです。

UserService.createUser のバリデーションを validate.js に寄せる

OrderService.calculateOrderSummary を Order の計算メソッドに寄せる

日付/通貨フォーマットを format.js か新設 helper に統一する

注意点

このリポジトリには現状テストが見当たらないので、先に helper の unit test を足してから差し替えるのが安全です。

特に壊れやすいのは 日付, 電話番号, 郵便番号, 注文金額, 年齢計算 です。

必要なら次に、実際の変更案として「どのファイルをどう分割するか」の具体的な差分設計まで落とします。検証②:サブエージェント機能との組み合わせ

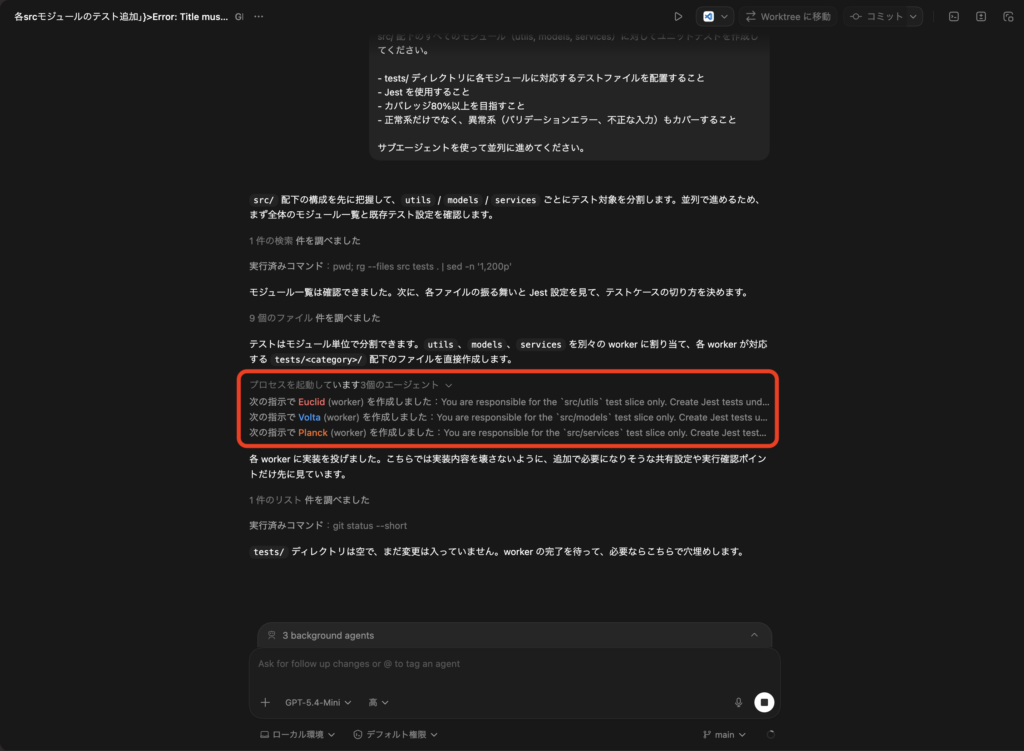

Codexアプリの画面下部には「Subagents in Codex — Delegate work to subagents that work in parallel.」というバナーが表示されており、サブエージェント機能が利用可能です。GPT-5.4をメインモデルとして選択し、サブタスクの実行をGPT-5.4-Miniに委任する構成を試してみました。

src/ 配下のすべてのモジュール(utils, models, services)に対してユニットテストを作成してください。

- tests/ ディレクトリに各モジュールに対応するテストファイルを配置すること

- Jest を使用すること

- カバレッジ80%以上を目指すこと

- 正常系だけでなく、異常系(バリデーションエラー、不正な入力)もカバーすること

サブエージェントを使って並列に進めてください。上記のように指示すると、個別のテストファイル生成をサブエージェント(GPT-5.4-Mini)が並列で処理してくれました。

以上、簡易的ですがGPT-5.4-miniの挙動確認でした。

よくある質問

最後に、GPT-5.4 miniとGPT-5.4 nanoに関して、よくある質問とその回答をご紹介します。

より高速かつ低コストなGPT-5.4 mini・nanoを活用しよう!

GPT-5.4 miniとGPT-5.4 nanoは、OpenAIのフラッグシップモデルGPT-5.4の性能を、より高速かつ低コストで利用できる小型モデルです。

GPT-5.4 miniはコーディング・マルチモーダル理解・コンピュータ操作の各ベンチマークでGPT-5 miniから大幅に性能が向上し、フルサイズのGPT-5.4に迫る実力を持ちながら2倍以上高速に動作します。

両モデルとも、OpenAIが推進するサブエージェントアーキテクチャの中核を担う存在として設計されており、フルモデルとの組み合わせでコストを抑えつつ高品質なAIシステムを構築できます。用途や予算に合わせて、ぜひ最適なモデルを選択してみてください。

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。