Google Cloud、Nvidia GPUでAI推論をサーバーレス化

Google Cloudが、AI推論向けの新たなサーバーレスアプローチを発表しました。

- Google CloudがAI推論にNvidia GPUを統合。

- サーバーレスで効率的なAI運用が可能に。

- コスト効率を考慮した新機能を提供。

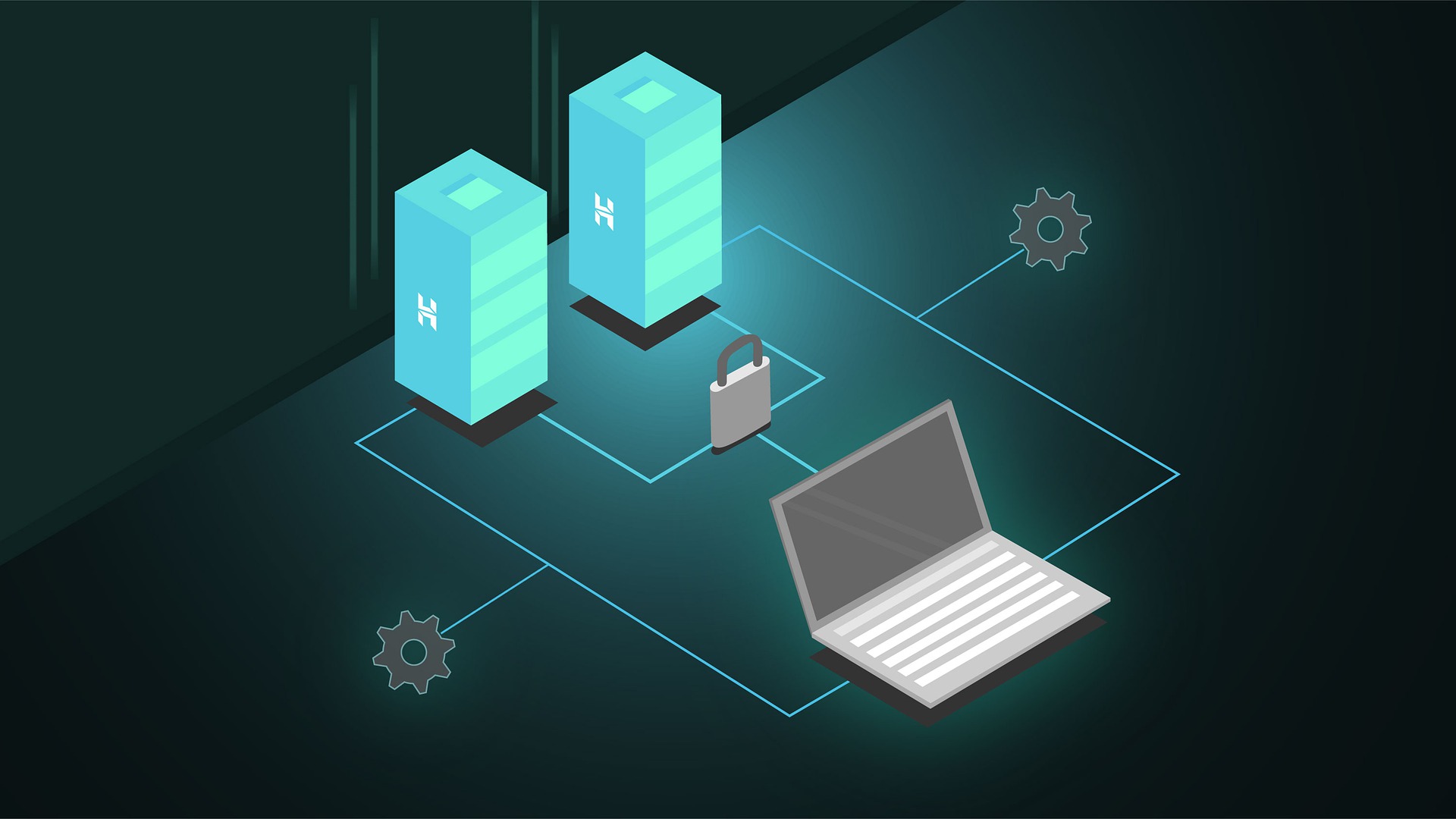

同社のサーバーレスプラットフォーム「Cloud Run」が、Nvidia L4 GPUを統合することで、組織はサーバーレスでのAI推論が可能になります。

この統合により、サービスは必要なときにだけ稼働し、使用した分だけの料金が請求されるというサーバーレスの特長がAI分野にも活用されることになりました。

従来、AI推論は長時間稼働するクラウドインスタンスやオンプレミスのハードウェアが必要でしたが、今回のアップデートにより、より柔軟で効率的なAI運用が期待されます。

さらに、Cloud Run上でのGPU対応により、リアルタイム推論やカスタムAIモデルの提供が可能となり、画像認識や3Dレンダリングなど計算集約型のサービスにも対応が可能です。

Google Cloudは、コールドスタートのパフォーマンスについても、11秒から35秒と高い応答性を示しています。

これにより、サーバーレスAI推論が従来のクラウドインスタンスに比べてコスト効率が高くなる可能性があります。

最適な運用コストの比較には、今後提供される新しい価格計算ツールが役立つでしょう。

参考記事:NVIDIA

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、朝の通勤時間に読めるメルマガを配信しています。

最新のAI情報を日本最速で受け取りたい方は、以下からご登録ください。

また、弊社紹介資料もご用意しておりますので、併せてご確認ください。