Google DeepMind「Gemma Scope 2」徹底解説!Gemma 3の挙動を読み解く解釈ツールキット

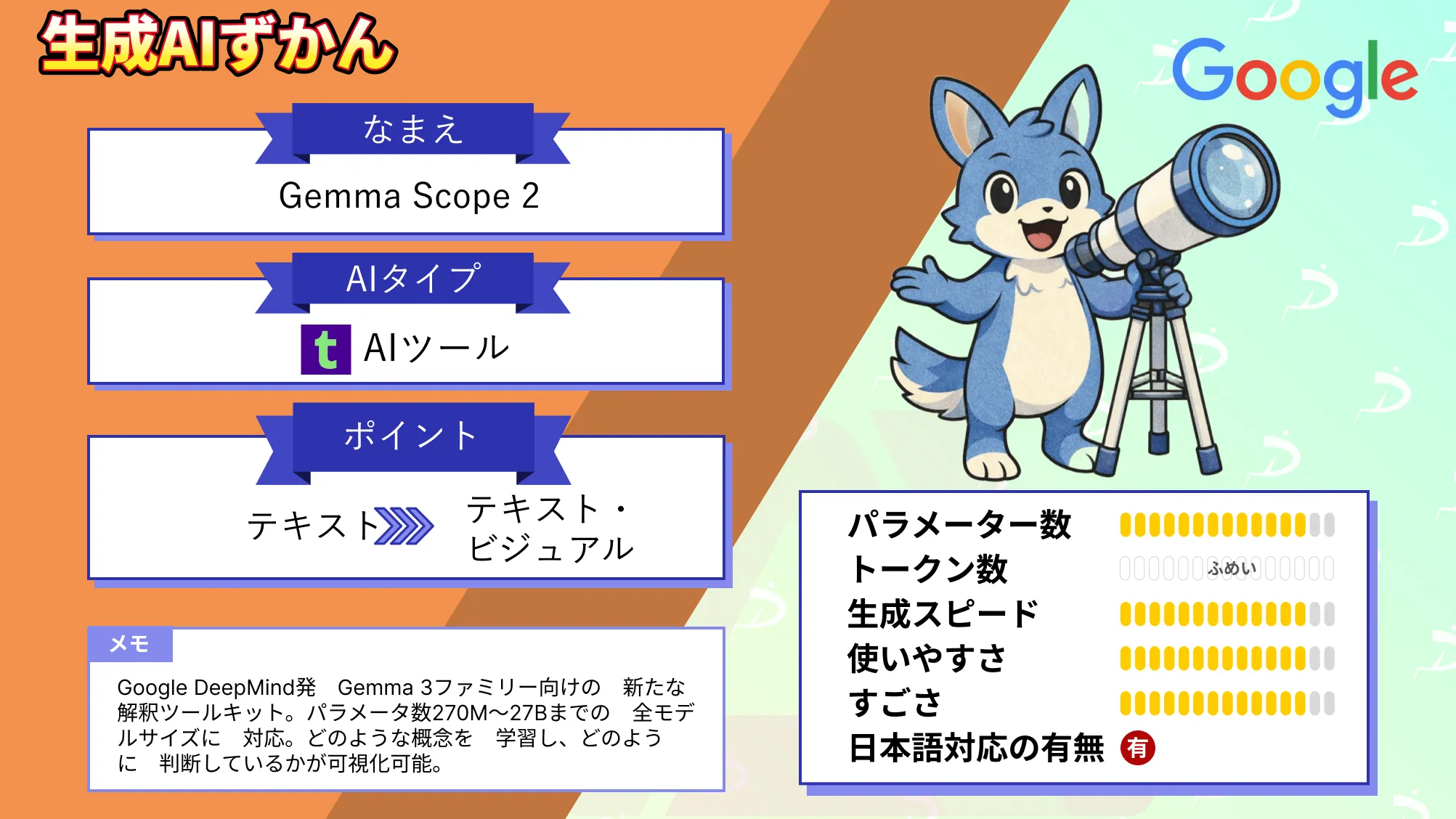

- Google DeepMind発、Gemma 3ファミリー向けの新たな解釈ツールキット

- パラメータ数270M~27Bまでの全モデルサイズに対応

- どのような概念を学習し、どのように判断しているかが可視化可能

2025年12月19日、Google DeepMindは、Gemma 3ファミリー向けの新たな解釈ツールキット「Gemma Scope 2」を公開しました!

これは、パラメータ数270M~27Bまでの全モデルサイズに対応するオープンソースの解析ツール群で、モデル内部の思考過程を細部まで「顕微鏡」のように観察することができるものになっています。

「Sparse Autoencoder (SAE)」と「トランスコーダ」を組み合わせる仕組みによって、モデルが、どのような概念を学習し、どのように判断しているかが可視化可能で、ハルシネーションや脱獄といった安全性リスクの解析が容易になるようです。

そこで本記事では、Gemma Scope 2の概要や性能、使い方や活用可能性を徹底的に解説します。

ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

Gemma Scope 2の概要

Gemma Scope 2は、言語モデルの内部挙動の解明を目的とした高度な解析ツールです。

仕組みとしては、各層に導入したSAEが、活性化パターンを圧縮・抽出し、モデルの隠れた概念を浮き彫りにします。

また、層間トランスコーダ(Cross-layer Transcoder)や、スキップ接続付きトランスコーダの採用で、多層にまたがる複雑な推論過程にも対応しています。

対応するモデル範囲は、Gemma 3の270M~27Bパラメータ全サイズに及んでいて、Gemma 2向けの従来版「Scope」を大幅に上回るフルカバレッジを実現しています。

DeepMindによると、110ペタバイト超のデータと、1兆パラメータ超を投入して訓練されたこのGemma Scope 2は、AI研究機関として史上最大規模の解釈ツールにあたるようです。

このツールキットによって、モデルのチェーン・オフ・ソート(CoT)やエージェント行動の解析、ジャイルブや幻覚・追従的応答といった問題の理解・デバッグが加速すると期待されています。

なお、Gemma 3 270Bについて詳しく知りたい方は、以下の記事も参考にしてみてください。

Gemma Scope 2の性能

Gemma Scope 2の特徴は、その圧倒的なスケールにあります。

開発には、約110PB以上のデータと、1兆パラメータ超の訓練がされていて、深層モデルの内部を網羅的に解析できるツールキットとなっています。

すべてのモデルサイズ(270M~27B)で、各層ごとのSAEとトランスコーダを提供し、大規模言語モデル特有の創発的挙動にも対応できます。

技術面では、Matryoshkaトレーニングなど最先端手法を採用し、SAEは高い疎性を保ちながら元の活性化を精度良く再構成します。

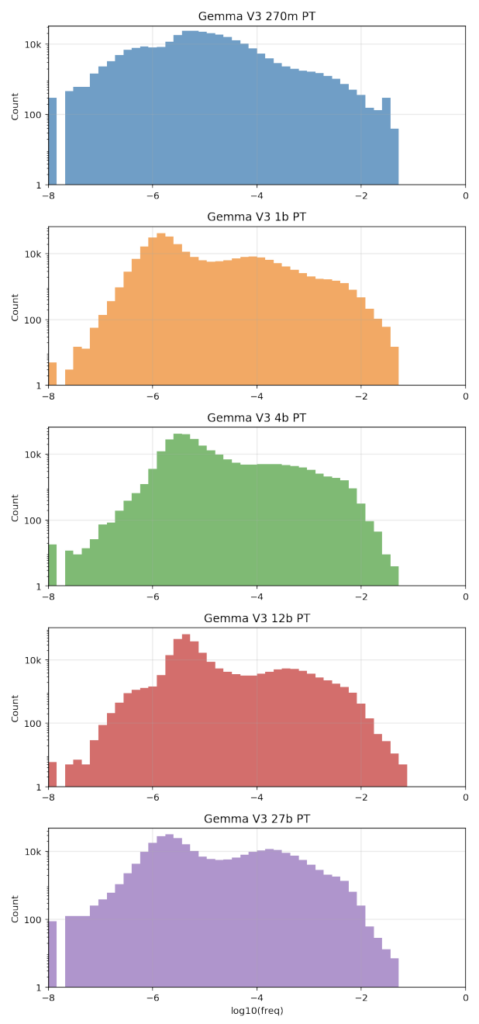

例えば、技術報告書の以下の図によると、全ての残差ストリーム用SAEにおいて、「活性化頻度10%超」の潜在変数は完全に排除でき、ほとんどの潜在変数が低頻度で活性化することが報告されています。

これによって、解釈可能性を維持しつつ、多層の複雑な計算を捉える性能が担保されているということが言えると思います。

なお、Gemma 3をベースにしたエンコーダ・デコーダモデル「T5Gemma 2」ついて詳しく知りたい方は、以下の記事も参考にしてみてください。

Gemma Scope 2のライセンス

Gemma Scope 2のモデルの重みは、CC-BY-4.0(クリエイティブコモンズ表示 4.0)の許諾で公開されています。

このライセンスは、帰属表示(クレジット)を条件に、商用利用・改変・再配布を広く許可するものです。

例えば、商用プロジェクトでの利用や改造も可能ですが、著作権表示を明示する必要があります。

| 利用用途 | 可否 | 備考 |

|---|---|---|

| 商用利用 | ⭕️ | 帰属表示が必要 |

| 改変 | ⭕️ | 変更後も帰属表示を保持する必要あり |

| 配布 | ⭕️ | |

| 特許使用 | 不明 | 明示的許諾なし |

| 私的使用 | ⭕️ |

Gemma Scope 2の料金

Gemma Scope 2および対応するGemma 3モデルはすべて無償で利用可能なオープンソースです。

ツールキット本体やモデルウェイトのダウンロード・利用に費用は発生しません。

Gemma Scope 2の使い方

Gemma Scope 2を使うには、①公式デモサイト、②GoogleColabチュートリアル、③HuggingFaceからダウンロードの3つの方法があります。

①公式デモサイト

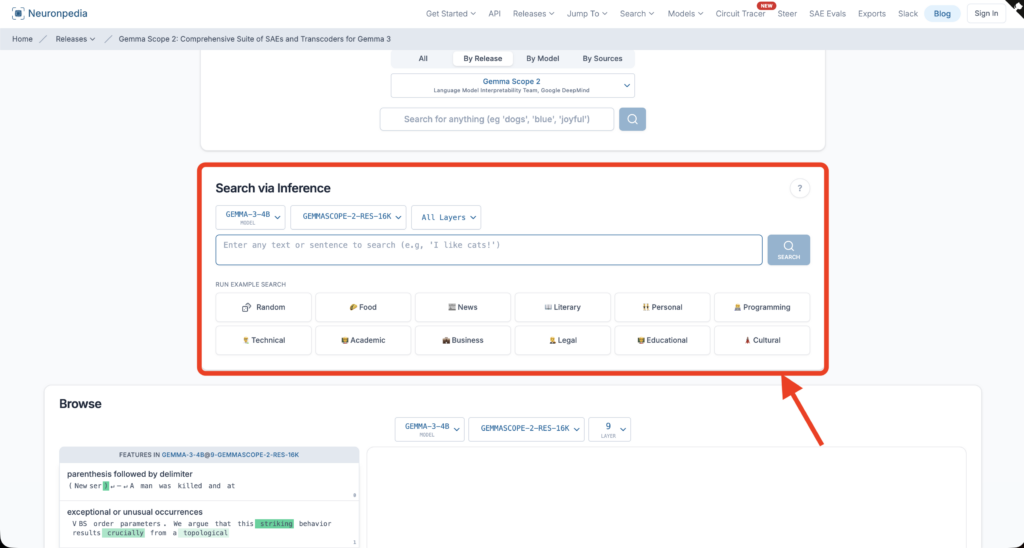

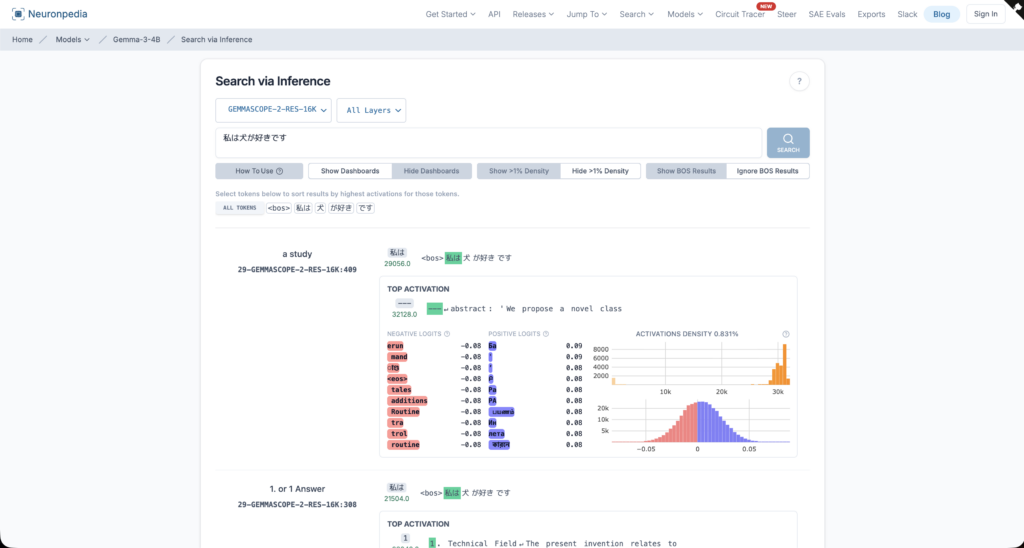

まずは、ブラウザで試すことができるNeuronpediaの公式デモがおすすめです。

Gemma Scope 2のページを開いたら、Search via Inferenceの「MODEL」から(例:Gemma 3 4Bなど)を選び、次に「Source/SAE」を選択します。

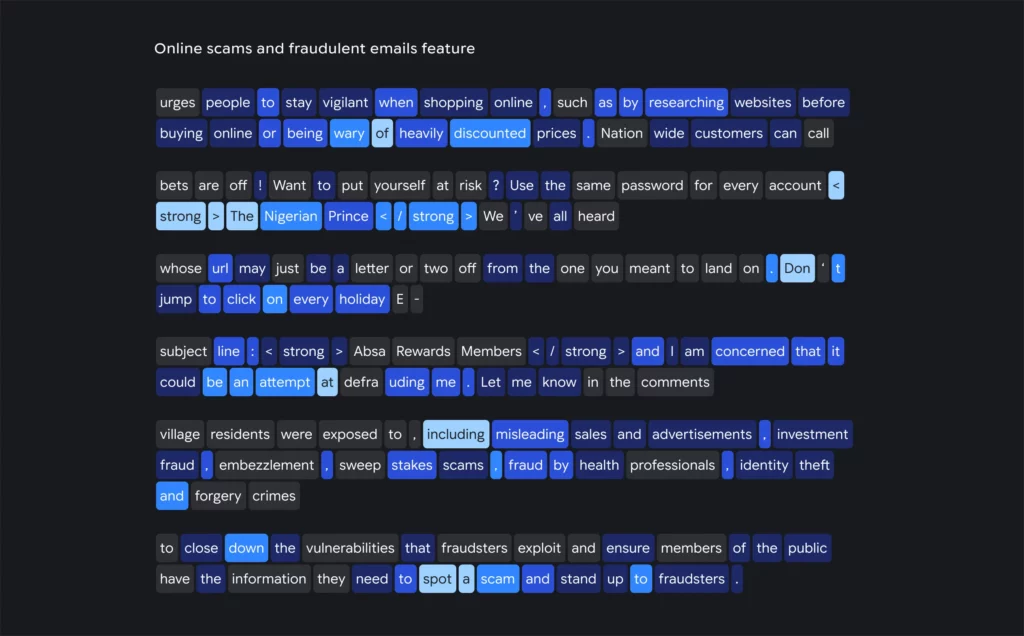

あとはテキストを入れて実行すると、どの概念(特徴)が、どのトークンに反応しているかを可視化しながら眺めることができます。

例えば、入力テキストを「私は犬が好きです」として実行した場合は、以下のように結果が返ってきます。

②GoogleColabチュートリアル

次に、Colabチュートリアルの紹介です。

リンクを開いたら、上から順にセルを実行していきます(必要に応じてドライブにコピーして保存してから実行)。

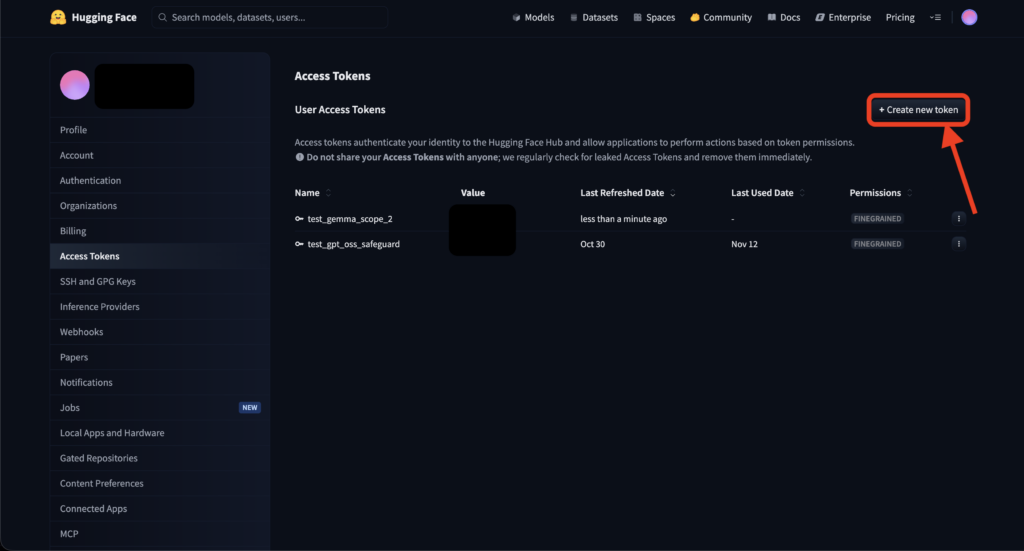

実行にはHuggingFaceのアクセストークン発行が必要になるので、こちらのページから発行するようにしましょう。

また、途中でモデルサイズや対象レイヤーを選ぶ部分が出てきたら、最初は小さめのモデルにしておくと詰まりにくいと思います。

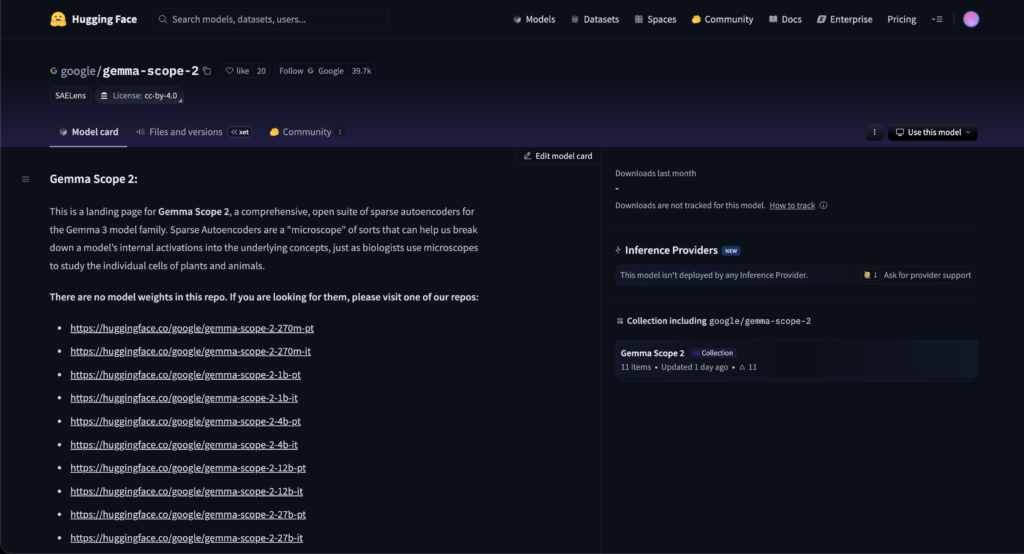

③HuggingFaceからダウンロード

最後に、HuggingFaceのモデルページからモデルの重みをダウンロードして、ローカル実行する方法です。

案内されている各サイズ(270M/1B/4B/12B/27B)からお好みのモデルを選択し、リポジトリへ移動します。

まずは「4B-PT」か「4B-IT」あたりを選んで、READMEに沿ってチェックポイント(SAE/Transcoder)をダウンロードして使うのが良いかと思います。

HuggingFace CLIを入れてログインし、対象リポジトリを--local-dirで指定したフォルダへダウンロードします。

# CLIを入れる(どれか1つでOK)

pip install -U "huggingface_hub[cli]"

# 認証(初回だけ。ブラウザが開くのでトークンでログイン)

hf auth login

# 例:4B-PT をローカルに保存(フォルダ名は好きに変えてOK)

hf download google/gemma-scope-2-4b-pt --local-dir ./gemma-scope-2-4b-ptGemma Scope 2の活用可能性

最後に、Gemma Scope 2を「どんな場面で役立てられるか」のイメージをご紹介します。

Gemma Scope 2は、モデルが何を考えて、どうその結論に至ったかを辿れるようにすることが狙いです。

特に、脱獄や幻覚、お世辞といった安全性に関わる挙動を、ブラックボックスのまま放置せずに検証できる点が大きな価値になります。

安全インシデントの原因究明

たとえば、あるプロンプトで急に拒否が崩れて危険な回答を返したとき、通常のログだけでは結果しか追えません。

Gemma Scope 2は、SAEやトランスコーダーを組み合わせてモデル内部を観察し、どんな特徴に反応し、それが最終的な挙動にどう繋がったかを追跡するものでした。

ここでのポイントは、単に「危ない出力を検知する」ではなく、危険な挙動に至る過程を手がかりにできることです。

DeepMindは、脱獄のような安全性に関わる挙動の研究をより豊かにし、実用的で強固な安全介入につなげたい、という文脈で位置づけています。

幻覚・お世辞・根拠がずれている場合のデバッグ

Gemma Scope 2は、モデルの推論と内部状態の不一致など、安全性に関係する論点も扱えるとされていて、表面上は筋が通っているのに実は根拠が薄い、といったケースの検証にも向いています。

さらに、チャット用に調整されたGemma 3向けに、脱獄・拒否メカニズム・Chain-of-Thoughtの忠実性(faithfulness)といった複雑な振る舞いを分析するためのツールも提供すると説明されています。

これを使うと、成功・失敗ではなく、「どの条件で破綻しやすいか」「どこで挙動が分岐するか」を観察して、プロンプトや運用ルール、評価設計の改善に繋げやすくなります。

まとめ

Gemma Scope 2は、DeepMindが提供するGemma 3向けの大規模・オープンソース解析ツールキットです。

Sparse Autoencoderとトランスコーダを駆使してモデル内部の概念を可視化し、幻覚など安全上の課題解決を支援します。ツール自体は無償ですが、解析にはGPUなどの計算資源が必要となる点に留意が必要です。

今後、Gemma Scope 2を活用した研究や開発が進めば、大規模言語モデルの信頼性向上やAI安全性確保の新たなスタンダードとして定着していくと思います。

気になる方は、ぜひ一度試してみてください!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。