D4RTとは何か?Google DeepMindが示す高速4Dシーン再構成・追跡モデルの全体像を解説

- 動的シーンを4Dで解釈できる統合AIモデル

- 最大300倍の処理効率と単眼RGB動画のみの入力による高い実用可能性

- 研究段階の公開であり一般ユーザーの利用方法については明記なし

2026年1月、Googleから新たなAIモデルが公開されました。

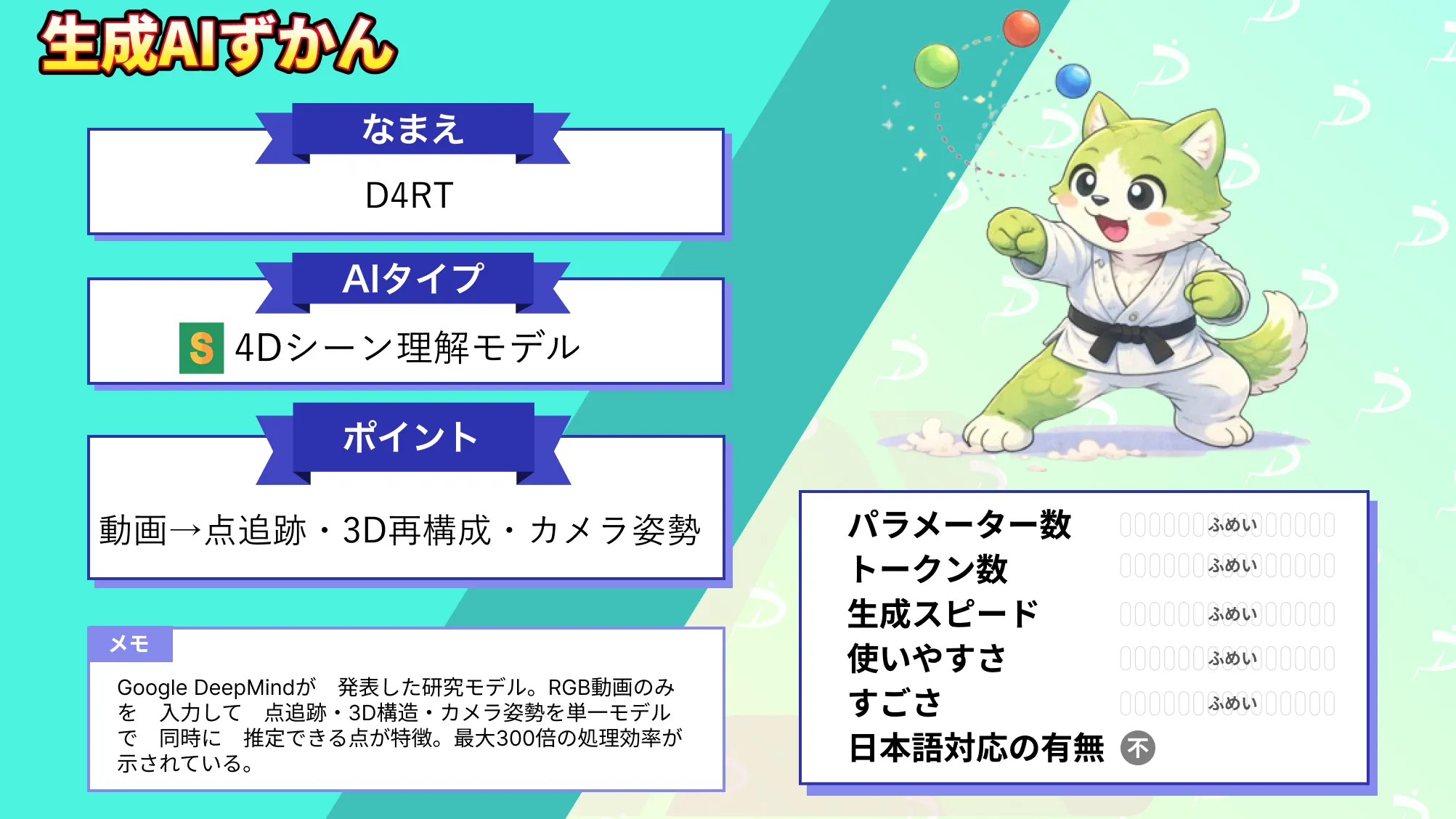

今回発表された「D4RT」は、RGB動画のみを入力として、点追跡・3D再構成・カメラ姿勢推定を単一モデルで同時に行う技術です。動きのあるシーンを空間と時間を含む4Dとして一貫して捉えられる点が大きな特徴です。

一方で、研究モデルとして登場した技術は、「結局どこが新しいのか」「従来手法と何が違うのか」「実務やプロダクト開発にどう関係するのか」が分かりにくいことも少なくありません。

そこで本記事では、D4RTの概要や仕組み、活用事例について解説します。本記事を最後までお読みいただければ、D4RTがどのような技術で、どのように活用するのかが理解できます。

ぜひ最後までお読みください。

\生成AIを活用して業務プロセスを自動化/

D4RTの概要

D4RTは、空間に時間を加えた「4D」として、動きのあるシーンを復元・追跡するための統合AIモデルです。

このモデルは、2Dの動画入力から、動く3D世界の形状と運動を同時に推定することができます。

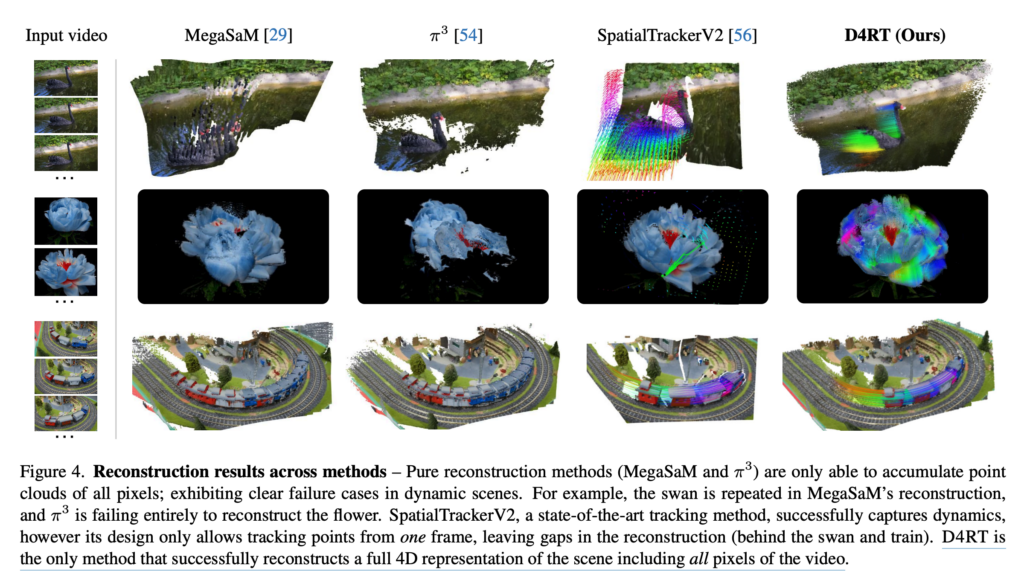

従来は、深度推定、動き推定、カメラ推定などを別々のモジュールで組み合わせる設計が一般的でした。しかし、従来の方法では計算負荷や構成の複雑さがボトルネックになっていました。

D4RTは、こうした動的シーン復元を単一の効率的な枠組みに統合したモデルであり、従来では断片的になっていた情報を一つにまとめます。

D4RTで特筆すべきは、最大で300倍という効率性の向上です。これにより、ロボティクスやARといったリアルタイム性が求められる領域での実用化も視野に入ります。

処理速度の向上だけでなく、動的オブジェクトの扱いにおいても従来よりも性能が上がっています。これまでの手法では動くオブジェクトの復元が破綻していましたが、D4RTは破綻が少なくなっています。

D4RTの仕組み

ここでは、D4RTがどのような流れで入力動画から4D表現を生成しているのかを解説します。

4Dを直接最適化する統合モデル

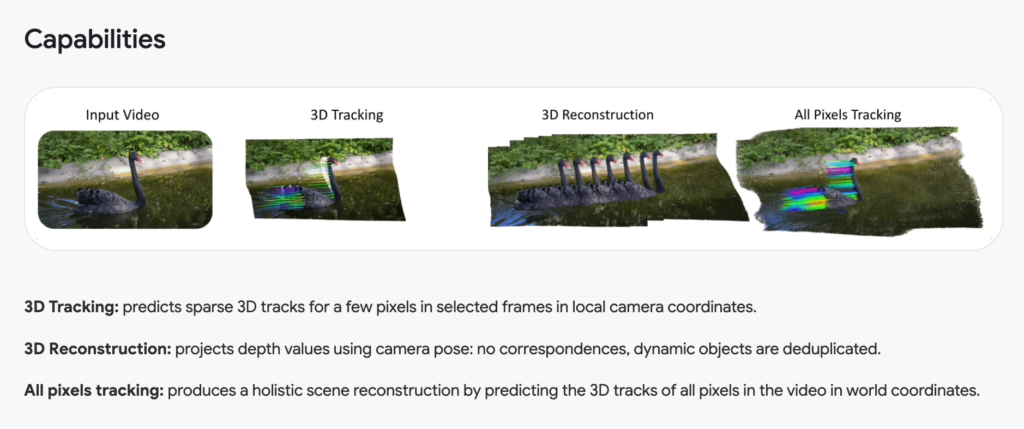

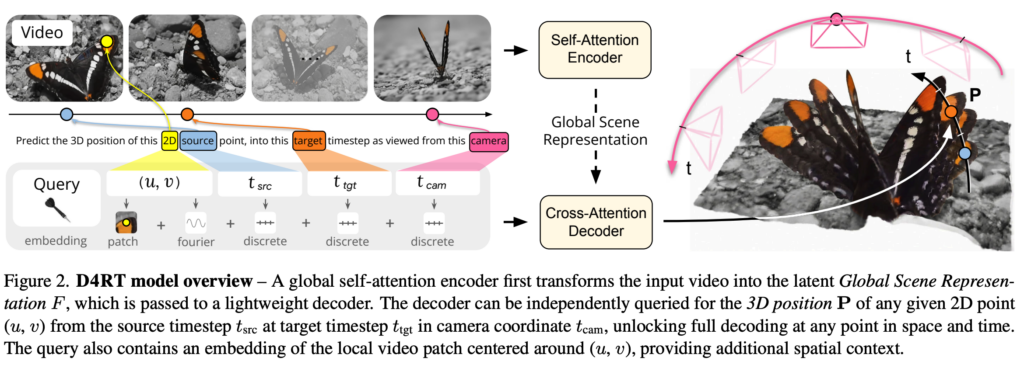

D4RTの最たる仕組みは、動画から点の軌跡(Point Tracking)と3D構造、さらにカメラ姿勢を同時に推定する統合アーキテクチャです。

従来手法では、まず2Dトラッキングを行い、その後に3D復元や姿勢推定を重ねる分離設計が一般的でした。

一方、D4RTは空間と時間をまとめて最適化する「4D表現」を直接学習対象としています。これにより、動く物体と静的背景を同一の枠組みで扱えることが可能です。

動画入力から4D再構成まで

入力はRGB動画のみで、深度センサーや事前に与えられた3D情報を必要としません。

まず、フレーム間で追跡される点が抽出され、それぞれが時系列の軌跡として表現。

次に、これらの点軌跡を手がかりとして、各時刻における3D点群が同時に最適化されます。併せて、カメラの移動や姿勢も内部表現として推定されます。

こうした同時最適化により、「どの点が、いつ、どこにあったのか」という4D情報が一貫して得られる仕組みとなっています。

D4RTの特徴

D4RTには、主に3つの特徴があります。それぞれが独立しているのではなく、相互に補完し合っています。

統合された4D表現による一貫性

最大の特徴は、点追跡・3D再構成・カメラ姿勢推定を単一モデルで同時に扱う点です。

従来は個別モジュールを組み合わせる必要があり、誤差の蓄積が課題でした。

D4RTでは4D表現を直接最適化するため、時間方向の整合性が自然に保たれます。その結果、動的オブジェクトが存在するシーンでも安定した復元が可能。

動的シーンに対する高い安定性

D4RTは、静的背景だけでなく動く物体を含むシーンを前提としています。

特に、フレーム間で物体が大きく移動する場合でも、点の対応関係が破綻しにくいことがテクニカルレポート上で実証されています。

これは、時間方向を含めた同時最適化によって、局所的なズレが全体で吸収されるため。結果として、動画全体を通じて一貫した点群と軌跡が得られる構造となっています。

高効率な処理性能

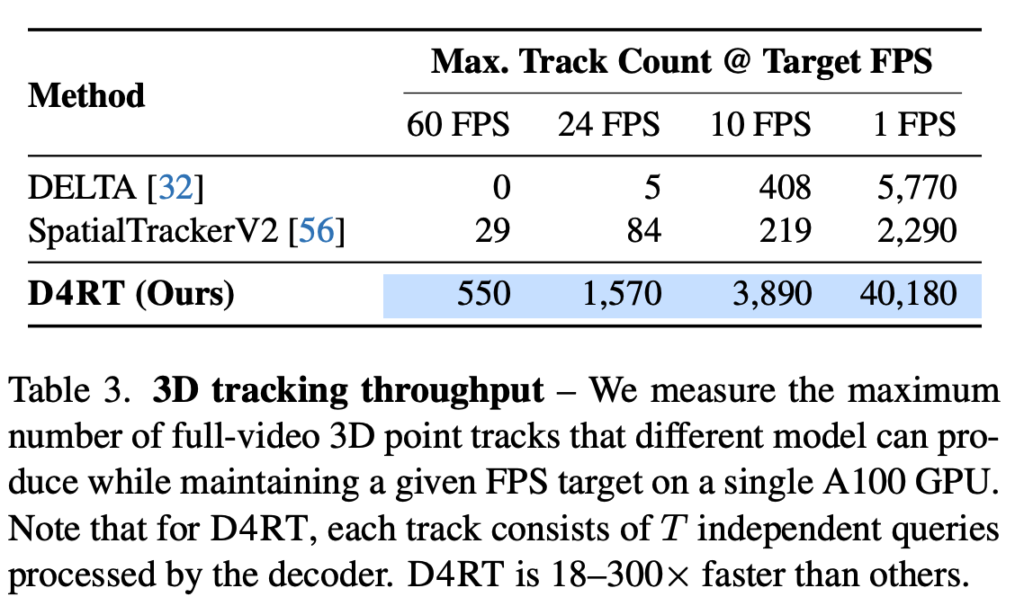

性能面では、処理効率の高さが明確に示されています。従来手法と比較して最大300倍の効率性が報告されています。

上記は目標FPSを維持したまま処理できる3Dポイント追跡数の上限を比較した結果です。D4RTは60FPS時でも550点、10FPSでは3,890点を同時追跡でき、既存手法を大きく上回ります。

特に低FPS条件では4万点以上の追跡が可能で、従来手法比で18〜300倍のスループット向上が示されています。

なお、LLM開発をベンダーロックインから解放するOpen Responsesについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

PersonaPlex-7Bの安全性・制約

D4RTは動的シーンの4D再構成において高い技術的完成度を示していますが、現時点では研究段階のモデルであり、実運用にあたっては制約や注意点が存在します。

安全性の観点では、D4RTは映像入力に基づく幾何推定モデルであり、意思決定や行動制御を直接行うシステムではありません。推定結果は確率的な予測に基づくため、誤推定や局所的な破綻の可能性があります。ロボット制御や自動化処理に接続する場合は、追加の検証やフェイルセーフ設計が必要です。

また、評価はA100 GPUやTPUといった高性能計算環境を前提としており、エッジデバイスや低リソース環境で同様の性能が保証されるわけではありません。さらに、単眼RGB動画のみを入力とする設計上、極端な照明変化や激しいモーションブラーがある場合、推定精度が低下する可能性があります。

D4RTの料金

D4RTの料金については、公式サイトに記載はありませんでした。また、本記事執筆(2026年1月)時点では、一般ユーザーの利用方法は明記されていません。

D4RTのライセンス

ライセンスについても料金同様、記載はありません。またテクニカルレポートでも言及されていませんでした。

なお、Sakana AIの文脈再配置技術であるRePoについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

D4RTの活用シーン

ここでは、D4RTの特性を踏まえた活用シーンを解説します。

ロボティクス・自律移動分野

ロボット分野では、周囲環境を動的に理解し続ける能力が不可欠です。D4RTは、カメラ入力のみから動く物体と静的構造を同時に把握できます。

そのため、障害物回避や環境理解を4Dで行う基盤としての活用が考えられます。従来のSLAM手法では困難だった動的環境への対応が改善される可能性があり、移動ロボットやドローンでの視覚認識強化につながると考えられます。

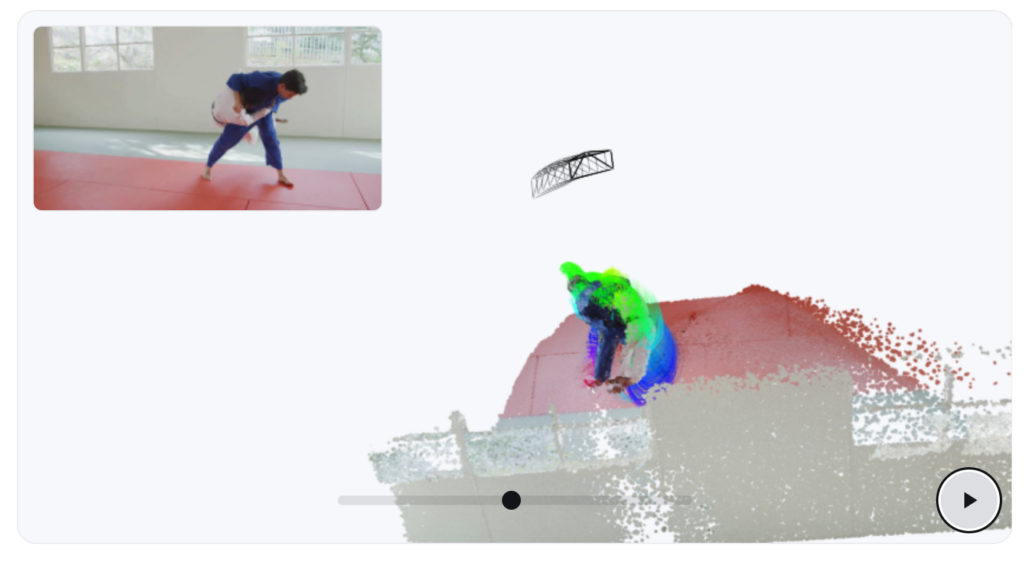

AR・XRコンテンツ制作

ARやXRでは、ユーザーの周囲にある動的な物体を正しく捉えることが重要。D4RTは、人物や物体の動きを含めた空間復元を行うことができます。

これにより、仮想オブジェクトと現実空間の整合性が高まると考えられます。動く対象に対して破綻しにくい点は、没入感向上に直結し、空間コンピューティング基盤の一部として利用される可能性もあります。

映像解析・シミュレーション分野

映像解析では、動画内の物体構造と動きを同時に把握するニーズがあります。D4RTの点軌跡と点群表現は、物理シミュレーションや再現解析に適しているでしょう。

例えば、人物動作や物体挙動の解析に応用できる可能性があります。単なる2D解析を超えた理解が可能になる点が価値であり、研究用途や高度な解析業務での利用が考えられます。

なお、複雑なタスクをAIが自動化するfabricについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

まとめ

本記事ではD4RTの概要から仕組み、活用事例について解説を行いました。本記事執筆(2026年1月)時点ではまだ一般ユーザーに公開はされておらず、利用することができませんが、モデルが公開された際には利用してみたいと思います!

最後に

いかがだったでしょうか?

D4RTのような先端研究を、PoCで終わらせず実運用につなげるには、技術理解と業務設計の両立が欠かせません。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。