【GPT-Realtime-2】GPT-5級の推論で音声AIが進化!リアルタイム音声モデルの性能・料金・使い方を徹底解説

- GPT-Realtime-2は、OpenAIが2026年5月8日に公開したGPT-5クラスの推論能力を持つリアルタイム音声モデル

- コンテキストウィンドウが従来の32Kから128Kトークンに4倍拡大し、長時間の複雑な会話にも対応

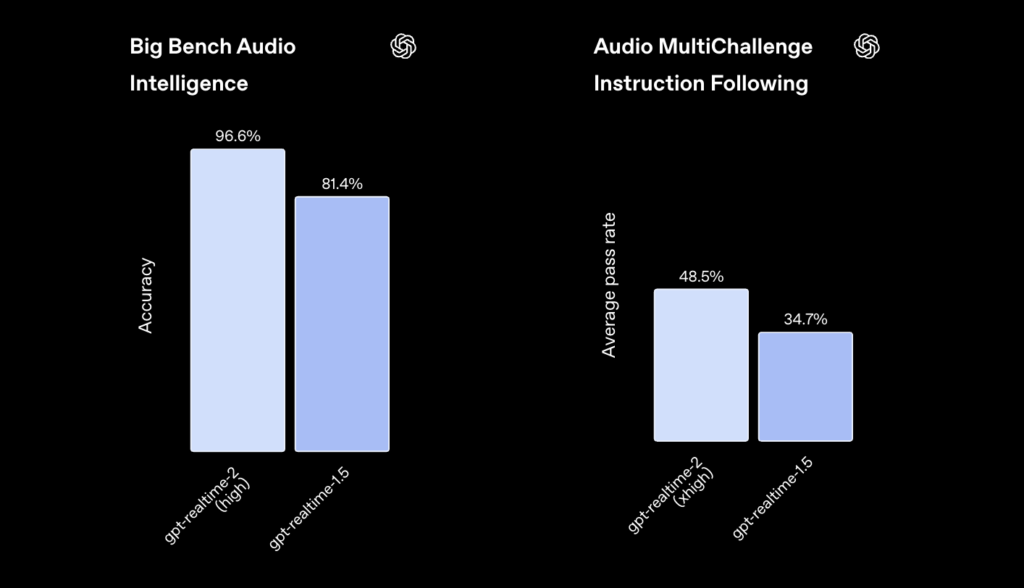

- Big Bench Audioベンチマークで96.6%の精度を達成(前モデルGPT-Realtime-1.5は81.4%)

2026年5月8日、OpenAIはGPT-5クラスの推論能力を持つ最新のリアルタイム音声モデル「GPT-Realtime-2」を発表しました!

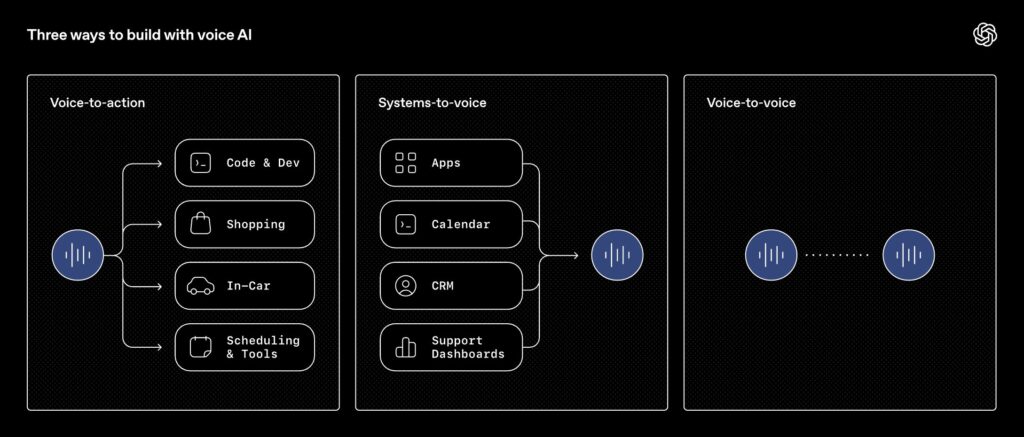

従来の音声AIは「話しかけたら返事が返ってくる」止まりでしたが、GPT-Realtime-2では会話中にツール呼び出しや推論を同時にこなし、まるで人間の同僚と話しているような自然なやり取りが可能になりました。

とはいえ、「どうやって使うの?」「料金はどれくらい?」「自分のサービスに組み込めるの?」と気になっている方も多いのではないでしょうか。

そこで本記事では、GPT-Realtime-2の概要から仕組み、ベンチマーク結果、料金体系、具体的な使い方までを徹底解説します。最後まで読めば、GPT-Realtime-2を自社の音声アプリケーションに活用するための知識が一通り身につきます。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

GPT-Realtime-2とは?

GPT-Realtime-2は、OpenAIがRealtime APIを通じて提供する最新のspeech-to-speechモデルです。

2026年5月8日、GPT-Realtime-Translate(リアルタイム翻訳モデル)およびGPT-Realtime-Whisper(ストリーミング文字起こしモデル)とあわせて3つの音声モデルが同時にAPIで利用可能になりました。その中でGPT-Realtime-2は、フラッグシップの推論モデルという位置づけです。

| 項目 | 内容 |

|---|---|

| 開発元 | OpenAI |

| 公開日 | 2026年5月8日 |

| モデル種別 | リアルタイム音声推論モデル(speech-to-speech) |

| コンテキストウィンドウ | 128Kトークン |

| 推論レベル | minimal〜xhighの5段階で調整可能 |

| 対応接続方式 | WebRTC・WebSocket・SIP |

| 利用方法 | Realtime API経由 |

最大の特徴は、音声入力をテキストに変換せず、音声のまま直接処理するspeech-to-speech方式を採用している点にあります。これによって、笑い声や感情のニュアンスといった非言語的な音も捉えられるほか、会話途中の言語切り替えにも対応できます。

また、前モデルのGPT-Realtime-1.5と比較すると、コンテキストウィンドウが32Kトークンから128Kトークンに4倍拡大されました。これにより、長時間にわたる顧客対応や複雑なマルチターン会話でも、文脈を失わずに対話を続けられます。

さらに、推論の深さを「minimal」から「xhigh」まで5段階で調整できる可変推論レベル(reasoning effort)機能が搭載されています。簡単な質問には素早く応答しつつ、複雑な問題には時間をかけて推論するといった柔軟な使い分けが可能となっています。

OpenAIのWhisperについて、詳しく知りたい方は以下の記事も参考にしてみてください。

GPT-Realtime-2の仕組み

GPT-Realtime-2は、エンドツーエンドのspeech-to-speechアーキテクチャを採用しています。

ユーザーの音声はテキストに変換されることなく、モデルが直接オーディオ信号として取り込み、推論処理を行ったうえで音声として出力します。従来のように「音声認識→テキスト処理→音声合成」というパイプラインを経由しないため、レイテンシの大幅な短縮と、より自然な応答が実現されています。

接続プロトコルとしては、WebRTC・WebSocket・SIP(Session Initiation Protocol)の3種類に対応しています。WebRTCはブラウザベースのアプリケーション、WebSocketはサーバーサイド統合、SIPは既存の電話システムとの連携に適しており、用途に応じた最適な接続方式を選択できます。

また、GPT-Realtime-2のアーキテクチャ上の重要なポイントとして、並列ツール呼び出し(Parallel Tool Calls)への対応があります。例えば、ユーザーが「来週の予定を確認して、近くのレストランも探して」と話しかけた場合、カレンダーAPIと地図検索APIを同時に呼び出し、結果をまとめて応答することが可能です。

GPT-Realtime-2の特徴

GPT-Realtime-2には、前モデルから大幅に進化したポイントが複数あります。

まず注目すべきは、ベンチマークでの性能向上です。OpenAI公式の発表によると、Big Bench Audioベンチマーク(音声での知能テスト)において、GPT-Realtime-2(highモード)は96.6%の精度を記録しました。前モデルのGPT-Realtime-1.5が81.4%だったことを考えると、約15ポイントの向上です。

さらに、マルチターン会話での指示遵守精度を測るAudio MultiChallengeベンチマークでは、xhighバリアントが48.5%の平均通過率を達成し、前モデルの34.7%から約14ポイント改善しています。関数呼び出しの正確性を測定するComplexFuncBenchでも、66.5%(前モデルは49.7%)と大きな性能向上が確認されています。

音声表現力の面では、トーンコントロール機能が追加されました。「早口でプロフェッショナルに」「共感的にフランス語アクセントで」といったきめ細かな話し方の指定が可能です。

専門用語への対応力も強化されました。医療用語や固有名詞、業界特有の専門用語の認識精度が向上しており、ヘルスケアや不動産、法律といった専門的な分野での実運用に耐える水準を目指しています。

GPT-Realtime-2の安全性・制約

音声AIの実運用においては、安全性の確保が欠かせません。OpenAIはGPT-Realtime-2に対して、複数のセーフティ機構を組み込んでいます。

まず、アクティブな分類器(Active Classifier)が搭載されており、有害なコンテンツや不正利用の兆候が検出された場合はすぐに会話が停止されます。開発者側でも追加のセーフガードを設定できる仕組みが用意されているため、業界のコンプライアンス要件にあわせたカスタマイズが可能です。

また、EUデータレジデンシー(EU圏内でのデータ保持)にも対応しており、OpenAIのエンタープライズプライバシーコミットメントの対象サービスとなっています。これによって、EUの規制要件に準拠したアプリケーション開発が行えます。

GPT-Realtime-2の料金

GPT-Realtime-2の料金体系は、トークンベースの従量課金制を採用しています。OpenAI公式のRealtime APIプライシングをもとに、あわせて発表された他のリアルタイム音声モデルと比較してみましょう。

| モデル名 | 入力料金 | キャッシュ入力 | 出力料金 |

|---|---|---|---|

| GPT-Realtime-2(音声) | $32.00 / 100万トークン | $0.40 / 100万トークン | $64.00 / 100万トークン |

| GPT-Realtime-2(テキスト) | $4.00 / 100万トークン | $0.40 / 100万トークン | $16.00 / 100万トークン |

| GPT-Realtime-2(画像) | $5.00 / 100万トークン | $0.50 / 100万トークン | ─ |

| GPT-Realtime-Translate | $0.034 / 分 | ─ | ─ |

| GPT-Realtime-Whisper | $0.017 / 分 | ─ | ─ |

GPT-Realtime-2の料金設定は、前世代のgpt-4o-realtime-previewと比較して約20%の値下げが実施されています。特にキャッシュ入力が100万トークンあたり$0.40と大幅に安価なため、繰り返し同じシステムプロンプトを使用するシナリオではコストを大きく抑えることが可能です。

GPT-Realtime-2のライセンス

GPT-Realtime-2は、OpenAIのRealtime APIを通じて提供されるクラウドホスティング型のプロプライエタリモデルです。オープンソースモデルとは異なり、モデルの重みやソースコードが公開されているわけではないため、一般的なOSSライセンスの概念はそのまま適用されません。

| 項目 | 可否 |

|---|---|

| 商用利用 | ⭕️ |

| 出力の改変 | ⭕️ |

| 再配布(モデル自体) | ❌️(モデルの重みやコードは非公開・再配布不可) |

| 特許利用 | -(OpenAIが特許権を保持。API経由の利用は規約に準拠) |

| 私的利用 | ⭕️ |

GPT-Realtime-2の使い方

ここからは、GPT-Realtime-2を実際に使い始めるための手順を解説していきます。Playground(ブラウザ上のテスト環境)で手軽に試す方法と、APIで本格的に組み込む方法の2パターンがあります。

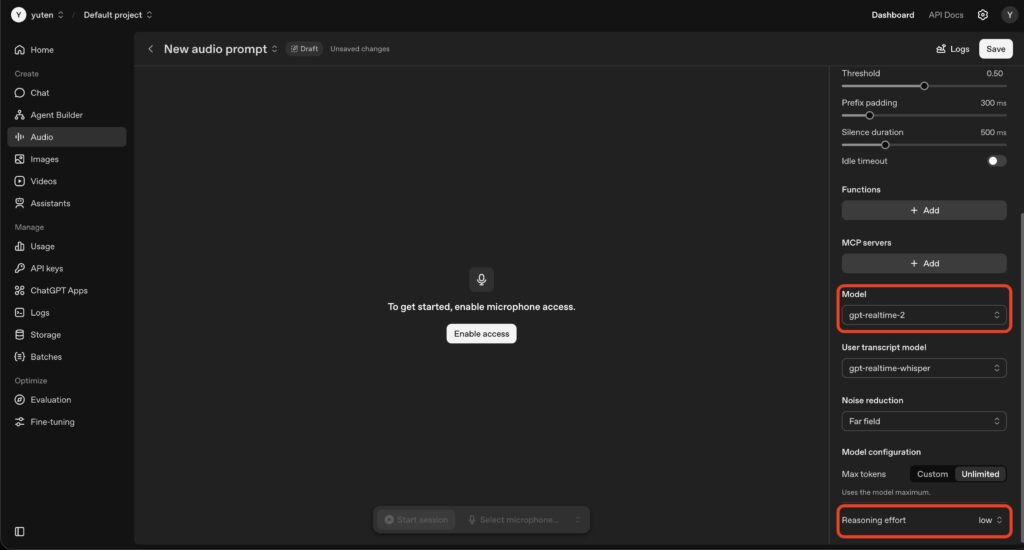

Playgroundで試す

もっとも手軽にGPT-Realtime-2を体験できるのが、OpenAI Playgroundです。コーディング不要で、ブラウザ上から直接音声でやり取りできます。

Playgroundを開く

ログイン後、左サイドバーから「Audio(Playground)」を選択します。

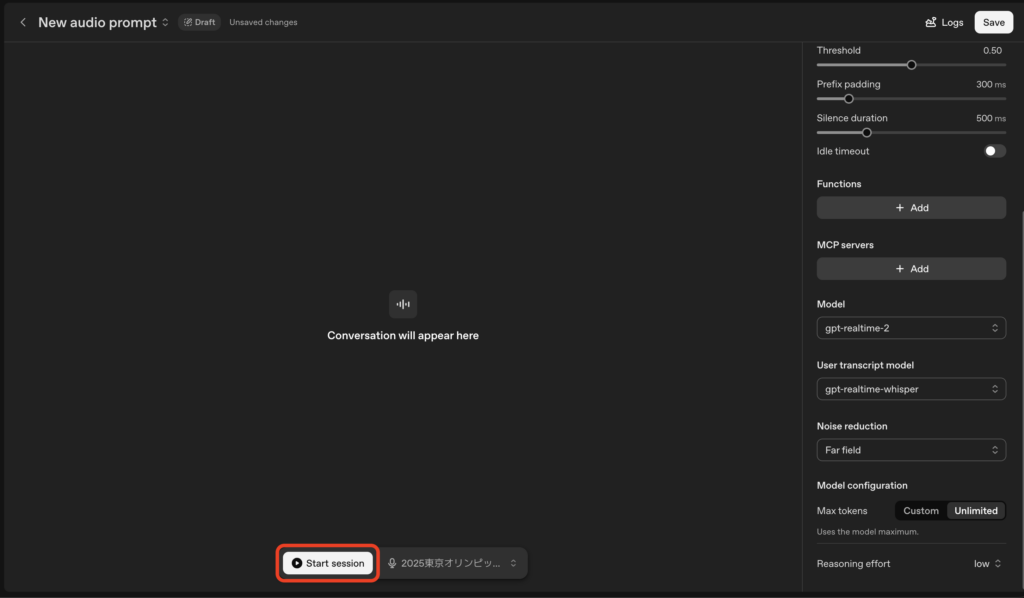

セッションを開始

「Enable access」ボタンをクリックすると、マイクが有効化されます。「Start session」をクリックし自然に話しかけるだけで、GPT-Realtime-2が音声でリアルタイムに応答します。

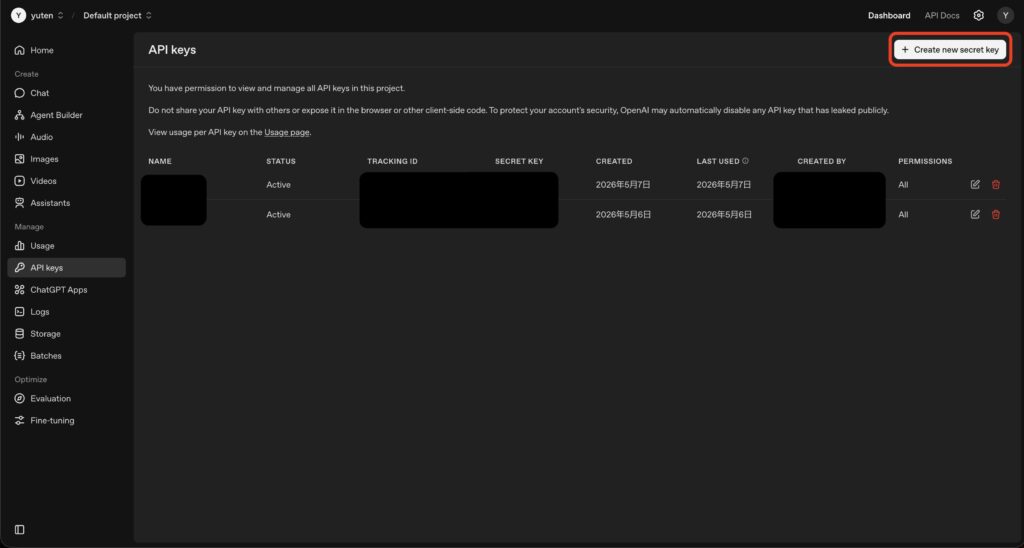

Realtime APIで実装する(WebSocket)

プロダクションレベルで音声機能をアプリケーションに組み込む場合は、Realtime APIを使います。以下は、WebSocketベースの基本的な接続例です。

WebSocket接続を確立

以下のようにWebSocketで接続します。

import asyncio

import websockets

import json

url = "wss://api.openai.com/v1/realtime?model=gpt-realtime-2"

headers = {

"Authorization": "Bearer YOUR_API_KEY",

"OpenAI-Beta": "realtime=v1"

}

async def connect():

async with websockets.connect(url, extra_headers=headers) as ws:

# セッション設定

await ws.send(json.dumps({

"type": "session.update",

"session": {

"modalities": ["text", "audio"],

"voice": "cedar",

"instructions": "あなたは親切な日本語アシスタントです。"

}

}))

response = await ws.recv()

print(json.loads(response))

asyncio.run(connect())ツール呼び出しの設定(オプション)

外部APIと連携したい場合は、toolsパラメータに関数定義を追加します。GPT-Realtime-2は並列ツール呼び出しにも対応しているため、複数のツールを同時に実行できます。

なお、WebRTCやSIP経由での接続も可能です。ブラウザアプリにはWebRTC、電話システムとの統合にはSIPがそれぞれ推奨されています。詳しくはOpenAIのRealtime APIドキュメントを参照してください。

Codex経由で導入する

OpenAIのコーディングエージェントCodexを使えば、既存のプロジェクトにGPT-Realtime-2を素早く追加することも可能です。

Codexアプリをインストール済みであれば、公式で紹介されている以下のプロンプトをそのまま実行するだけで、既存アプリへのGPT-Realtime-2統合や新規アプリの雛形生成を行うことができます。

Build or add a minimal Realtime 2 WebRTC voice agent using the gpt-realtime-2 model.

Use the latest OpenAI Realtime API docs for the WebRTC and session setup patterns. If this folder already contains an app, add it to the existing app. Otherwise, create a small local web app. Add a server-side session endpoint that uses OPENAI_API_KEY and posts browser SDP to /v1/realtime/calls following the docs exactly: multipart FormData fields named sdp and session, not file uploads. Connect browser microphone input and model audio output with RTCPeerConnection, open an oai-events data channel, and register one sample function tool with session.update: check_calendar(date, time), which returns whether the requested time is available.

Keep it small and include setup/run instructions.コードの雛形生成から実装までをCodexに任せられるため、音声AI開発のハードルがぐっと下がります。

SNSで話題!「翻訳の速さ」と「割り込み対応」に驚きの声

GPT-Realtime-2の発表直後から、X上ではリアルタイム翻訳のスピード感と割り込み対応の自然さが特に話題を集めています。

同時発表されたGPT-Realtime-Translateは、70以上の入力言語を13の出力言語にリアルタイム変換するモデルで、さまざまなリアルタイム翻訳再生デモがSNS上で反響を呼んでいます。

もうひとつ注目されているのが、GPT-Realtime-2の割り込み対応です。

従来の音声AIでは、回答中にユーザーが割り込むと文脈が失われるケースが多くありましたが、GPT-Realtime-2ではコンテキストを保持したまま軌道修正が可能です。エラー時も無言で停止せず「今少し問題が発生しています」と音声で報告するリカバリー機能が搭載されており、会話が壊れない安心感を評価する声が出始めています。

【業界別】GPT-Realtime-2の活用シーン

GPT-Realtime-2の登場により、音声AIの活用の幅は大きく広がっています。ここからは、業界ごとにどのような使い方が考えられるかを整理してみましょう。

カスタマーサポート業界

GPT-Realtime-2の並列ツール呼び出しとリカバリー機能は、コールセンター業務の自動化と相性が抜群です。

顧客の問い合わせを受けながら、同時にCRMの検索や注文ステータスの確認を行い、すぐに回答を返すことが可能になります。割り込みや訂正にも柔軟に対応できるため、従来のIVR(自動音声応答)では実現できなかった自然な対話型サポートが実現します。

生成AIをカスタマーサポートで活用する方法について、詳しく知りたい方は以下の記事も参考にしてみてください。

不動産・旅行業界

Zillow社やPriceline社の事例が示すように、複雑な条件検索と予約操作の音声化が現実味を帯びてきました。「駅から徒歩10分以内で2LDK、ペット可の物件を探して」といった細かい条件指定を音声で行い、そのまま内覧予約まで完了できるような体験が構築可能です。

不動産業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

教育・メディア業界

GPT-Realtime-Translateとの組み合わせにより、リアルタイム多言語字幕付きのオンライン授業やウェビナーが実現可能です。教育機関や動画プラットフォームにとって、グローバル展開のハードルが大幅に下がるでしょう。

VimeoがGPT-Realtime-Translateのテストに参加している点からも、この領域への期待がうかがえます。

教育業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】GPT-Realtime-2が解決できること

GPT-Realtime-2は、従来の音声AIが抱えていたさまざまな課題を解消するポテンシャルを持っています。代表的な課題と、それに対するGPT-Realtime-2のアプローチを見ていきましょう。

長時間会話でのコンテキスト喪失を解消

従来のリアルタイム音声モデルでは、32Kトークンのコンテキスト制限があったため、長時間の通話で会話の前半部分を忘れてしまう問題がありました。

それに対して、GPT-Realtime-2は128Kトークンに拡張されたことで、30分以上の長い商談や技術サポートでも文脈を保持し続けることが期待できます。

ツール呼び出し中のストレス軽減

音声AIがバックエンドのAPIを呼び出している間、ユーザーに何のフィードバックもなく無音状態が続くのは1つのストレス要因としてありますよね。

GPT-Realtime-2のプリアンブル機能とツール透明性機能により、「ただいまカレンダーを確認しています」のようなつなぎの発話が自動的に挿入され、待ち時間のストレス軽減が期待できます。

多言語対応のコスト削減

グローバルサービスで複数言語に対応するには、言語ごとに別々のモデルやパイプラインを用意する必要がありました。

GPT-Realtime-2自体が会話途中の言語切り替えに対応しているほか、GPT-Realtime-Translateとの連携で70以上の言語からの入力を13言語に変換できるため、多言語対応の構築コストを大きく削減することが期待できます。

GPT-Realtime-2を使ってみた

ここからは、GPT-Realtime-2の性能を確認していきましょう。OpenAI Playgroundを使って、日本語での依頼と割り込み依頼を実際に試してみます。

プロンプトはこちら

ベジタリアンの友人2人を招いて夕食を作りたいんだけど、30分で作れるメニューを考えて

(割り込み)

やっぱり予算は3,000円以内でお願いします出力結果はこちら

よくある質問

最後に、GPT-Realtime-2に関して、多くの方が気になるであろう質問とその回答をご紹介します。

GPT-Realtime-2で音声AIの実用化を加速させよう!

GPT-Realtime-2は、GPT-5クラスの推論能力と128Kトークンの拡張コンテキスト、並列ツール呼び出しやプリアンブル機能など、音声AIをデモレベルからプロダクションレベルへ引き上げる数多くの技術的進歩を実現したモデルです。

Zillow、Priceline、Deutsche Telekomといった大手企業がすでに実運用を見据えたテストを行っている点からも、このモデルの完成度の高さがうかがえますね。カスタマーサポート、不動産、旅行、医療、教育と、業界を問わず幅広いユースケースが想定されており、音声インターフェースの可能性が一気に広がったといえるでしょう。

音声AIの導入や開発に関心がある方は、まずはPlaygroundで実際にモデルの応答を体感してみてください。

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。