Intent-based Prompt Calibration(IPC)とは?概要を初心者でもわかりやすく解説

- Intent-based Prompt Calibrationは、ユーザーの意図に基づいてプロンプトを自動で最適化する新しい手法。

- 曖昧な指示や少量データでも高精度な出力が可能で、分類や文章生成タスクなど幅広く活用できる。

- 導入には技術的な知識が必要だが、試行錯誤の手間を減らし、プロンプト設計の効率と品質を大幅に改善できる。

生成AIに指示を出すとき、言葉の選び方ひとつで結果が大きく変わることはありませんか?

想定の結果が得られるまで、何度も言い回しを変えてプロンプトを作るのってめんどくさいですよね…。

「Intent-based Prompt Calibration」は、ユーザーの意図に基づいてプロンプトを自動で最適化する技術です。IPCを利用することで、より精度が高くブレの少ないプロンプトを出力することが可能です。

本記事ではIntent-based Prompt Calibrationの概要から導入方法、実際の使い方や活用例まで解説しています。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

Intent-based Prompt Calibration(IPC)とは

Intent-based Prompt Calibration(IPC)とは、ユーザーの意図(intent)を理解し、それに応じてプロンプトの出力を最適化・調整する技術や手法のことを指します。

従来のプロンプト最適化手法(OPROやPEなど)では高品質な評価ベンチマークが必要でしたが、IPCでは代わりに合成データを自動生成し、その結果を用いてプロンプトを反復的に改善していきます。

主に生成AIや大規模言語モデル(LLM)において、より的確かつ望ましい応答を得るためのプロンプトアプローチとして利用することが可能です。

なお、プロンプトエンジニアリングについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

AutoPrompt(オートプロンプト)とは

AutoPromptとは、Elad Levi氏らが開発したオープンソースのプロンプト最適化フレームワークで、Intent-based Prompt Calibration(IPC)手法を実装しています。

このツールは、ユーザーの意図に基づいてプロンプトを自動的に洗練し、LLM(大規模言語モデル)の出力精度と一貫性を向上させることを目的としています。

AutoPromptの特徴としては下記が挙げられます。

- 意図ベースのプロンプト最適化

ユーザーが提供した初期プロンプトとタスク説明をもとに、難易度の高い境界ケースを合成し、プロンプトを反復的に改善します。 - 少量のデータで精度の高いプロンプトが生成できる

高品質なベンチマークデータがなくても、合成データとLLMを活用してプロンプトの精度を向上させることが可能です。 - 柔軟なモジュール設計と拡張性

AutoPromptはモジュール構造で作られており、LangChain、Wandb、Argillaといった有名なオープンソースツールと簡単に連携できます。また、データ生成やプロンプト移植(モデル間のプロンプト最適化)など、さまざまな用途に対応できます。

プロンプト最適化とは

プロンプト最適化(Prompt Optimization)」とは、大規模言語モデル(LLM)により良い出力をさせるために、与えるプロンプト(指示文)を工夫・改善するプロセスのことです。

例えば、ChatGPTに「文章を要約して」というプロンプトを入力するよりも「この技術記事を300文字以内で、初心者向けにわかりやすく要約してください」というプロンプトのほうが、より精度の高い答えを生成してくれる可能性が高くなります。

ChatGPTに質問をしても理想の答えが生成されず、何度も試行錯誤してプロンプトの言い回しや構成を変えて繰り返し質問したことはありませんか?それも手動によるプロンプト最適化とも言えるでしょう。

ただ、それだと効率が悪いので「Few-shot prompting」や「One-shot prompting」といったテクニックが用いられることが多いのが現状です。

プロンプトエンジニアリングとの違い

「プロンプトエンジニアリング」と「Intent-based Prompt Calibration(IPC)」は目的やアプローチが異なります。

■プロンプトエンジニアリング

- 望ましい出力を得るためにプロンプトを工夫すること

- 柔軟で細かな制御ができる

- 「こう言った方がいい出力が出る」「この順番にすると精度が上がる」といった経験が必要

■Intent-based Prompt Calibration

- ユーザーの意図に合わせて、LLMが自動でプロンプトを最適化

- 自動化されるため、人による試行錯誤が不要

- 実行にはコード環境やLLM API、ツールセットが必要

例えば小規模プロジェクトや柔軟に調整が必要な場合はプロンプトエンジニアリング、精度の高さが重要や自動化したいという場合にはIntent-based Prompt Calibrationが向いているでしょう。

どちらがいいのかは、プロジェクトの方針や規模によって異なりますのでそれぞれの特徴を理解した上で、目的に応じて使い分けましょう。

IPCの背景・課題

同じタスクをLLMで出力しても、プロンプトの言い回しひとつで出力が大きく変わることがあります。少しの言葉の違いで精度が下がるということは、プロンプトの内容や入力する人によって大きくブレるということです。

できるだけ精度の高い回答を得るためにプロンプト最適化が行われますが、「こう言えば良い出力が出るかも?」という手動での試行錯誤を行う必要がありました。

ただ、現実的に大量のプロンプトを最適化したくても、時間・人手・ノウハウが足りないという問題が多くのケースで存在します。

そこで、「プロンプトによる回答のブレ」や「手動調整による効率の悪さ」などの問題を解決するためにIntent-based Prompt Calibrationが登場しました。

ユーザーの意図(Intent)に基づき、間違いやすい例を合成し、それを基にプロンプトをLLM自身が繰り返し改善していくというIPCは上記の問題を解決するために非常に有効な手法として注目されています。

しかし、IPCを利用するにはLangChainやArgilla、LLMのAPIの知識などある程度のプログラミングスキルが必要になり、「とりあえず試してみたい」という初心者にはやや敷居が高くなってしまっています。

また、IPCは合成データに依存してしまうため利用するデータが実際のユーザータスクや現実のデータ分布とズレている場合、誤った方向に最適化されるリスクがあります。

今後の改善ポイントとして、マルチモーダル対応(画像+テキストなど)や、より軽量なメタプロンプト最適化も検討されているようです。※1

Intent-based Prompt Calibrationのライセンス・利用料金

Intent-based Prompt Calibrationを使うことができるAutoPromtはApache2.0で公開されており、無料で利用することができます。

| 利用用途 | 可否 |

|---|---|

| 商用利用 | ⭕️ |

| 改変 | ⭕️ |

| 配布 | ⭕️ |

| 特許使用 | ⭕️ |

| 私的使用 | ⭕️ |

ただし、OpenAI-APIやAnthropic APIを利用するための費用は必要になりますのでご注意ください。

Intent-based Prompt Calibration(AutoPrompt)の使い方・手順

ここでは前述したAutoPromptの使い方と手順を解説します。

AutoPromptのGitHubを参考にしていますが、それぞれの環境によってパッケージのバージョンを変更してください。

AutoPromptを動かすための環境

今回はローカルでAutoPromptを動かしました。その時の環境は下記のとおりです。

■ハードウェア

- CPUの種類: Intel Corei3 12100F 3.30GHz

- システムメモリ :16GB

- GPUの種類: GeForce GTX 1650

- GPUメモリ:4GB

- HDD/SSDの空き容量: 80GB以上

■ソフトウェア

- python 3.11.5

- argilla 1.29.0

- langchain-openai 0.3.14

- langchain-community 0.3.23

- numpy 1.26.4

AutoPromptのセットアップ

1.Gitからプロジェクトをダウンロードする

git clone https://github.com/Eladlev/AutoPrompt.git

cd AutoPrompt2.必要なパッケージをインストールする

pip install -r requirements.txt※requirements.txtに記述されているパッケージと各環境下のパッケージのバージョンの違いでうまく動かないことがあります。前述のAutoPromptを動かすための環境を参考に、各パッケージが動くバージョンに揃えてください。

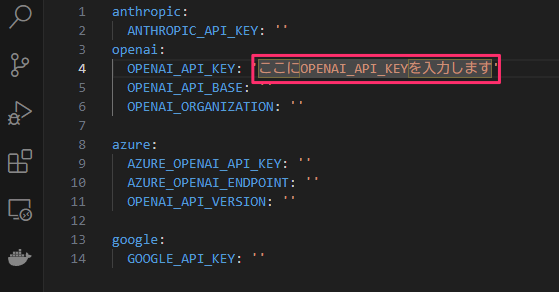

3.設定ファイルにAPI KEYを記述する

「config/llm_env.yml」に利用するAPI KEYを記述してください。

4.アノテーターを構成する

アノテーターはdockerやLLMを利用することができるようですが、今回は簡単にHugging Faceを利用します。

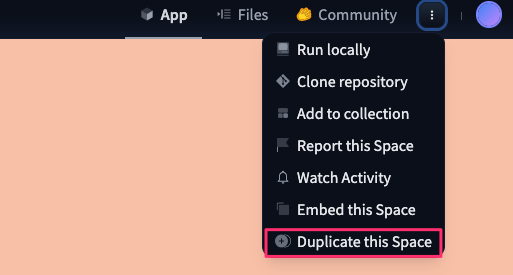

Hugging Faceにログイン後、用意されているスペースを開いて右上の三点リーダーを開き、「Duplicate this Space」をクリックします。

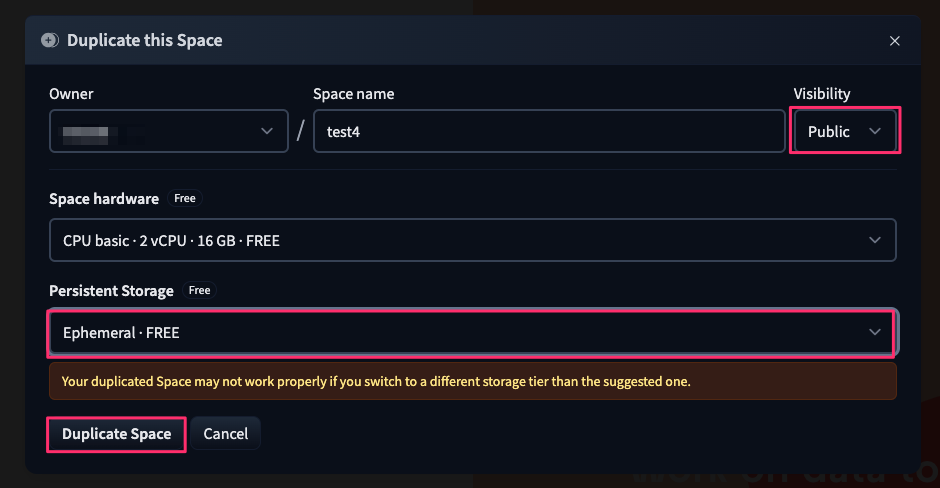

次に表示されたウィンドウで、VisibilityをPublicに、Persistent StorageをEphemeral Freeに変更し、Duplicate Spaceのボタンをクリックしてください。

しばらくすると、セットアップが完了します。

ログイン画面が表示されますのでUsernameに「admin」、Passwordに「12345678」を入力してSign Inをクリックしてください。ログインできればOKです。

左上のHugging Faceのロゴの右にオーナー名とスペース名が出ていると思うので控えておきましょう。

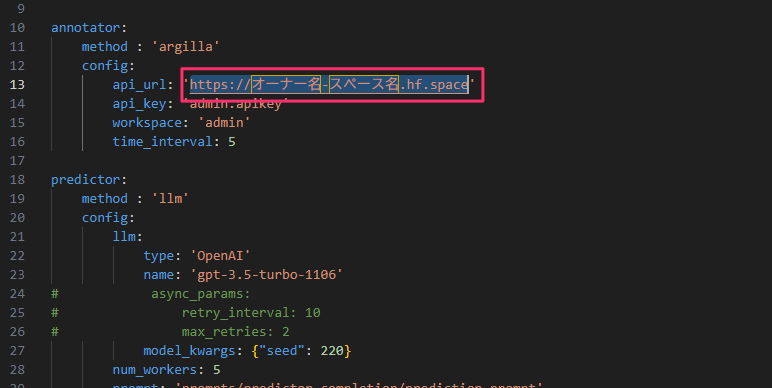

その後、「config/config_default.yml」のannotatorの箇所を変更します。

api_urlの箇所へ「https://オーナー名-スペース名.hf.space」を追記してください。

api_keyはadmin.apikey、workspaceはadminのままで大丈夫です。

編集し終えたら保存を忘れないようにしてください。

AutoPromptを使ってプロンプトを最適化する

では実際にAutoPromptを使ってプロンプトを最適化してみましょう。

下記のコードを実行します。

python run_pipeline.py --prompt "Does this movie review contain a spoiler? answer Yes or No" --task_description "Assistant is an expert classifier that will classify a movie review, and let the user know if it contains a spoiler for the reviewed movie or not." --num_steps 3■訳

映画のレビューにネタバレが含まれるかを調べるためのプロンプトになります。

ネタバレってどこからどこまでが含まれるのか非常に曖昧でAIに指示しようと思うと言語化しにくいですよね。

これを、AutoPromptにわかりやすく最適なプロンプトを生成してもらいましょう!

簡単な映画のレビューが表示されるので、それがネタバレかどうかをYes/Noで選んでいきましょう。曖昧な表現がネタバレなのかどうか、データセットを作っていく過程になります。

そして、こちらが今回AutoPromptが最適化した結果です。

Identify whether the movie review reveals key plot resolutions, significant twists, or undisclosed character identities that would materially impact the viewer's prior understanding of the movie's narrative as established by official promotional content. A review contains a spoiler if it discloses such information. If the review only discusses complex character relationships, introduces surprise elements without detailing critical outcomes, or reveals unexpected narrative developments that do not substantially alter the understanding of the plot, it should not be classified as containing a spoiler. Answer 'Yes' if the review contains a spoiler, and 'No' if it does not.日本語訳:

どんなパターンがネタバレなのか、具体的に言語化されていますね!

今回は「–num_steps 3」と指定したので3回しか表示されませんが、ここの回数を増やせば増やすほど、データが溜まるのでより精度の高いプロンプトが生成されるので、ぜひじっくり試してみてください。

ICPの活用例・ユースケース

Intent-based Prompt Calibrationは下記のような活用例が考えられます。

SNSやレビューサイトでの「不適切表現・成人表現・ネタバレ」などの自動検出

ユーザーが投稿した“曖昧な基準”(例:暗示的な表現もNG)に合わせて、微妙な表現や境界的なケースを合成・学習することにより、誤検出や見落としを大幅に減らすことができる。

文章生成タスクのトーン最適化

「情熱的かつ信頼できるレビューを書いてほしい」「皮肉っぽいけど前向きな感想にして」といった曖昧な指示を合成されたレビュー例から学習し、精密にプロンプト最適化することで、 ユーザーの感覚に近い出力が望めます。

分類タスク

たとえば、「やや不満/普通/やや満足」といった曖昧なカテゴリ分けでレビューを分類したり、問い合わせをカテゴリ分けをしたい場合、合成された「誤分類しやすい例」を用いた調整により、少量のデータでも意図に沿った境界判断が可能です。

IPCは、ユーザーの意図を忠実に再現するプロンプトをLLM自身が自動で最適化する仕組みです。そのため、「曖昧なプロンプトで結果が安定しない」「少量のデータしかないが高精度が求められる」といった状況で特に力を発揮します。

まとめ

Intent-based Prompt Calibration(IPC)は、曖昧なプロンプトや少量データでも高精度な出力を引き出す新しい自動最適化手法です。

手動のプロンプトエンジニアリングとは異なり、ユーザーの意図に沿った境界ケースを合成しながらLLM自身がプロンプトを改善していきます。

特に生成AIや分類タスク、モデレーションなど精度が求められる現場で効果を発揮しますが、導入には一定の技術的スキルも必要です。用途や環境に応じて活用を検討しましょう。

最後に

いかがだったでしょうか?

プロンプトの試行錯誤にかけていた時間を、もっと価値ある業務に使いませんか?IPC導入で精度と効率を一気に向上させましょう。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。