【GPT-5.1-Codex-Max】新手法「コンパクション」によって進化したコーディングモデルを徹底解説!

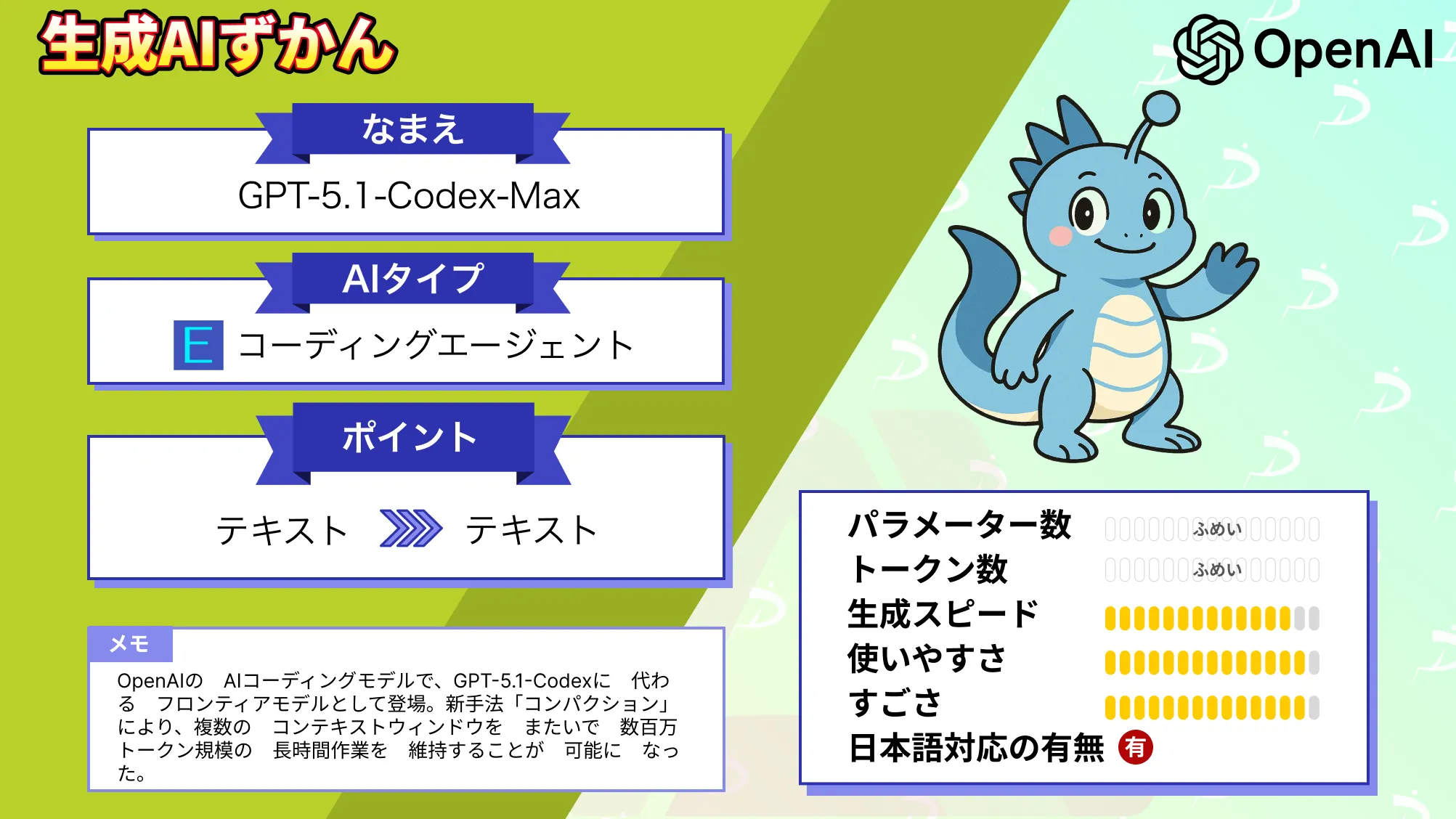

- OpenAIの新しいAIコーディングモデルで、GPT-5.1-Codexに代わるフロンティアモデルとして登場

- 新手法「コンパクション」により、複数のコンテキストウィンドウをまたいで数百万トークン規模の長時間作業を維持することが可能に

- 同じ推論設定でも、従来モデル「GPT-5.1-Codex」と比べ、約30%少ないトークンで同等以上の精度を実現

2025年11月20日、OpenAI社は新しいAIコーディングモデル「GPT-5.1-Codex-Max」を発表しました!

これは従来のGPT-5.1-Codexを置き換えるフロンティアモデルで、高速かつ高い知性を持つエージェンティック(自律的)なコーディングモデルとなっています。

新技術「コンパクション(Compaction)」の導入で、数百万トークンに及ぶ長大な文脈情報を保持しつつ処理できるため、プロジェクト全体を見渡すような、大規模なリファクタリングや長時間にわたるデバッグなど、従来のモデルでは困難だった作業に対応できるようになりました。

このGPT-5.1-Codex-Maxは、すでにCodex環境(CLIやIDE拡張、クラウド、コードレビューなど)で利用可能となっており、今後API経由の提供も予定されているようです。

本記事では、GPT-5.1-Codex-Maxの概要や性能、使い方をご紹介していきます。

ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

GPT-5.1-Codex-Maxの概要

GPT-5.1-Codex-Maxは、OpenAIの最新基盤推論モデルをベースにしたエージェント型コーディングAIです。

ソフトウェアエンジニアリングや数学、研究といった複雑で連続性のあるタスクを念頭にトレーニングされており、開発サイクルのあらゆる段階でコード生成や検証をサポートしてくれます。

従来モデルと比べると、高速かつ知的で、トークン効率も大幅に改善されています。

最大の特徴は「コンパクション」と呼ばれる新手法で、これにより複数のコンテキストウィンドウをまたいで数百万トークン規模の長時間作業を維持できます。

具体的には、文脈ウィンドウの上限に近づくと、重要な情報を圧縮・保持して新たなウィンドウに繰り越すため、大規模リファクタリングや深いデバッグ、数時間にわたるエージェントループなどを中断することなく完遂してくれるんです。

OpenAI社の検証では、コンパクションによって、長時間(24時間以上)にわたる自律的作業を継続し、複雑なタスクを完了するケースが確認されているようです。

2025年11月20日現在の提供状況としては、CodexのCLIや各種IDE拡張、クラウド環境、コードレビュー機能などで利用可能で、ChatGPTのPlus・Pro・Enterpriseプラン等にも含まれています。

API経由での利用も近日中に開始される予定とのことです。

GPT-5.1-Codex-Maxの性能

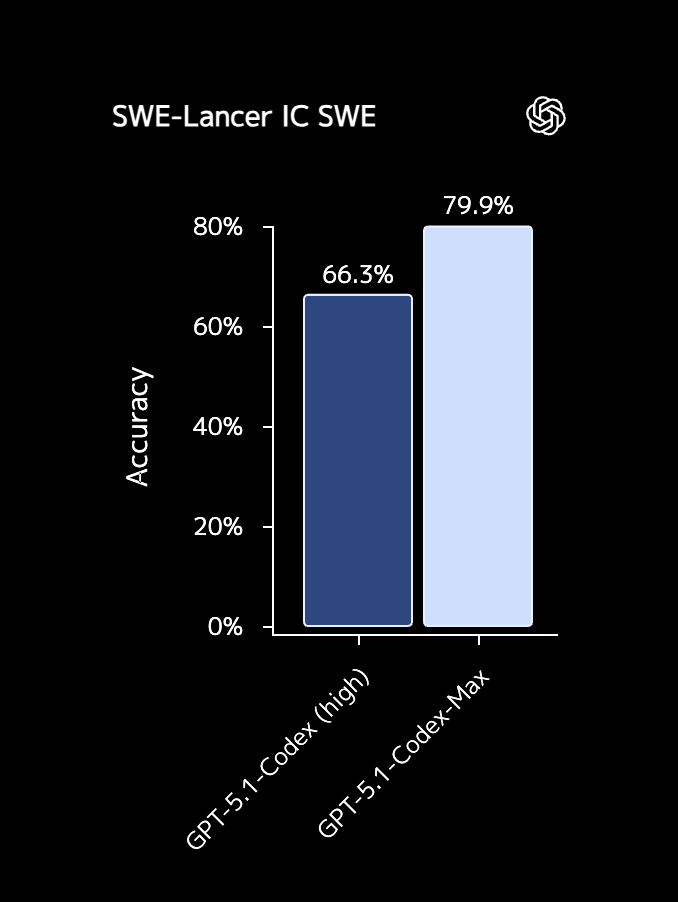

GPT-5.1-Codex-Maxは、主要なコーディングベンチマークで従来モデルを大きく上回る性能を発揮しています。

例えば、「SWE-Lancer IC SWE」(実業務タスク模擬)では、79.9%の正答率を達成し、従来のGPT-5.1-Codexの66.3%から大幅に向上しています。

同様に、コード理解・修正能力を測る「SWE-Bench Verified」(n=500)では、最高設定で77.9%を記録し、GPT-5.1-Codex(73.7%)や競合モデル(Gemini 3 Proの76.2%)を上回る結果を残しています。

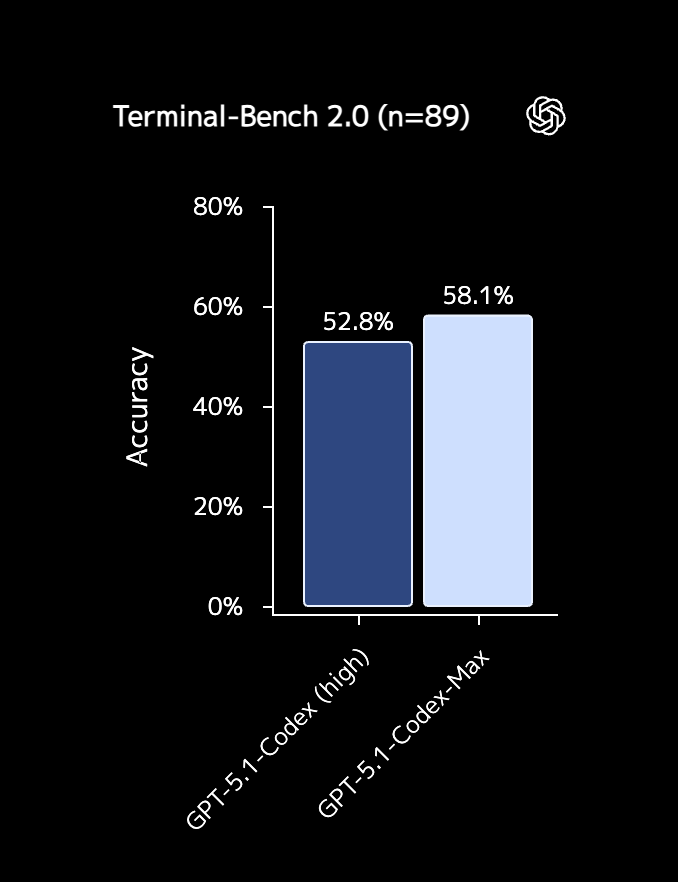

さらに、端末操作能力を評価する「Terminal-Bench 2.0」では58.1%を記録し、こちらも、GPT-5.1-Codexの52.8%やGemini 3 Proの54.2%より高い結果となっています。

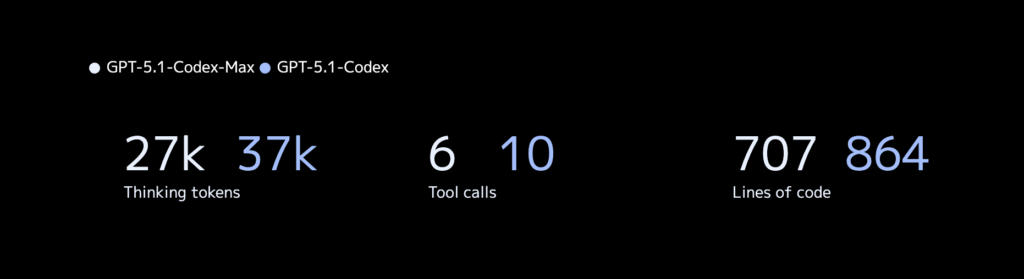

トークン効率も大幅に改善されていて、同じ中程度(medium)推論設定でも、GPT-5.1-Codexに比べて約30%少ないトークンで同等以上の精度を実現しました。

このトークン削減は、開発コストの低減につながり、コード生成でもGPT-5.1-Codex-Maxは同等の機能をより低コストで実行できるとされています。

また、24時間以上続くような長時間タスクへの対応力も強化されており、内部テストでは、一貫した作業を約24時間継続し、テストの失敗を修正して最終的に正しい結果を出すことが確認されています。

なお、GPT-5-Codexについて詳しく知りたい方は、以下の記事も参考にしてみてください。

GPT-5.1-Codex-Maxのライセンス

GPT-5.1-Codex-Maxは、非公開の商用AIモデルで、OpenAIのAPIおよびCodexサービスを介して利用する形態となっています。

商用利用はOpenAIとの契約に基づき可能ですが、モデル自体を取得・改変・再配布することは利用規約で禁止されています

| 利用用途 | 可否 | 備考 |

|---|---|---|

| 商用利用 | ⭕️ | API / ChatGPTプラン経由で利用 |

| 改変 | ❌️ | |

| 配布 | ❌️ | |

| 特許使用 | ⭕️ | |

| 私的使用 | ⭕️ | OpenAIプラン内で利用 |

GPT-5.1-Codex-Maxの料金

GPT-5.1-Codex-Maxを利用するには、主にChatGPTの有料プラン(Plus, Pro, Enterpriseなど)に加入するか、OpenAI APIを直接利用する方法の2つに大別されます。

ChatGPTの各プラン、API利用時の料金例は以下の通りです。

| プラン | 料金(税込) | 利用制限 |

|---|---|---|

| 無料 | – | Codex非対応 |

| Plus | $20/月(約¥2,700) | |

| Pro | $200/月(約¥30,000) | |

| Team | $30/ユーザー(月額、月払いの場合)※年契約なら$25/ユーザー/月 | |

| Enterprise | 要問い合わせ (カスタム契約) | |

| API利用(入力トークン) | $1.25 / 100万トークン | |

| API利用(出力トークン) | $10.00 / 100万トークン |

GPT-5.1-Codex-Maxの使い方

GPT-5.1-Codex-Maxは「Codex」という開発者向けプロダクトの中で提供されており、ふだんの開発フローにかなり自然に組み込んで使えるようになっています。

大きく分けると、ターミナルから使う「Codex CLI」と、VS CodeやCursorなどのIDEに統合する「Codex IDE拡張」の2パターンがあり、どちらもChatGPT Plus / Pro / Business / Edu / Enterpriseのいずれかのプランに入っていれば追加契約なしで利用することができます。

Codex CLI

まずは、Codex CLIをインストールします。公式ドキュメントでは、npmでのインストールが案内されています。

npm i -g @openai/codex上記コマンドで、グローバルコマンドとしてcodexが使えるようになります。

インストール後、ターミナルで codex とだけ入力して実行します。

初回起動時だけChatGPTアカウントによるサインイン(もしくはAPIキー入力)が求められると思いますので、ブラウザでログインを完了させればCLIとアカウントが紐づきます。

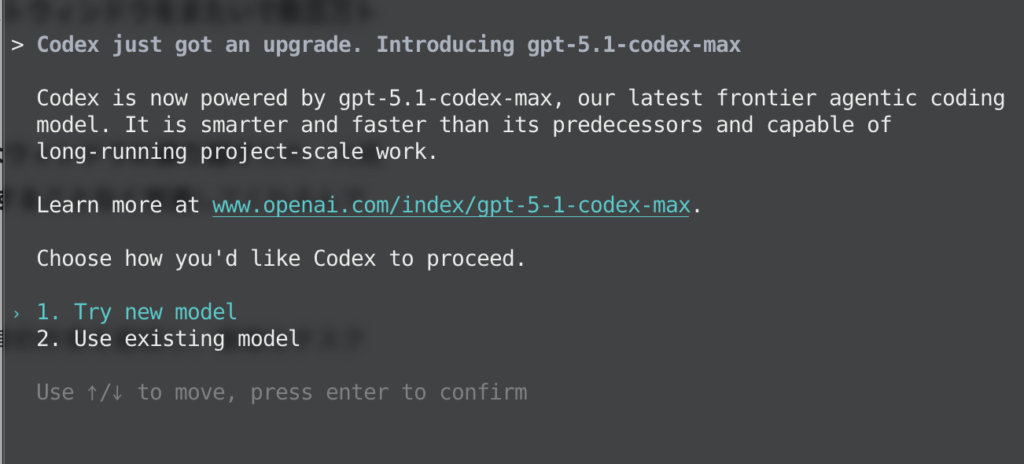

起動後、ベースモデルがGPT-5.1-Codex-Maxに切り替えられます。

Codexのモデル一覧ページでは、gpt-5.1-codex-maxが「長時間のエージェント的なコーディングタスク向けの推奨モデル」として示されており、CLIからは codex -m gpt-5.1-codex-max という形で明示的に指定できることが記載されています。

すでにセッションが立ち上がっている場合は、画面内のプロンプトで/modelコマンドを呼び出し、一覧からGPT-5.1-Codex-Maxを選ぶことで同じ設定にできます。

CLIには/initでAGENTS.mdを自動生成したり、/statusで現在の設定を確認したり、/reviewで変更内容をまとめてレビューしてもらうためのコマンドも用意されています。

IDE拡張

Codex IDE拡張は、VS Code、その派生であるInsiders版やCursor、Windsurfといったエディタで動作することが明記されており、Visual Studio Code MarketplaceからCodex拡張を取得するか、各IDE向けのダウンロードリンクからインストールできると説明されています。

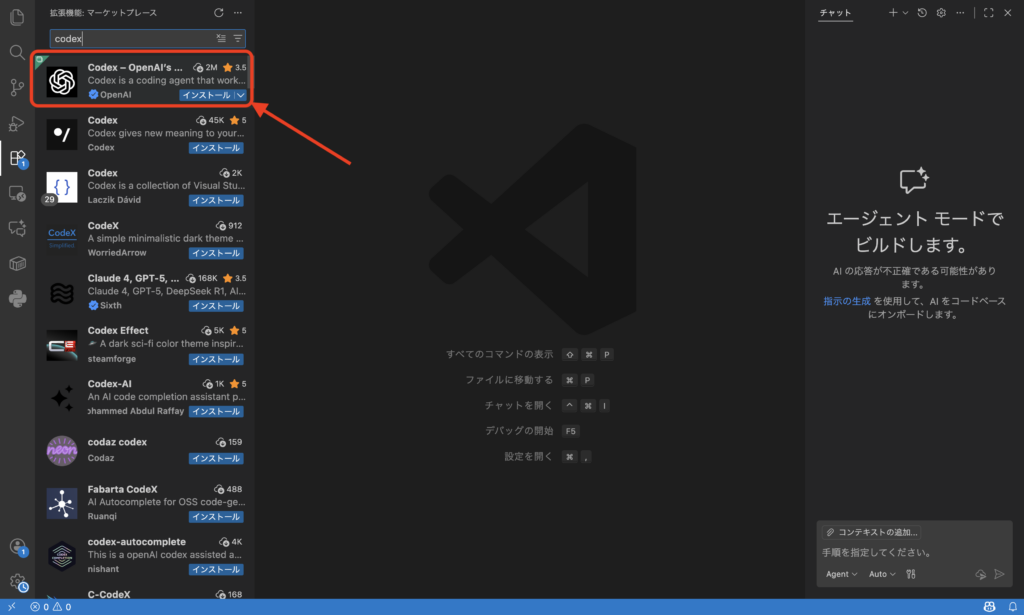

今回はVS Codeを例に確認してみましょう。拡張機能でCodexを検索し、インストールします。

インストールしてCodex IDE拡張を開くと、以下の画像のような表示が出るので、「Try new model now」をクリックします。

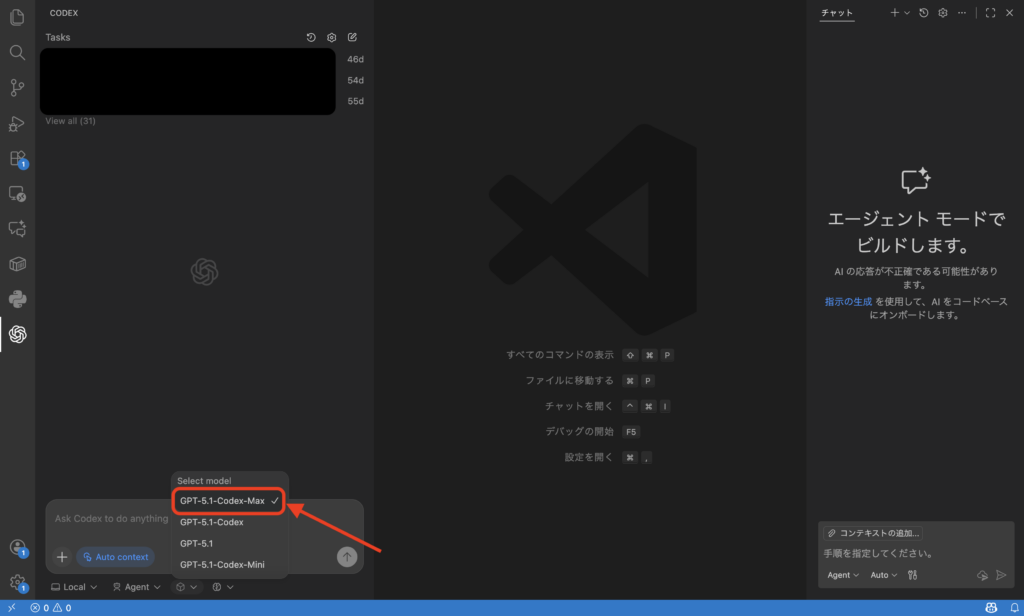

するとチャット画面が表示され、GPT-5.1-Codex-Maxモデル選択ができていることが確認できます。

以上、Codex CLIとIDE拡張の2通りの使い方のご紹介でした。

GPT-5.1-Codex-Max vs Gemini 3.0 Proで比較検証してみた

ここからは実際にGPT-5.1-Codex-MaxをCodex CLIで使っていきます!

シンプルなコーディングタスクでコーディング性能を確認していきましょう。また、Gemini 3.0 Proでも同一プロンプトを投げて、実行結果の比較もしていきます。

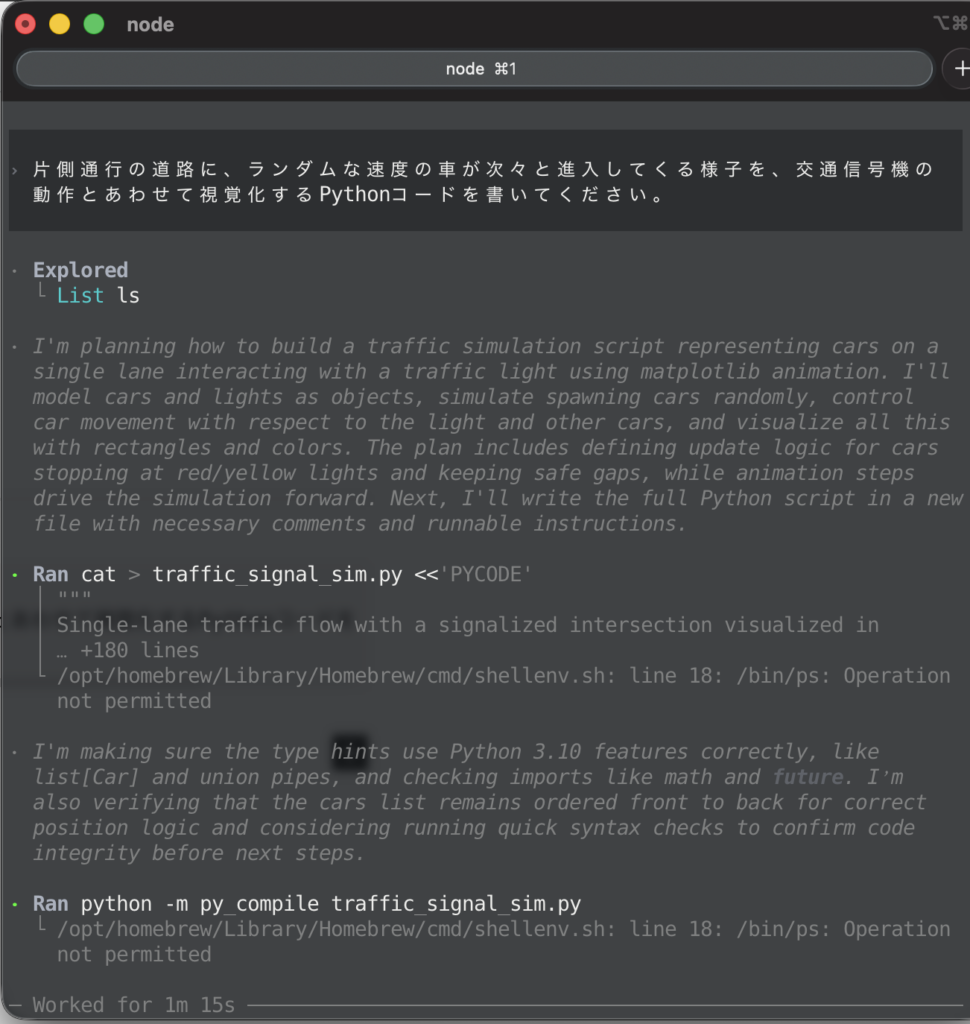

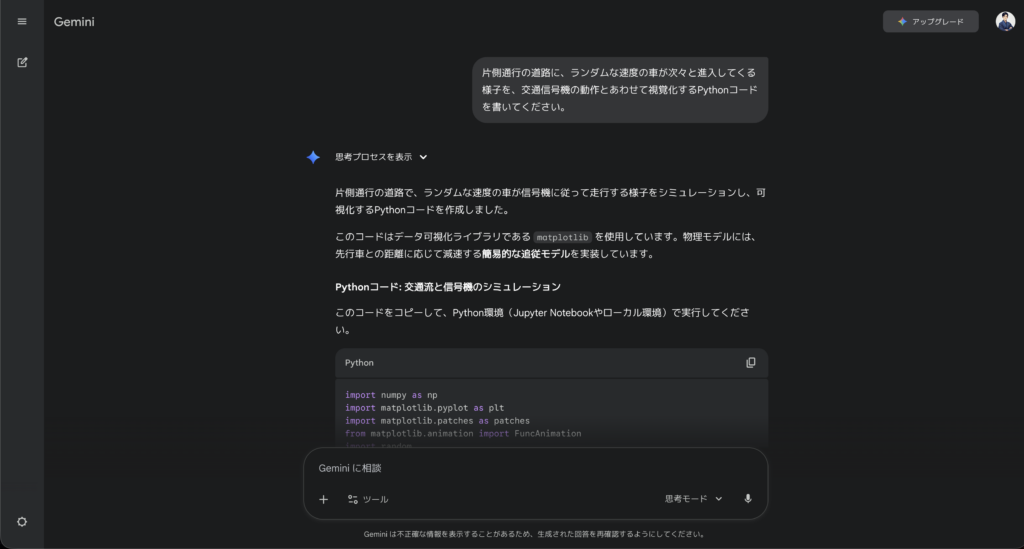

片側通行の道路に、ランダムな速度の車が次々と進入してくる様子を、交通信号機の動作とあわせて視覚化するPythonコードを書いてください。

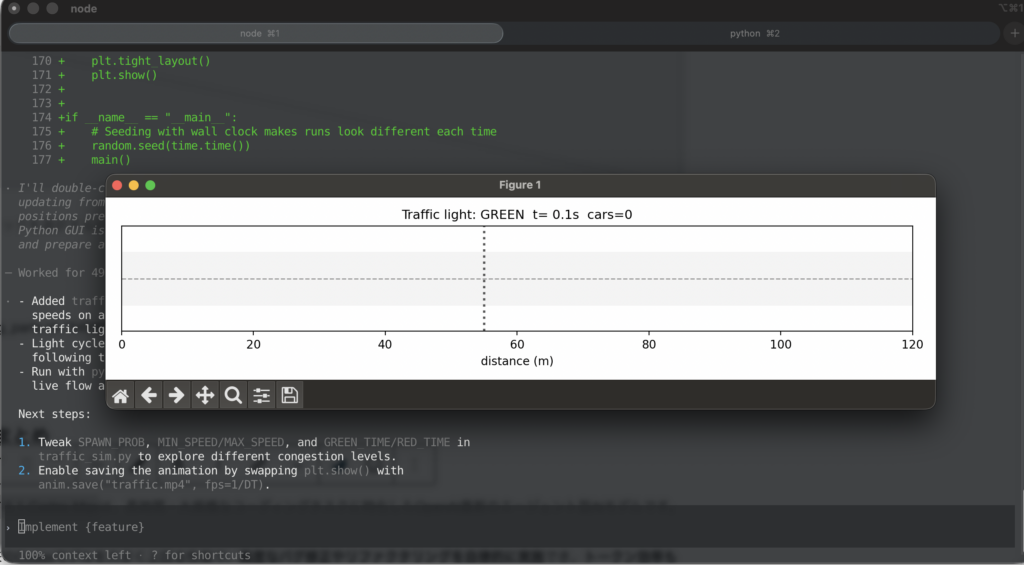

ワンショットコードの実行結果は以下の通り。ちなみに推論設定はHighで実行しています。

骨組みはできていますが、動きはないし、色味も無機質です。1度だけ修正依頼をかけた結果は以下の通りです。

良い感じです!修正依頼をかければ、こちらの意図通りに、ランダムな速度の車が次々と進入してくる様子を、交通信号機の動作とあわせて視覚化してくれています。

Gemini 3.0 Proの実行結果も確認します。

Gemini 3.0 ProはワンショットでこのクオリティのPythonコードを書いてくれました。

UIの差は好みだと思いますが、Gemini 3.0 Proのほうが、車の速度や色味がほどよくランダムになっている点、車それぞれにスピードメーターが実装されている点で優秀かなと、個人的に感じました!

ただし、実行するたびに出力結果は変わってきますし、タスク内容(特に長時間・大規模なコーディングタスク)によっても精度に差が出てくるかと思いますので、是非みなさんもご自身のタスクで試してみてください。

まとめ

GPT-5.1-Codex-Maxは、長時間・大規模なコーディングタスクに特化したOpenAI最新のエージェント型AIモデルです。

従来のCodexモデルを大きく上回る性能で、高度なバグ修正やリファクタリングを自律的に実施でき、トークン効率も向上しています。

Codex CLIやIDE拡張、クラウド環境などで利用でき、ChatGPTの有料プランまたはAPI契約を通じて手軽に利用可能です。

特に、コンパクション機能により継続作業が強化されており、開発現場での高度なコーディング作業を大幅に効率化してくれる頼もしい相棒になってくれそうです。

今後もAPI提供や機能強化が期待されており、情報アップデートから目が離せません!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。