パラメーター数– tax –

-

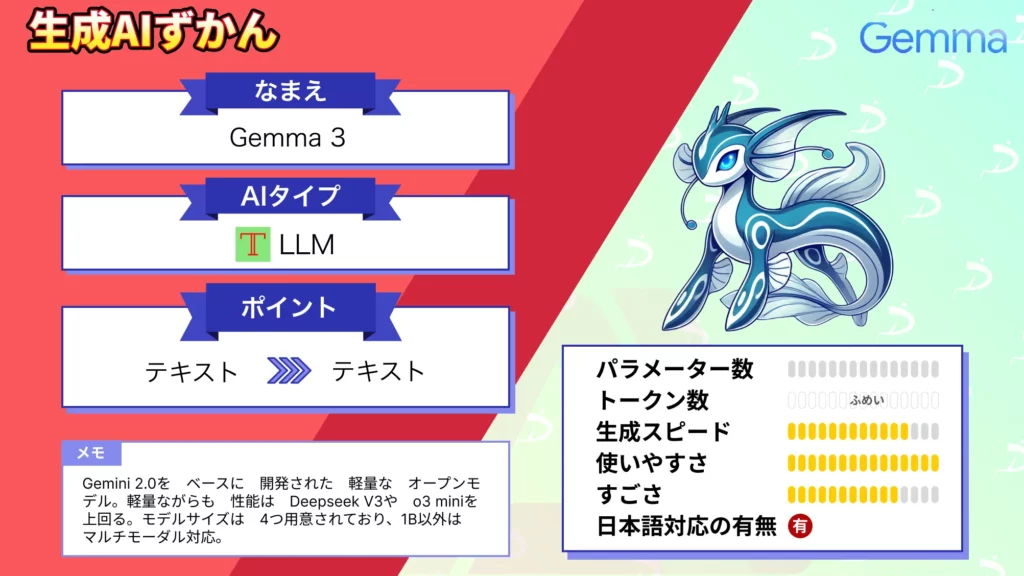

【Gemma 3】軽量&マルチモーダル処理が可能な高性能!GoogleのオープンAIモデル解説

-

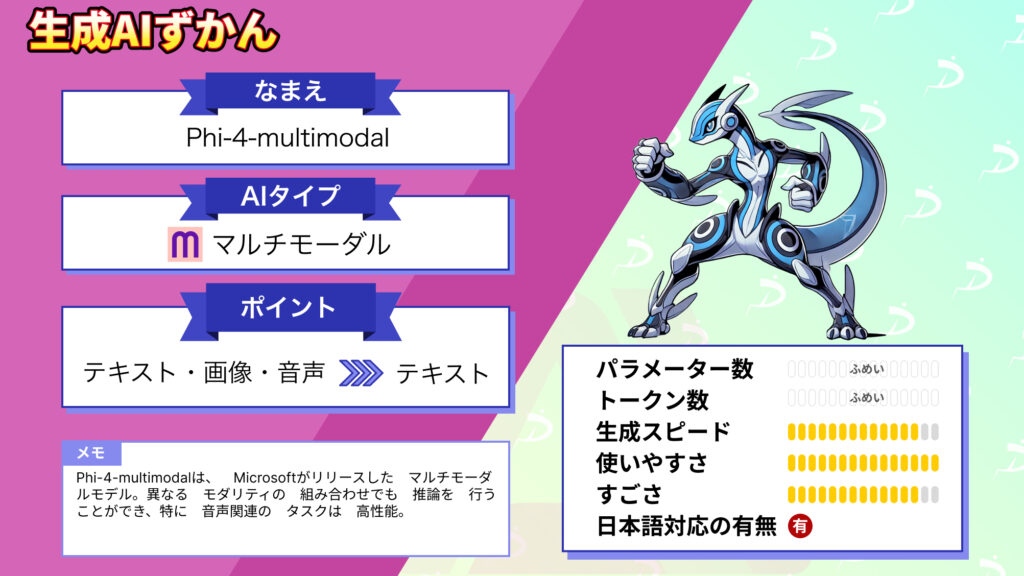

【Phi-4-multimodal】マイクロソフトのマルチモーダルモデル!概要から料金、実力まで徹底検証

-

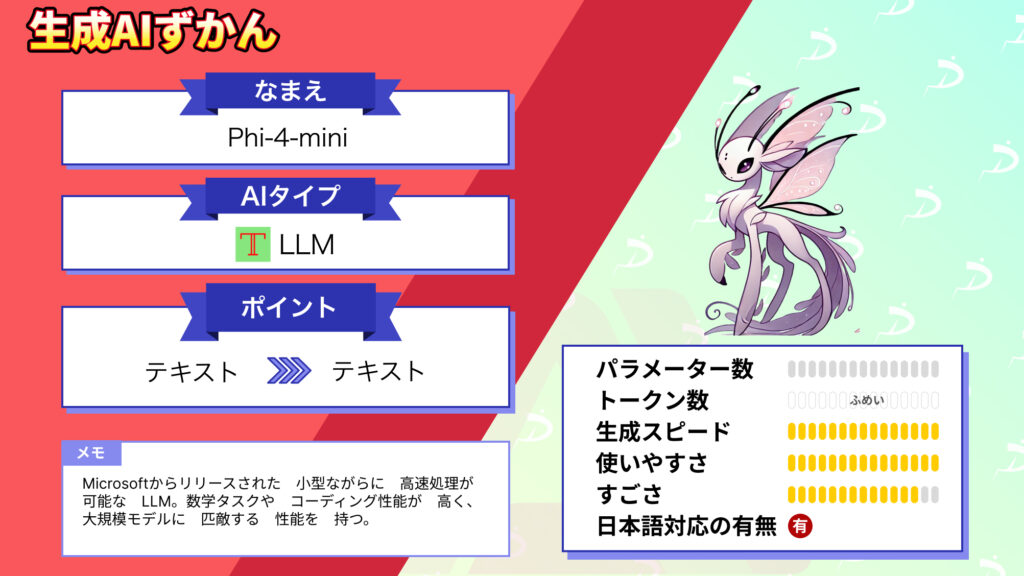

Phi-4-miniは何がすごい?Microsoftの軽量モデル試してみた!概要・使い方・料金まで解説

-

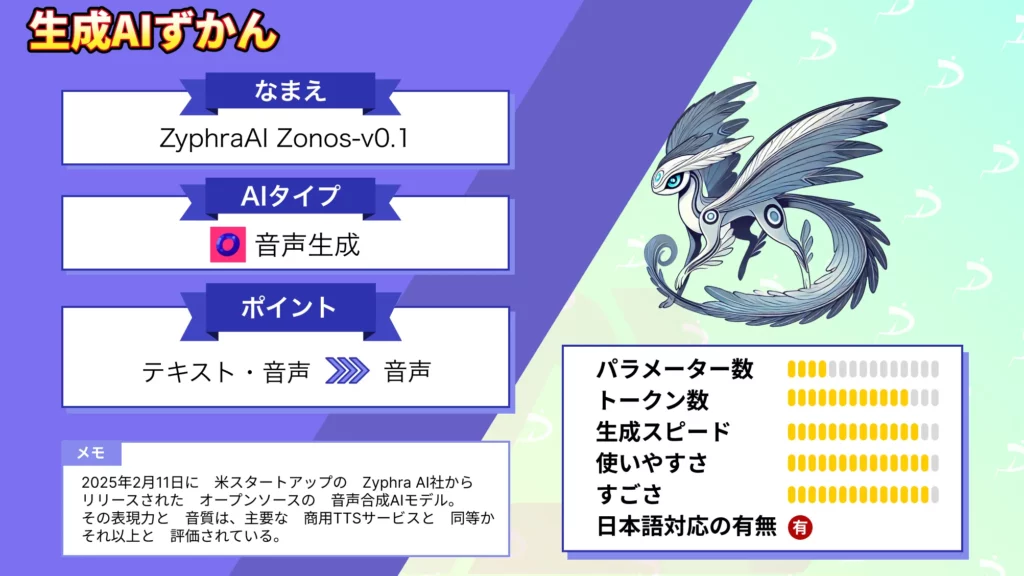

【ZyphraAI Zonos-v0.1】テキストや人間の声から音声をクローン!?概要や使い方、活用事例を徹底解説!

-

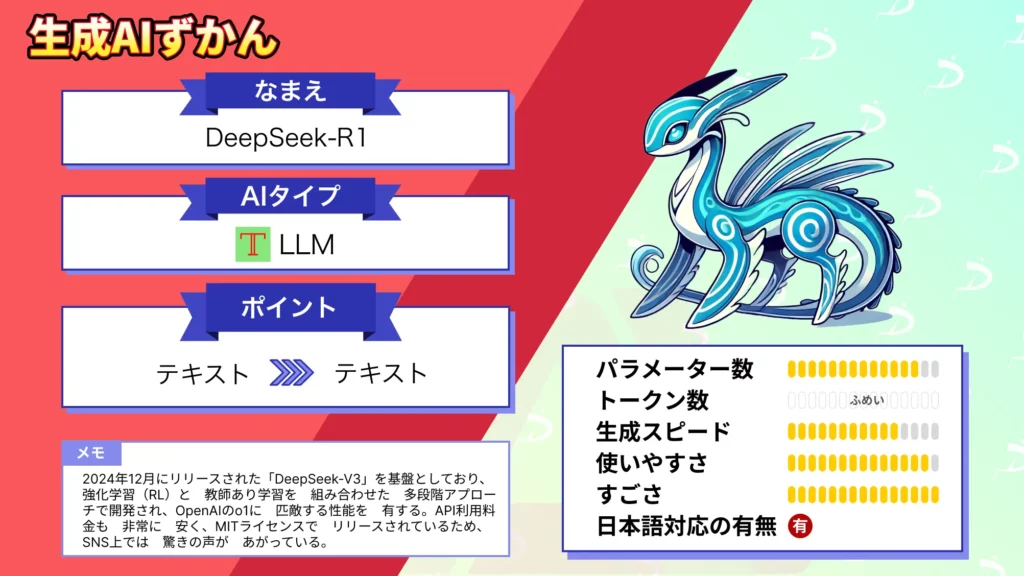

【DeepSeek-R1】GPT-o1に匹敵する最新AIモデル!日本語対応モデルや使い方などを徹底解説

-

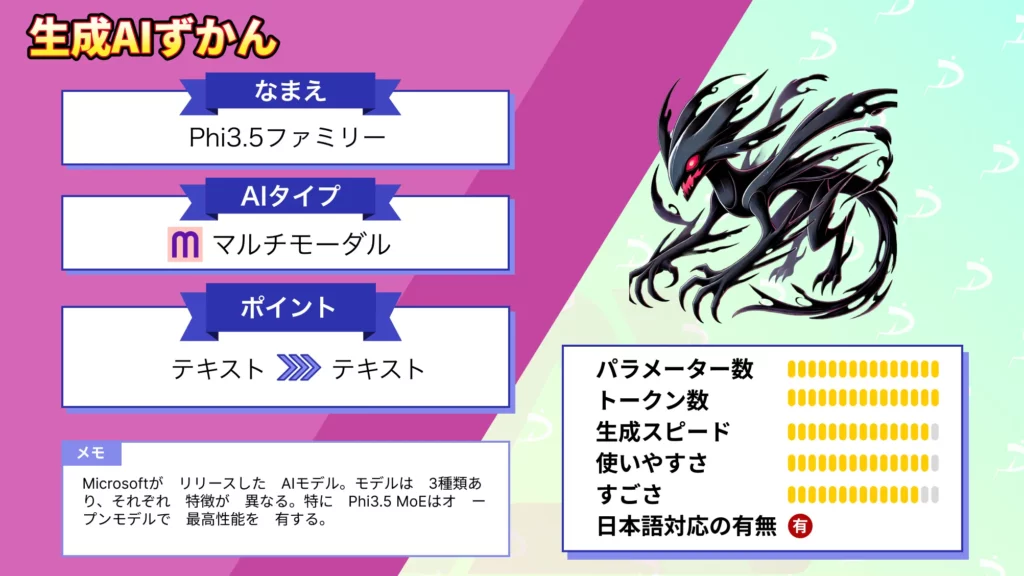

【Phi 3.5】スマホで動くMicrosoftの最新LLMの性能をGPT-4oと徹底比較してみた

-

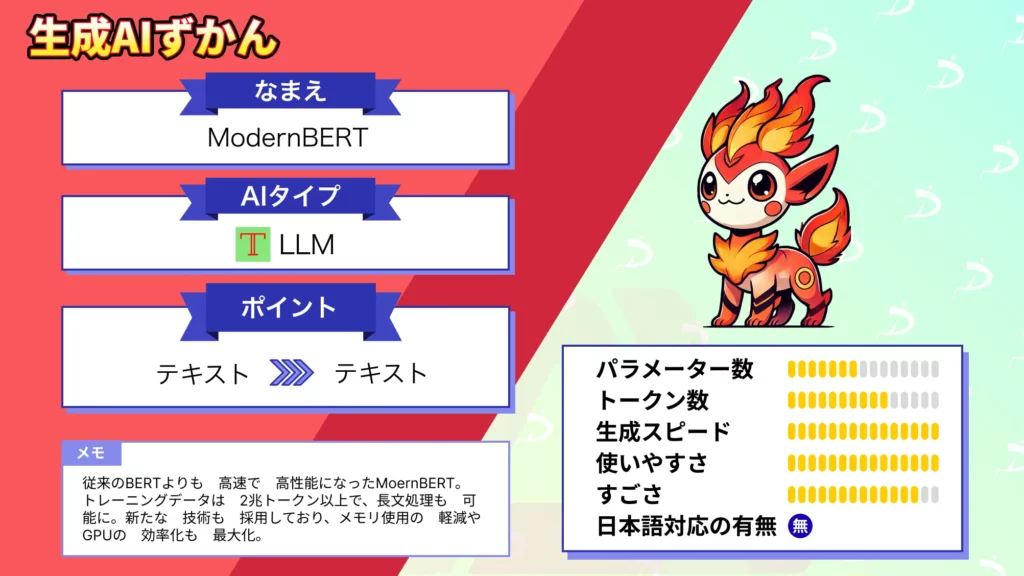

検索・分類を強化する「ModernBERT」長文対応可能なAIモデル徹底解説

-

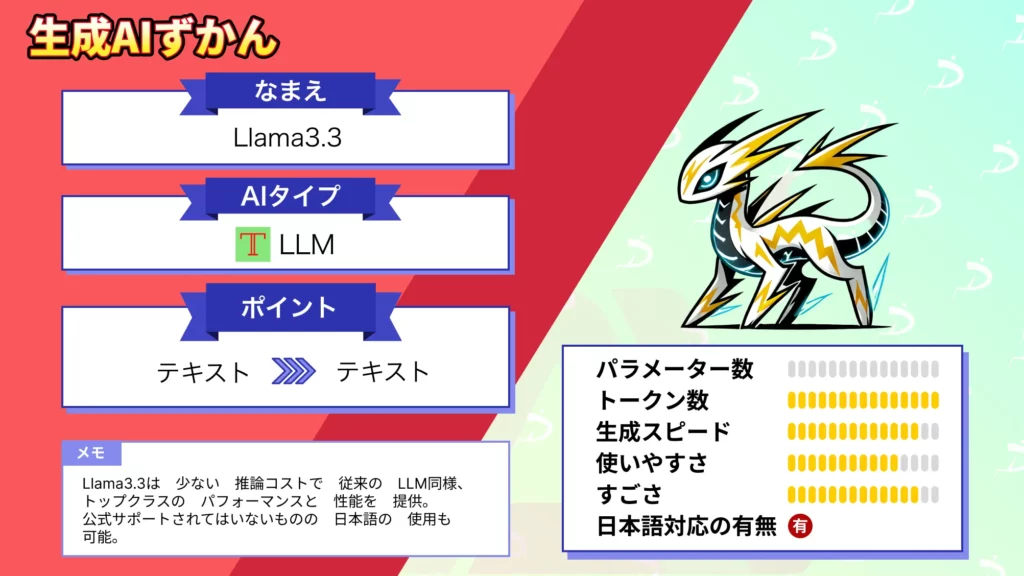

【Llama 3.3】コスパ最強のMeta最新LLM!3.1と比較すると意外な結果に

-

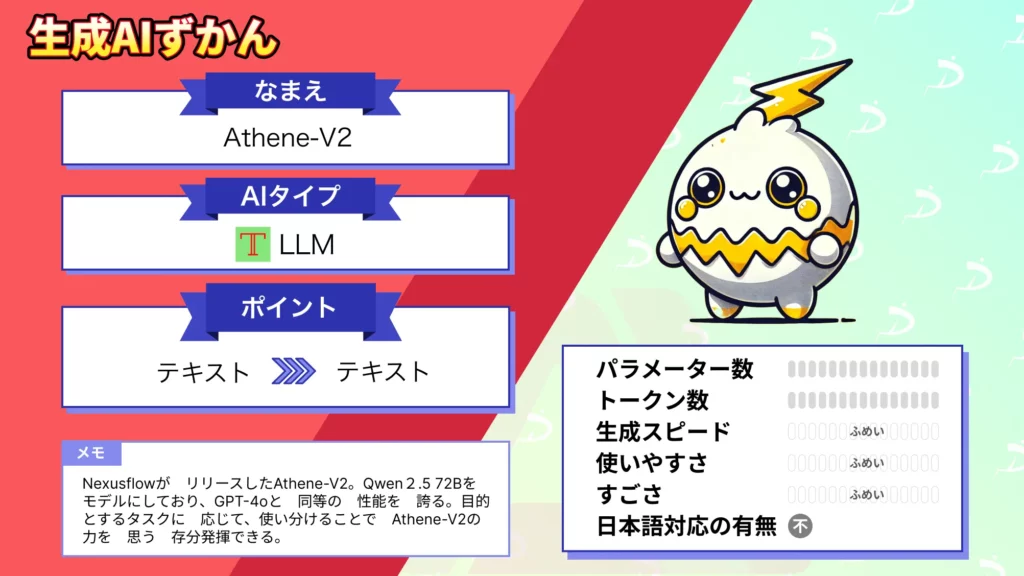

【Athene-V2】GPT-4oやLlama 3.1 405Bと競合する驚異の72B言語モデル