Qwen3.6-27Bとは?27Bパラメータで前世代397Bを超えたオープンソースモデルの特徴・使い方を徹底解説

- Qwen3.6-27Bは27B Dense構成で前世代MoEを上回るコーディング性能

- テキスト・画像・動画に対応し、Thinking/Non-thinkingの切り替えが可能

- API提供状況やコンテキスト長など、公開前に公式情報の再確認が必要

2026年4月、Alibaba GroupのQwenチームから新たなオープンソースAIモデルが公開されました。

今回登場した「Qwen3.6-27B」は、わずか27BパラメータのDenseアーキテクチャながら、397Bパラメータという15倍以上の規模を持つ前世代フラッグシップを全主要コーディングベンチマークで超えるという驚異的な性能を実現したモデルです。

これまでのオープンソースLLMでは、「高い性能を出すには数百Bパラメータが必要」「MoEアーキテクチャはデプロイが複雑でインフラ負荷が高い」「マルチモーダルとフラッグシップ水準のコーディングを1つのモデルで両立するのは難しい」といった課題がありました。

一方でQwen3.6-27Bは、MoEルーティングの複雑さを排した純粋なDenseアーキテクチャを採用しながら、前世代MoEモデルを凌駕するコーディング性能を達成。ThinkingモードとNon-thinkingモードを1つのチェックポイントで切り替えられるため、推論コストと性能のバランスを柔軟に制御できます。

しかし、新しいオープンソースモデルが登場するたびに、「従来のQwenシリーズとどう違うのか」「エージェント開発に実際に組み込めるのか」「ローカル環境での動作には何が必要なのか」といった疑問を感じる方も多いのではないでしょうか。

そこで本記事では、Qwen3.6-27Bの概要や仕組み、主な特徴を整理しながら、具体的な使い方や活用方法について詳しく解説します。

最後までお読みいただくことで、Qwen3.6-27Bがどのようなに設計され、どのような開発シーンで力を発揮するのかが理解できるはずです。

\生成AIを活用して業務プロセスを自動化/

Qwen3.6-27Bとは

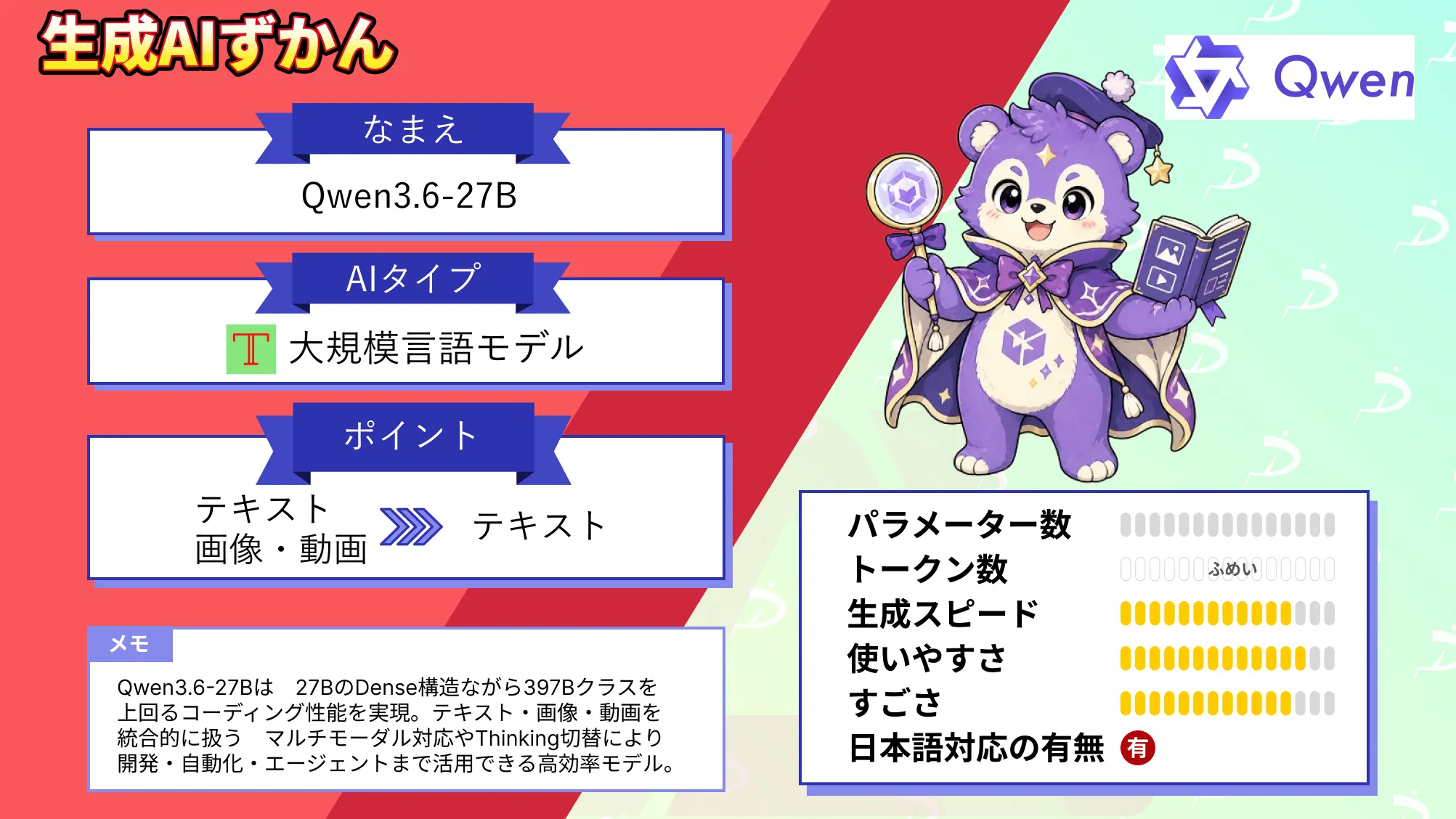

Qwen3.6-27Bは、Alibaba GroupのQwenチームが2026年4月に公開した、27BパラメータのオープンソースマルチモーダルDenseモデルです。

最大の特徴は、前世代のフラッグシップモデルであるQwen3.5-397B-A17B(総パラメータ397B・アクティブ17B MoE)を全主要コーディングベンチマークで上回った点です。

同時期にリリースされたクローズドモデルQwen3.6ファミリーのオープンウェイトモデルに相当。

Qwen3.6-27BはDenseアーキテクチャを採用しており、Mixture-of-Experts(MoE)モデルで必要となるルーティング機構の複雑さがありません。デプロイの容易さとフラッグシップ水準のコーディング性能を両立しています。

テキストだけでなく画像・動画の入力に対応したネイティブマルチモーダルモデルでもあります。ThinkingモードとNon-thinkingモードの両方を1つのチェックポイントで切り替えることも可能です。

| 比較項目 | Qwen3.6-27B | Qwen3.5-397B-A17B |

|---|---|---|

| アーキテクチャ | Dense(27B) | MoE(総計397B / アクティブ17B) |

| SWE-bench Verified | 77.2 | 76.2 |

| Terminal-Bench 2.0 | 59.3 | 52.5 |

| SkillsBench | 48.2 | 30.0 |

| マルチモーダル対応 | テキスト・画像・動画 | テキスト・画像・動画 |

| Thinkingモード | あり | あり |

| ライセンス | Apache-2.0 | Apache-2.0 |

| オープンウェイト公開 | Hugging Face / ModelScope | Hugging Face / ModelScope |

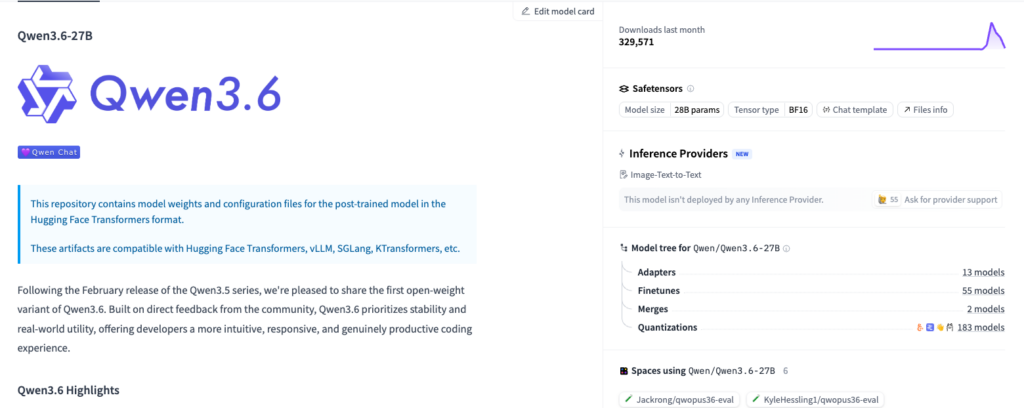

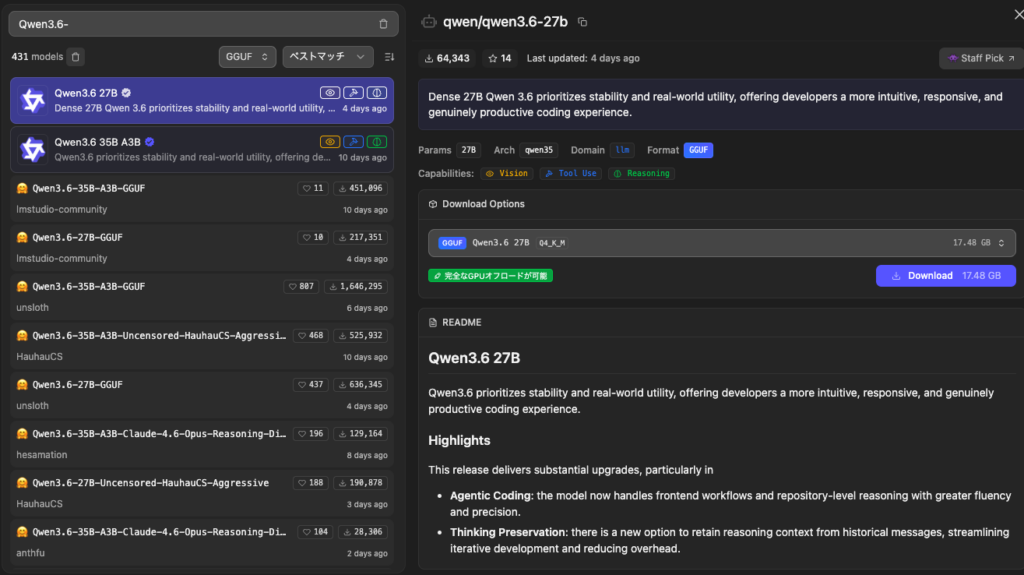

現在はQwen Studioで利用ができます。また、Hugging FaceおよびModelScopeからウェイトを無料でダウンロードでき、Alibaba Cloud Model Studio APIからの利用も準備中。

Qwen3.6-27Bの仕組み

Qwen3.6-27Bは、Denseアーキテクチャをベースに、マルチモーダル入力と思考プロセスの制御機構を統合したモデルです。ここではQwen3.6-27Bの仕組みについて解説をしていきます。

Denseアーキテクチャによるシンプルなインターフェース

MoEモデルは推論時に特定の専門家(Expert)サブネットワークだけを活性化するため、パラメータ効率は高い一方、ルーティング機構の実装やメモリ管理が複雑です。

Qwen3.6-27Bは全27Bパラメータが常に活性化されるDense構造を採用。推論時の計算グラフがシンプルなため、vLLMやSGLang・llama.cppなど主要な推論フレームワークとの互換性が高く、セルフホストが容易です。

ThinkingモードとNon-thinkingモードの切り替え

Qwen3.6-27Bは1つのモデルチェックポイントで「Thinkingモード」と「Non-thinkingモード」を切り替えられる設計です。

Thinkingモードでは、モデルが内部で段階的な推論プロセスを生成してから最終回答を出力します。コーディングや数学など精度が求められるタスクではThinkingモード、高速な応答が必要な対話タスクではNon-thinkingモードが適しています。

Thinking Preservation機能

Qwen3.6-27Bが新たに導入した機能が「Thinking Preservation(思考保持)」です。

通常、マルチターンの会話では各ターンで推論内容がリセットされます。Thinking Preservationを有効にすると、前のターンの思考内容を次のターンに引き継げるため、長期的な開発タスクや反復的なコーディング作業での文脈保持が向上。エージェント型タスクでの利用に活用できます。

ネイティブマルチモーダル統合

Qwen3.6-27Bはテキスト・画像・動画を同一のモデルで処理するネイティブマルチモーダル設計。早期融合訓練により、視覚情報とテキスト情報を統合的に扱えます。

マルチモーダルThinkingモードとNon-thinkingモードも単一チェックポイントで対応しており、画像を含むコード生成タスクや、ドキュメント画像からの情報抽出なども可能。

Qwen3.6-27Bがタスクを処理する基本的な流れは以下のとおりです。

- ユーザーがテキストまたは画像・動画を入力する

- ThinkingモードであればReasoning Traceを生成し、前ターンのThinkingコンテキストを保持

- 多段階のツール操作・ファイル編集・コード実行などのエージェントタスクをこなしながら成果物を生成する

- 最終回答を出力し、次ターンに思考コンテキストを引き継ぐ

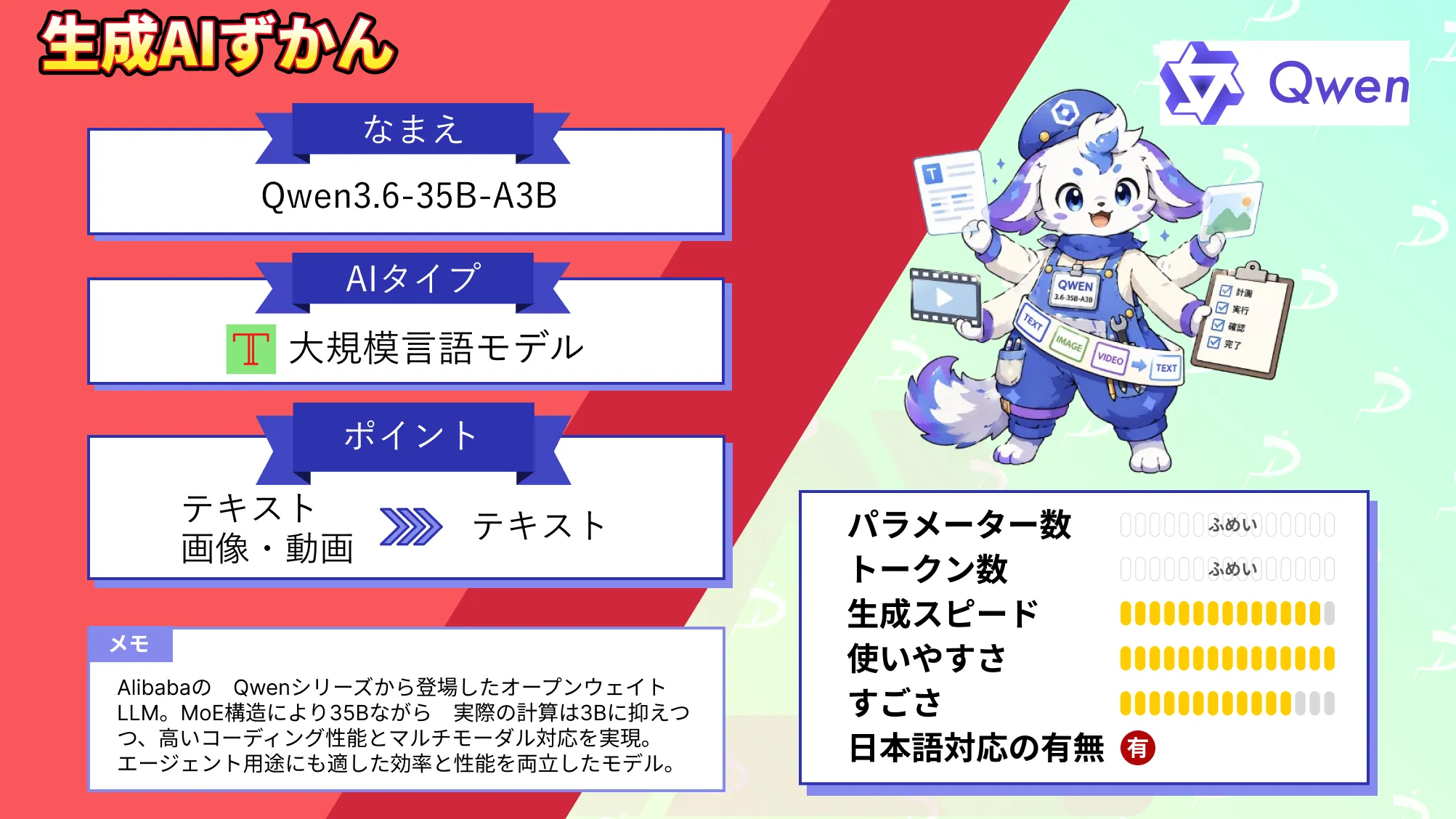

同じQwen3.6ファミリーのMoEモデルQwen3.6-35B-A3Bについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bの特徴

Qwen3.6-27Bの最大の特徴は、27Bという実用的なスケールで、フラッグシップ水準のエージェント型コーディング性能を実現した点です。競合モデルとのベンチマーク比較も交えながら、主な特徴を解説します。

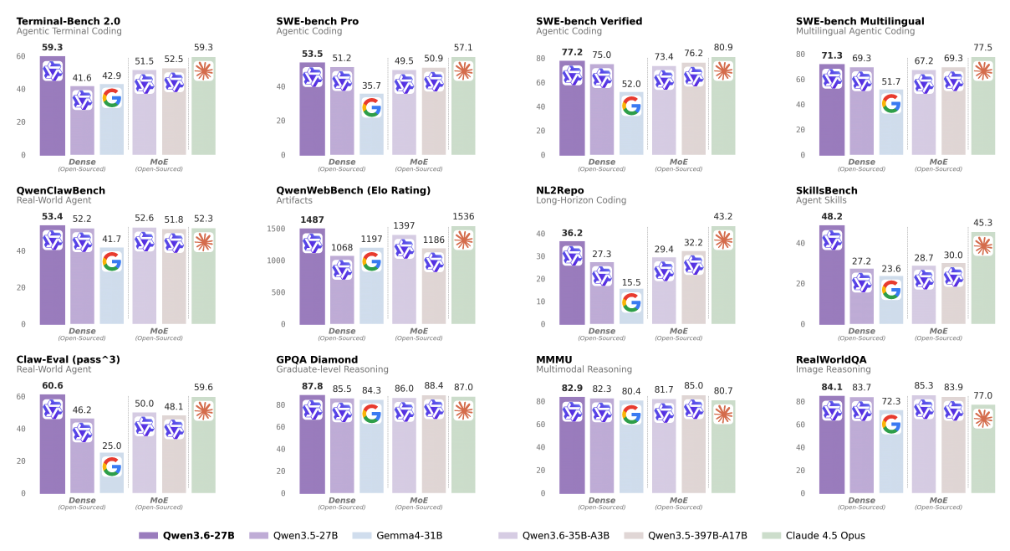

| 評価項目 | Qwen3.6-27B | Qwen3.5-397B-A17B | Qwen3.6-35B-A3B | Claude 4.5 Opus | Gemma4-31B |

|---|---|---|---|---|---|

| SWE-bench Verified | 77.2 | 76.2 | 73.4 | 80.9 | 52.0 |

| SWE-bench Pro | 53.5 | 50.9 | 49.5 | 57.1 | 35.7 |

| Terminal-Bench 2.0 | 59.3 | 52.5 | 51.5 | 59.3 | 42.9 |

| SkillsBench | 48.2 | 30.0 | 28.7 | 45.3 | 23.6 |

| GPQA Diamond(推論) | 87.8 | 88.4 | 86.0 | 87.0 | 84.3 |

| MMMU(マルチモーダル) | 82.9 | 85.0 | 81.7 | 80.7 | 80.4 |

27Bで前世代397Bを超えるエージェント型コーディング性能

Qwen3.6-27Bは、オープンソースDenseモデルとしてエージェント型コーディングで突出した性能を達成。SkillsBenchでは48.2を記録し、前世代フラッグシップQwen3.5-397B-A17B(30.0)を18.2ポイントも上回ります。

Terminal-Bench 2.0では59.3を達成。これはQwen3.5-397B-A17B(52.5)を6.8ポイント上回り、Claude 4.5 Opus(59.3)と同水準です。

Dense構造による低VRAMでの実用的なデプロイ

MoEモデルはアクティブパラメータは少ないものの、全専門家のウェイトをメモリに保持する必要があります。Qwen3.5-397B-A17BはVRAM要件が非常に高く、個人や中小チームがセルフホストするには相当なインフラ投資が必要でした。

Qwen3.6-27BはDenseアーキテクチャのため、27Bパラメータ分のVRAMだけで動作します。量子化(GGUF形式)を使えば、さらに低スペック環境での稼働も可能です。

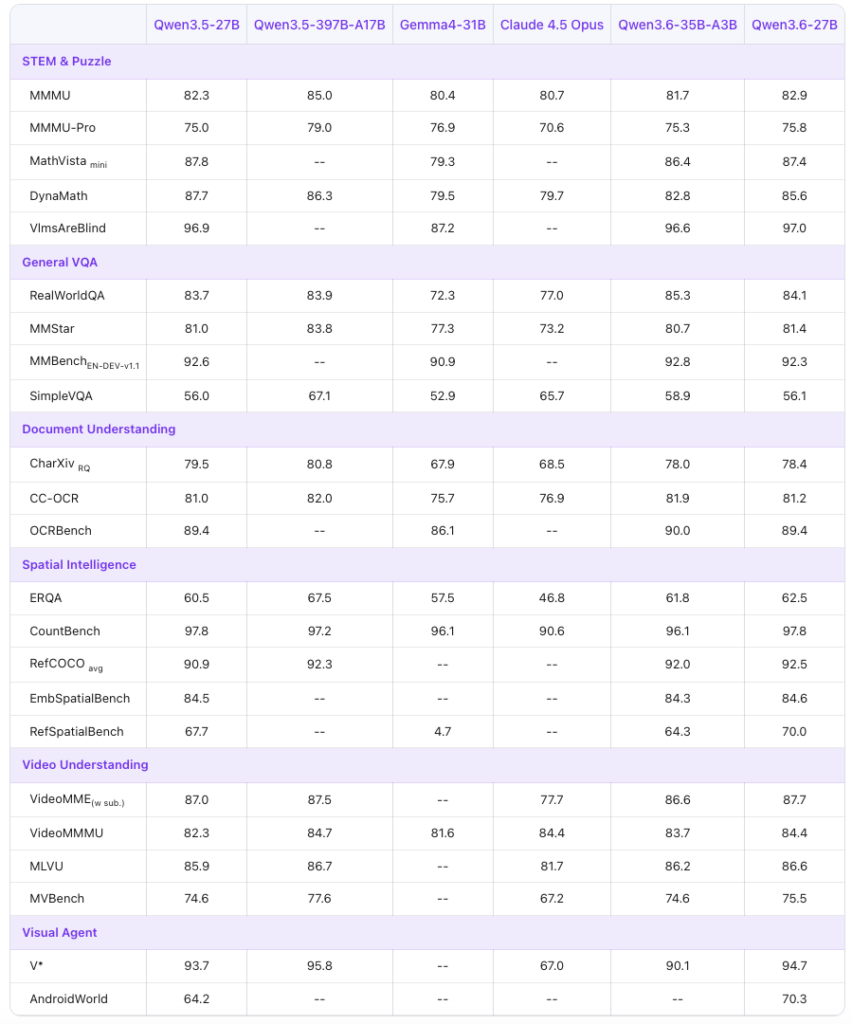

ネイティブマルチモーダルで画像・動画も扱える

Qwen3.6-27Bはテキスト・画像・動画を1つのモデルで統合的に処理できるマルチモーダルモデルです。MMMUでは82.9を記録し、Claude 4.5 Opus(80.7)を上回ります。

ビジュアルエージェント評価のAndroidWorldでは70.3と、前世代Qwen3.5-27B(64.2)を6.1ポイント上回る結果。デバイス上の画像を解析しながらタスクを自律実行する場面での有効性が示されています。

Qwen3.6-27Bの安全性・制約

Qwen3.6-27BはAlibaba Groupが開発・公開するオープンソースモデルです。利用にあたっては以下の点を把握しておくことと良いでしょう。

| 項目 | 内容 |

|---|---|

| ライセンス | Apache-2.0 |

| 利用規約 | Qwen Usage Policy |

| コンテキストウィンドウ | 262,144トークン |

| 最大出力トークン | 1,010,000トークン |

| 対応入力モダリティ | テキスト・画像(動画も対応) |

オープンウェイトモデルのため、Qwen Studioを経由せずにウェイトを直接ダウンロードして自己ホストする場合、安全性フィルターの有無や動作はユーザー側の実装に依存します。

エージェント指向の自立型コーディングAIであるQwen3.6-Max-Previewについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bの料金

Qwen3.6-27BはオープンウェイトモデルとしてHugging FaceおよびModelScopeから無料でウェイトをダウンロードできます。セルフホストであれば、モデルそのものの利用コストはかかりません。

| 利用方法 | 料金 | 備考 |

|---|---|---|

| オープンウェイト(セルフホスト) | 無料 | Hugging Face / ModelScopeよりダウンロード |

| Qwen Studio(試用) | 詳細非公開 | Web、デスクトップ、モバイルアプリ |

| Alibaba Cloud Model Studio API | 準備中(詳細非公開) | 2026年4月時点でcoming soon |

APIを通じた利用については、Alibaba Cloud Model Studio APIの提供開始後に料金体系が公開される見込みです。

オープンソース動画生成AIであるWan2.1について、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bのライセンス

Qwen3.6-27BはApache-2.0ライセンスで公開されています。

| 利用形態 | 可否 |

|---|---|

| 商用利用 | ⭕️ |

| 改変 | ⭕️ |

| 再配布 | ⭕️ |

| 特許利用 | ⭕️ |

| 私的利用 | ⭕️ |

Apache-2.0ライセンスは商用利用・改変・再配布・私的利用・特許利用のすべてを許可する非常に自由度の高いライセンスです。ソースコードの開示義務もなく、自社プロダクトへの組み込みや派生モデルの作成も可能。

生成と編集を統合した次世代の画像AIであるQwen-Image-2.0について、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bの使い方

Qwen3.6-27BはQwen Studio、Alibaba Cloud Model Studio API、セルフホストの3つの方法で利用できます。ここでは代表的な利用方法を紹介します。

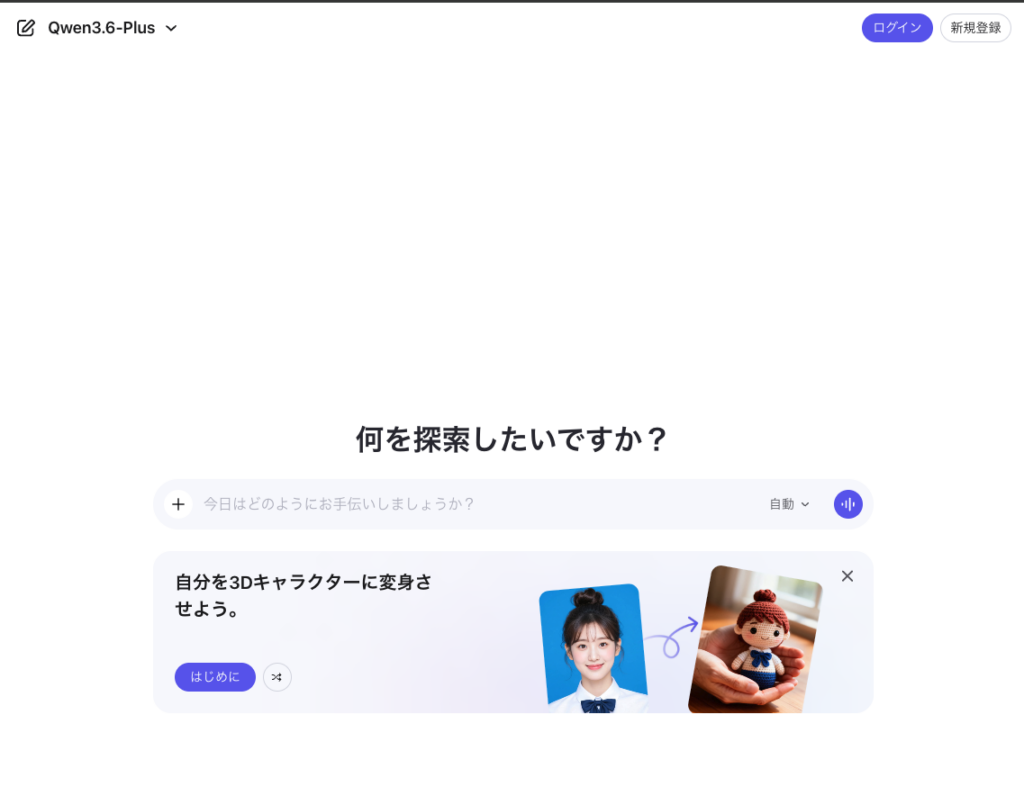

Qwen Studioで試す

最も手軽な方法はQwen Studioです。Web、デスクトップ、モバイルアプリが提供されており、アカウント登録だけで即座に利用可能。

Qwen Studioを使う場合、ログインをしなくても使えますが、チャット履歴が残らないので、履歴を残したい場合にはログインをして使うのが良いでしょう。

Qwen3.6-27Bになっていない場合には、モデルを変更しましょう。

モデルを変更したら、プロンプトを入力します。今回は「Qwen3.6-27Bについて教えて」と指示を入れます。

結果はこちら

こんにちは!私はアリババグループの通義実験室(Tongyi Qianwen)が独自に開発した大規模言語モデル、Qwen(通義千問)です。

「Qwen3.6-27B」についてのご質問ですね。Qwenファミリーは世代(Qwen, Qwen2, Qwen3など)やパラメータサイズによって特徴が異なりますが、名前から読み取れる「27B(270億)パラメータ規模」のモデルと、Qwen3世代に期待される主な特徴についてお伝えします。

### 1. 「27B(270億)パラメータ」の立ち位置

Qwenのファミリーにおいて、27Bは「中規模モデル(Mid-size)」の一角として、**コストと性能のバランスが最も優れている**とされるクラスです。

* **推論の高速さ:** 72Bなどの超大規模モデルに比べて計算量が少なく、ローカル環境(高性能なゲーミングPCやワークステーション、または軽量なサーバー)でも比較的快適に動きます。

* **高水準な知能:** 旧世代の70B規模のモデルよりも大幅に高い推論能力を持ちます。小規模なモデル(7Bや14B)とは別次元の複雑なタスク(深い論理思考、複雑なコード作成など)をこなすことができます。

* **実務導入への最適解:** 大量のリソースを必要としないため、実業務への導入や特定タスクへのファインチューニング(微調整)に向いています。

### 2. 「Qwen3」世代の進化のポイント

Qwenシリーズの近年の世代(Qwen2.5やQwen3系統)では、単にパラメータを増やすだけでなく、アーキテクチャや学習データの質を改善することで以下のような能力が劇的に向上しています。

* **高度なロジックと推論能力:** 数学の問題や複雑な論理パズルなどにおいて、段階的に思考して正解にたどり着く能力が大幅に強化されています。

* **コーディングの支援:** 複雑なタスクの分解や、複数ファイルにまたがるコードの生成・理解・デバッグが可能となり、実質的な開発支援ツールとして機能します。

* **超長文脈のサポート:** 非常に長い資料やドキュメント(256Kコンテキストウィンドウ)を一度に読み込み、その中から正確に情報を抽出したり要約したりできます。

* **視覚分析の深化:** 画像認識だけでなく、複雑なチャート、数式、科学図表などを論理的に解釈し、文章化することができます。

もし、Qwen3.6-27Bに関する具体的なベンチマークスコア、HuggingFaceやOllamaなどでの具体的なモデルの動かし方(プロンプト設計やハードウェア要件など)についてご興味があれば、そのあたりも詳しくお答えできます。

何か特定のタスクでお手伝いできることや、さらに知りたい技術的な詳細はありますか?ちゃんと回答してくれましたが、処理速度はちょっと遅いなと感じました。

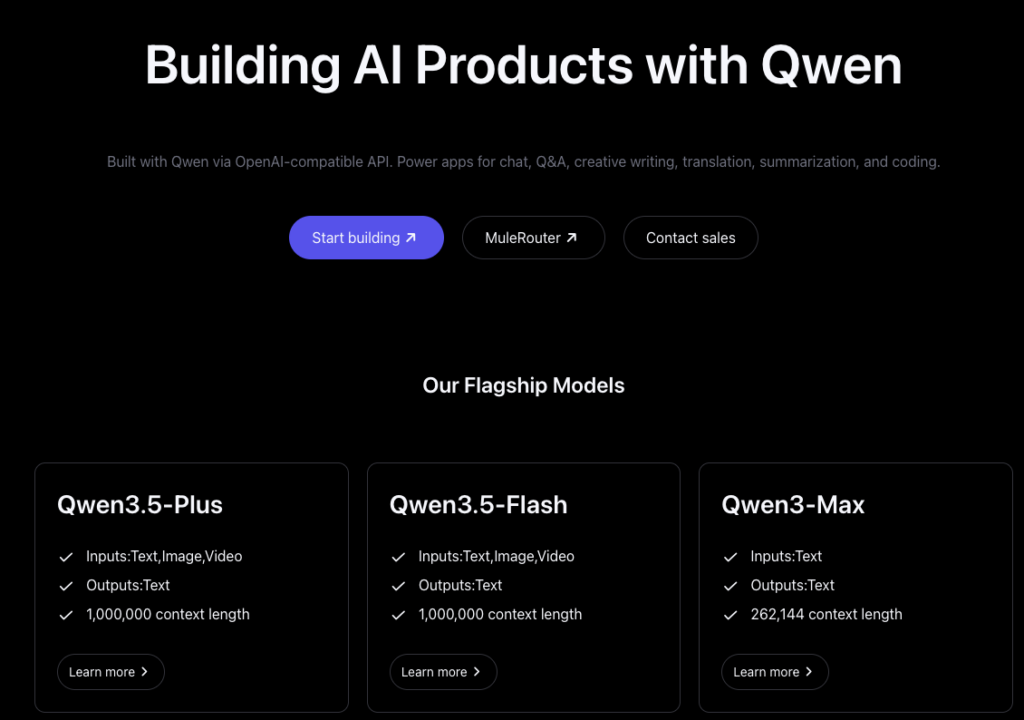

Alibaba Cloud Model Studio APIで呼び出す

Alibaba Cloud Model Studio APIはOpenAI互換・Anthropic互換の両プロトコルをサポートしており、既存のアプリケーションにほぼ変更なく組み込めます。

ローカルにセルフホストする

Hugging FaceまたはModelScopeからウェイトをダウンロードし、主要な推論フレームワークで動作させられます。対応フレームワークは以下のとおり。

| フレームワーク | 特徴 |

|---|---|

| Hugging Face Transformers | 標準的なLLM推論・学習フレームワーク。transformers serveでOpenAI互換サーバーを起動可能 |

| llama.cpp(GGUF) | 最小限のセットアップで幅広いハードウェアに対応。量子化モデルで低VRAMでの動作が可能 |

| MLX(mlx-lm / mlx-vlm) | Apple Silicon最適化。テキストのみはmlx-lm、画像+テキストはmlx-vlm |

| SGLang | 高速な大規模LLM・VLMサービングフレームワーク。OpenAI互換API提供 |

| vLLM | 高スループット・低レイテンシのLLM推論エンジン |

LM Studioでも使えるようになっています。

【業界別】Qwen3.6-27Bの活用シーン

Qwen3.6-27Bのエージェント型コーディング性能とマルチモーダル対応は、さまざまな業界での活用が期待できます。ここでは代表的な活用シーンを業界別に解説します。

ソフトウェア開発・エンジニアリング

ソフトウェア開発とエンジニアリングはQwen3.6-27Bが最も力を発揮する領域ではないでしょうか。

SWE-benchシリーズやTerminal-Bench 2.0での高スコアが示すように、リポジトリ全体を把握した上でのバグ修正・コードレビュー・リファクタリングといった実際の開発業務に直結するタスクに強みを持ちます。

OpenClawやClaude Code・Qwen Codeを通じてエージェントとして動かすことで、ターミナル操作・ファイル編集・テスト実行まで一連のワークフローを自動化できるでしょう。

フロントエンド・UI開発

QwenWebBenchでEloレーティング1487を記録。Webデザイン・Webアプリ・ゲーム・SVG・データビジュアライゼーション・アニメーション・3Dのカテゴリを対象とした内部評価で、フロントエンド開発における高い自動生成品質が確認されています。

デザインのスクリーンショットやワイヤーフレーム画像を入力として受け取り、対応するコードを生成するマルチモーダルな活用も期待できるでしょう。

医療・研究・高度な推論が必要な分野

大学院レベルの推論能力を測るGPQA Diamondでは87.8を記録し、Claude 4.5 Opus(87.0)と同等の水準。医療論文の読解・実験計画の補助・科学的データの解析など、専門的な推論を要する場面での活用が考えられます。

ただし、医療現場での意思決定に直接利用する場合は、専門家による検証と適切なガイドラインへの準拠が前提となります。

医師の業務をサポートするAI活用事例について、詳しく知りたい方は以下の記事も参考にしてみてください。

マーケティング・コンテンツ制作

マルチモーダル対応により、画像・動画と組み合わせたコンテンツ分析や生成が可能です。画像認識能力を活用した商品画像の解析や、競合比較レポートの自動生成など、業務効率化の有力な手段といえるでしょう。

生成AIを活用したマーケティングツールについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bを使ってみた

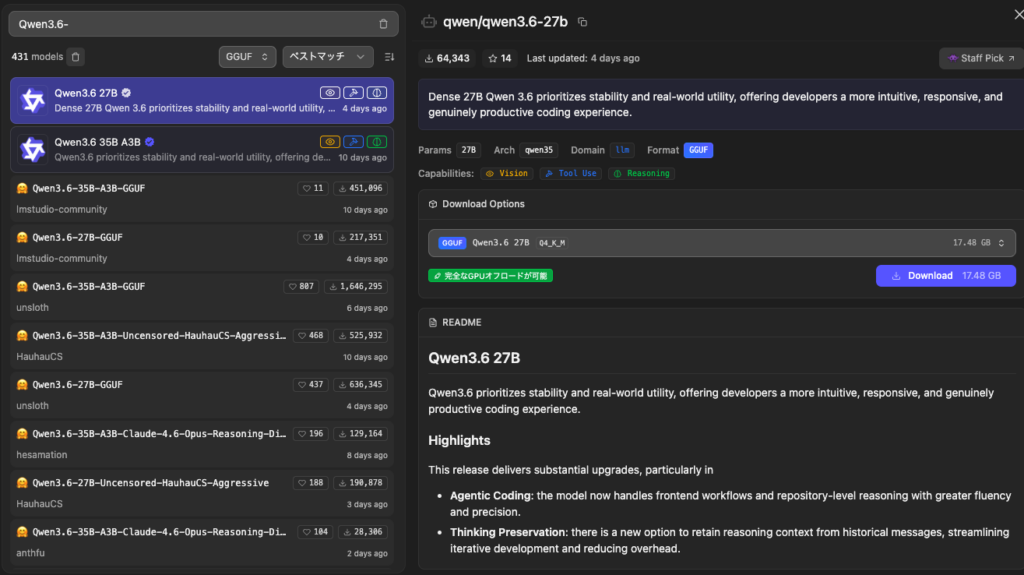

API経由での利用が本記事執筆時点ではまだできないので、今回はLM Studio経由で使ってみたいと思います。

筆者の環境としては下記です。

◆Mac mini M4

◆64GBメモリ

モデルをダウンロードして、Qwen3.6-35B-A3Bと比較してみます。

「strawberryにrはいくつある?」というのを並列で処理してもらいます。

Qwen3.6-27Bの結果がこちら

結論:strawberryには「r」が3つあります。

理由:綴りを文字列として分解すると `s-t-r-a-w-b-e-r-r-y` であり、インデックス2(3文字目)、インデックス7(8文字目)、インデックス8(9文字目)に `r` が配置されています。

実装検証例(Python):

```python

word = "strawberry"

count = word.count("r") # → 3

```

不確実性:なし。言語表記は固定されており、カウント結果は一意です。Qwen3.6-35B-A3Bの結果がこちら

結論:「strawberry」に含まれる「r」は3つです。

理由:

- 文字列を逐字確認:s-t-**r**-a-w-b-e-**r**-**r**-y

- 位置:3文字目、8文字目、9文字目にそれぞれ1つずつ該当

- 大文字・小文字を区別しない場合でも、アルファベット「r」の出現回数は3で確定

実装確認案:

- Python: `str("strawberry").count("r")` → `3`

- JavaScript: `"strawberry".match(/r/g)?.length` → `3`

- SQL: `LENGTH("strawberry") - LENGTH(REPLACE(LOWER("strawberry"), 'r', ''))` → `3`64GBのメモリで並列処理をさせたので、処理速度はかなり遅くなってしまいましたが、この課題についてはどちらのモデルを正解をしています。

Qwen3.6-27Bには「Qwen3.6-27Bについて教えて」というプロンプトも投げてみます。

結果はこちら

結論:Qwen3.6-27Bは公式に存在しないモデル名です。AlibabaのQwenシリーズでは現在「Qwen2.5」まで公開されており、パラメータ規模は7B/14B/32B/72Bの標準階層が採用されています。

理由:

- 公式技術レポート・Hugging Face/ModelScopeの公開リストに「Qwen3.6」または「27B」規模のモデルは存在しない。

- 「3.6」はバージョン表記の誤記、「27B」はQwenの公開ラインナップに合致しない非標準パラメータ数。

- 実務で想定される用途(医療ドメインLLM・RAG・画像解析連携)では、Qwen2.5-32B-Instructが最も近接する代替モデル。

実装・運用レベルでの代替案(不確実:公式ロードマップ未公開のため、現時点での最適構成):

- モデル選定:Qwen2.5-32B-Instruct(Apache 2.0)。医療・理学療法ドメインでは32Bクラスが推論精度と推論コストのバランスで最適。

- 推論基盤:vLLMまたはOllamaでGPU(A100 40GB×1またはL40S×1)にデプロイ。設定例:`max_model_len=8192, tensor_parallel_size=1, dtype=float16, temperature=0.2, top_p=0.9`。

- RAG連携:LangChain/LlamaIndex + ChromaDB/Weaviate。足部評価ガイドライン・理学療法エビデンス文献を`chunk_size=512, overlap=50`で分割。埋め込みモデルは`bge-m3`または`text-embedding-3-large`。

- 出力制御:JSON Schema強制出力。例:

```json

{

"assessment": "足底筋膜炎疑い",

"range_of_motion": {"ankle_dorsiflexion_deg": 5},

"recommendation": ["踵ストレッチ", "発泡ウレタンインソール検討"],

"confidence": 0.82

}

```

医療用途では必ずHITL(人間検証)と出力ガードレール(禁忌用語フィルタ・臨床ガイドライン一致チェック)を併設。

- 検証方法:MedQA/PubMedQAでベースライン測定後、自前データセット(足部圧力マップキャプション・関節可動域記録・理学療法評価表)でFew-shot評価。精度閾値はドメイン依存だが、通常F1≥0.85を事業化基準とする。

注記:モデル名・バージョンは公式アナウンス(Tongyi Lab Blog、arXiv、Hugging Face)で確認してください。事業化検討時は、医療AI規制(PMDA/CE marking)とデータプライバシー(国内医療情報管理基準)のコンプライアンス設計を並行して進める必要があります。ナレッジカットオフがあるので、最新のモデルについてはやはり回答できないようです。ただ、知らないことでもハルシネーションっぽさは出てないですね。

【課題別】Qwen3.6-27Bが解決できること

Qwen3.6-27Bが解決できる代表的な課題を紹介します。オープンソースモデルの導入を検討している開発者やチームにとって、特に関連性の高いユースケースです。

大規模MoEモデルを使わずにフラッグシップ水準のコーディングを実現できる

これまでオープンソースでフラッグシップ水準のコーディング性能を得るには、Qwen3.5-397B-A17BのようなMoEモデルが必要でした。Qwen3.6-27Bは27BパラメータのシンプルなDenseアーキテクチャでその壁を突破。

推論インフラの設計・コスト・運用負荷を大幅に削減しながら、SWE-bench Verifiedで77.2という実用的な精度を維持しています。

マルチターンのエージェントタスクで文脈を失わずに作業を継続できる

従来のモデルでは、エージェントが長期タスクを実行する際に各ターンで推論コンテキストがリセットされる問題がありました。

Thinking Preservation機能により、前ターンの思考内容を引き継いだ継続的な推論が可能。大規模リポジトリへの継続的なコード修正や、複数ステップにわたるデバッグ作業の精度が向上します。

テキスト・画像・動画を統合したマルチモーダル開発に対応できる

コーディングに特化したモデルとビジョンモデルを別々に運用する場合、モデルの切り替えやコスト管理が複雑です。

Qwen3.6-27Bは1つのチェックポイントでテキスト・画像・動画を処理できます。UI設計のスクリーンショットからコードを生成したり、ドキュメント画像から情報を抽出してコードに反映したりする統合的なワークフローが実現可能。

| 課題 | Qwen3.6-27Bで解決できるか |

|---|---|

| 大規模MoEなしでのフラッグシップコーディング | 解決できる |

| マルチターンエージェントでの文脈喪失 | Thinking Preservationで解決 |

| テキスト+画像+動画の統合処理 | ネイティブマルチモーダルで対応 |

| Apache-2.0での商用プロダクト組み込み | ライセンス上問題なし |

| 既存OpenAI/Anthropic SDKからの移行 | 両互換APIで対応 |

ビジョン×コーディング特化型マルチモーダルモデルであるGLM-5V-Turboについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-27Bの活用事例

ここではQwen3.6-27Bの活用事例をXでリサーチしたものをいくつか紹介していきます。ご自身でQwen3.6-27Bを利用するときの参考にしてください。

モデル同士の性能比較

こちらの投稿ではQwen3.6-27BとQwen3.6-35B-A3Bで性能を比較されています。

結果はQwen3.6-27Bの勝利のようです。Qwen3.6-27Bは処理速度は遅いが、出力されたものがQwen3.6-35B-A3Bよりも良かったとのことです。

下記の投稿でもモデルの性能を比較されています。thinkingの有無などでも比較されており、結果が可視化されているので非常にわかりやすいです。

下記の投稿ではClaudeと比較をしています。Opus4.5と比較して同じものを作った結果、優劣がつけ難いとのことです。

Qwen3.6-27Bのよくある質問

ここではQwen3.6-27Bのよくある質問について回答していきます。Qwen3.6-27Bの使用を検討している場合には、ぜひ参考にしてみてください。

Qwen3.6-27Bでオープンソース開発を加速しよう

Qwen3.6-27Bは、27BパラメータのシンプルなDenseアーキテクチャで、15倍以上の規模を持つ前世代フラッグシップを全主要コーディングベンチマークで上回るという、オープンソースモデルの常識を覆す存在です。

単なるベンチマーク上の数字ではなく、開発者が実際に直面するリポジトリ修正・ターミナル操作・フロントエンドコード生成といった現実のタスクで前世代を超えた点が、このモデルの本質的な価値といえるでしょう。

今後はAlibaba Cloud Model Studio APIの正式提供が開始されることで、エンタープライズ環境でのQwen3.6-27B活用がさらに広がっていくと考えられます。

ぜひ皆さんも本記事を参考にQwen3.6-27Bを使ってみてください!

最後に

いかがだったでしょうか?

Qwen3.6-27Bを活用することで、大規模なインフラを用意せずともフラッグシップ水準のエージェント型コーディングを自社の開発ワークフローに組み込めます。一方で、API提供前の現段階ではセルフホストのインフラ設計やVRAMの確保が鍵となるため、まずQwen Studioで試してから本番環境への導入を検討することが、効果的な活用につながります。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。