MCPを活用したオンプレミスとは?メリットや活用シーンを徹底解説

WEELメディア事業部AIライターの2scです。

みなさん!業務特化のチャットボットやAIエージェントが簡単に作れる「MCP(Model Context Protocol)」はもう、お試しになりましたか?

実はこのMCP、クラウドだけでなくオンプレミスでも導入が可能。しかも、オンプレミスでの導入なら、MCPの弱点がカバーできちゃうんです。

当記事では、そんなMCP×オンプレミスを徹底解説!両者を組み合わせるメリットや具体的な活用シーンをお伝えしていきます。完読いただくと、Claude DesktopにとらわれないMCPの導入が目指せます。ぜひぜひ、最後までお読みくださいね!

\生成AIを活用して業務プロセスを自動化/

MCPとは?

2024年11月末にAnthropicが公開したMCP(Model Context Protocol)は、AIアプリ(生成AI)と外部ツール群をシームレスに連携させるプロトコルです。その特徴は以下のとおりになります。(※1)

- オープンソース・共通規格としてリリースされた「生成AI界のUSB-Cポート」

- 雑多な外部ツール群と生成AIの連携方法を統一

- 雑多な外部ツール群と生成AIのデータ・処理のやり取りを双方向で仲介

- 大手企業や個人開発者のコミュニティから、MCP対応のツール(MCPサーバー)がリリース中

- Claude Desktop / Cline / Amazon Bedrock Agents / Copilot Studio…etc.MCP対応のAIアプリも登場中

このMCPの魅力としては、JSONファイルを書き換えるだけで多種多様な外部ツールと生成AIを連携できてしまう手軽さが挙げられます。導入に際して、従来のRAGチャットボット&AIエージェント導入時のような、外部ツールに合わせたフルスクラッチ開発は不要です。

そんなMCPについては、OpenAIのサム・アルトマンCEOも注目していて、今後の生成AI活用シーンの主流になることが期待されています。

なお、MCPについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

MCP×オンプレミスのメリット

話題のMCPですが、こちらは自社保有のハード&ソフトウェアで生成AIやシステムを稼働させる「オンプレミス」との相性にも優れています。両者を組み合わせた生成AI搭載システムのメリットは下記の5点です。

- 実装・保守・カスタマイズが容易

- 学習範囲外の知識が拡張可

- 生成AI側からツールへの操作も可能

- セキュリティ面の強化が可能

- 通信速度も改善可

それでは以下、MCP×オンプレミスのメリットを詳しくみていきましょう。

実装・保守・カスタマイズが容易

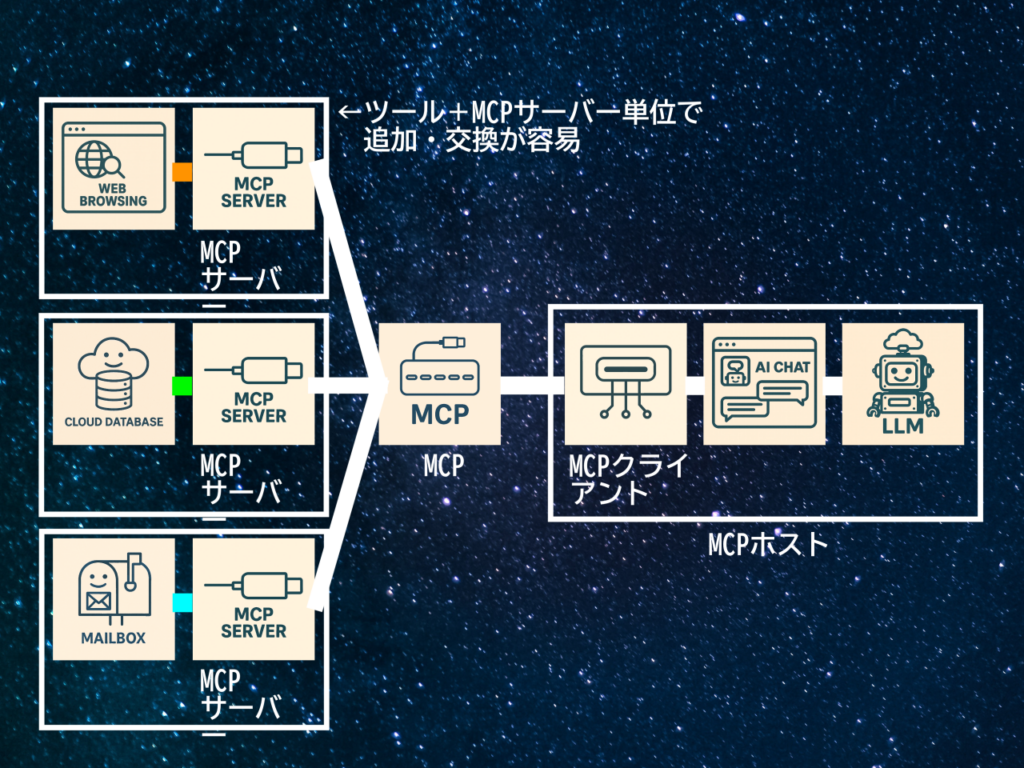

MCPは以下の部品で構成されていて、連携先の追加・変更はMCP共通のルールに則って画一的に行えます。連携先別でソースコード用意しなくても済むため、実装・保守・カスタマイズが容易です。

- MCPホスト:MCPクライアントを含むAIアプリ本体(Claude Desktopや自作のアプリ等)

- MCPクライアント:AIアプリに同梱されるMCP用のコネクタ

- MCP:MCPサーバーを1つに束ねてMCPクライアントに繋ぐハブ

- MCPサーバー:各ツールをMCPに繋ぐためのプラグ(SlackやTavily等)

- ツール(Tools):生成AIから各ツールを動かすための関数

- リソース(Resources):生成AIが参照できる情報

- プロンプト(Prompts):生成AIの挙動を固定するテンプレート

そんなMCPについては、すでにオンプレミスで実装されているシステムや生成AIとの統合も簡単に行えます。「2025年の崖」の原因であるレガシーシステムやサイロ化したデータも、MCPサーバー化して生成AIと連携させることで、新しいソリューションの種となってくれるかもしれません。

学習範囲外の知識が拡張可

生成AI、特にオンプレミスで実装されたローカルLLMでは、リアルタイムの情報やニッチな知識の提供が困難です。

そこでMCPが活躍します。MCPは社内のストレージやデータベースをローカルLLMに繋ぐことができ、学習範囲外の知識の補完が可能です。

さらに、既存のMCPサーバーを活用すれば従来のRAGチャットボットのようなEmbeddingやチャンク分けは不要で、手軽に社内用チャットボットが導入できます。

生成AI側からツールへの操作も可能

MCPでは、FunctionCallingやAIエージェントのように、生成AI側からツールを操作させることも可能です。こちらをオンプレミスで活用すれば、既存のシステムや社内用ツールをチャット形式で自動化できるようになり、コンテンツ生成にとどまらない業務効率化が図れます。

セキュリティ面の強化が可能

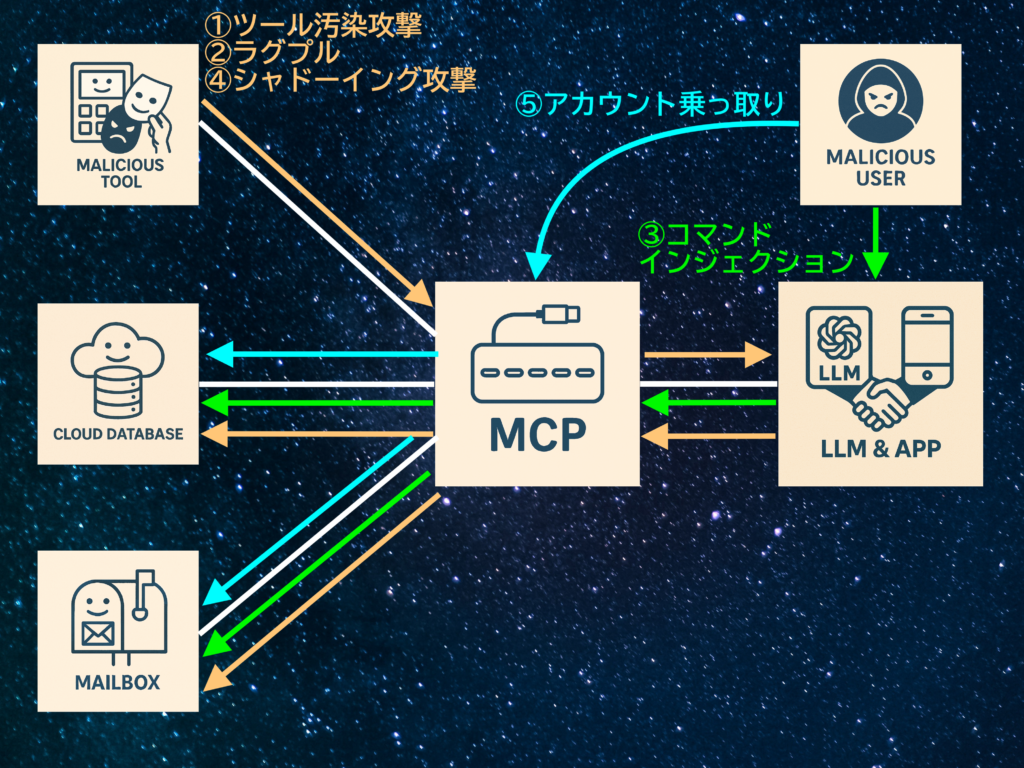

登場して間もない技術であるMCPは、以下のようなセキュリティ上のリスクを抱えています。以下に挙げられるものは、どれも攻撃の発見が難しく、重大なインシデントに繋がりかねません。

- ツール汚染攻撃:悪意のあるMCPサーバーがユーザーに隠れて不正を働くリスク

- ラグプル:導入したMCPサーバーに後出しで不正な機能が実装されるリスク

- コマンドインジェクション:生成AI経由でMCPサーバーに不正なコマンドが渡されるリスク

- シャドーイング攻撃:悪意のあるMCPサーバーが正規のMCPサーバーに不正な動作をさせるリスク

- アカウント乗っ取り:MCPサーバーとの連携に使うアカウントが乗っ取られるリスク

なのですが、生成AIからMCPサーバーまでを丸ごとオンプレミスで運用してしまうことで、これら外部からの攻撃リスクは大幅に低減可能。求めるセキュリティ要件が高い場合や法律上社内データを第三者に提供できない場合でも、MCPであれば導入が行えるかもしれません。

処理速度も改善可

生成AIとツールをMCPサーバー経由で連携させるMCPでは、両者をダイレクトに連携させる従来手法に比べて処理速度が低下する傾向にあります。ですが、完全オンプレミスでMCPを運用することにより、処理速度の改善が可能です。

MCP×オンプレミスの活用シーン

ここからは、MCPとオンプレミスの組み合わせが活躍しそうなシーンを3つご紹介します。以下、詳しくみていきましょう。

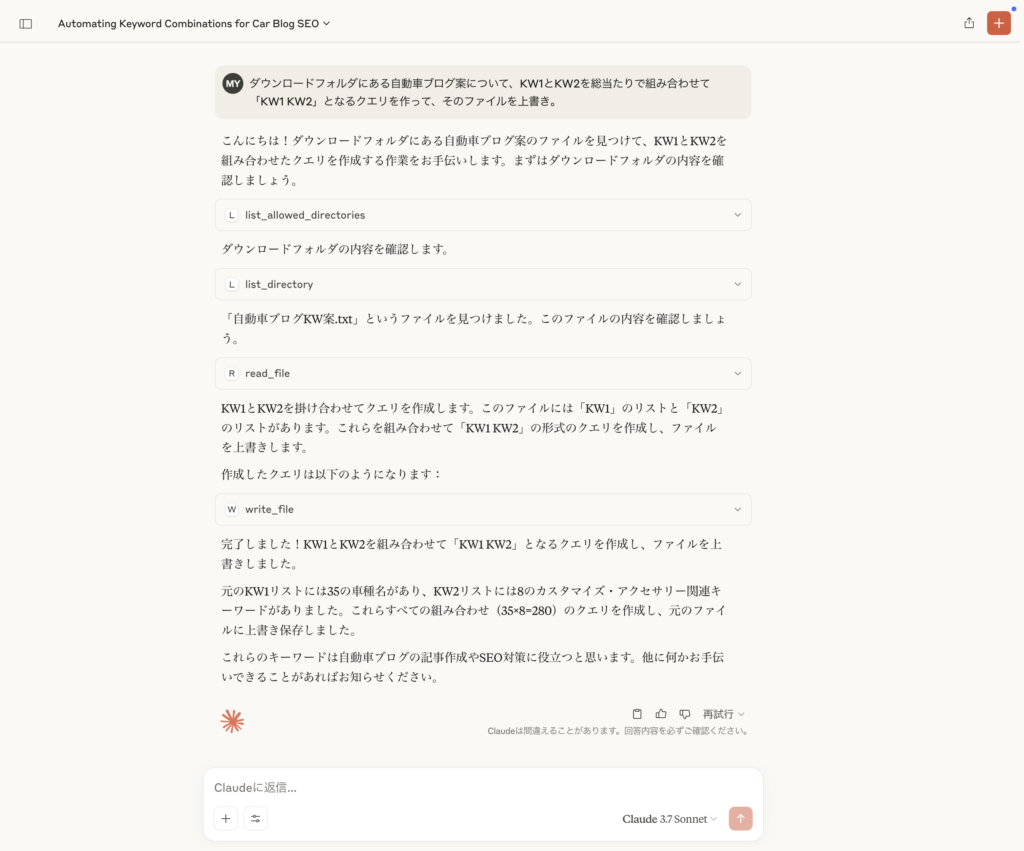

【LangChain MCP Adapter】ローカルLLMでもMCPの導入を実現

MCPは基本的に、Claude DesktopやClineのような既製AIアプリでの使用を想定して開発されています。

ですが、「LangChain MCP Adapter」を活用することで、オンプレミス運用のローカルLLMでもMCPサーバーとの連携が可能となります。その具体的なしくみは、以下のとおりです。(※2)

- LangChain&Ollamaで実装されたローカルLLMがLangChainのツールを呼び出す

- LangChain MCP AdapterがLangChain式のツール呼び出しをMCP式に翻訳する

- ローカルLLMの命令どおりにMCPサーバーが稼働する

こちらの方法であれば、オンプレミスでもMCPを使って、チャットボットやAIエージェントが簡単に開発・導入できるでしょう。

【Filesystem MCP Server】ローカルファイルによる回答提供

MCPが公式にリリースしている「Filesystem MCP Server」は、生成AIによるローカルファイルの参照・操作を可能とするMCPサーバーです。その強みは以下のとおりで、Claude Desktop等に導入してすぐに使える優れものとなっています。

- 公式MCPサーバーのため信頼性が高い

- コーディングやベクトルDBの準備は一切不要で、ファイルの参照・操作機能が実装できる

そんなFilesystem MCP Serverは、先述のLangChain MCP Adapter経由で、オンプレミス運用のローカルLLMからも利用可。社外秘の資料や設計図を扱う際に、その威力を発揮してくれるでしょう。

【音声認識モデル】文字起こしから資料作成までの自動化

会話音声を文字起こししてくれる「音声認識モデル」のなかには、AIモデルをローカルにインストールして使えるものも存在します。この音声認識モデルをMCPサーバー化してオンプレミス運用のローカルLLMと繋ぐことで、文字起こしから資料作成までの自動化が可能です。

なお、LLM全般とオンプレミスの組み合わせについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

「MCP×オンプレミス」で生成AIの社内活用を加速させよう

当記事では、話題のMCPとオンプレミスの組み合わせについてご紹介しました。オンプレミスはMCPとの相性に優れていて、MCPが苦手とするセキュリティ面・処理速度を補ってくれます。そんなMCPとオンプレミスの組み合わせで考えられる活用シーンは以下のとおりです。

- ローカルLLMでもMCPの導入を実現(LangChain MCP Adapter)

- ローカルファイルによる回答提供(Filesystem MCP Server)

- 文字起こしから資料作成までの自動化(音声認識モデル)

簡単にチャットボットやAIエージェントが作れるMCPは今後、業界問わず広く普及していくかもしれません。クラウド / オンプレミス問わず導入ができますので、先取りして生成AI込みのDXを実現しましょう!

最後に

いかがだったでしょうか?

生成AIの導入を検討する上で、MCPとオンプレミスの組み合わせは、安全性と柔軟性を両立する現実的な選択肢です。レガシー資産を活かしながら、業務特化型AIエージェントの構築を次のステップへ進めるヒントが得られるはずです。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。

【監修者】田村 洋樹

株式会社WEELの代表取締役として、AI導入支援や生成AIを活用した業務改革を中心に、アドバイザリー・プロジェクトマネジメント・講演活動など多面的な立場で企業を支援している。

これまでに累計25社以上のAIアドバイザリーを担当し、企業向けセミナーや大学講義を通じて、のべ10,000人を超える受講者に対して実践的な知見を提供。上場企業や国立大学などでの登壇実績も多く、日本HP主催「HP Future Ready AI Conference 2024」や、インテル主催「Intel Connection Japan 2024」など、業界を代表するカンファレンスにも登壇している。