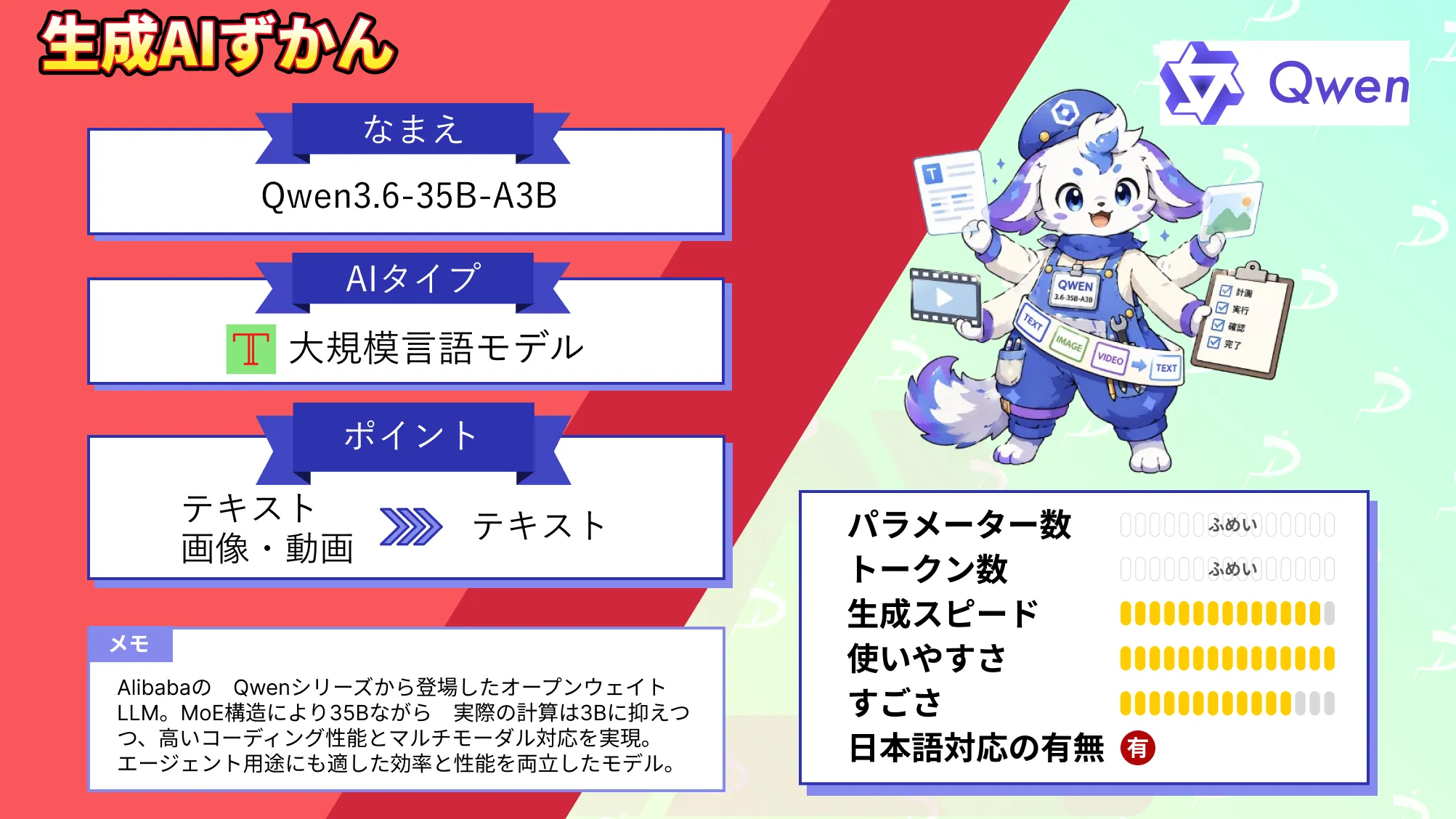

Qwen3.6-35B-A3Bとは?Claude Sonnet 4.5を超えた空間知能と圧倒的コーディング性能を徹底解説

- Qwen3.6-35B-A3Bは、3Bのアクティブパラメータで高いコーディング性能を実現するオープンウェイトLLM

- マルチモーダル対応とPreserve Thinkingにより、複雑なエージェントタスクにも活用しやすい設計

- ベンチマークや活用事例から見ても、コーディング用途での実用性が高いモデル

2026年4月、Alibabaが開発するQwenシリーズから、新たなオープンウェイトLLMが公開されました。

今回登場した「Qwen3.6-35B-A3B」は、Mixture-of-Experts(MoE)構造を採用した大規模言語モデルでありながら、実際に推論に使用されるパラメータを約30億に抑え、高い性能と効率性を両立している点が特徴です。

特に注目すべきは、エージェント的なコーディング能力とマルチモーダルな理解力です。従来モデルを大きく上回る性能を示しつつ、より大規模なモデルに匹敵する水準に到達しています。

一方で、新しいLLMが登場するたびに、「従来のモデルと何が違うのか」「どの程度の性能が出るのか」「実際の開発でどのように活用できるのか」といった疑問を感じる方も多いのではないでしょうか。

そこで本記事では、Qwen3.6-35B-A3Bの概要や仕組み、特徴を整理しながら、実際のユースケースや活用方法について詳しく解説します。

本記事を最後までお読みいただければ、本モデルがどのような思想で設計され、どのような場面で価値を発揮するのかが理解できるはずです。

\生成AIを活用して業務プロセスを自動化/

Qwen3.6-35B-A3Bとは

Qwen3.6-35B-A3Bは、Alibaba CloudのQwenチームが開発・公開したオープンソースの大規模言語モデルです。2026年4月にリリースされ、Apache-2.0ライセンスのもとHugging FaceおよびModelScopeで公開されています。

前世代モデル「Qwen3.5-35B-A3B」の後継であり、同時期にリリースされたクローズドモデル「Qwen3.6-Plus」のオープンソース版に相当。

注目すべき点は、Mixture-of-Experts(MoE)アーキテクチャによる圧倒的な計算効率です。

トータルパラメータは35Bですが、各推論時に実際に活性化するのは3Bのみです。

従来のデンスモデルでは全パラメータを常に使用するのに対し、MoEでは必要なエキスパートのみを選択的に活用するため、大幅なコスト削減が実現されています。

| 項目 | Qwen3.6-35B-A3B | Qwen3.5-35B-A3B(前世代) |

|---|---|---|

| リリース時期 | 2026年04月 | 前世代(2025年) |

| トータルパラメータ | 35B | 35B |

| アクティブパラメータ | 3B | 3B |

| マルチモーダル対応 | テキスト・画像・動画 | テキスト・画像 |

| エージェンティックコーディング | 大幅向上 | 基本対応 |

| Preserve Thinking機能 | あり | なし |

| ライセンス | Apache-2.0 | Apache-2.0 |

| コンテキスト長(最大) | 約100万トークン | 256Kトークン |

Qwen3.6-35B-A3Bの仕組み

Qwen3.6-35B-A3Bは、一般的なTransformerベースのモデルとは異なり、Gated DeltaNetとGated Attentionを組み合わせたレイヤー構成を採用しています。

全40層にわたって「10 × (3 × (Gated DeltaNet → MoE) → 1 × (Gated Attention → MoE))」というパターンで層が積み重なっており、線形アテンションと通常アテンションを効果的に使い分ける設計です。

MoEでは、256個のエキスパートのうち推論時に8つがルーティングにより選択され、さらに1つの共有エキスパートを常時使用。合計9つのエキスパートが協調して動作するため、3Bというアクティブパラメータ数にもかかわらず、高い表現能力が発揮されています。

処理フロー

Qwen3.6-35B-A3Bの処理フローとしては、下記のようになります。

- ユーザーからの入力(テキスト・画像・動画)をトークン化し、Vision Encoderで画像・動画情報を処理する

- シンキングモードでは、

<think>...</think>タグ内でモデルが推論プロセスを展開してから最終回答を生成する - MoEルーターが入力に最適なエキスパートを選択し、8つのルーティングエキスパートと1つの共有エキスパートが並列処理を行う

- Preserve Thinking機能が有効な場合、過去のターンの推論コンテキストを保持した状態で次の推論を行い、一貫した意思決定を実現する

- 最終的な回答をユーザーに出力する

コンテキスト長と推論設定

Qwen3.6-35B-A3Bは、標準で262,144トークン(約26万トークン)のコンテキスト長をサポートしています。

さらに拡張すれば最大1,010,000トークン(約100万トークン)までの対応が可能。ただし、コンテキスト長を短くしすぎると推論能力が低下するため、少なくとも128Kトークン以上の設定が推奨されています。

| 主なスペック | 値 |

|---|---|

| トータルパラメータ | 35B |

| アクティブパラメータ | 3B |

| レイヤー数 | 40 |

| エキスパート数 | 256(8ルーティング+1共有) |

| Hidden Dimension | 2048 |

| コンテキスト長(標準) | 262,144トークン |

| コンテキスト長(最大) | 1,010,000トークン |

| テンソル形式 | BF16 |

| モデルタイプ | Causal Language Model with Vision Encoder |

世界最高性能のフラッグシップモデルであるClaude Opus 4.7について、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-35B-A3Bの特徴

Qwen3.6-35B-A3Bには、従来のオープンソースモデルとよりも優れている3つの特徴があります。

エージェンティックコーディング性能の大幅向上、マルチモーダル能力の強化、そしてPreserve Thinkingによる推論継続性です。それぞれを詳しく解説していきます。

エージェンティックコーディング性能

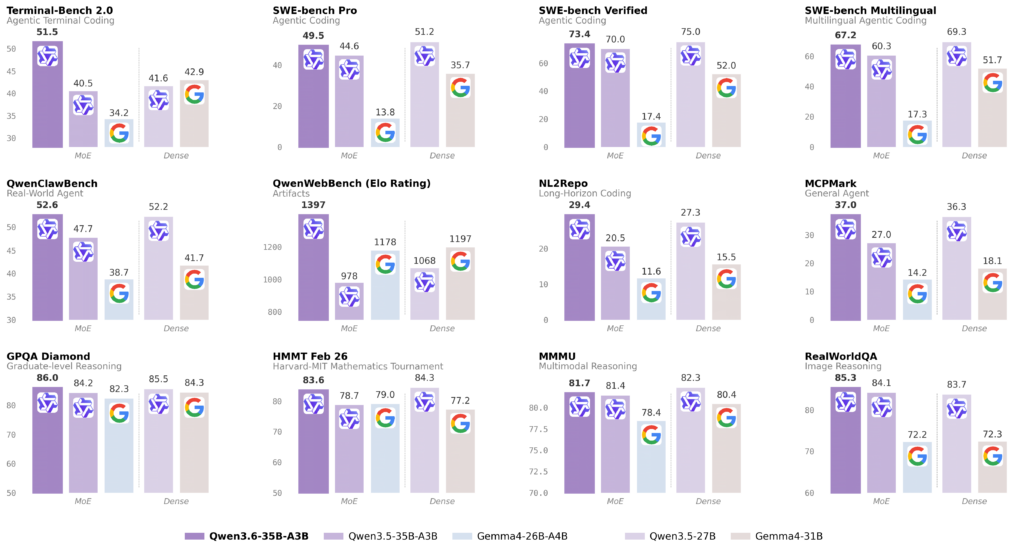

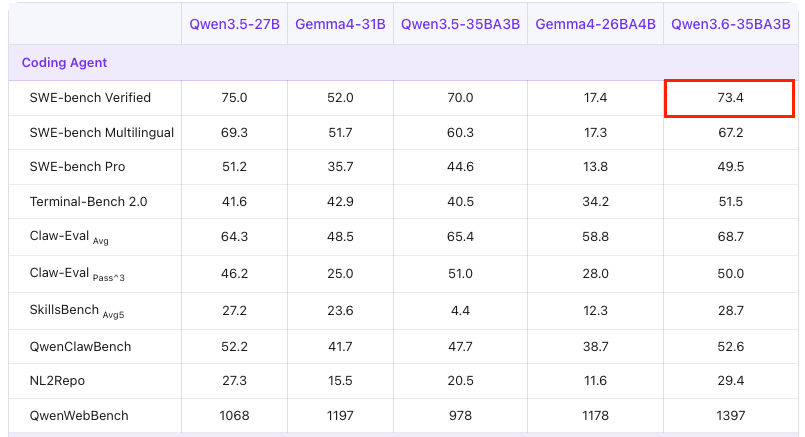

最も際立つ特徴は、3Bというアクティブパラメータで27Bクラスのデンスモデルに匹敵するコーディング性能です。

SWE-bench Verifiedでは73.4を記録し、Qwen3.5-35B-A3Bの70.0から大幅な改善を達成。Terminal-Bench 2.0では全比較モデル中トップの51.5を記録するなど、エージェンティックなコーディングタスクで高い性能を示しています。

マルチモーダル能力と空間知能

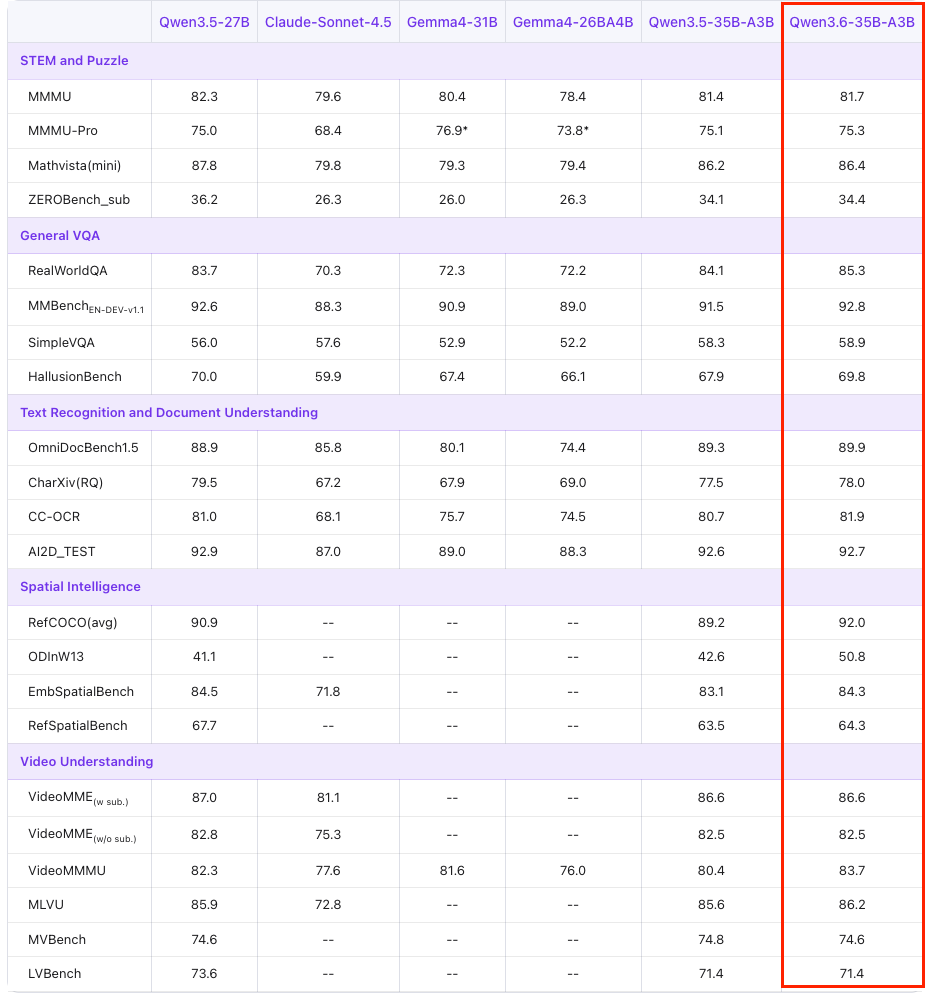

Qwen3.6-35B-A3Bはテキストだけでなく、画像・動画にも対応したマルチモーダルモデルです。

ビジョン言語ベンチマークでは、3Bのアクティブパラメータという制約を超えた高い性能が示されています。

特に注目すべきは空間知能の分野で、RefCOCO(平均)では92.0、ODInW13では50.8を記録しており、いずれも比較モデルの中で最高スコアです。

RealWorldQAでは85.3を記録し、Claude Sonnet 4.5の70.3を大きく上回っています。ドキュメント理解やグラフ読み取りでも高い水準にあり、多様なビジョンタスクへの対応力があります。

Preserve Thinking(推論コンテキスト保持)

Qwen3.6-35B-A3Bが新たに導入したPreserve Thinking機能は、エージェンティックタスクにとって重要な改善点です。

従来のモデルでは、マルチターンの対話において最新のターンの推論コンテキストのみが保持されていました。Preserve Thinking機能を有効にすると、過去のターンで生成された推論トレースを次のターンに引き継ぐことができます。

この機能により、エージェントが複雑なタスクを段階的に遂行する際の意思決定一貫性が向上。重複した推論を最小化できるため、トークン消費量の削減にもつながります。エージェンティックタスクでの利用には特にこの機能の活用が推奨されています。

OpenAIが防御専門家向けに開発したGPT-5.4-Cyberについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-35B-A3Bの安全性・制約

Qwen3.6-35B-A3Bを利用する際に把握しておくべき制約と推奨設定を整理します。

| 項目 | 内容 |

|---|---|

| シンキングモードのデフォルト | デフォルトでシンキングモードが有効。非シンキングモードに切り替える場合はAPIパラメータで設定が必要 |

| /think・/nothinkコマンド | Qwen3.5で提供されていたソフトスイッチ(/think、/nothink)は非サポート |

| 推奨コンテキスト長 | シンキング能力を維持するため、128Kトークン以上の設定を推奨 |

| 本番環境のサービング | 高負荷環境ではSGLang・KTransformers・vLLMなど専用エンジンの利用を推奨 |

| フレームワーク推奨バージョン | SGLang v0.5.10以上、vLLM v0.19.0以上 |

| ライセンス | Apache-2.0 |

Qwen3.6-35B-A3Bを利用する際に把握しておくべき制約と推奨設定を整理します。

| 項目 | 内容 |

|---|---|

| シンキングモードのデフォルト | デフォルトでシンキングモードが有効。非シンキングモードに切り替える場合はAPIパラメータで設定が必要 |

| /think・/nothinkコマンド | Qwen3.5で提供されていたソフトスイッチ(/think、/nothink)は非サポート |

| 推奨コンテキスト長 | シンキング能力を維持するため、128Kトークン以上の設定を推奨 |

| 本番環境のサービング | 高負荷環境ではSGLang・KTransformers・vLLMなど専用エンジンの利用を推奨 |

| フレームワーク推奨バージョン | SGLang v0.5.10以上、vLLM v0.19.0以上 |

| ライセンス | Apache-2.0 |

Hugging Face Transformersは軽量なサーバーとしてクイックテストや中程度の負荷に向いています。

一方で、本番環境や高頻度なリクエストを処理するケースでは、より効率的な推論基盤の導入が求められます。SGLangやvLLMといった専用のサービングエンジンを利用することで、スループットの向上やレイテンシの低減が期待できるでしょう。

特に、エージェント的なコーディングタスクのように複数ステップの推論を繰り返す場合には、こうした最適化された実行環境の有無がパフォーマンスに大きく影響します。

Qwen3.6-35B-A3Bの料金

Qwen3.6-35B-A3Bの利用形態は大きく2つに分かれています。

一方はオープンウェイトとしての自己ホスティング、もう一方はAlibaba Cloud Model Studio APIを通じたクラウド利用です。

オープンウェイトとして公開されているため、自前のサーバーやクラウド環境で自己ホスティングする場合は無料で利用できます。

Qwen3.6-35B-A3Bのライセンス

Qwen3.6-35B-A3BはApache-2.0ライセンスのもとで公開されています。Apache-2.0は商用利用・配布・改変・私的利用いずれも許可する、オープンソースの世界で広く採用されているライセンスです。

| 利用区分 | 可否 |

|---|---|

| 商用利用 | ⭕️ |

| 私的利用 | ⭕️ |

| 改変 | ⭕️ |

| 再配布 | ⭕️ |

| 特許利用 | ⭕️ |

一方で、Apache-2.0ライセンスでは、ソースコードの改変・再配布時に著作権表示とライセンス文の記載が求められます。

Metaが発表したパーソナル超知性AIであるMuse Sparkについて、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-35B-A3Bの使い方

Qwen3.6-35B-A3Bは複数の方法で利用できます。最も手軽なのはQwen Studioでの利用ですが、自動化や本格的な開発にはAPIや自己ホスティングが適しています。

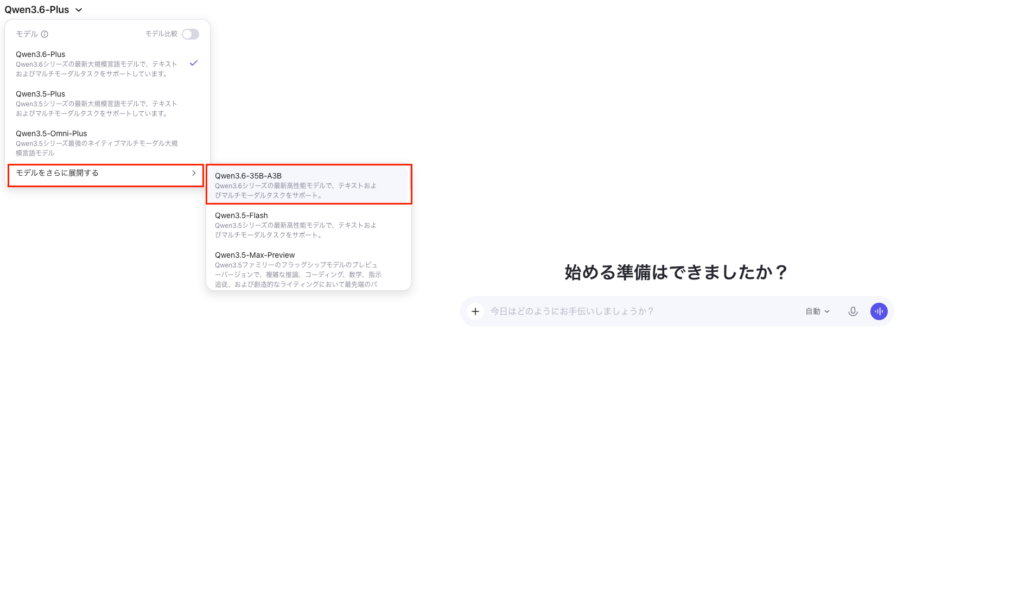

Qwen Studioでの使い方

Web・iOS・Android・macOS・Windowsに対応したQwen Studioから、チャット経由で試すことができます。コードを書かずにモデルの能力を確認したい場合に向いています。

モデル選択

使用する際には、「モデルをさらに展開する」を選択して、Qwen3.6-35B-A3Bを選んでください。

入力と結果の確認

実際に使ってみます。今回は「Qwen3.6-35B-A3Bって何が得意なの?」と質問をします。

回答はこちら

ご質問ありがとうございます。

「Qwen3.6-35B-A3B」というモデル名についてですが、これはアリババクローンの研究機関であるTongyi Labが公開している大規模言語モデル「Qwen(通義千問)」シリーズの一部であり、特に**混合専門家モデル(MoE: Mixture of Experts)**アーキテクチャを採用したバージョンであると推測されます。

この命名規則から読み取れるそのモデルが**「得意なこと(強み)」**は、主に以下の3点に集約されます。

### 1. 「軽さ」と「賢さ」の驚くべきバランス(高効率)

このモデルの最大の特徴は、**350億パラメータ(全体容量)のうち、実際に処理に使われるのは30億パラメータのみ(Active: A3B)**という構造にあります。

* **得意なこと:** **高い知能を維持しながら、非常に高速に動作すること。**

* 通常の350億パラメータ級モデルのように重たくならずに、30億パラメータ級のモデルのような低いメモリ使用量と計算コストで動作します。

* 「賢い(知識豊富)」かつ「軽い(応答が速い)」という、商用利用や実装において究極的に求められている特性を持っています。

### 2. コンシューマー向けGPUでのスムーズな運用

従来の350億パラメータ級のモデルは動かすのに高価なデータセンター向けのGPUが必要でしたが、この「A3B(Active 3B)」設計により、環境への負荷が劇的に下がります。

* **得意なこと:** **ローカル環境やエッジデバイスでのリッチなAI活用。**

* 一般的なビデオカード(VRAM 8GB〜16GBなど)でも容易に稼働・チューニングが可能になります。

* これにより、個人の開発者や中小企業であっても、プライベートな巨大言語モデルを自分のサーバーで運営することが得意分野です。

### 3. Qwenシリーズ本領:コーディングと複雑なタスク処理

ここまでの技術的な効率性に加え、ベースとなったQwen3.xシリーズ本来の能力を活かしています。

* **得意なこと:** **プログラミング支援と論理的思考。**

* コーディング生成、デバッグ、数学的推論などに非常に強く、複雑な指示を正確にステップバイステップで処理します。

* また、Qwenシリーズ特有の多言語理解力(日本語を含む)にも優れており、翻訳や要約などの自然言語処理タスクでも高い精度を発揮します。

---

### まとめ

**「Qwen3.6-35B-A3B」が得意なのは、「限られた計算資源の中で、できるだけ賢く、そして最も素早く回答を導き出すこと」**です。

もしこれを導入あるいは使用するシチュエーションがあるのであれば、

* 「レスポンス速度を犠牲にしたくないチャットボット」

* 「高いCPU/GPUコストを抑えたいバックグラウンド処理」

* 「個人PCでも重い処理を回したいエージェント型アプリ」

といった用途において、非常に強力なパートナーとなるでしょう。モデル名からどういうことが得意なのかを考えてくれました。この結果を読むと、Qwen3.6-35B-A3Bは高性能GPUやメモリを多く積んでいないデバイスでも使用できそうです。

コーディングエージェントツールとの連携

Qwen3.6-35B-A3Bは主要なコーディングエージェントとシームレスに連携できます。

OpenClaw(旧Moltbot / Clawdbot)、Claude Code、Qwen Codeの3つが公式に対応。Claude Codeと連携する場合は、以下の環境変数を設定するだけで利用が始められます。

| 項目 | 値 |

|---|---|

| ANTHROPIC_MODEL | qwen3.6-flash |

| ANTHROPIC_BASE_URL | https://dashscope-intl.aliyuncs.com/apps/anthropic |

| ANTHROPIC_AUTH_TOKEN | 取得したAPIキー |

Anthropic最強AIであるClaude Mythos Previewについて、詳しく知りたい方は以下の記事も参考にしてみてください。

【業界別】Qwen3.6-35B-A3Bの活用シーン

Qwen3.6-35B-A3Bの高いコーディング能力とマルチモーダル対応は、さまざまな業界での活用が期待されます。ここではそれぞれの業界でどのような活用ができるかを考えていきます。

ソフトウェア開発・スタートアップ

エージェンティックコーディングに特化したモデルであるため、ソフトウェア開発の現場との相性は抜群と考えられます。

リポジトリ全体を理解した上でのコード修正や、フロントエンドコード生成で高いスコアを記録。SWE-bench Multilingualの高スコアは多言語コードベースへの対応力を示しており、グローバルなプロジェクトにも活用できます。

生成AIを使った開発環境と手法について、詳しく知りたい方は以下の記事も参考にしてみてください。

リサーチ・文書処理・金融

OmniDocBench1.5やCharXivの高スコアが示すように、複雑なドキュメントやグラフ・チャートの読み取りに優れています。

研究論文の解析や財務報告書の処理など、高度な文書理解が求められる業務への活用が期待できるでしょう。

GPQAという大学院レベルの推論ベンチマークでも高い評価を得ており、専門的な知識が必要なリサーチ支援にも対応可能。

金融業界のDX化について、詳しく知りたい方は以下の記事も参考にしてみてください。

製造・物流・空間データ処理

空間知能の高さは、製造ラインの画像認識や物体検出などへの応用もできるのではないでしょうか。オープンソースモデルでこのレベルの空間認識能力を持つものは限られており、自社環境で運用できる点は大きな強みとなります。

製造業界の課題を生成AIで解決する方法について、詳しく知りたい方は以下の記事も参考にしてみてください。

教育・Eラーニング

HMMTやAIME26などの数学的推論ベンチマークで高い性能を示しており、数学教育支援や問題解説への活用が考えられます。多言語対応により、さまざまな言語での教育コンテンツ生成にも可能性があります。

ChatGPTは学校教育に活用する方法について、詳しく知りたい方は以下の記事も参考にしてみてください。

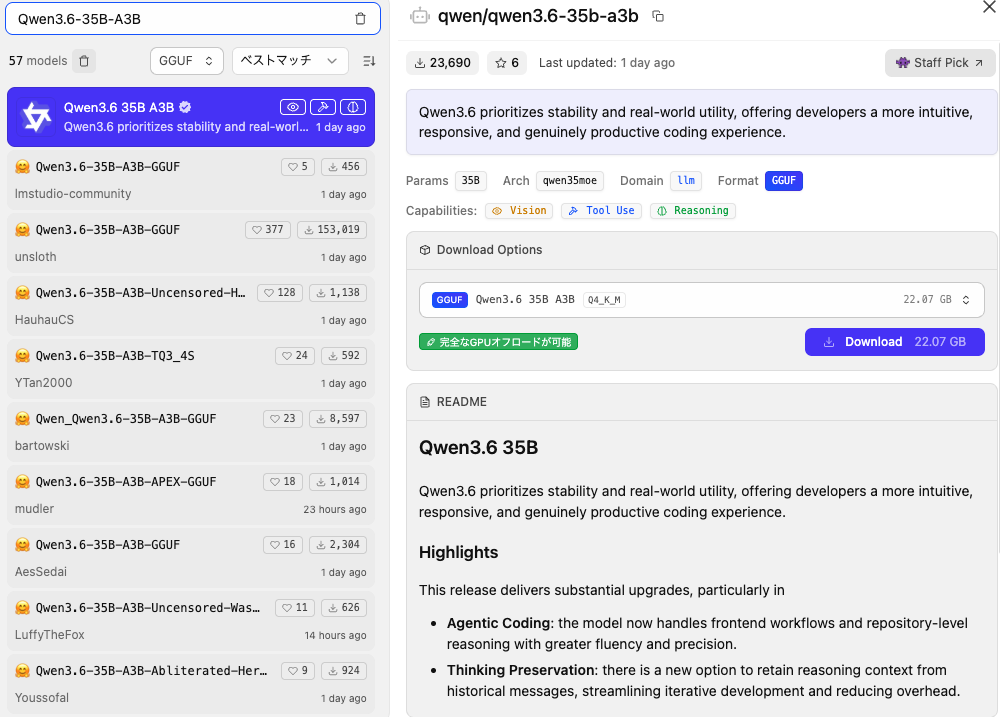

Qwen3.6-35B-A3Bを実際に使ってみた

使い方ではQwen Studioで使用をしてみましたが、ここではLM StudioにQwen3.6-35B-A3Bをダウンロードして使ってみたいと思います。

先ほどと同じように「Qwen3.6-35B-A3Bって何が得意なの?」と聞いてみます。

結果はこちら

結論:「Qwen3.6-35B-A3B」は現状の公式リリースに存在しないモデル名です。もし35B級テキストモデル(Qwen2.5-32B/72Bや他社30B級モデル)を指す場合は、実務向けバランスモデルとして「コード生成・論理推論・長文コンテキスト処理・日本語対応」が得意です。

理由:

- **命名と公式情報の不一致**:Alibaba CloudのTongyi Labが公開するQwenシリーズは「Qwen2.5-7B/14B/32B/72B/110B」が最新です。「3.6」「A3B」は公式論文・Hugging Face・ModelScopeのモデルカードに記録されていません。命名規則から推測すると、32B級ベースモデルに3BパラメータのLoRA/Adapterを積んだファインチューニング版、または非公式量化版の可能性が高いです。

- **30B〜40B級モデルの設計意図**:20B級より推論精度が高く、70B級よりリソース消費が少ないため、実装・運用コストと性能のバランスを取るために設計されています。得意領域は以下の通りです:

- コード生成・デバッグ・SQL変換

- 数学・論理推論・数値計算

- 32K〜128Kトークンの長文コンテキスト維持

- 日本語・中国語の言語理解と文体制御

- 専門ドメイン適応(医療・法規制・技術文書)※ベースモデル+ファインチューニング前提

- **実装・運用上の制約**:

- 推論リソース:4bit量子化(AWQ/bitsandbytes)で24GB VRAM(RTX 4090相当)、FP16で48GB以上必要

- スループット:vLLMまたはSGLangでバッチ処理可能。RAGパイプラインやデータ前処理に組み込みやすい

- 非得意:マルチモーダル処理(画像/音声/動画)はQwen2.5-VLシリーズが担当。テキスト専用モデルに画像入力するとエラーまたは精度劣化が発生

具体例・実装案:

- 医療文書要約・RAG連携の場合:`Qwen2.5-32B-Instruct` をvLLMで4bit量子化し、LangChain/LlamaIndex経由で電子カルテ/PDFから抽出したチャンクを埋め込み(BGE-m3等)→ retriever → Qwenで回答生成。24GB VRAM環境で実用レベルのレイテンシ(2〜5秒/クエリ)を達成可能。

- A3BがLoRA/Adapter(Active 3B)を指す場合:ベースモデル(Qwen2.5-32B)とLoRAウェイトを並行ロードし、医療データでパラメータ効率的ファインチューニング(QLoRA)後、vLLMの`--gpu-memory-utilization 0.9`でデプロイ。推論メモリ増加は約2〜4GB/LoRAモジュール。

不確実性:モデル名の正確なアーキテクチャ・ベンチマーク値・サポート言語・ライセンスは公式発表がないため推測になります。正確な用途適合のためには、Hugging Face/ModelScopeのモデルカードまたは開発者への仕様確認を推奨します。Qwen Studioの時とは異なり、「存在しないモデル名」と言われてしまいました。ローカルでは4bit量子化を使っている影響かもしれません。なお、出力は46.98トークン/秒という結果でした。

【課題別】Qwen3.6-35B-A3Bが解決できること

ここではQwen3.6-35B-A3Bが解決できる代表的な課題を紹介します。Qwen3.6-35B-A3Bが解決できることを理解できると、使い道も定まってきます。

コーディングコストを抑えながら高品質なコードを生成できる

オープンウェイトとして公開されているため、自己ホスティングによるコスト削減が可能です。

3Bのアクティブパラメータという軽量設計により、高価なGPUリソースへの依存を抑えながらも、より大きなデンスモデルに匹敵するコーディング性能を発揮。

複雑な多段階エージェントタスクを一貫して処理できる

Preserve Thinking機能により、複数ターンにわたるエージェント処理で推論コンテキストが引き継がれます。

長い開発タスクやデバッグセッションで同じ前提条件を何度も伝え直す手間がなくなり、一貫した意思決定のもとで作業を進めることが可能です。

テキストと画像・動画を組み合わせた情報処理ができる

テキストのみならず、画像や動画の処理にも対応しています。

ドキュメント内の図表を解析したり、UIのスクリーンショットをもとにコードを生成したりといった、マルチモーダルなタスクを一つのモデルで完結できます。

既存のOpenAIとAnthropicベースのワークフローに組み込める

Alibaba Cloud Model StudioはOpenAI互換APIとAnthropicプロトコルの両方をサポートしています。既存のSDKや開発ツールを大きく変更することなく、Qwen3.6-35B-A3Bへの切り替えが可能です。

スマートフォンでも動作するGoogleの最強オープンモデルであるGemma 4について、詳しく知りたい方は以下の記事も参考にしてみてください。

Qwen3.6-35B-A3Bの活用事例

ここではXをリサーチしてQwen3.6-35B-A3Bを活用している事例をいくつか紹介していきます。

バグの発見

こちらの投稿ではQwen3.6-35B-A3Bを使ってバグの発見を行なっていました。なお、バグの特定だけでなく、再現手順の提示、修正コードの生成、テストの追加、さらにはPR文の作成までを一貫して実行しています。

ゲーム作成

こちらの投稿ではブロック崩しのゲームを作成されていました。投稿者の方は、過去最高の出来になったと述べており、Qwen3.6-35B-A3Bの性能の高さが伺えます。

こちらの方もゲームを作成されています。

バグの修正やゲーム作成などの活用事例からも分かるように、Qwen3.6-35B-A3Bはコーディングの性能が高く、コーディング用途での活用が進みそうです。

Qwen3.6-35B-A3Bのよくある質問

ここではQwen3.6-35B-A3Bのよくある質問に回答していきます。実際に使用する前に参考にしてみてください。

Qwen3.6-35B-A3Bでエージェンティック開発を加速しよう

Qwen3.6-35B-A3Bは、MoEアーキテクチャによって3Bのアクティブパラメータで高いコーディング性能を実現した、注目度の高いオープンウェイトLLMです。

特に、エージェンティックコーディングを見据えてオープンソースモデルを検討しているエンジニアやプロダクトチームにとって、選択肢の1つといえるでしょう。

自己ホスティングによるコスト最適化と高性能を両立しやすい点は、大きな魅力です。

今後は、関連ツールとの連携強化や量子化・実装環境の整備が進むことで、さらに導入しやすくなる可能性があります。

これから利用を検討する場合は、まずは自社の用途がコーディング支援、マルチモーダル処理、エージェント運用のどこにあるのかを明確にしたうえで、小規模な検証から適性を見極めていくのがよいでしょう。

最後に

いかがだったでしょうか?

Qwen3.6-35B-A3Bを活用することで、エージェンティックコーディングや多言語・マルチモーダルなタスク処理を低コストで実現し、業務効率化の大幅な向上が期待できます。一方で、AIモデルの導入や業務への組み込みは設計次第で効果が大きく変わるため、実装経験のあるパートナーと進めることも重要な選択肢です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。