【GLM-5V-Turbo】入力画像を直接解釈?ビジョン×コーディング特化型マルチモーダルモデルを徹底解説!

- GLM-5V-Turboは、中国発のビジョン×コーディング特化型マルチモーダル基盤モデル

- デザインカンプやUI画面のスクリーンショットを入力として受け取ると、レイアウト構造・配色・コンポーネント階層・インタラクションロジックを直接解釈可能

- OpenClawやClaude Codeといったエージェントフレームワークとの連携に深く最適化

2026年4月2日、中国の大手AI企業であるZ.aiが、ビジョン×コーディングに特化したマルチモーダル基盤モデル「GLM-5V-Turbo」を公開しました!

このモデルは、画像やデザインカンプを読み取り、そのままフロントエンドのコードを生成するという、いわば見たものをそのままコードに変換する能力を備えています。

エージェント駆動型のワークフローにも最適化されており、OpenClawやClaude Codeとの連携も想定して設計されているようです。

そこで本記事では、GLM-5V-Turboの概要から仕組み、料金、具体的な使い方までを徹底的に解説していきます。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

GLM-5V-Turboとは?

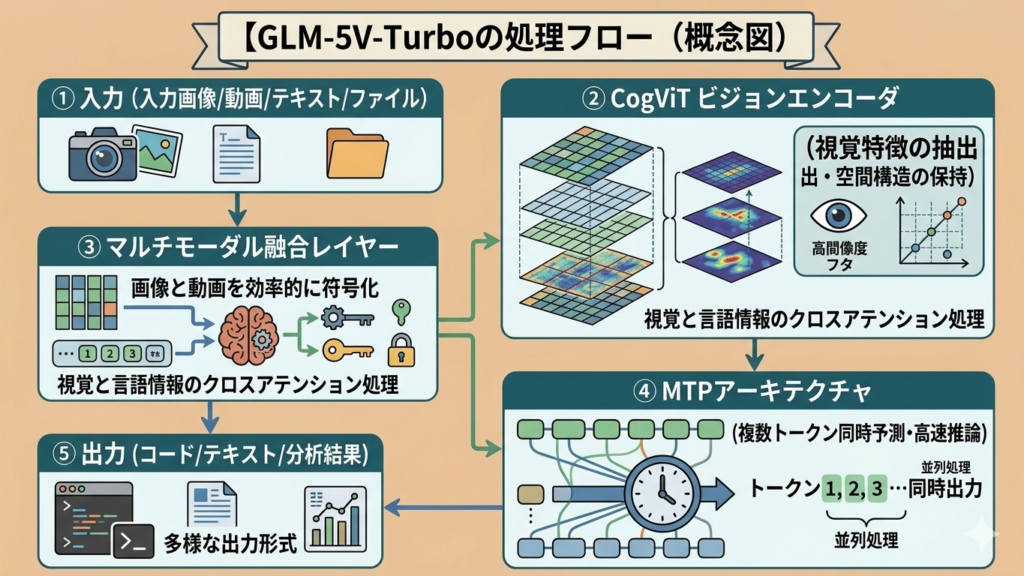

GLM-5V-Turboは、Z.aiが開発した初のネイティブマルチモーダルコーディング基盤モデルです。ネイティブマルチモーダルとは、画像・動画・テキスト・ファイルといった複数の入力形式を、中間的なテキスト変換を介さずに直接理解できることを意味しています。

従来のビジョン言語モデルでは、画像を一度テキストで説明してからコードを生成するという二段階のプロセスが一般的でした。GLM-5V-Turboはこの課題を解消し、デザインカンプやUI画面のスクリーンショットを入力として受け取ると、レイアウト構造・配色・コンポーネント階層・インタラクションロジックを直接解釈し、実行可能なフロントエンドプロジェクトを丸ごと出力することができます。

コンテキストウィンドウは約200Kトークンに対応し、最大出力は約128Kトークンと、リポジトリ規模の大規模タスクにも耐えうる設計となっています。

さらに、OpenClawやClaude Codeといったエージェントフレームワークとの連携に深く最適化されており、環境を認識して計画を立て、タスクを実行するといった一連のループを自律的に回すことが可能です。

GLM-5V-Turboの仕組み

GLM-5V-Turboの技術的な仕組みとしては、アーキテクチャ・学習手法・推論最適化の3つの柱で構成されています。

まず、視覚入力の処理を担うのが「CogViT」と呼ばれる新しいビジョンエンコーダです。CogViTは、画像や動画の空間的な階層構造や細かいビジュアルディテールを保持したまま特徴量を抽出する役割を果たします。これによって、デザインカンプの微妙なレイアウトの違いやアイコンの配置関係まで正確に把握できるようになっています。

次に、推論の効率を高めるために採用されているのが「MTP(Multi-Token Prediction)」アーキテクチャです。これは複数のトークンを同時に予測することで、推論速度と精度のバランスを改善する手法です。さらに、INT8量子化による推論高速化も実装されています。

学習手法としては「30以上のタスクによる同時強化学習(Joint RL)」が特徴となっています。STEM問題、グラウンディング、動画理解、エージェントタスクなど30種類以上の異なるタスクを同時に最適化することで、ビジョン言語モデルでよく起きるシーソー効果、つまりある能力を高めると別の能力が低下してしまう現象を抑制しています。

GLM-5V-Turboの特徴

GLM-5V-Turboの最大の強みは、デザインからコードへの変換精度において業界トップクラスの性能を有している点です。

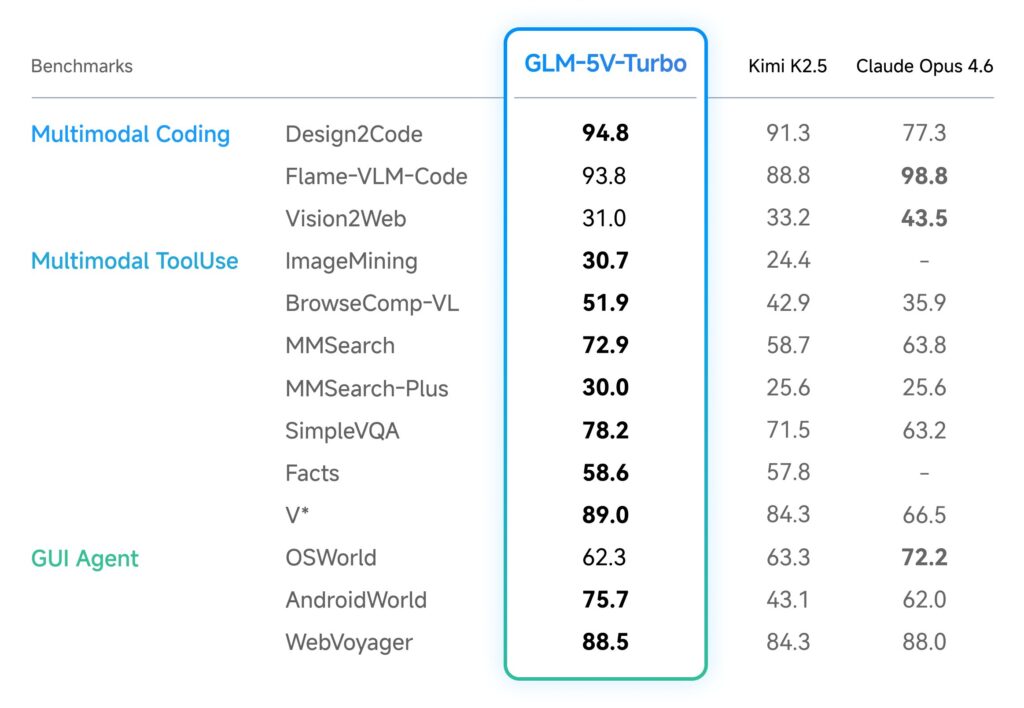

Design2Codeベンチマークでは94.8を記録し、Claude Opus 4.6の77.3を大きく上回っています。ワイヤーフレームからは構造と機能を再構築し、高精度デザインカンプからはピクセルレベルの視覚的一貫性を目指したコード生成が可能です。

GUIエージェントとしての性能も高評価です。実際のGUI環境での制御能力を測るAndroidWorldやWebVoyagerといったベンチマークでもトップクラスの性能を誇っており、画面を見て理解し、自律的に操作するというエージェント的な振る舞いにおいて高い実力があることが分かります。

GLM-5V-Turboの安全性・制約

GLM-5V-Turboは98%のタスク成功率を記録しており、技術的な安定性は高い水準にあります。ハルシネーション、一般知識、倫理の各ベンチマークで100%の正確性を達成している点も、安全性を裏付ける材料といえます。

一方で、制約もありまして、純粋なテキストベースのコーディング、たとえばバックエンドの実装やリポジトリ全体の探索といったタスクでは、Claudeなど他のモデルに対して優位性があるとは言い切れません。

GLM-5V-Turboの料金

GLM-5V-TurboのAPI料金は、大手モデルと比較してもリーズナブルな水準に設定されています。特にビジョン×コーディングという専門領域でこの価格帯は、開発者にとって導入しやすいポイントといえるでしょう。

| 項目 | 料金 |

|---|---|

| 入力トークン | $1.20 / 100万トークン |

| 出力トークン | $4.00 / 100万トークン |

| キャッシュ読み取り | $0.24 / 100万トークン |

| コンテキストウィンドウ | 202,752トークン |

| 最大出力トークン | 131,072トークン |

なお、chat.z.aiのWebインターフェースでは無料で利用することも可能です。また、Z.aiはGLM Coding Planという月額サブスクリプションプランも提供しており、GLM-5V-Turboを含む複数モデルをまとめて利用できます。キャッシュ読み取りが入力トークンの5分の1の価格に設定されているため、長い会話や繰り返しのリクエストではコスト最適化が見込めます。

GLM-5V-Turboのライセンス

GLM-5V-Turboは、GLM-5(MITライセンスのオープンソース)とは異なり、クローズドソースモデルとして提供されています。

| 項目 | 可否 |

|---|---|

| 商用利用 | ⭕️ |

| モデルの改変 | ❌️ |

| 再配布 | ❌️ |

| 特許利用 | Z.aiの利用規約に準拠 |

| 私的利用 | ⭕️ |

GLM-5V-Turboを業務で利用する場合は、Z.aiのAPI利用規約に従う形になります。モデルの重みをダウンロードして自社サーバーでホスティングしたり、改変したりすることはできません。

GLM-5V-Turboの使い方

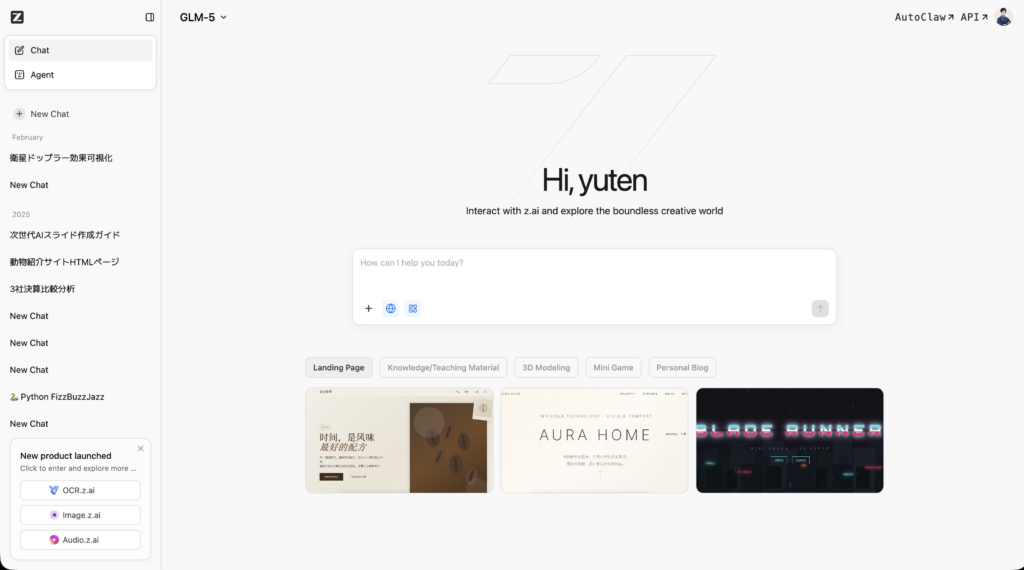

GLM-5V-Turboを試すには、大きく分けてWebインターフェース(chat.z.ai)を使う方法と、APIを直接呼び出す方法の2通りがあります。それぞれの手順をご紹介します。

chat.z.aiで試す

まず、ブラウザで https://chat.z.ai/ を開きます。Z.aiのアカウントをお持ちでない場合は、新規登録を行ってください。

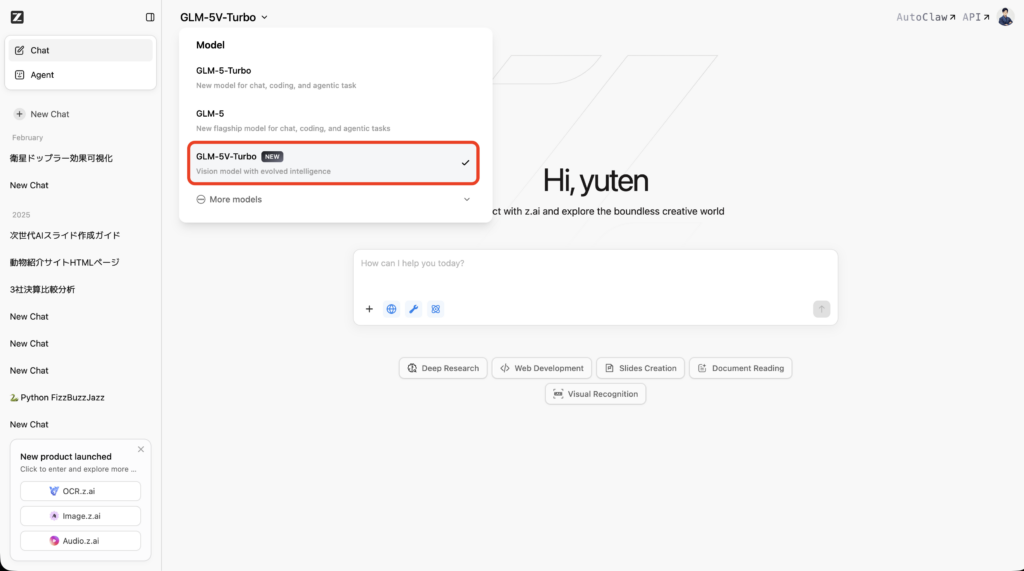

チャット画面上部のモデル選択メニューから「GLM-5V-Turbo」を選択します。

あとは、画像やデザインカンプをアップロードして質問するだけです。

たとえば、UIデザインのスクリーンショットを添付し、「この画面をHTML/CSSで再現してください」と入力して送信すると、GLM-5V-Turboがデザインを解析してコードを生成してくれるかと思います。

Python SDKで利用する

SDKをインストールする

pip install zai-sdkバージョン0.0.4以上が必要です。

コードを実行する

以下のPythonコードで、画像を入力としてGLM-5V-Turboを呼び出すことができます。

クリックで表示

from zai import ZaiClient

client = ZaiClient(api_key="your-api-key")

response = client.chat.completions.create(

model="glm-5v-turbo",

messages=[

{

"role": "user",

"content": [

{

"type": "image_url",

"image_url": {"url": "https://example.com/design-mockup.png"}

},

{

"type": "text",

"text": "このデザインカンプをHTML/CSSで再現してください"

}

]

}

],

thinking={"type": "enabled"}

)

print(response.choices[0].message.content)cURLで直接APIを呼び出す

クリックで表示

curl -X POST https://api.z.ai/api/paas/v4/chat/completions \

-H "Authorization: Bearer YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "glm-5v-turbo",

"messages": [

{

"role": "user",

"content": [

{"type": "image_url", "image_url": {"url": "IMAGE_URL"}},

{"type": "text", "text": "このUIをReactコンポーネントに変換してください"}

]

}

]

}'エンドポイントは https://api.z.ai/api/paas/v4/chat/completions 、モデルIDは glm-5v-turbo です。Java SDK(Maven/Gradle経由で ai.z.openapi:zai-sdk:0.3.0)も利用可能です。

【業界別】GLM-5V-Turboの活用シーン

GLM-5V-Turboは、見たものをコードに変換するという独自の強みを持つため、特定の業界やユースケースで活用することができます。代表的な活用シーンを業界別に確認していきましょう。

Web制作・フロントエンド開発

Web制作やフロントエンド開発において、デザイナーが作成したFigmaやSketchのカンプを直接入力し、HTML/CSS/Reactなどのコードを自動生成するような用途に最適です。

デザインと実装のギャップを埋め、フロントエンドエンジニアの工数を大幅に削減することができます。

生成AIを搭載したSaaSについて、詳しく知りたい方は以下の記事も参考にしてみてください。

モバイルアプリ開発・QA

GLM-5V-Turboは、AndroidWorldベンチマークでの高スコアが示している通り、モバイルアプリ画面の自動操作やUIテストの自動化に活用できます。

画面遷移の検証やバグのスクリーンショットからの問題特定など、QAプロセスの効率化が期待できます。

教育・研究機関

教育業界においては、マルチモーダルAIの研究素材として、あるいは学生向けのプログラミング教材(デザインからコードを学ぶ教育ツール)としての活用が考えられます。

視覚的な入力からコードへの変換プロセスを可視化できる点は、教育的にも価値があるかと思います。

教育業界における生成AI活用について、詳しく知りたい方は以下の記事も参考にしてみてください。

【課題別】GLM-5V-Turboが解決できること

GLM-5V-Turboは、従来のテキストベースLLMでは対応が難しかった視覚情報とコードの橋渡しといった課題に特化しています。ここからはGLM-5B-Turboが解決できることを課題別に確認していきましょう。

デザインカンプからのコーディング工数の削減

デザイナーとエンジニアの間で発生するデザインの再現という工程は、Web制作において大きなコストを占めています。

そこで、GLM-5V-Turboを使えば、カンプ画像を入力するだけで高精度なフロントエンドコードが得られるため、この工数を短縮することが期待できます。

GUI操作の自動化における精度向上

WebVoyagerやAndroidWorldのベンチマーク結果が示している通り、Webサイトやモバイルアプリのインターフェースを視覚的に認識し、自律的に操作するタスクにおいて高い精度を実現しています。

RPAやテスト自動化の精度に悩んでいる場合は、有力な選択肢になりえます。

マルチモーダル入力への対応不足

画像・動画・テキストを統合的に扱えるモデルは増えていますが、それをコーディングタスクに直結させられるモデルは限られています。

そんな中でGLM-5V-Turboは、視覚入力を中間テキスト変換なしにコードへ直接変換するため、従来のパイプラインで発生していた情報のロスを解消できます。

生成AI導入効果については下記で解説

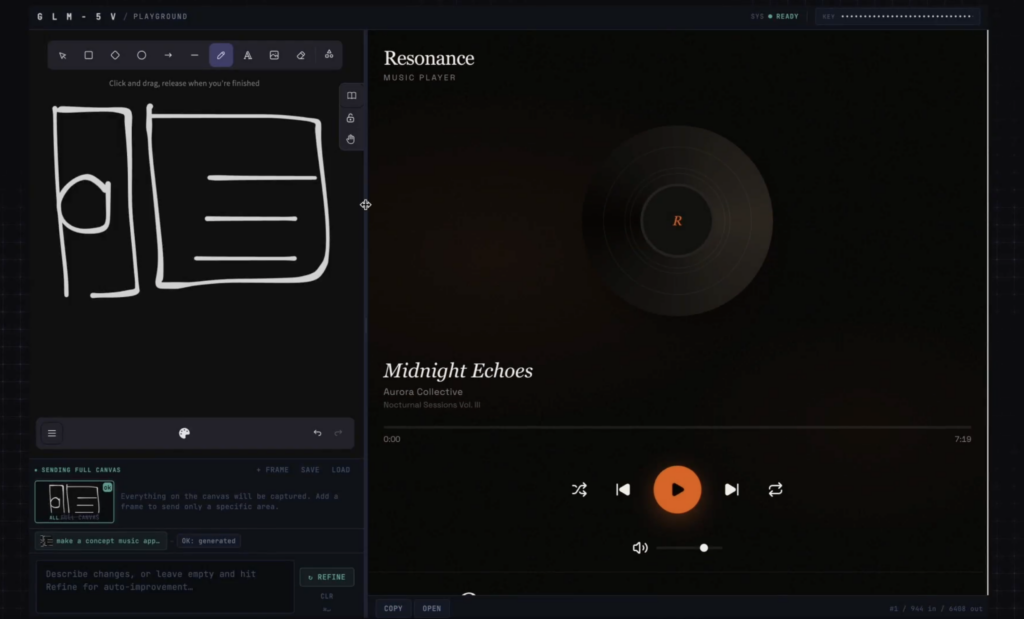

GLM-5V-TurboをChat.Z.ai上で使ってみた

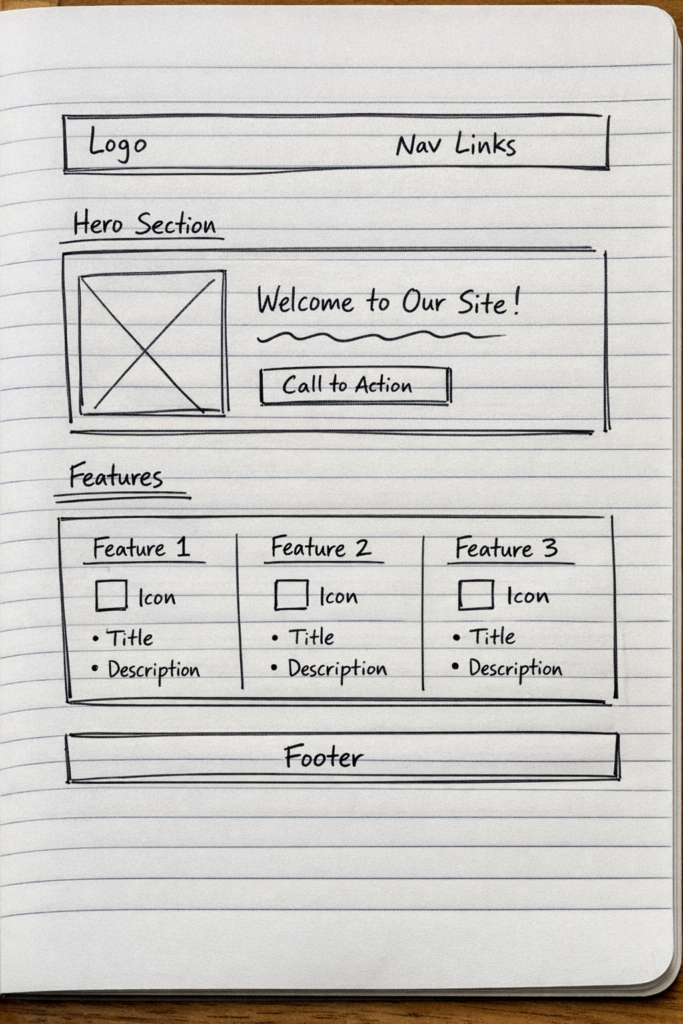

それでは実際に、chat.z.ai上でGLM-5V-Turboを試してみましょう。今回は、手書きのワイヤーフレーム画像からWebページのHTMLコードを生成していきます。

まず、シンプルなランディングページのワイヤーフレームを準備します。今回はChatGPT Imagesを活用してこちらの画像を生成しています。

ヘッダー、ヒーローセクション、3カラムの特徴紹介セクション、フッターという一般的な構成です。

この画像をchat.z.aiにアップロードし、以下のプロンプトを入力しました。

この手書きワイヤーフレームを元に、モダンなランディングページのHTMLとCSSを生成してください。レスポンシブ対応でお願いします。出力結果はこちら

よくある質問

最後に、GLM-5V-Turboに関して、多くの方が気になるであろう質問とその回答をご紹介します。

GLM-5V-Turboに期待大!

GLM-5V-Turboは、デザインを見てコードを書くというビジョン×コーディング領域において、2026年4月時点で最高水準の性能を持つモデルです。

Design2Codeベンチマーク94.8という圧倒的なスコア、AndroidWorldやWebVoyagerでのGUIエージェント性能、そして200Kトークンの大容量コンテキストウィンドウは、フロントエンド開発やUI自動化の現場に大きなインパクトをもたらす可能性を秘めています。

一方で、バックエンドの純粋なコーディングタスクや構造化文書の生成では他モデルのほうが活躍する場合もあり、あくまでビジョンコーディング特化型という位置づけを理解したうえで活用するのが賢い使い方といえます。

公式チャットページで無料で試すことができますので、気になった方はぜひ一度試してみてください!

最後に

いかがだったでしょうか?

弊社では、AI導入を検討中の企業向けに、業務効率化や新しい価値創出を支援する情報提供・導入支援を行っています。最新のAIを活用し、効率的な業務改善や高度な分析が可能です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。