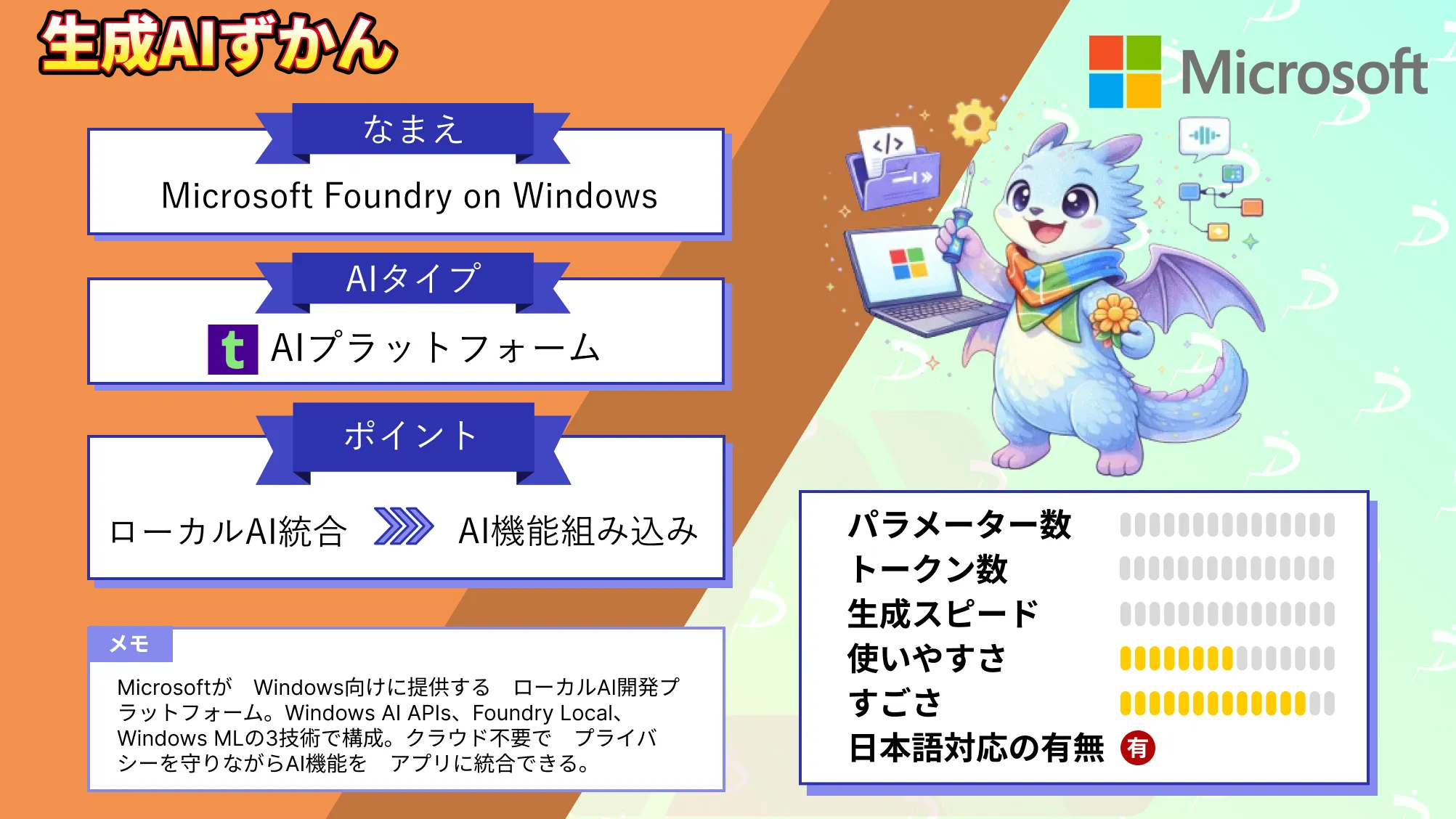

【Microsoft Foundry on Windows】3つの技術でローカルAIをアプリに統合!仕組みから実装までを解説

- Microsoft Foundry on Windowsは、Windows AI APIs・Foundry Local・Windows MLの3技術で、用途に合わせたローカルAI開発ができる

- Azureサブスクリプション不要・無料で利用でき、データをデバイスから外に出さずにAI処理ができる

- OpenAI互換APIとPython/C#/JavaScript SDKに対応し、既存の開発ワークフローにそのまま組み込める

Windowsアプリに生成AIを組み込みたいけれど、クラウドへのデータ送信やAPIコストが気になる、という声は多いのではないでしょうか。Microsoft Foundry on Windowsは、デバイス上でAIモデルを動かすための3つの技術をまとめた開発プラットフォームです。

この記事では、Microsoft Foundry on Windowsの仕組みから3つのメイン機能、料金、実装方法、活用シーンまでくわしく解説します。

\生成AIを活用して業務プロセスを自動化/

Microsoft Foundry on Windowsとは

Microsoft Foundry on Windowsは、Windowsアプリケーションにローカルで動くAI機能を組み込むための開発者向けプラットフォームです。 2026年3月6日時点ではプレビュー版として利用できます。

クラウドにデータを送らずにデバイス上でAIモデルを実行するため、プライバシーの確保やレイテンシを減らしたうえで、クラウドコストの削減もできるというメリットがあります。

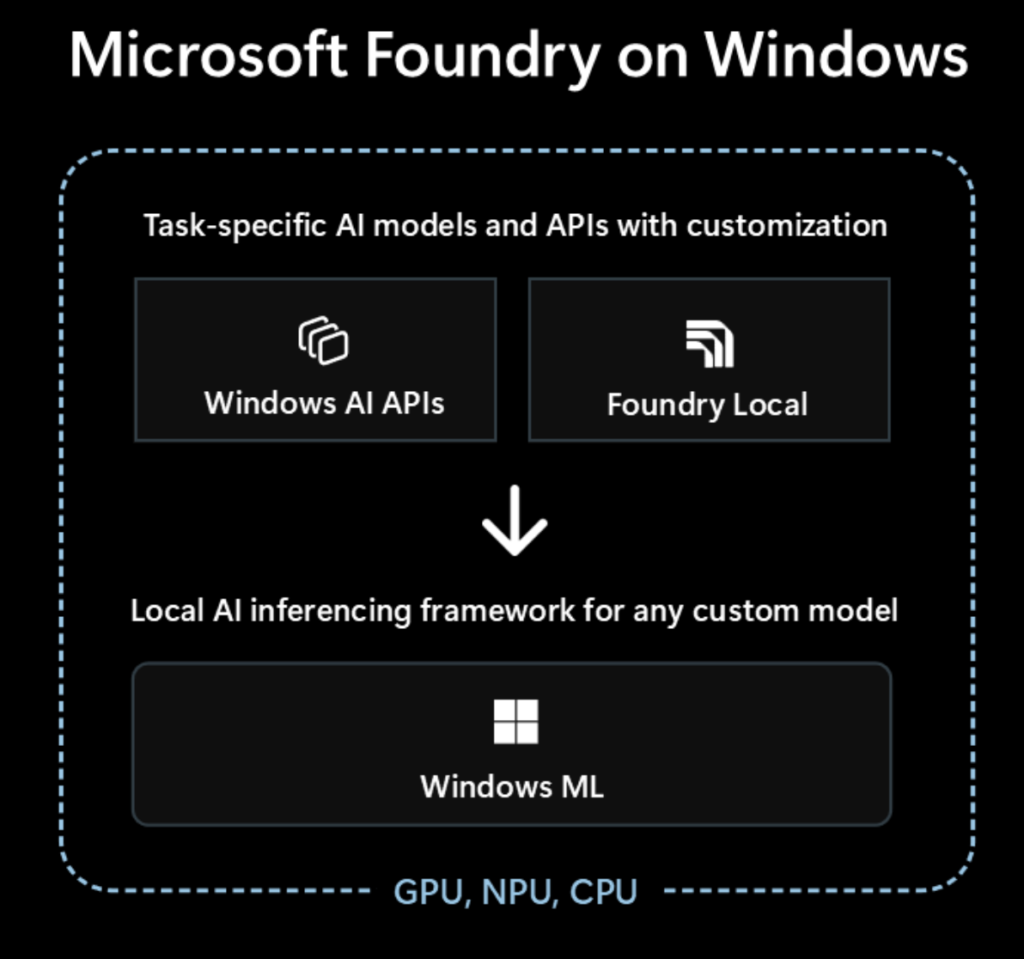

このプラットフォームはWindows AI APIs・Foundry Local・Windows MLという3つの技術で構成されています。それぞれ対象デバイスや用途が異なるため、開発者は自分の要件に合った技術を選ぶか、組み合わせて使えます。

ローカルLLMのように端末上でモデルを動かす手法が注目されるなか、Microsoftとしてその基盤を一つにまとめた取り組みです。

登場の背景

生成AIの活用が各業界に広がるなかで、クラウドベースのAIサービスだけではカバーしにくい要件が増えてきました。「社外に出せない機密データを扱いたい」「オフライン環境でもAIを使いたい」「クラウドの推論コストがサービス規模に合わない」などの要望もあり、ローカルAIへの需要が高まっています。

Microsoftはこうした期待に応えるために、もともと別々に提供していたWindows AI APIs、Foundry Local、Windows MLをMicrosoft Foundry on Windowsという統合ブランドのもとに一本化しました。

開発者はデバイスの種類やタスクの内容に応じて最適な技術を選べるうえ、3つの技術を組み合わせることもできます。NPUとGPUの違いを活かしたハードウェアアクセラレーションにも対応しており、Copilot+ PCのNPUから一般的なGPU、CPUまで幅広いハードウェアで動作します。

これまでとの違い

これまでWindowsでローカルLLMを動かそうとすると、OllamaやLM Studioなどのサードパーティツールに頼る必要がありました。モデルの取得や変換、ハードウェアごとの最適化を開発者が自分で管理しなければならず、手間がかかる作業でした。

しかし、Microsoft Foundry on Windowsは、モデルの配信からハードウェア最適化までをプラットフォーム側が管理する点が大きな利点です。

Windows AI APIsとFoundry Localではモデルをマイクロソフトがホストし、ランタイムで自動取得されるため、開発者がモデルの管理を意識する必要がありません。Windows MLでも実行プロバイダー(EP)の自動ダウンロードに対応しており、ハードウェアの違いをプラットフォームが吸収します。

なお、Microsoft発の画期的なオープンソース音声認識モデルであるVibeVoice-ASRが公開されています。くわしくは下記の記事を合わせてご確認ください。

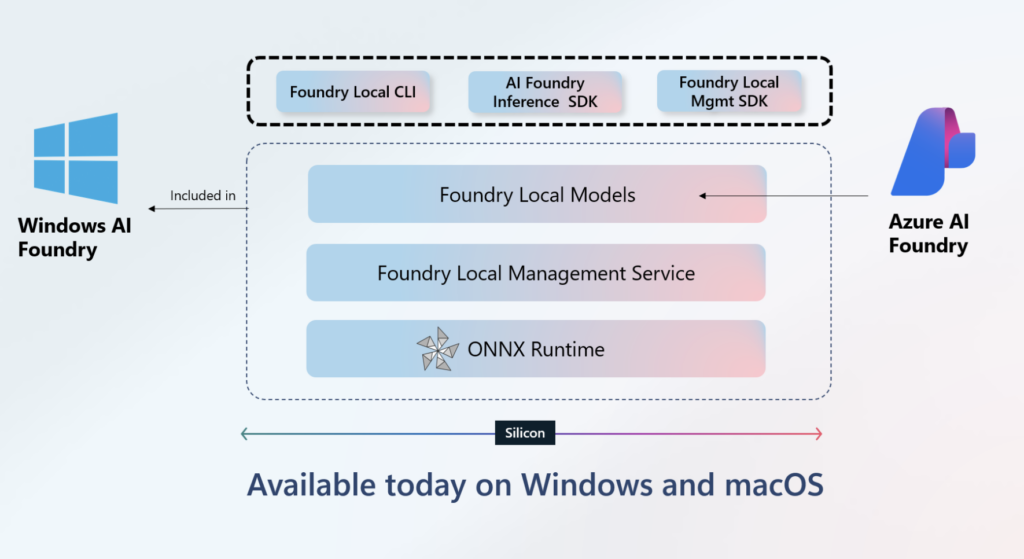

Microsoft Foundry on Windowsの仕組み

Microsoft Foundry on Windowsは、3つの技術がそれぞれ異なるレイヤーで動作し、全体としてローカルAI機能を提供するアーキテクチャになっています。

共通の基盤技術としてONNX Runtimeが使われており、各技術はこの推論エンジンの上に構築されています。ONNX Runtimeは、AIモデルをさまざまな環境で効率よく動かすための推論基盤です。デバイスのCPUやGPU、NPUを自動検出し、使えるハードウェアに応じた最適な実行プロバイダーを選ぶ仕組みです。各レイヤーは独立しつつも連携しており、開発者は用途に応じて組み合わせて使えます。

全体のアーキテクチャ

Microsoft Foundry on Windowsの構成を上位レイヤーから整理すると、以下のようになります。

| レイヤー | 技術 | 役割 |

|---|---|---|

| API層 | Windows AI APIs | 即利用型のAI機能をAPI経由で提供 |

| ランタイム層 | Foundry Local | LLM・音声認識モデルのローカル実行環境 |

| フレームワーク層 | Windows ML | ONNXモデルの汎用推論フレームワーク |

| 実行エンジン | ONNX Runtime | モデル推論のコアエンジン |

| ハードウェア抽象化 | DirectML / 各種EP | CPU・GPU・NPU向けの最適化 |

ハードウェア対応

Microsoft Foundry on Windowsは、幅広いハードウェアに対応するための抽象化レイヤーが実装されています。

Foundry Localの場合、モデルをダウンロードするときにデバイスのハードウェアを自動検出し、NVIDIA GPUがあればCUDA最適化版を、Qualcomm NPUがあればNPU版を、いずれもなければCPU版を取得します。

| ハードウェア | 対応状況 |

|---|---|

| NVIDIA GPU(2000シリーズ以降) | CUDA実行プロバイダー |

| AMD GPU(6000シリーズ以降) | AMD実行プロバイダー |

| Intel iGPU / NPU | Intel実行プロバイダー(NPUはWindows 11 24H2以降) |

| Qualcomm Snapdragon X Elite | Qualcomm NPU実行プロバイダー |

| Apple Silicon(macOS) | Apple Silicon対応(Foundry Localのみ) |

| CPU(x64/ARM64) | CPU実行プロバイダー(すべてのデバイス) |

Microsoft Foundry on Windowsのメイン機能

Microsoft Foundry on Windowsは3つの主要技術で構成されており、それぞれ対象デバイスや利用シーンが異なります。

Foundry Local(LLM・音声認識のローカル実行環境)

Foundry Localは、LLMや音声認識モデルをデバイス上で実行するためのローカル推論環境です。 Azureサブスクリプションは不要で、完全無料で使えます。

Foundry Localの中核はOpenAI互換のRESTサーバーです。foundryというCLIツールでモデルの管理と実行を行い、ローカルに立ち上がるRESTエンドポイントを通じてアプリケーションと連携します。OpenAI SDKをそのまま使えるため、既存のコードをほぼ変更なしにローカル環境に持ってこれます。

利用できるモデルは20種類以上のオープンソースLLMと、Whisperベースの音声認識モデルです。Phiシリーズ、Qwen、GPT-OSSなど幅広いモデルが用意されており、foundry model listコマンドでカタログを確認できます。モデルはデバイスのハードウェアに合わせて最適な自動選択がされます。

| 項目 | 内容 |

|---|---|

| 対応OS | Windows 10(x64)、Windows 11(x64/ARM)、Windows Server 2025、macOS |

| 最小要件 | RAM 8GB、空きディスク 3GB |

| 推奨要件 | RAM 16GB、空きディスク 15GB |

| 利用可能モデル | 20種類以上のOSS LLM、Whisper(音声認識) |

| SDK | Python、JavaScript、C#、Rust |

| API | OpenAI互換REST API |

| 料金 | 無料(Azureサブスクリプション不要) |

Windows AI APIs(Copilot+ PC向け即利用型API)

Windows AI APIsは、Copilot+ PC向けに最適化された即利用型のAI機能です。 Windows App SDK経由で呼び出すことができ、数行のコードでテキスト生成や画像処理、OCRなどのAI機能をアプリに組み込めます。モデルの配信はMicrosoftが管理しており、アプリ間でモデルが共有されるためストレージの節約にもなります。

中心となるのはPhi SilicaというMicrosoft Research開発の小規模言語モデル(SLM)です。Copilot+ PCのNPUに最適化されており、テキスト生成や会話要約をハードウェアアクセラレーションで高速に処理します。LoRAファインチューニングにも対応しており、用途に合わせたカスタマイズもできます。

| API名 | 機能 |

|---|---|

| Image Description | 画像の自然言語説明を生成 |

| Image Super Resolution | 画像の解像度を向上 |

| Image Object Extractor | 画像内のオブジェクトをセグメンテーション |

| Image Object Erase | 画像からオブジェクトを削除 |

| Image Generation | テキストから画像を生成 |

| Image Foreground Extractor | 画像の前景をセグメンテーション |

| Text Recognition(OCR) | 画像内のテキストを認識 |

| Semantic Search | テキスト・画像のセマンティック検索 |

| Speech Recognition | 音声からテキストへの変換 |

| Video Super Resolution | 動画の解像度を向上 |

Windows ML(ONNXモデル推論フレームワーク)

Windows ML(Windows Machine Learning)は、C#・C++・Pythonの開発者がONNXモデルをローカルで実行するための推論フレームワークです。

Windows AI APIsやFoundry Localがあらかじめ用意されたモデルを使うのに対し、Windows MLではHugging Faceや独自に学習したモデルなど、開発者が作成したモデルを実行できるのが大きな違いです。PyTorch、TensorFlow、scikit-learnなど他のフレームワークで作成したモデルをONNX形式に変換すれば、Windows ML上で動かせます。

| 項目 | 内容 |

|---|---|

| 対応OS | Windows App SDKがサポートするWindowsバージョン(x64/ARM64) |

| 対応モデル形式 | ONNX |

| 開発言語 | C#、C++、Python |

| モデル取得先 | Hugging Face、独自学習、Model Catalog |

| ハードウェア | CPU、GPU(DirectML)、NPU(Windows 11 24H2以降) |

| 料金 | 無料(Windows App SDK同梱) |

これまでのDirectMLベースのソリューションと比べて、TensorRT for RTX、AI Engine Direct、Intel’s Extension for PyTorch相当のパフォーマンスを維持しています。

あわせて、GAFAMの一角であるAppleが発表した新たなAI技術「SHARP」も押さえておくと、AIへの理解がより深まるでしょう。詳しくは、以下の記事をご覧ください。

Microsoft Foundry on Windowsの安全性

Microsoft Foundry on Windowsはローカル実行を前提としており、データがデバイスから外部に送信されない設計になっています。 Foundry Localの場合、プロンプトとモデルの出力はすべてデバイス上で処理されます。ネットワーク通信が発生するのは、モデルや実行プロバイダーの初回ダウンロード時のみです。公式ドキュメントにも、ローカルエンドポイントへのリクエストはローカルで処理されることが書かれています。

Windows AI APIsにもコンテンツモデレーション機能が組み込まれており、有害なコンテンツの生成を防ぐフィルターが動作します。感度フィルターの調整にも対応しているため、アプリの用途に応じたチューニングもできます。

Microsoft Foundry on Windowsの制約

2026年3月6日時点で、Microsoft Foundry on Windowsにはいくつかの制限があります。 とくにFoundry Localがプレビュー版であること、Windows AI APIsがCopilot+ PC専用であることは、導入検討時にかならず確認しておくべきポイントです。

| 制約事項 | 詳細 |

|---|---|

| Foundry Localのステータス | プレビュー版(GA前のため仕様変更の可能性あり) |

| Windows AI APIsの対象デバイス | Copilot+ PC専用 |

| Phi Silicaの地域制限 | 中国では利用不可 |

| Windows MLのNPU対応 | Windows 11 24H2以降が必要 |

| モデルの初回ダウンロード | インターネット接続が必要 |

| Foundry Localのディスク容量 | モデルによっては15GB以上の空き容量が推奨 |

Foundry Localはプレビュー段階のため、APIの仕様やモデルカタログが今後変更される可能性があります。プロダクション環境での利用にあたっては、一般提供のタイミングを確認してから判断するのがよいでしょう。

Microsoft Foundry on Windowsの料金

Microsoft Foundry on Windowsの3つの技術はいずれも無料で利用できます。 Azureサブスクリプションも不要で、モデルのダウンロードから推論実行まで追加のコストは発生しません。クラウドAIサービスのようなトークン単位の従量課金もないため、利用量に比例してコストが増える心配がありません。

| 技術 | 料金 | 備考 |

|---|---|---|

| Foundry Local | 無料 | Azureサブスクリプション不要 |

| Windows AI APIs | 無料 | Copilot+ PCのハードウェアが必要 |

| Windows ML | 無料 | Windows App SDKに同梱 |

ただし、ハードウェアのコストは別途かかります。 Windows AI APIsを使うにはCopilot+ PCが必要であり、Foundry Localで大型モデル(GPT-OSS 20Bなど)を動かす場合は16GB以上のVRAMを搭載したNVIDIA GPUが推奨されます。実質的なコストは、必要なハードウェアスペックに依存します。

クラウドベースのAzure OpenAI Serviceと比較すると、推論のたびに発生するAPI料金がない点は大きなメリットです。大量のリクエストを処理するアプリケーションや、オフラインで動作するアプリケーションではコスト面で有利になるでしょう。

Microsoft Foundry on Windowsのライセンス

Microsoft Foundry on Windowsのプラットフォーム自体はMicrosoft Software License Termsに基づいて提供されています。 各モデルにはそれぞれ個別のライセンスが設定されており、商用利用の可否はモデルごとに確認が必要です。

Foundry Localで利用できるモデルのライセンスは、GitHubリポジトリのlicensesディレクトリで確認できます。オープンソースモデル(Qwen、Phi等)の多くはApache-2.0やMITライセンスで提供されており、商用利用が可能です。また、Windows AI APIs経由で使えるPhi SilicaはMicrosoft独自のモデルであり、Windows App SDKの利用規約に準拠します。

Microsoft Foundry on Windowsの実装方法

Microsoft Foundry on Windowsの実装方法は、選ぶ技術によって異なります。 ここでは3つの技術それぞれの基本的なセットアップ手順とコード例を紹介します。

Foundry LocalはPython、Windows AI APIsとWindows MLはC#を中心に解説します。いずれも短時間で環境構築が完了し、すぐにAI機能を試せます。公式のサンプルコードをベースにしているため、そのままプロジェクトに組み込めます。

Foundry Localの実装(Python)

Foundry LocalをPythonで使う場合の手順は以下のとおりです。

Foundry Localのインストール

// Windowsの場合

winget install Microsoft.FoundryLocal// macOSの場合

brew install microsoft/foundrylocal/foundrylocalモデルの実行を確認

foundry model run qwen2.5-0.5b上記のコマンドを実行すると、モデルが自動ダウンロードされ、CLIで対話できるようになります。

Pythonからの利用

import openai

from foundry_local import FoundryLocalManager

alias = "phi-3.5-mini"

manager = FoundryLocalManager(alias)

client = openai.OpenAI(

base_url=manager.endpoint,

api_key=manager.api_key

)

stream = client.chat.completions.create(

model=manager.get_model_info(alias).id,

messages=[{"role": "user", "content": "Windowsのローカル AI機能について教えて"}],

stream=True

)

for chunk in stream:

if chunk.choices[0].delta.content is not None:

print(chunk.choices[0].delta.content, end="", flush=True)pip install foundry-local-sdk openaiで必要なパッケージをインストールしておきます。OpenAI SDKをそのまま使えるため、クラウドのOpenAI APIからの移行もスムーズです。SDKが動的ポートを自動検出するため、エンドポイントのハードコードは不要です。

Windows AI APIsの実装(C#)

Windows AI APIsはC#での利用がメインです。Windows App SDK 1.8以降のNuGetパッケージが必要です。

using Microsoft.Windows.AI;

// モデルの準備状態を確認

if (LanguageModel.GetReadyState() == AIFeatureReadyState.EnsureNeeded)

{

var result = await LanguageModel.EnsureReadyAsync();

if (result.Status != PackageDeploymentStatus.CompletedSuccess)

{

throw new Exception(result.ExtendedError().Message);

}

}

// モデルを作成してプロンプトを送信

using LanguageModel languageModel = await LanguageModel.CreateAsync();

string prompt = "Windowsのローカル AI機能の利点を3つ挙げてください。";

var result = await languageModel.GenerateResponseAsync(prompt);

Console.WriteLine(result.Response);ビルド構成はARM64に設定し、Package.appxmanifestにsystemAIModelsケーパビリティを追加する必要があります。Copilot+ PC上で動作させるため、ターゲットデバイスの確認を忘れないようにしましょう。なお、EnsureReadyAsync()を最初に呼ぶことで、必要なモデルが端末に未インストールの場合は自動的にダウンロードされます。モデルはWindows Update経由で配信されるため、開発者が手動で管理する必要はありません。

Windows MLの実装(C#)

Windows MLを使う場合は、ONNX Runtime+実行プロバイダーのセットアップが最初のステップです。

using Microsoft.ML.OnnxRuntime;

using Microsoft.Windows.AI.MachineLearning;

// ORT環境を構成

EnvironmentCreationOptions envOptions = new()

{

logId = "MyApp",

logLevel = OrtLoggingLevel.ORT_LOGGING_LEVEL_ERROR

};

using var ortEnv = OrtEnv.CreateInstanceWithOptions(ref envOptions);

// 実行プロバイダーを自動ダウンロード・登録

var catalog = ExecutionProviderCatalog.GetDefault();

await catalog.EnsureAndRegisterCertifiedAsync();この設定後、通常のONNX Runtime APIでモデルの推論を実行できます。EnsureAndRegisterCertifiedAsync()がデバイスに最適なEPを自動で取得・登録するため、ハードウェアごとの分岐コードは不要です。

なお、GoogleはAI機能のリリースを続けており、AI音楽生成モデル「Lyria 3」も話題になっています。くわしく知りたい方はこちらをご覧ください。

【業界別】Microsoft Foundry on Windowsの活用シーン

Microsoft Foundry on Windowsは、データをクラウドに送れない業界やオフライン環境が求められる業界で力を発揮します。 ローカル実行によるプライバシー確保やレイテンシの低減、クラウドコストの削減といったメリットは、多くの業界のニーズに合うでしょう。

3つの技術を組み合わせれば、テキスト処理から画像認識まで幅広いAIタスクをカバーできます。以下では4つの業界を取り上げ、それぞれの活用ポイントを解説します。

ソフトウェア開発

AIを使ったコード補完やレビュー機能をIDE内に組み込むケースで、Foundry Localが活きます。ソースコードをクラウドに送信できないセキュリティポリシーの企業でも、ローカルでLLMを動かせば安全にAIコーディング支援を導入できます。

OpenAI互換APIに対応しているため、既存のAI開発ツールとの統合もスムーズです。社内の独自コードスタイルに合わせたファインチューニング済みモデルをWindows MLで動かすこともできます。

生成AI×システム開発はこちらで解説

医療・ヘルスケア

患者データを扱う電子カルテシステムや診断支援ツールにAI機能を組み込む場合、データの外部送信は許容されません。Microsoft Foundry on Windowsなら、すべての推論をデバイス上で完結させられるため、医療情報の厳格なプライバシー要件に対応できます。

Windows AI APIsの画像処理機能は、医療画像の解析補助にも応用できます。オフラインの診療環境でも動作する点は、地方や離島の医療機関にとってメリットになります。

生成AIの医療活用は下記で解説

製造業・エッジコンピューティング

工場の検品ラインや品質管理システムで、画像認識や異常検知のAIモデルをリアルタイムに動かすケースに適しています。Windows MLでカスタムの検品モデルをデプロイすれば、ネットワーク遅延の影響を受けずにリアルタイム処理ができます。

エッジAIの需要が高まるなか、統一されたフレームワークでモデルを管理できる点はメンテナンス性の面でも有利です。実行プロバイダーの自動管理により、工場内の異なるスペックの端末でも同じアプリを展開できます。

製造業界の生成AI活用はこちらで解説

教育・研究

生成AIの実験やモデルの比較検証を、クラウドコストを気にせずに行える点が研究者にとって大きなメリットです。Foundry Localなら20種類以上のOSS LLMをローカルで自由に試せます。

Windows MLを使えばHugging Faceから取得したモデルもONNX変換後にそのまま動かせるため、論文の再現実験やモデルの性能比較に便利です。学生が個人のPC上で気軽にAI開発を始められる環境として、教育用途にも適しています。

教育現場での生成AI活用は下記で紹介

【課題別】Microsoft Foundry on Windowsが解決できること

ローカルAI開発でよくある課題に対して、Microsoft Foundry on Windowsがどう役立つかを整理しました。 セキュリティ、コスト、運用面など、企業がAI導入時に直面しやすい5つの課題について、それぞれの解決策を紹介します。

クラウドAIとローカルAIのどちらを選ぶか迷っている方にも、判断の手がかりになるはずです。自社の要件に照らし合わせて、導入を検討するときの判断材料としてご活用ください。

機密データをクラウドに送らずにAI処理ができる

「顧客情報や社内の機密文書をAIで分析したいけれど、クラウドへのデータ送信がセキュリティポリシーで禁止されている」というケースは多いでしょう。

Microsoft Foundry on Windowsならすべての推論がデバイス上で完結するため、データが外部に出ることはありません。オンプレミス環境と同等のデータ保護レベルをPC上で実現できます。コンテンツモデレーション機能も備えているため、有害な出力を防ぐフィルタリングも可能です。

ハードウェアごとの最適化を手動で管理しなくて済む

社内のPCにはNVIDIA GPU搭載機もあれば、Intel内蔵GPUのみの機械もあります。こうした環境の違いを吸収するのは開発者にとって大きな負担です。

Microsoft Foundry on Windowsではハードウェアの自動検出と最適なEPの自動選択が行われるため、ハードウェアごとの分岐コードを書く必要がありません。write-once-run-anywhereの考え方で、1つのコードベースを複数のデバイスにデプロイできます。

クラウドAPI料金の増加をおさえられる

AIチャットボットやドキュメント処理など、リクエスト数が多い用途ではクラウドAPI料金が膨らみがちです。Microsoft Foundry on Windowsはすべて無料で使えるため、推論コストがゼロです。

初期のハードウェア投資だけで、利用量を気にせずAI機能を提供できます。Azureサブスクリプションも不要なので、ライセンス管理の手間もかかりません。トークン単位の従量課金がないため、利用量の見積もりが難しい段階でも安心して導入できます。

オフライン環境でもAIが使える

フィールドワークや機密施設内など、ネットワーク接続がない環境でもAI機能が必要な場面があります。Microsoft Foundry on Windowsはモデルをいちどダウンロードすればオフラインで動作するため、ネットワーク環境に依存しない運用ができます。

Foundry Localは軽量なモデルであればRAM 8GBの端末でも動くため、モバイルノートPCでの利用にも適しています。モデルの更新が必要になった場合のみ、ネットワークに接続すればよいので、運用もシンプルです。

Microsoft Foundry on Windowsの活用事例

Microsoft Foundry on WindowsはGitHub上で約2000スター以上を獲得しており、開発者コミュニティでの注目度は高まっています。 Microsoftが公式サンプルやデモアプリを積極的に公開しており、導入のハードルを下げる取り組みが進んでいます。

インドの医療現場でWindows AI APIsが活用されている事例

Windows Developer公式アカウントは、Dot Inc.がWindows AI APIsを活用してインド農村部の視覚障害を持つ医療従事者を支援している事例を紹介しています。Dot Inc.はWindows AI APIsの画像認識やテキスト読み上げ機能をアプリに組み込み、視覚に頼れない環境でも医療業務を遂行できる支援ツールを開発しました。

この事例が注目に値するのは、ネットワーク環境が不安定なインド農村部でも、ローカル実行のAIであれば安定して動作するという点です。クラウドAIではインターネット接続が前提となりますが、Windows AI APIsはCopilot+ PC上でモデルが動くため、オフラインや低帯域の環境でもAI機能を提供できます。医療データをデバイスから外に出さずに処理できるプライバシー面のメリットも、医療分野での採用を後押ししています。

「クラウド不要・100%プライベート」がX上で大きな反響

Microsoft Foundry on Windows全体ではありませんが、構成技術の一つであるFoundry Local単体に対する反響も紹介します。

Foundry Localの公開直後、X上でとくに大きな反響を呼んだのが、「MicrosoftがAIモデルをローカルで動かすオープンソースツールをリリースした。クラウド依存ゼロ、サブスクリプション不要、認証不要。すべて100%プライベート」という紹介です。この特徴を活かした活用シーンとして、とくに以下のようなケースが考えられます。

まず、社内チャットボットのローカル運用です。顧客対応や社内ナレッジ検索にLLMを使いたいけれど、問い合わせ内容をクラウドに送れないという企業は多いでしょう。Foundry LocalならOpenAI互換APIで既存のチャットUIをそのまま流用しつつ、データをデバイスから外に出さずに運用できます。公式のChat Application Starterをベースにすれば、Electronベースのローカルチャットアプリをすぐに構築できます。

さらに、外部APIへの依存を減らしたいプロダクト開発にも向いています。Function Calling Exampleでは実装例が公開されており、クラウドAPIの従量課金を気にせずにAI機能をアプリに組み込めます。

よくある質問

Microsoft Foundry on Windowsについて、導入を検討する際によく寄せられる質問をまとめました。 料金、対応環境、他ツールとの違いなど、気になるポイントを確認してください。公式ドキュメントやGitHubリポジトリの情報をもとに、よくある疑問に回答します。

Microsoft Foundry on WindowsでローカルAI開発を加速しよう!

Microsoft Foundry on Windowsは、Windows AI APIs・Foundry Local・Windows MLの3技術でローカルAI開発を統合的に支援するプラットフォームです。 Azureサブスクリプション不要で無料利用でき、データをデバイスから外に出さずにAI処理できる点が大きな強みです。Foundry Localが20以上のOSS LLMをOpenAI互換APIで提供し、PythonやC#からすぐに使える手軽さも魅力です。

ローカルAIの導入やAIアプリ開発をお考えの方は、ぜひWEELにご相談ください。

最後に

いかがだったでしょうか?

弊社では

・マーケティングやエンジニアリングなどの専門知識を学習させたAI社員の開発

・要件定義・業務フロー作成を80%カットできる自律カスタマイズ型カスタマーサービス

・経営者のブレーンとして、AIが経営についてアドバイスするAIコンサルタント

についてのご相談についてはもちろん、生成AI導入についての無料相談も承っております。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、通勤時間に読めるメルマガを配信しています。

最新のAI情報を日本最速で受け取りたい方は、以下からご登録ください。

また、弊社紹介資料もご用意しておりますので、併せてご確認ください。