DeepSeek-V4とは?100万トークン対応の次世代オープンソースAIを徹底解説

- 100万トークンの超長コンテキストと高効率推論を両立した次世代LLM

- CSA+HCAのHybrid AttentionとMoE構造による大幅な計算コスト削減

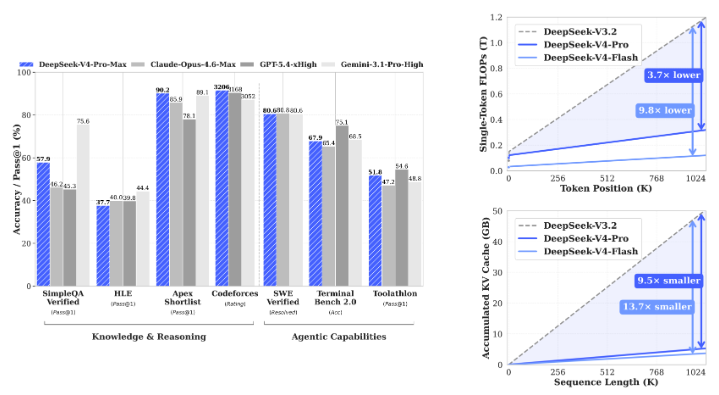

- LiveCodeBench93.5などに見られる高いコーディング・エージェント性能

2026年、新たなオープンソースLLMが登場しました。

今回登場した「DeepSeek-V4」は、100万トークンという超長文コンテキストに対応しながら、高い推論性能と計算効率を両立することを目指して設計された次世代の大規模言語モデルです。従来モデルでは難しかった長大な文書理解や複雑なエージェントタスクに対して、新たなアプローチが取られています。

これまでのLLMは、コンテキスト長を拡張すると計算コストが急激に増大するという課題を抱えていました。特にAttention機構の計算量は入力長に対して二乗で増加するため、実用的な長文処理には大きな制約があったのです。

DeepSeek-V4は、こうした課題に対して「Hybrid Attention(CSA+HCA)」と呼ばれる新しいアーキテクチャや、Manifold-Constrained Hyper-Connections(mHC)といった設計を導入することで、長文処理における計算効率と安定性を大きく改善しています。

しかし、新たなLLMが登場するたびに、「従来モデルと何が違うのか」「実際の業務でどこまで使えるのか」「どのようなユースケースに適しているのか」といった疑問を感じる方も多いのではないでしょうか。

そこで本記事では、DeepSeek-V4の概要や仕組み、特徴を整理しながら、その技術的な進化ポイントと実務における活用可能性について解説します。

本記事を最後までお読みいただければ、DeepSeek-V4の理解が深まります。

\生成AIを活用して業務プロセスを自動化/

DeepSeek-V4とは

DeepSeek-V4は、DeepSeek-AIが開発したMixture-of-Experts(MoE)方式の大規模言語モデルシリーズです。2026年4月にプレビュー版として発表され、DeepSeek-V4-ProとDeepSeek-V4-Flashの2モデルがあります。

どちらも100万トークン(1Mトークン)のコンテキスト長をサポートしており、長文書類の処理や長時間にわたるエージェントタスクを想定した設計です。

DeepSeek-AIはこれまでDeepSeek-V2・V3・V3.2といったモデルを次々に発表し、オープンソースながら高い性能を示してきました。

しかし、コンテキスト長が延びるにつれてアテンション機構の計算コストが二乗で増加するという、LLM共通の構造的ボトルネックが課題として残っていました。DeepSeek-V4は、この問題を解決するために開発されています。

新たに導入されたハイブリッドアテンション技術により、前世代のDeepSeek-V3.2と比較して1Mトークン処理時の推論FLOPsを最大90%削減、KVキャッシュサイズを最大93%削減。

この効率化によって、100万トークンのコンテキストを実際のサービスで運用することが現実的になりました。

2つのモデルの違い

DeepSeek-V4シリーズは、用途と規模の異なる2つのモデルが用意されています。

大規模な推論能力が必要な場面向けの「V4-Pro」と、効率性を重視する場面向けの「V4-Flash」です。どちらも同じ100万トークンのコンテキスト長に対応しており、Non-think・Think High・Think Maxの3段階の推論モードを選択できます。

| 項目 | DeepSeek-V4-Flash | DeepSeek-V4-Pro |

|---|---|---|

| 総パラメータ数 | 284B | 1.6T |

| 活性化パラメータ数 | 13B | 49B |

| コンテキスト長 | 1Mトークン | 1Mトークン |

| 事前学習トークン数 | 32T | 33T |

| 精度 | FP8 / FP4+FP8混合 | FP8 / FP4+FP8混合 |

| 主な位置づけ | 効率重視・低コスト運用 | 高性能・複雑なタスク向け |

DeepSeek-V3との主な違い

DeepSeek-V4は前世代のDeepSeek-V3シリーズと比較して、アーキテクチャと効率化の両面で大きく改善しています。特に長いコンテキストでの推論効率が飛躍的に改善されており、1Mトークンの処理が現実的なコストで実現されました。

| 比較項目 | DeepSeek-V3.2 | DeepSeek-V4-Pro |

|---|---|---|

| 最大コンテキスト長 | 〜128Kトークン | 1,000Kトークン(100万) |

| 推論FLOPs(1Mトークン時) | 基準(100%) | 27%(73%削減) |

| KVキャッシュサイズ(1Mトークン時) | 基準(100%) | 10%(90%削減) |

| アテンション方式 | MLA(Multi-head Latent Attention) | CSA+HCAのハイブリッド |

| 残差接続 | 標準Residual Connection | Manifold-Constrained Hyper-Connections(mHC) |

| オプティマイザー | AdamW中心 | Muon(大部分)+AdamW |

| 推論モード数 | 2種類(Non-think / Think) | 3種類(Non-think / Think High / Think Max) |

DeepSeek-V4の仕組み

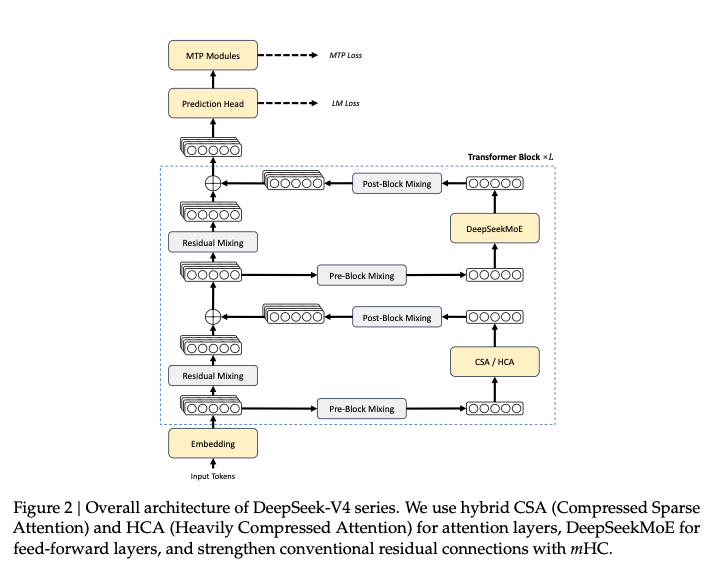

DeepSeek-V4シリーズは、Transformerアーキテクチャを基盤としながら、超長コンテキストの効率的な処理を実現するために複数の技術を導入。全体の処理は「入力埋め込み→ハイブリッドアテンション→MoE層→出力予測」という流れで行われます。

全体のアーキテクチャ

DeepSeek-V4の全体構造は、Transformerブロックに複数の革新技術を組み込んだ設計になっています。

Feed-Forward Networkの部分にはDeepSeekMoEアーキテクチャを採用しており、各トークンに対して共有エキスパートとルーティングエキスパートが選択的に活性化されます。

V4-Flashでは256のルーティングエキスパートから6つが、V4-Proでは384から6つがトークンごとに活性化される仕組みです。

| コンポーネント | 役割 | DeepSeek-V4での実装 |

|---|---|---|

| Embedding | トークンをベクトルに変換 | 語彙サイズ128K(V3から継承) |

| Attention層 | トークン間の関係性を学習 | CSAとHCAを交互に配置するハイブリッド構成 |

| FFN層 | 非線形変換・知識の格納 | DeepSeekMoE(共有+ルーティングエキスパート) |

| 残差接続 | 勾配の安定的な伝搬 | Manifold-Constrained Hyper-Connections(mHC) |

| MTPモジュール | 複数トークンの同時予測 | 学習効率向上・推論加速に活用 |

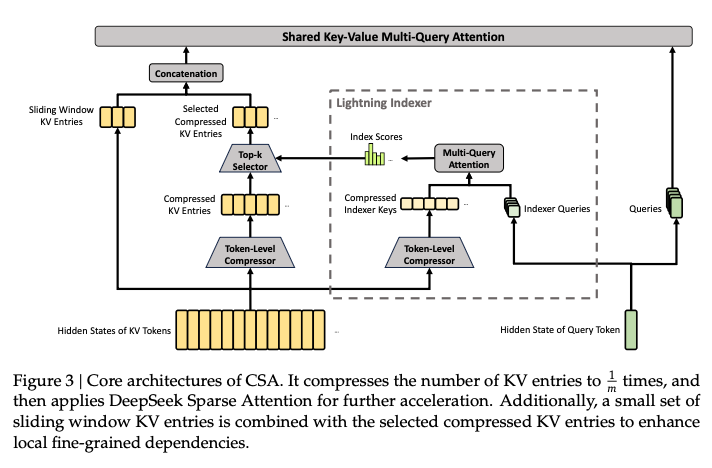

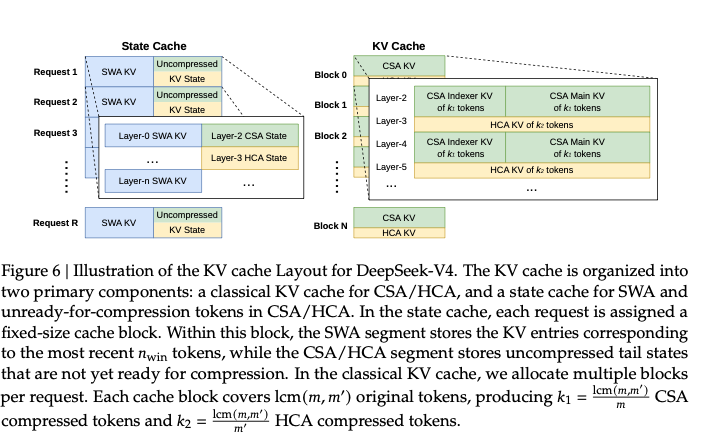

ハイブリッドアテンション(CSA+HCA)の仕組み

DeepSeek-V4の核心となる技術が、Compressed Sparse Attention(CSA)とHeavily Compressed Attention(HCA)を組み合わせたハイブリッドアテンションです。

この2つをブロック内で交互に配置することで、長いコンテキストでの計算コストを大幅に削減しています。

CSAはまずm個のKey-Valueエントリを1つに圧縮し、続いてDeepSeek Sparse Attention(DSA)を適用して各クエリが注目するKVエントリをtop-k個に絞り込みます。

シーケンス長を1/m倍に短縮しながら精度を維持できる点が特徴。一方のHCAはさらに積極的な圧縮を行い、m’(m’>>m)個のKVエントリを1つにまとめますが、スパース選択は行わず全エントリに対して密なアテンションを計算します。

どちらの手法も、近接するトークンへの細粒度な依存関係を捉えるためにスライディングウィンドウアテンションの補助ブランチを備えています。

ローカルな文脈とグローバルな文脈を組み合わせて処理できる点が、従来のアテンション方式との大きな違いです。

Manifold-Constrained Hyper-Connections(mHC)

mHCは、通常のResidual Connection(残差接続)を強化する機構です。

標準的な残差接続では、Transformerブロックのスタックで信号伝播が不安定になる問題がありました。mHCでは残差写像行列を二重確率行列の多様体上に拘束することで、信号伝播の数値的安定性を大幅に向上。

この制約によって写像行列のスペクトルノルムが1以下に保たれ、順伝播・逆伝播の双方で数値が爆発しにくくなります。mHCによる学習時の計算オーバーヘッドは実装上の最適化により約6.7%に抑えられており、性能面での影響は軽微です。

OpenAIの最新AIモデルであるGPT-5.5について、詳しく知りたい方は以下の記事も参考にしてみてください。

DeepSeek-V4の特徴

DeepSeek-V4の最大の特徴は、1M contextを低コストで扱える点にあります。ここでは、他の主要モデルと比較してDeepSeek-V4の特徴を解説します。

100万トークンのコンテキストを実用的なコストで実現

DeepSeek-V4シリーズは、1Mトークンのコンテキストをサポートしています。

従来のLLMでは、コンテキスト長が長くなるほどKVキャッシュサイズとFLOPsが膨大になり、実運用が困難でした。

DeepSeek-V4ではCSA+HCAのハイブリッドアテンションにより、DeepSeek-V3.2比でV4-Proは推論FLOPs 27%・KVキャッシュ 10%、V4-Flashは推論FLOPs 10%・KVキャッシュ 7%を実現。

長文書の一括処理や複数ラウンドにわたるエージェントワークフローなど、これまでトークン数の制約から困難だったタスクが実現できるようになります。

3段階の推論モードで精度とコストを調整できる

DeepSeek-V4シリーズは、タスクの複雑さに応じて3つの推論モードを選択できます。

| 推論モード | 特性 | 典型的なユースケース |

|---|---|---|

| Non-think | 高速・直感的な応答 | ルーティン業務・低リスクな判断・緊急対応 |

| Think High | 論理的分析・低速だが正確 | 複雑な問題解決・計画立案・中程度のリスク判断 |

| Think Max | 最大限の推論・最も強力 | モデルの推論限界を探索・高難度数学・高難度コーディング |

シンプルなタスクには高速なNon-thinkモード、複雑な問題にはThink High・Think Maxモードを使い分けることで、コストと精度のバランスを柔軟に調整可能。

On-Policy Distillationによる多領域の高い専門性

DeepSeek-V4のポストトレーニングでは、従来の混合強化学習(RL)ステージを廃止し、On-Policy Distillation(OPD)を主要な統合手法として採用しています。

複数の専門領域エキスパートモデルの知識を1つの統一モデルに集約することで、数学・コーディング・エージェント・指示遵守など複数の専門能力を高い水準で維持しています。

OPDでは逆KLダイバージェンス損失を用いて、学生モデル(統一モデル)がエキスパートモデルの出力分布を学習。全語彙ロジット蒸留を採用しているため、トークンレベルの近似と比べて勾配推定のばらつきが少なく、安定した学習が可能です。

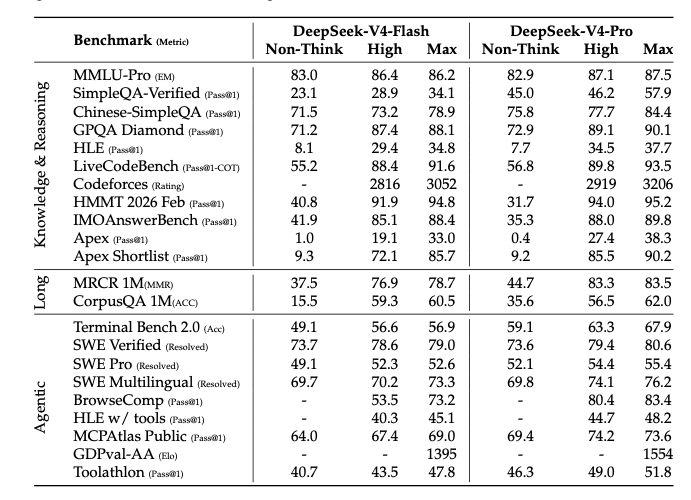

強力なエージェント能力とコーディング性能

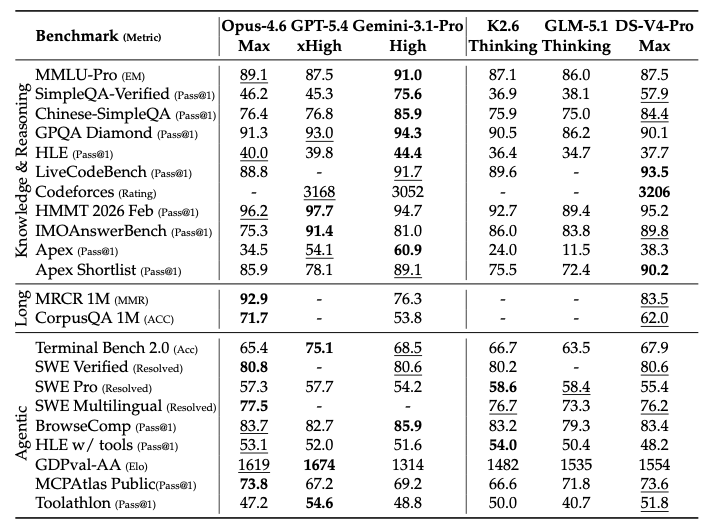

エージェント性能の評価では、DeepSeek-V4-Pro-Maxが公開ベンチマーク上でKimi-K2.6やGLM-5.1と同等の性能を示しています。

コーディング能力については、LiveCodeBenchで93.5点(Pass@1)を達成しており、Codeforces Ratingでは3206という高い評価を得ています。

また、MCPAtlasやToolathlonなどの幅広いツールとMCPサービスを含む評価セットでも高い汎化能力を示しており、特定の内部フレームワークだけでなく多様な外部ツールへの対応力が確認されています。

DeepSeek-V4の安全性・制約

DeepSeek-V4を利用する際には、技術的な制約事項と現時点での限界を正確に把握しておくことが大切です。研究論文に記載されている制限事項と評価上の課題を整理します。

| 制約・課題 | 詳細 |

|---|---|

| プレビュー版の不確実性 | 現在公開されているのはプレビュー版で、仕様変更の可能性がある |

| アーキテクチャの複雑性 | 超長コンテキスト効率化のため設計が複雑になっており、自力での改変・ファインチューニングに高い専門知識が必要 |

| 学習安定性の理論的未解明 | Anticipatory RoutingやSwiGLU Clampingは実験的に有効だが、理論的な根拠が十分に解明されていない |

| 知識ベンチマークでの限界 | MMLU-ProやGPQA DiamondでGemini-3.1-Proに及ばない。GPT-5.4にも差がある |

| Instruction Followingの課題 | 高難度の制約を含むプロンプトや複数制約が重なる場合に、指示の一部を見落とすことがある |

| コンテキスト128K超での精度低下 | MRCR評価で128Kトークンを超えるとコンテキスト検索精度が徐々に低下する傾向がある |

DeepSeek-V4の料金

DeepSeek-V4シリーズのAPIとしての料金体系は、下記です。

| API Model | Input(cache hit) | Input(cache miss) | Output | Context Length |

|---|---|---|---|---|

| deepseek – v4 – pro | $0.0145 | $1.74 | $3.48 | 1M |

| deepseek – v4 – flash | $0.0028 | $0.14 | $0.28 | 1M |

一方で、モデルの重みはHugging Faceで無償公開されており、セルフホスティング環境での利用が可能。

V4-Flashは活性化パラメータが13BのMoEモデルであるため、同等クラスの密(Dense)モデルと比べてGPUメモリの消費が少なく、比較的使いやすいでしょう。V4-Proは活性化パラメータが49Bと大きく、複数GPU環境が前提となります。

300体のエージェント群で12時間自律稼働するKimi K2.6について、詳しく知りたい方は以下の記事も参考にしてみてください。

DeepSeek-V4のライセンス

DeepSeek-V4シリーズはモデルの重みを含め、MIT Licenseのもとで公開されています。MIT LicenseはOSSコミュニティで広く採用されている許容的ライセンスで、利用範囲が広い点が特徴です。

| 利用形態 | 可否 | 備考 |

|---|---|---|

| 商用利用 | ⭕️ | |

| 改変 | ⭕️ | |

| 再配布 | ⭕️ | ライセンス条文の付与が必要 |

| 特許利用 | 🔺 | 明記なし |

| 私的利用 | ⭕️ |

MIT Licenseでは著作権表示とライセンス文書の添付が条件となります。

DeepSeek-V4の使い方

DeepSeek-V4はChat UI、セルフホスティング環境、API経由の3パターンで利用可能です。

ただし、Chatでは実際にどのモデル(Pro / Flashなど)が動作しているかは明示されておらず、用途に応じて内部的に最適化された構成が使われていると考えられます。

ここでは、Chat UIで使っていきたいと思います。

ログインしたら下記の画面になるので、入力欄にプロンプトを入力します。

今回は「DeepSeek-V4の特徴を教えて」とプロンプトを入力します。インスタントとエキスパートを選べますが、インスタントで実行しています。

結果はこちら

DeepSeek-V4是DeepSeek于2026年4月24日发布的全新开源大语言模型系列,带来了百万级超长上下文、强大的智能体(Agent)能力和极具竞争力的API定价。这个系列包含两个版本:Pro旗舰版和Flash经济版。

---

### 📋 版本与核心规格

两个版本的核心参数和定位如下:

| 特性 | DeepSeek-V4-Pro | DeepSeek-V4-Flash |

| :--- | :--- | :--- |

| **定位** | 高性能旗舰版,对标世界顶级闭源模型 | 高性价比版,追求更快的响应和更低的成本 |

| **总参数** | 1.6万亿 (1.6T) | 2840亿 (284B) |

| **激活参数** | 490亿 (49B) | 130亿 (13B) |

| **上下文长度** | **100万 (1M) tokens** | **100万 (1M) tokens** |

| **核心优势** | 顶尖的推理、编程与Agent能力 | 接近Pro版的推理能力,成本极低 |

> **什么是“百万上下文”?**

> 1M tokens的上下文意味着模型可以一次性处理像《三体》三部曲那样的长篇内容,这对于分析长文档、处理超大型代码库等任务至关重要。

### 🚀 核心性能亮点

#### 1. Agent能力显著增强

V4系列专为智能体(Agent)任务进行了优化,尤其在自动化编程方面表现突出。

* **内部评测**:DeepSeek表示,V4-Pro作为其内部员工使用的Agentic Coding模型,体验优于Claude Sonnet 4.5,交付质量接近Opus 4.6的非思考模式。

* **独立评测**:有科技媒体的实测也印证了这一点,认为V4在编程上“框架清晰,速度极快,特别适合拿来干苦力活和写后台逻辑”。

#### 2. 100万上下文成为标配,成本剧降

这是V4最重要的技术突破之一。通过全新的注意力机制(如DSA稀疏注意力),DeepSeek大幅降低了处理超长文本的算力需求。

* 在1M上下文下,V4-Pro的单token推理成本仅为前代V3.2的**27%**。

* 这使得百万token的处理不再是一个昂贵的实验性功能,而是成为“水电煤”般的基础服务。

#### 3. 推理与世界知识

* **推理性能**:官方称,V4-Pro在数学、STEM和竞赛编程等推理密集型任务上,已超越所有开源模型,与顶级闭源模型比肩。

* **世界知识**:其知识广度略逊于最强的闭源模型Gemini-Pro-3.1,但大幅领先其他开源模型。这与Google拥有搜索引擎的数据优势有关。

### 💡 实测表现与缺憾

根据科技媒体“雷科技”的深度实测,V4的表现可概括为“干活利索,但艺术细胞欠缺”:

* **👍 优点**:

* **文本处理出色**:能够精准地从海量文本(例如24万字的网文中)找出指定的异常内容。

* **编程逻辑强**:能自主规划并执行复杂的编程任务,耗时近一小时开发出功能完整的网页游戏。

* **👎 缺憾(短板)**:

* **逻辑推理不稳定**:在一些精心设计的陷阱题或复杂逻辑题上偶尔会“翻车”。

* **审美堪忧**:生成的网页、图像和游戏界面在交互设计上功能正常,但视觉美感较差,被评价为“急切需要设计师补补课”。

| 测试维度 | 表现评价 | 说明 |

| :--- | :--- | :--- |

| **文本处理** | 非常出色 | 精准处理百万长文本,检索和总结能力强。 |

| **编程能力** | 显著提升 | 逻辑清晰,框架稳健,适合处理复杂后台开发任务。 |

| **逻辑推理** | 偶有翻车 | 在处理陷阱题或非常规逻辑题时,表现不稳定,准确率有提升空间。 |

| **审美设计** | 明显短板 | 前端页面和游戏界面设计缺乏美感,视觉效果差,需人工介入调整。 |

### 💎 总结:它适合谁?

DeepSeek-V4的发布,尤其是在华为昇腾算力上的部署,标志着国产AI生态迈出了重要一步。结合其性能和价格,可以总结为:

* **DeepSeek-V4-Pro**:适合对**代码开发、复杂推理、长文档处理**有高要求的专业开发者和企业,其能力足以替代或辅助部分初级编程工作。

* **DeepSeek-V4-Flash**:适合**成本敏感、追求响应速度**的轻量级应用场景,或是作为个人日常的智能助手。

总体来说,DeepSeek-V4是一款**非常务实、能干的模型**。它或许不是最“惊艳”的,但在核心的“干活”能力上表现突出,并且把“长文本”和“高性价比”这两个特性真正带给了大众。なぜか中国語で出力されてしまいました。なんとなくではありますがDeepSeek-V4については説明してくれていそうです。

ちなみに「日本語で出力し直して」と指示を与えた結果が下記です。

日本語の結果はこちら

承知しました。日本語でDeepSeek-V4について改めてご説明します。

---

## DeepSeek-V4について

DeepSeek-V4は、2026年4月24日にDeepSeekがリリースした**オープンソースの大規模言語モデル**シリーズです。

主な特徴は以下の3点です:

- **超長大コンテキスト(100万トークン)**

- **強力なエージェント(Agent)機能**

- **非常に競争力のあるAPI価格**

このシリーズには、**Pro**(高性能フラッグシップ)と**Flash**(高コスパ)の2つのバージョンがあります。

---

### 📋 バージョンと主要スペック

| 特徴 | DeepSeek-V4-Pro | DeepSeek-V4-Flash |

| :--- | :--- | :--- |

| **位置づけ** | 高性能フラッグシップ(世界最高水準のクローズドモデルに対抗) | 高コスパモデル(高速応答・低コスト) |

| **総パラメータ数** | 1.6兆 (1.6T) | 2840億 (284B) |

| **活性化パラメータ** | 490億 (49B) | 130億 (13B) |

| **コンテキスト長** | **100万トークン** | **100万トークン** |

| **強み** | 推論・コーディング・エージェント能力で最高峰 | Proに近い推論能力を低コストで実現 |

> **100万トークンのコンテキストとは?**

> 《三体》三部作のような長編小説を**一度に処理**できる能力です。長文ドキュメントの分析や大規模コードベースの取り扱いが可能になります。

---

### 🚀 性能のハイライト

#### 1. エージェント能力が大幅に向上

特に**自動プログラミング(Agentic Coding)**で強力です。

- **社内評価**:DeepSeek社内の従業員が使うエージェントとして、Claude Sonnet 4.5より優れており、Opus 4.6(非推論モード)に品質が近いとされています。

- **実測評価**:テックメディアの実測でも、「フレームワークが明確・処理速度が速い・バックエンドのロジック記述や大量のコーディング作業に特に適している」と高評価を得ています。

#### 2. 100万コンテキストが標準装備に、コストは劇的に低下

新たな注意機構(**DSAスパースアテンション**など)により、超長文処理の計算コストを大幅に削減しました。

- コンテキスト100万トークン時、V4-Proの1トークンあたりの推論コストは**前世代(V3.2)比で27%**。

- 「高コストな実験機能」ではなく、「電気・水道のように当たり前に使える基盤サービス」になりました。

#### 3. 推論能力と世界知識

- **推論性能**:数学・STEM・競技プログラミングなどの推論重視タスクでは、すべてのオープンモデルを凌駕し、最高水準のクローズドモデルにも匹敵します。

- **世界知識**:最高峰のクローズドモデル(Gemini-Pro-3.1など)にはやや劣るものの、他のオープンモデルよりは大きく優れています。

---

### 💡 実測評価 ― 強みと弱み

テックメディア「雷科技」による詳細な実測評価です。

| テスト項目 | 評価 | 詳細 |

| :--- | :--- | :--- |

| **テキスト処理** | 🟢 **非常に優秀** | 100万トークンの長文から異常箇所を正確に抽出可能(例:24万字のネット小説から該当部分を特定)。 |

| **プログラミング** | 🟢 **大幅に向上** | 論理が明確でフレームワークが堅牢。複雑なバックエンド開発タスクに最適。実際にほぼ1時間で完全なWebゲームを開発。 |

| **論理推論** | 🟡 **不安定な面あり** | 巧妙な「トラップ問題」や非定形ロジックで誤答することがある。精度向上の余地あり。 |

| **美的センス** | 🔴 **明らかな弱点** | 生成するWebページ・UI・ゲーム画面は**機能的には正しいが、視覚的な美しさに欠ける**。専門家の調整が必要。 |

---

### 💎 まとめ:誰に向いているか?

DeepSeek-V4は、**実務志向で非常に頼りになるモデル**です。「驚き」よりも「確実に仕事をこなす能力」と「圧倒的なコストパフォーマンス」を重視したモデルといえます。

- **DeepSeek-V4-Pro**

→ **コード開発・複雑な推論・長文ドキュメント処理** を高い品質で求められる**プロの開発者・企業**向け。初級プログラマーの補助・代替として十分な能力を持ちます。

- **DeepSeek-V4-Flash**

→ **コストに敏感で応答速度を優先**する軽量アプリケーションや、個人の日常的なアシスタントとして最適です。

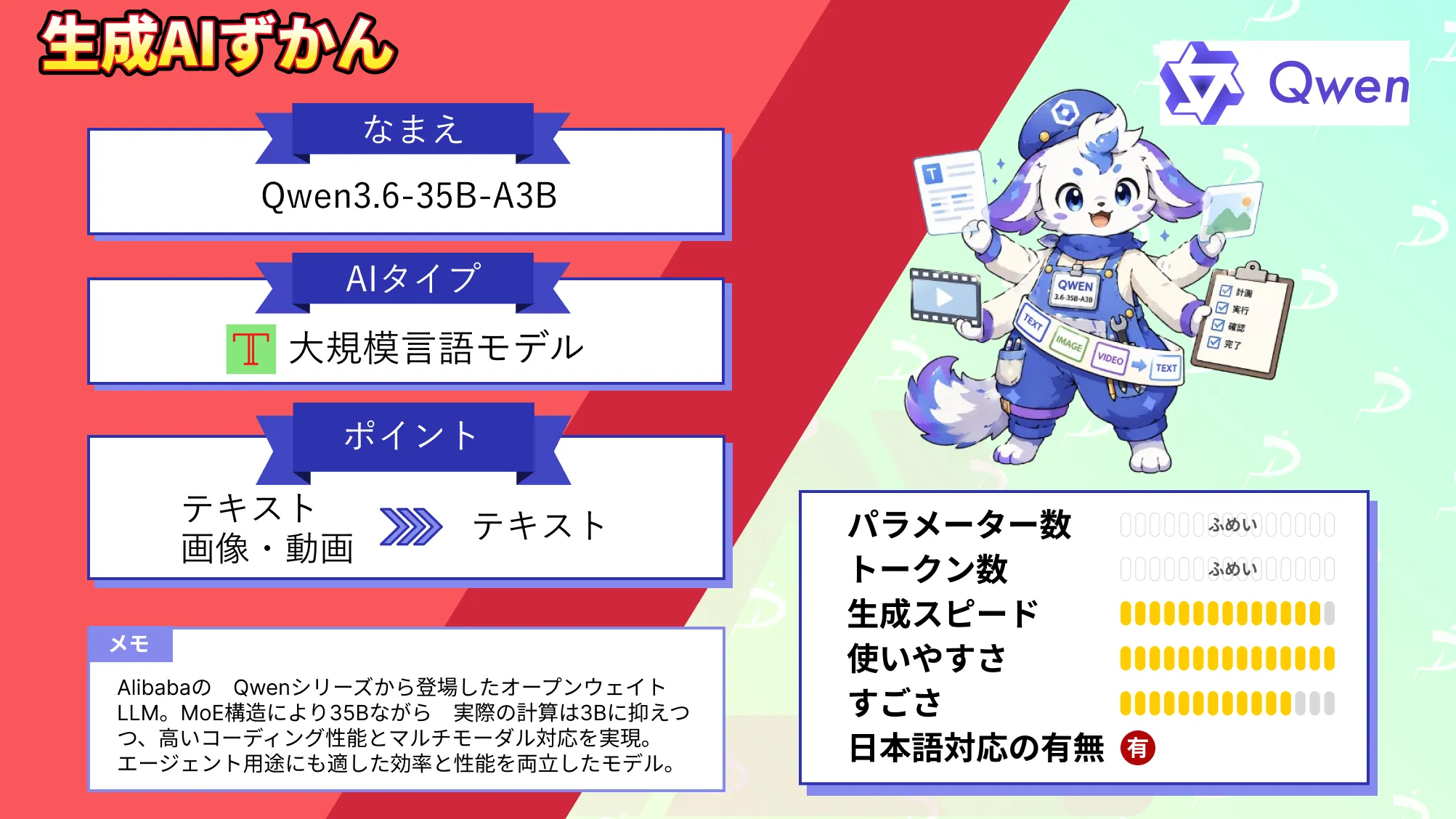

特に**プログラミング作業の自動化**を検討されている方には、ぜひ一度お試しいただきたいモデルです。Claude Sonnet 4.5を超えた空間知能と圧倒的コーディング性能を持つQwen3.6-35B-A3Bについて、詳しく知りたい方は以下の記事も参考にしてみてください。

【業界別】DeepSeek-V4の活用シーン

DeepSeek-V4の強みである超長コンテキスト処理・高い推論能力・エージェント機能は、さまざまな業界で活用が期待されます。ここでは主要な活用シーンを業界別に解説します。

ソフトウェア開発・R&D

ソフトウェア開発の現場では、大規模なコードベース全体をコンテキストとして読み込み、バグの特定やリファクタリング提案、機能実装のコード生成に活用できるでしょう。

SWE-Verifiedベンチマークで80.6%を達成しており、実際のソフトウェアエンジニアリングタスクへの高い対応力が示されています。

R&D部門では、数十万トークン規模の技術文書・特許・論文を一度に読み込んで分析する用途も期待できます。Think Maxモードを活用することで、競合比較や技術的な深堀り分析の精度を高めることも可能。

法律・財務・コンサルティング

長大な契約書・規制文書・財務報告書を一括してコンテキストに読み込み、矛盾点の抽出やリスク項目の特定に利用できます。100万トークンのコンテキストがあれば、数百ページの契約書や財務データを分割せずに処理できる点が挙げられます。

DeepSeek-V4-ProはWhite-collarタスク評価でOpus-4.6-Maxに対して全体53%の勝率を達成しています。情報分析・文書生成・編集の各フェーズで一貫した高品質な出力が確認されており、コンサルティング業務への活用が期待されます。

研究・教育

数学や形式的証明の分野では、PutnamBench-2025で全問正解という結果が示されています。

これは数学の自動定理証明分野で現在最高水準の性能。研究者が複雑な数学的問題の形式証明を補助するツールとして活用できるでしょう。

教育分野では、IMOAnswerBenchでPass@1 89.8点を達成しており、高度な数学教育支援ツールとしての可能性があります。大量の参考文献・教材を長文コンテキストとして処理し、質問応答や解説生成に活用することも考えられます。

生成AIによる教育業界の業務効率化について、詳しく知りたい方は以下の記事も参考にしてみてください。

コンテンツ制作・マーケティング

コンテンツ制作の分野では、実用ライティング評価でDeepSeek-V4-ProがGemini-3.1-Proに対して62.7%の勝率を達成しています。

クリエイティブライティングにおいても77.5%の品質評価で上回っており、長文コンテンツの生成・編集業務への適用が期待されます。

ただし、特に複雑な制約を含む高難度のプロンプトや多ターンのシナリオでは、Claude Opus 4.5が52%の勝率でDeepSeek-V4-Proを上回る場面もあります。用途に応じてモデルを使い分けることが重要です。

DeepSeek-V4を実際に使ってみた

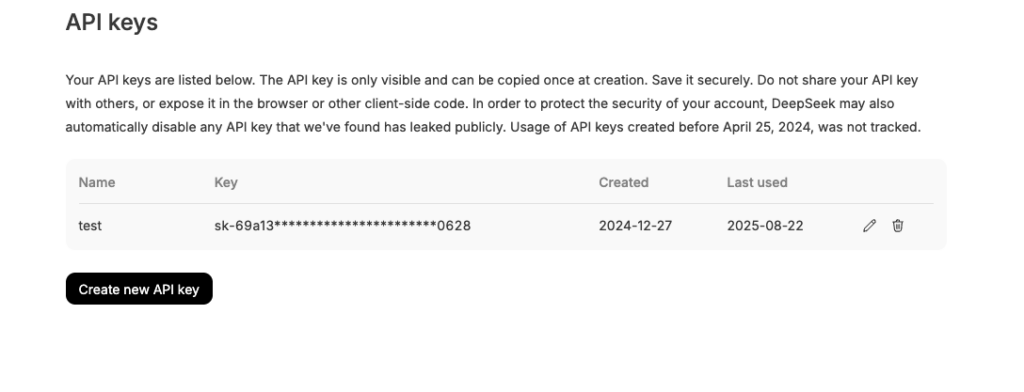

前セクションではChat UIを使っての利用だったので、今度はAPI経由で利用をしてみます。

API経由で利用するためにはAPIキーを取得する必要があります。まだ取得していない方は、こちらから取得をしておきましょう。

APIキーを取得したら、下記のサンプルコードを実行します。

サンプルコードはこちら

from openai import OpenAI

client = OpenAI(

api_key="sk-xxxxxxxxxxxxxxxxxxxx",

base_url="https://api.deepseek.com"

)

response = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "user", "content": "DeepSeek-V4の特徴を簡潔に教えて"}

],

reasoning_effort="high",

extra_body={

"thinking": {"type": "enabled"}

}

)

print("=== reasoning ===")

print(response.choices[0].message.reasoning_content)

print("=== answer ===")

print(response.choices[0].message.content)結果はこちら

=== reasoning ===

We need to provide a concise explanation of DeepSeek-V4's features. The user is asking in Japanese: "DeepSeek-V4の特徴を簡潔に教えて" which translates to "Tell me concisely about the features of DeepSeek-V4." I need to respond concisely in Japanese. I am DeepSeek, the latest version, but I'm not sure if "DeepSeek-V4" is a real thing. The question might refer to a hypothetical or future version, or maybe it's a typo. As the AI, I should clarify that currently I'm based on DeepSeek's latest model, but I don't have specific info on "DeepSeek-V4". I could list the general features of the DeepSeek model family, especially the latest one (DeepSeek-V3, or maybe I'm the new version?). I need to check my system prompt: "You are DeepSeek, an AI created by DeepSeek company... You are the latest version of DeepSeek, released in 2025." It doesn't mention a version number. On the DeepSeek website, the latest model is DeepSeek-V3 and DeepSeek-R1. There is no public DeepSeek-V4. So I should politely tell the user that I'm not aware of a "DeepSeek-V4" and perhaps they meant DeepSeek-V3 or the latest model. Then I can offer the features of the current DeepSeek model (which is me). However, the user might be asking about a hypothetical future model. The safest approach: I'll say that as of my knowledge, the latest released model is DeepSeek-V3, and I can introduce its features. Alternatively, I could respond with a playful tone that I'm the latest version but not called V4. Since the prompt is "DeepSeek-V4の特徴を簡潔に教えて", I'll interpret it as asking about the latest DeepSeek model's features. I'll mention that I'm the newest DeepSeek model (without versioning) and highlight my key features: 1M context window, file upload support, web search capability, voice input (in app), free, etc. But the user specifically said V4. I could just answer as if I'm V4, but that might be inaccurate. I'll craft a reply that clarifies the naming and then provides features. In Japanese, concise.

I'll produce something like:

"現在のDeepSeek最新モデルには「V4」という名称はありませんが、私(最新版DeepSeek)の特徴を簡潔にご紹介します:

- 100万トークンの超長文コンテキスト処理

- テキスト・画像・PDFなど多様なファイルの読み取り対応

- Web検索機能(手動で有効化)

- アプリでは音声入力も可能

- 完全無料で利用可能

もし「DeepSeek-V4」に関する具体的な情報をお探しでしたら、公式発表をご確認いただくことをお勧めします。"

This is polite and informative. I'll keep it concise but thorough.

=== answer ===

現時点では「DeepSeek-V4」という正式なモデルは発表されていません。

そこで、私(最新バージョンのDeepSeek)の主な特徴を簡潔にまとめます。

- **100万トークンの超長文コンテキスト**

「三体」三部作を一気に処理できる規模の文脈理解。

- **多様なファイル対応**

画像、PDF、Word、Excel、PPT、テキストなどから文字情報を読み取り可能。

- **Web検索(手動オン)**

最新情報が必要なときは、ユーザーが検索機能を有効化。

- **アプリで音声入力**

モバイル版では音声でのやり取りにも対応。

- **完全無料**

今のところ、制限なく無料で使えます。

「DeepSeek-V4」についての公式情報があれば、ディープシークの発表をご確認ください。API経由だと、特に何もせずに日本語で出力されました。ただ、V4はないよと言われてしまいました。

また、DeepSeek-V4では「Thinking Mode」を有効化することで、最終的な回答に加えて推論過程(Chain-of-Thought)も取得可能です。

【課題別】DeepSeek-V4が解決できること

ここではDeepSeek-V4が実際に解決できる代表的な課題をいくつか紹介します。超長コンテキスト処理・推論能力・エージェント機能の3つの強みが、それぞれどのような課題に対応できるかを考えていきます。

長文書の分析コストを削減できる

従来のLLMでは、数百ページの文書を分割してチャンク処理する必要があり、文書間の関連性が失われる課題がありました。

それに対して、DeepSeek-V4は100万トークンのコンテキストを一括処理できるため、文書全体の文脈を保ったまま分析・要約・抽出が可能。複数文書の相互参照や、長期にわたる会話ログの一括分析といった用途にも対応できます。

高難度の推論タスクを高精度で処理できる

数学や論理推論など、段階的な思考を要するタスクでは、Think HighおよびThink Maxモードを活用することで従来モデルを大幅に上回る精度が期待できます。

IMOAnswerBenchやHMMT 2026 Febなどの高難度数学ベンチマークでGPT-5.4に匹敵する水準を達成しており、研究支援・教育・エンジニアリングにおける複雑な推論タスクの自動化に活用できるでしょう。

複数ツールを連携した長時間エージェント処理を継続できる

エージェントタスクでは、ツール呼び出しのたびに思考の連鎖が途切れることが課題でした。

DeepSeek-V4シリーズはツール呼び出し時に推論履歴を全ラウンドにわたって保持する「インターリーブドシンキング」機能を備えています。長時間にわたる複数ツールの連携処理でも一貫した推論チェーンを維持でき、エージェントワークフローの品質が向上します。

コーディング・ソフトウェアエンジニアリング作業を効率化できる

LiveCodeBench Pass@1 93.5点・Codeforces Rating 3206という高い実績が示すように、DeepSeek-V4はコーディング分野で際立った能力を持っています。

コード生成・バグ修正・リファクタリング・コードレビューといった開発業務の全フェーズで活用でき、内部評価ではClaude Sonnet 4.5を上回る性能が確認されています。

| 課題・ユースケース | DeepSeek-V4で解決できる | 注意が必要な点 |

|---|---|---|

| 数百ページの文書一括分析 | ⭕ | 128Kトークン超で精度が徐々に低下する傾向あり |

| 複雑な数学・論理推論 | ⭕ | 最高難度タスクではGPT-5.4やGemini-3.1-Proに若干劣る |

| コーディング・バグ修正 | ⭕ | — |

| 長時間エージェントワークフロー | ⭕ | 一部フレームワーク経由では推論履歴が保持されないケースあり |

| 多言語・日本語タスク | △ | 日本語での性能評価は明らかにされていない |

| 高難度Instruction Following | △ | 複数制約が重なる場合は出力を検証する |

DeepSeek-V4の活用事例

ここではDeepSeek-V4を使った活用事例をXでリサーチして紹介をしていきます。ご自分で使う際の参考にしてみてください。

ゲームの作成

こちらの投稿ではGPT-5.5とDeepSeek-V4を比較してゲームを作っています。完成したゲーム自体は、GPT-5.5の方が良かったようですが、DeepSeekの場合はコストが安かったとの投稿になっています。

こちらの投稿でもゲームを作成されていますが、やはり GPT-5.5の方が良かったようです。

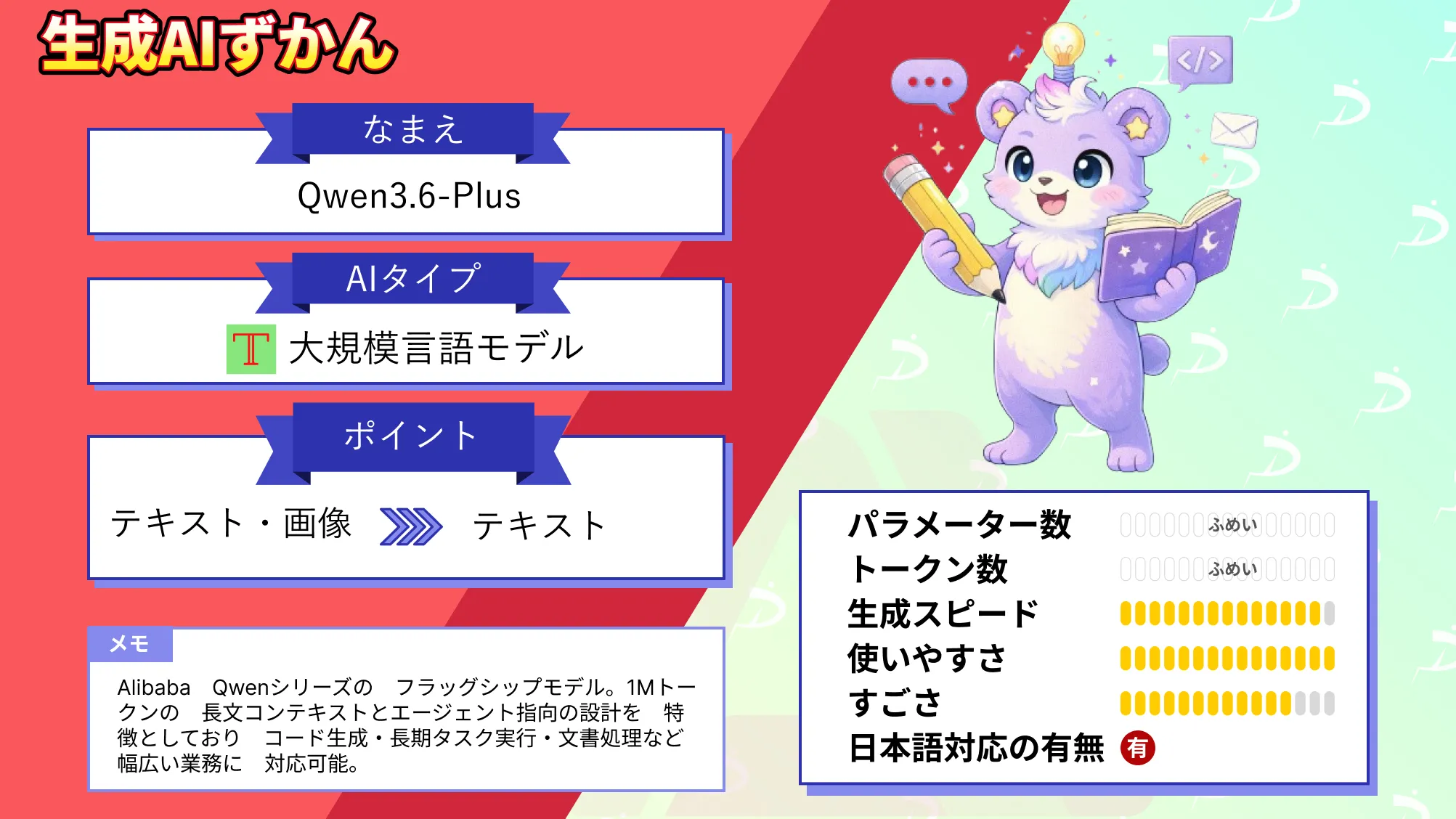

1Mトークン対応のエージェント型LLMであるQwen3.6-Plusについて、詳しく知りたい方は以下の記事も参考にしてみてください。

DeepSeek-V4のよくある質問

ここではDeepSeek-V4のよくある質問に回答していきます。実際に使用する前の参考にしてください。

DeepSeek-V4で実務AI活用を加速しよう

本記事では、DeepSeek-AIが開発したDeepSeek-V4シリーズについて、アーキテクチャから特徴、具体的な活用シーンまでを整理してきました。

DeepSeek-V4は、100万トークンという超長コンテキストと計算効率を両立した設計により、従来のLLMでは難しかった長文処理やエージェントタスクを現実的なコストで実行できる点が大きな特徴です。

一方で、知識系ベンチマークや高難度の指示遵守では最先端の商用モデルに及ばない部分もあり、用途に応じた適切な評価と使い分けが求められます。

現時点ではプレビュー版であり、今後の正式リリースに向けて性能改善や仕様変更が行われる可能性も十分に考えられます。特に長文コンテキストの安定性や推論精度、多言語性能の向上が進めば、より幅広い業務領域での実用性が高まるでしょう。

超長コンテキストを前提としたアプリケーション設計やエージェントワークフローは、今後のLLM活用における重要なテーマです。DeepSeek-V4はその流れを象徴するモデルの1つとして、今後の進化とエコシステムの広がりに注目しておきたい存在といえます。

最後に

いかがだったでしょうか?

DeepSeek-V4を活用することで、従来コンテキスト長の制約から困難だった長文書一括処理や長時間エージェントワークフローが現実的なコストで実現できます。一方で、超長コンテキストLLMの導入や業務への組み込みはシステム設計次第で効果が大きく変わるため、自社のユースケースに合ったモデルと推論モードの選択を慎重に進めることが重要です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。