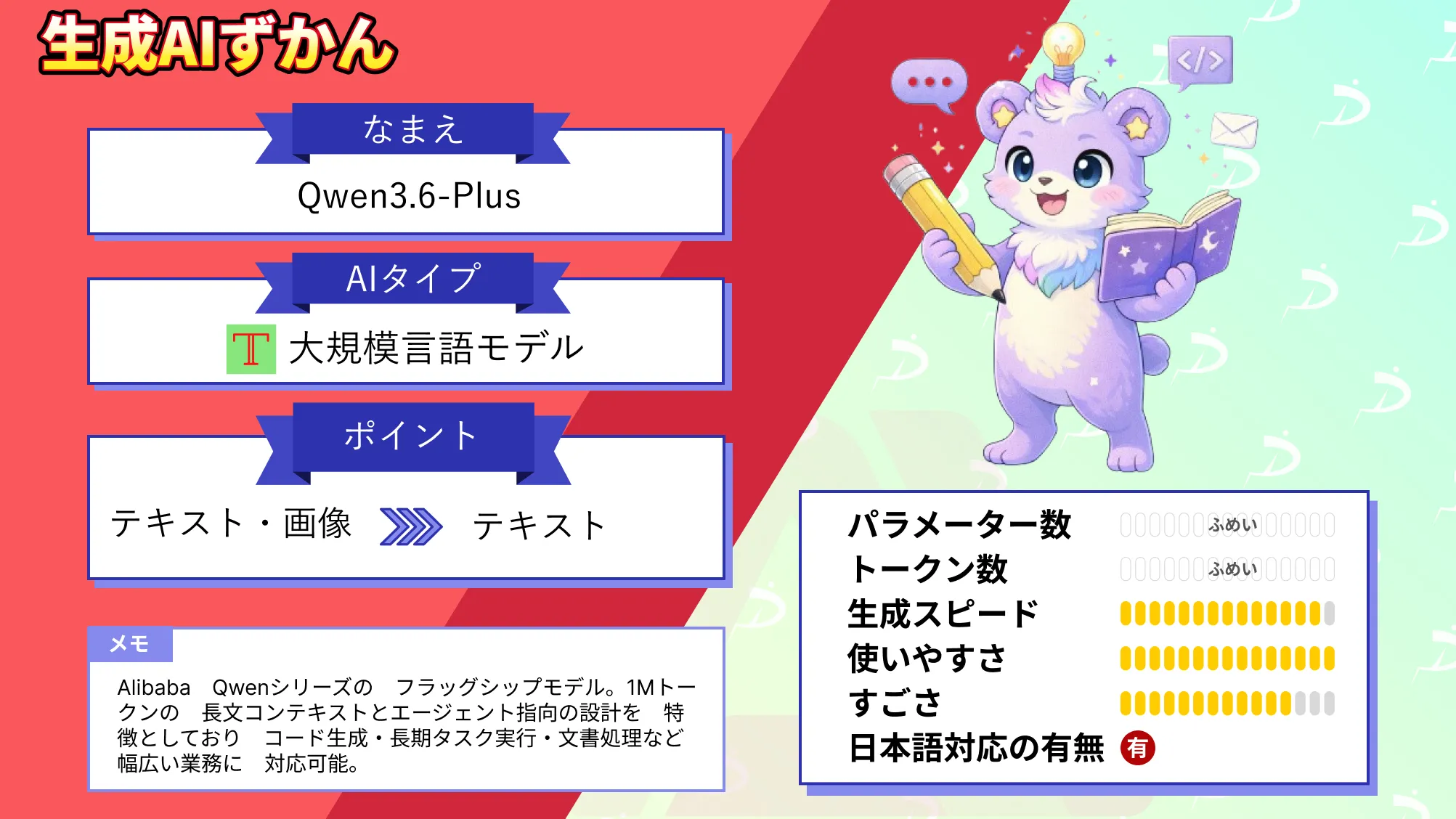

Qwen3.6-Plusとは?1Mトークン対応のエージェント型LLMを徹底解説

- Qwen3.6-Plusは1Mトークン対応と高いエージェント性能を備えた、実務向けのフラッグシップモデル

- OpenAI互換APIとAnthropic互換APIに対応し、Claude CodeやQwen Codeと連携しやすい点が強み

- 大規模コード修正、長期タスク実行、文書処理まで対応し、業務フロー全体の自動化に活用しやすい

2026年4月、AlibabaのQwenシリーズから新たなフラッグシップモデルが登場しました。

今回発表された「Qwen3.6-Plus」は、単なる大規模言語モデルの進化にとどまらず、実世界での活用を前提としたエージェント指向になっています。

コーディング支援やツール連携、長期的なタスク実行といった領域で性能が大幅に強化されており、従来モデルでは難しかった複雑な業務フローの自動化にも対応可能です。さらに、マルチモーダル理解や長文コンテキスト処理の精度も向上。

これまでのLLMは「単発の応答生成」に強みを持つ一方で、「継続的な思考」や「ツールを活用した問題解決」といった実務レベルのタスクでは限界がありました。Qwen3.6-Plusはこうした課題に対して、推論・記憶・実行を統合する設計によってアプローチしており、より自律的にタスクを遂行するAIへと進化しています。

しかし、新たな高性能モデルが登場するたびに、「従来モデルと何が違うのか」「どのようなユースケースで強みを発揮するのか」「実務でどこまで使えるのか」といった疑問を持つ方も多いのではないでしょうか。

そこで本記事では、Qwen3.6-Plusの概要や仕組み、特徴を整理しながら、どのような場面で活用できるのかを詳しく解説します。

最後までお読みいただくことで、本モデルがどのような思想で設計され、どのように実務へ組み込めるのかが理解できるはずです。

\生成AIを活用して業務プロセスを自動化/

Qwen3.6-Plusとは

Qwen3.6-Plusは、アリババクラウドのQwenチームが2026年4月にリリースした大規模言語モデルです。

「Towards Real World Agents(現実世界のエージェントへ)」をコンセプトに掲げており、Alibaba Cloud Model StudioのAPIを通じて利用できます。

これまでのAIモデルは、単純な質問応答には強かった一方で、複数ツールを組み合わせた長期タスクの自律実行では課題がありました。

Qwen3.6-Plusはこの課題に正面から取り組み、フロントエンド開発からリポジトリレベルの複雑な問題解決まで、エンドツーエンドで対応するエージェント能力を備えています。

また、OpenAI互換APIとAnthropic互換APIの両方をサポートしており、既存のツールチェーンへ組み込みやすい点も大きな特徴です。Claude Code、Cline、OpenCode、Kilo Code、OpenClawといった人気のコーディングアシスタントと連携して利用できます。

| 比較項目 | Qwen3.5-Plus | Qwen3.6-Plus |

|---|---|---|

| リリース時期 | 2026年2月 | 2026年4月 |

| コンテキストウィンドウ | 非公開 | 1Mトークン(デフォルト) |

| エージェントコーディング | 基本的な対応 | 大幅強化 |

| マルチモーダル | 対応 | 視覚・動画能力を強化 |

| APIプロトコル互換 | OpenAI互換 | OpenAI+Anthropic両対応 |

| preserve_thinking機能 | なし | あり(エージェント向け新機能) |

| 対応コーディングツール | 一部対応 | Claude Code・Cline・OpenClaw等 |

アリババの0.8B〜9Bの小型マルチモーダルAIであるQwen 3.5 Small Model Seriesについては、以下の記事も参考にしてみてください。

Qwen3.6-Plusの仕組み

Qwen3.6-Plusは、テキスト・画像・動画を統合的に処理するマルチモーダルモデルです。

「推論(Reasoning)・記憶(Memory)・実行(Execution)」を深く統合した設計により、単なる回答生成にとどまらず、ツールを使いながら複数ステップのタスクを自律的に処理できます。

中核となる機能として「Thinking Mode」があります。enable_thinkingパラメータをTrueに設定すると、モデルは回答前に内部で推論プロセスを実行し、複雑な問題に対してより精度の高い出力が得られます。

Falseに設定すると通常の応答速度で動作するため、タスクの性質に応じて切り替えることが可能です。

preserve_thinkingの仕組み

Qwen3.6-Plusで新たに導入されたpreserve_thinkingは、エージェントタスクにおける思考の一貫性を高める機能です。デフォルトではfalseに設定されており、最新ターンの思考内容のみが保持されます。

trueに設定すると、全ての前ターンの思考内容をメッセージ内に保持するため、長期タスクでの文脈の一貫性が向上します。

APIエンドポイント

Qwen3.6-Plusは、Alibaba CloudのModel Studio経由で提供されており、OpenAI互換およびAnthropic互換のAPIプロトコルに対応しています。

| プロトコル | エンドポイント(シンガポール) |

|---|---|

| OpenAI互換 | https://dashscope-intl.aliyuncs.com/compatible-mode/v1 |

| Anthropic互換 | https://dashscope-intl.aliyuncs.com/apps/anthropic |

| モデルコード | qwen3.6-plus |

Qwen3.6-Plusの特徴

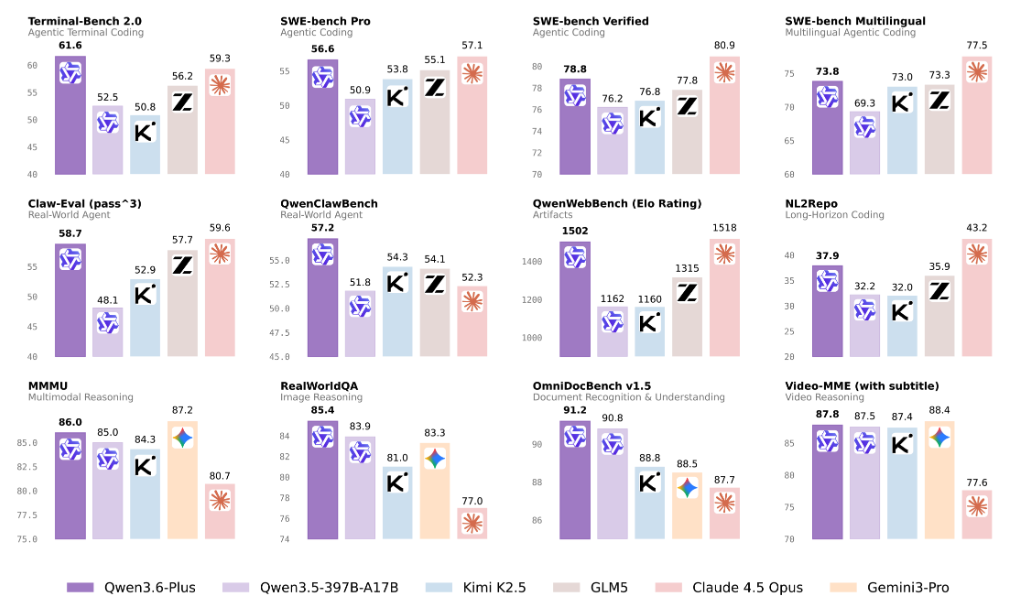

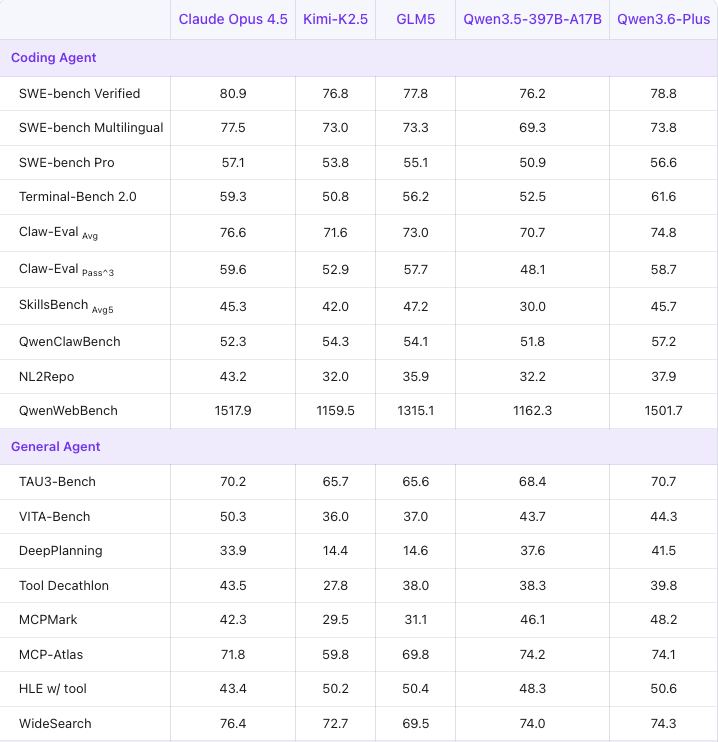

Qwen3.6-Plusの最大の特徴は、エージェントとしての実践的な総合性能です。コーディング・計画・ツール利用・マルチモーダル対応のいずれにおいても高い水準を示しており、「全方位型」のモデルとして設計されています。

| ベンチマーク | Claude Opus 4.5 | Kimi-K2.5 | GLM5 | Qwen3.5-397B | Qwen3.6-Plus |

|---|---|---|---|---|---|

| SWE-bench Verified | 80.9 | 76.8 | 77.8 | 76.2 | 78.8 |

| Terminal-Bench 2.0 | 59.3 | 50.8 | 56.2 | 52.5 | 61.6 |

| TAU3-Bench | 70.2 | 65.7 | 65.6 | 68.4 | 70.7 |

| DeepPlanning | 33.9 | 14.4 | 14.6 | 37.6 | 41.5 |

| MCPMark | 42.3 | 29.5 | 31.1 | 46.1 | 48.2 |

| GPQA | 87.0 | 87.6 | 86.0 | 88.4 | 90.4 |

| LiveCodeBench v6 | 84.8 | 85.0 | 85.5 | 83.6 | 87.1 |

AIエージェントコーディング能力

Qwen3.6-Plusは、コーディングエージェント性能の大幅な向上を最大の目標として開発されました。

Terminal-Bench 2.0では61.6点を記録し、これはClaude Opus 4.5(59.3点)を上回る最高スコアです。ターミナル操作の自動化や複雑なタスクの連続実行において、特に優れた実践的性能を発揮します。

SWE-bench Verifiedでも78.8点を記録しており、リポジトリレベルのバグ修正にも対応。

内部ベンチマーク「QwenWebBench」では1501.7点を記録し、3Dシーン・ゲーム・Webアプリなどの高度なフロントエンド実装でも強みを持ちます。

1Mトークンのコンテキストウィンドウ

Qwen3.6-PlusはデフォルトでMax 1Mトークンのコンテキストウィンドウを提供しています。

最大入力トークン数は通常モードで991K、Thinkingモード時は983Kです。数万行規模のコードベース全体を参照しながら修正作業を行うことが可能になっています。

マルチモーダル対応

テキストだけでなく、画像や動画の理解・処理能力も備えています。

文書理解ベンチマーク「OmniDocBench1.5」では91.2点を記録し、比較対象モデルの中で最高スコアとなっています。

UIスクリーンショット・設計モックアップ・プロダクトプロトタイプを読み取り、フロントエンドコードを生成する「ビジュアルコーディング」能力も強化。

動画理解においても、VideoMMEで87.8点を記録しており、時系列情報・動的変化・フレーム間の関係性を横断的に処理する能力が確認されています。

高い汎用エージェント・ツール利用性能

長期計画評価ベンチマーク「DeepPlanning」で41.5点を記録し、Claude Opus 4.5(33.9点)を大きく上回っています。MCP対応ツールの呼び出し評価「MCPMark」でも48.2点となり、Claude Opus 4.5(42.3点)を超えています。

TAU3-Benchでは70.7点を記録し、Claude Opus 4.5(70.2点)と同水準の汎用エージェント能力も示しています。

AlibabaのMoE型LLMであるQwen 3.5 Mediumについて詳しく知りたい方は、以下も参考にしてください。

Qwen3.6-Plusの安全性・制約

Qwen3.6-Plusを利用する際は、APIレートリミットおよびコンテキスト制約を事前に把握しておくことが重要です。

特にエージェントタスクで長時間処理を行う場合、トークン制限やリクエスト数の上限に注意する必要があります。

| 制約項目 | 値 | 補足 |

|---|---|---|

| 最大入力トークン(通常) | 991K | コンテキストウィンドウ1M内 |

| 最大入力トークン(Thinking時) | 983K | enable_thinking有効時 |

| 最大出力トークン | 64K | 通常・Thinking両モード共通 |

| RPM(1分あたりリクエスト数) | 15,000 | アカウント単位 |

| TPM(1分あたりトークン数) | 5,000,000 | アカウント単位 |

| 無料クォータ | 非対応 | 新規ユーザー向け無料枠なし |

Qwen3.6-Plusの料金

Qwen3.6-PlusはAlibaba Cloud Model Studio経由でAPI課金制で提供されています。料金はトークン単位で計算されます。

| 料金項目 | 単価(1Mトークンあたり) | 備考 |

|---|---|---|

| Input(入力) | $0.5 | 256K以下のリクエストに適用 |

| Explicit Cache Creation(キャッシュ作成) | $0.625 | 明示的キャッシュの作成時 |

| Explicit Cache Read(キャッシュ読み取り) | $0.05 | 明示的キャッシュの再利用時 |

| Output(出力) | $3 | — |

ツール呼び出し機能を利用する場合は、以下の追加料金が発生します。Responses APIを通じたツール呼び出しが対象です。

| ツール | 料金 | 備考 |

|---|---|---|

| web_search(Web検索) | $10/1K calls | — |

| code_interpreter(コード実行) | 期間限定無料 | 終了時期未定 |

| web_extractor(Webコンテンツ抽出) | 期間限定無料 | 終了時期未定 |

| i2i_search(画像→画像検索) | $8/1K calls | — |

| t2i_search(テキスト→画像検索) | $8/1K calls | — |

Qwen3.6-Plusのライセンス

Qwen3.6-PlusはAlibaba Cloud Model Studio経由でAPIとして提供されているホステッドモデルです。API経由での利用時のライセンスについては下記の通りです。

| 利用区分 | 可否 | 補足 |

|---|---|---|

| 商用利用 | 🔺 | 禁止記載なし/課金・API提供形態から商用前提と解釈される |

| 私的利用 | ⭕️ | 制限なし |

| 改変 | ❌ | モデル重み・構造へのアクセス不可 |

| 再配布 | 🔺 | アプリ経由での提供は可、モデル再配布は不可 |

| 特許利用 | ❌ | モデルの知的財産はAlibabaに帰属 |

マルチモーダルトークンの早期融合学習が採用されたアリババの次世代AIモデルであるQwen3.5-397B-A17Bについては、以下も参考にしてみてください。

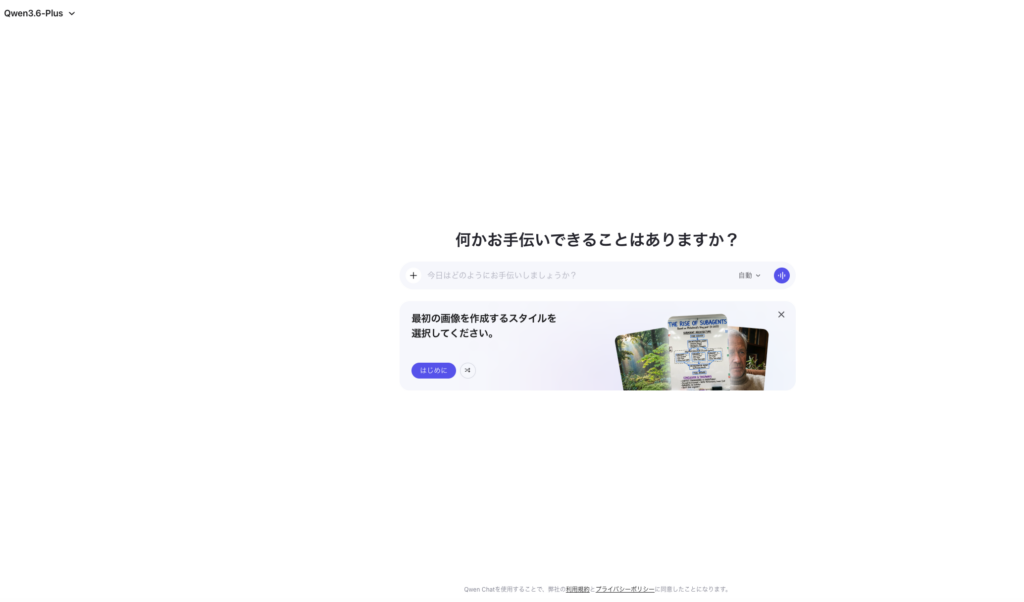

Qwen3.6-Plusの使い方

Qwen3.6-PlusはModel StudioのAPIもしくはチャットを通じて利用できます。ここではチャット画面で利用してみます。

左上のモデル名が「Qwen3.6-Plus」になっているのを確認して利用しましょう。

実際に応答している様子が下記です。

【業界別】Qwen3.6-Plusの活用シーン

Qwen3.6-Plusは、エージェントコーディング・マルチモーダル処理・多言語対応という3つの強みを持ちます。これらの特性を活かせる業界や用途は幅広く、さまざまなシーンでのAI自動化が期待されています。

ソフトウェア開発・IT

ソフトウェア開発では、コードレビュー・バグ修正・ドキュメント生成・テスト自動化など、エンジニアの日常業務の多くをAIエージェントに委ねる動きが進んでいます。

Qwen3.6-Plusは1Mトークンのコンテキストを活かして大規模リポジトリを丸ごと参照でき、複雑な依存関係を持つプロジェクトでも文脈を失わずに修正作業が可能です。

Claude CodeやOpenClaw、Clineといったターミナル型エージェントのバックエンドとして使用することで、「コード修正→テスト実行→エラー解析→再修正」のサイクルを自律的にこなすエンジニアリングアシスタントとして活用が期待されます。

ソフトウェア開発に関心がある方は下記の記事もおすすめです

Webフロントエンド・デザイン

Qwen3.6-PlusはUIのスクリーンショットや設計モックアップをインプットとして受け取り、対応するHTMLやCSSのコードを自動生成する「ビジュアルコーディング」に強みがあります。

そのため、デザイナーとエンジニアの橋渡し役として、Figmaのモックアップから動作するWebページを素早く生成するユースケースへの導入が考えられます。

GPTsでデザイン作成を行う方法について詳しく知りたい方は、以下の記事も参考にしてみてください。

企業の情報処理・業務効率化

文書理解ベンチマーク「OmniDocBench1.5」での高スコア(91.2点)が示すように、Qwen3.6-Plusは複雑な書類・表・チャートを含む文書の処理に優れています。

請求書・契約書・レポートなど大量のドキュメントを自動分類・要約する業務への活用が考えられます。

MCPプロトコル対応により、社内ツールとシームレスに連携したエージェントの構築も可能です。繰り返しの情報収集・整理作業を業務効率化する手段として期待されます。

ChatGPTによる契約書作成について詳しくは、以下も参考にしてみてください。

多言語コンテンツ制作・翻訳

WMT24++で84.3点、MMMLUで89.5点を記録しており、高精度な多言語処理が可能です。

グローバル展開を進める企業が、製品資料・サポートドキュメント・マーケティングコンテンツを多言語展開する際の支援ツールとして活用が見込まれます。

生成AIを活用した翻訳は下記も参考にしてください

AIを活用した活用事例について詳しく知りたい方は、以下の記事も参考にしてみてください。

Qwen3.6-Plusを実際に使ってみた

ここでは、Qwen3.6-PlusをAPI経由で利用、Claude Code、Qwen Codeそれぞれで使ってみたいと思います・

まずはAPI経由です。

API経由OpenAIのPython SDKを使ってQwen3.6-Plusにアクセスできます。base_urlをDashScopeのエンドポイントに切り替えるだけで、既存のコードをほぼそのまま流用できます。

なお、無料クォーターがあるので、有効にすれば課金されずに利用可能です。下記のコードをgoogle colaboratoryで実行します。

サンプルコードはこちら

!pip install openai -q

import os

os.environ["DASHSCOPE_API_KEY"] = "ここにAPIキーを入力"

from openai import OpenAI

client = OpenAI(

api_key=os.getenv("DASHSCOPE_API_KEY"),

base_url="https://dashscope-intl.aliyuncs.com/compatible-mode/v1",

)

completion = client.chat.completions.create(

model="qwen3.6-plus",

messages=[

{"role": "user", "content": "バイブコーディングの紹介"}

],

extra_body={

"enable_thinking": True,

# "preserve_thinking": True, # エージェント用途ならON推奨

},

stream=True

)

reasoning_content = ""

answer_content = ""

is_answering = False

print("===== Reasoning =====\n")

for chunk in completion:

if not chunk.choices:

continue

delta = chunk.choices[0].delta

# 思考過程

if hasattr(delta, "reasoning_content") and delta.reasoning_content:

if not is_answering:

print(delta.reasoning_content, end="", flush=True)

reasoning_content += delta.reasoning_content

# 最終回答

if hasattr(delta, "content") and delta.content:

if not is_answering:

print("\n\n===== Answer =====\n")

is_answering = True

print(delta.content, end="", flush=True)

answer_content += delta.content結果はこちら

===== Reasoning =====

We need to understand what "バイブコーディング" is. It's a Japanese term. "バイブ" likely comes from "vibe" and "コーディング" is "coding". So it might be "vibe coding". This is a recent trend in programming where developers use AI tools to generate code based on natural language descriptions, often in a relaxed, intuitive way, focusing on the "vibe" or feel rather than strict syntax. It's associated with tools like Cursor, GitHub Copilot, etc. The term might have been popularized by a tweet or article.

I should provide an introduction in Japanese as the query is in Japanese. The user said "バイブコーディングの紹介", so they want an introduction to vibe coding.

I'll structure the response:

1. Define バイブコーディング (vibe coding).

2. Explain its origin and context.

3. Describe how it works, typically using AI assistants.

4. Mention benefits and potential drawbacks.

5. Give examples or tools associated with it.

6. Conclude with its impact on programming.

I'll write in Japanese.

Let me draft:

バイブコーディング(Vibe Coding)は、AI アシスタントを活用して、自然言語による指示や直感的な「雰囲気」を基にコードを生成するプログラミングスタイルです。従来の厳密な構文や設計を重視する開発とは異なり、開発者が「やりたいこと」をざっくりと説明するだけで、AI がそれを実装してくれることを特徴とします。この用語は 2024 年頃に SNS やテックコミュニティで広まり、特に Cursor や GitHub Copilot などの AI コーディングツールと関連付けられています。

バイブコーディングの利点としては、プロトタイピングの高速化、学習コストの低減、創造的なアイデアの迅速な実現などが挙げられます。一方で、生成コードの品質管理やセキュリティ、メンテナンス性への注意が必要です。また、開発者の深い理解が伴わないと、デバッグが困難になる場合もあります。

代表的なツールには、Cursor、GitHub Copilot、Amazon CodeWhisperer、Replit Ghostwriter などがあります。これらのツールは自然言語処理とコード補完を組み合わせ、対話的にコード生成を支援します。

バイブコーディングは、AI と人間の協働による新しい開発パラダイムを示しており、プログラミングの民主化や生産性向上に貢献すると期待されています。ただし、適切なコードレビューやテスト、アーキテクチャ設計とのバランスが重要であり、完全に人間に取って代わるものではなく、補助ツールとして位置付けることが現実的です。

This seems comprehensive. I'll make sure it's accurate and up-to-date. The term "vibe coding" indeed gained traction around 2024. I should note that it's not an official methodology but a cultural trend.

Now, I'll output the response in Japanese as requested.

===== Answer =====

# バイブコーディング(Vibe Coding)とは

**バイブコーディング**とは、AI コーディングアシスタントを活用し、厳密な構文や設計ドキュメントよりも「直感」「雰囲気」「やりたいこと」を自然言語で伝えることで、対話的にソフトウェア開発を行うプログラミングスタイルです。2024 年頃から SNS や開発者コミュニティで広く認知され、**「AI と人間の協働による新しい開発パラダイム」**として注目されています。

## 🔑 核心的な特徴

- **自然言語駆動**: 「ログイン画面を作って」「データベースを接続して」などのざっくりとした指示で AI がコードを生成。

- **対話的イテレーション**: 生成結果を確認し、「もっとシンプルに」「エラー処理を追加して」と会話形式で修正を指示。

- **文脈理解**: AI がプロジェクト全体のファイル構造や既存コードを把握し、一貫性のある実装を提案。

- **低コード/ノーコードとの違い**: 最終的には標準的なコードベースが出力されるため、カスタマイズ性や拡張性が高い。

## 🛠 代表的なツール

| ツール | 特徴 |

|--------|------|

| **Cursor** | エディタ統合型、コードベース全体の理解、エージェントモード |

| **GitHub Copilot** | 補完・チャット機能、大規模エコシステム対応 |

| **Replit Agent** | ブラウザ完結、ワンクリックデプロイ、プロトタイピング特化 |

| **Windsurf / Codeium** | リアルタイム補完、マルチモデル対応 |

| **Lovable / v0** | UI 生成特化、デザインからコードへの変換 |

## ✅ メリット

- 🚀 **開発速度の劇的向上**: プロトタイピングや反復作業が数倍速く

- 📚 **学習ハードルの低減**: 構文暗記より「問題解決」に集中可能

- 💡 **創造性の解放**: アイデアを即座に形にできる実験的開発が促進

- 🌍 **プログラミングの民主化**: 非エンジニアも論理的思考で開発に参加可能

## ⚠️ 注意点・課題

- 🔍 **コード品質・セキュリティ**: 生成コードの検証、依存関係の管理、脆弱性チェックが必須

- 🧠 **過信リスク**: AI の誤りや hallucination(幻覚)を見抜くデバッグ能力が必要

- 📦 **メンテナンス性**: 生成コードの構造化不足により、長期保守が困難になる場合も

- 📜 **知的財産・ライセンス**: 訓練データの出典や出力コードの著作権に注意

- 🔄 **人間スキル**: 最終的にはアーキテクチャ設計、テスト、レビューの知識が不可欠

## 📈 適切な活用法

1. **補助ツールとして位置付ける**: AI は「共同作業者」であり「代替者」ではない

2. **プロトタイピング・反復作業に活用**: 定型コードや UI 生成で時間節約

3. **必ずレビュー・テストを実施**: 生成コードは必ず人間が検証し、単体テスト・統合テストを記述

4. **設計思想は人間が主導**: システムアーキテクチャ、セキュリティ方針、ビジネスロジックは開発者が決定

5. **継続的学習**: AI の出力を理解し、自身のコーディングスキル向上に繋げる

## 🔮 今後の展望

バイブコーディングは「AI がコードを書く」段階から「AI と人間が対話してシステムを共創する」段階へ移行しつつあります。今後は以下の進化が期待されます:

- エージェント型 AI による自律的な機能実装・デバッグ

- コード生成からテスト・デプロイ・監視までのフル自動化パイプライン

- ドメイン特化 AI による業界最適化されたコード生成

- オープンソースモデルの発展による透明性・カスタマイズ性向上

## 📚 参考情報

- [Cursor 公式ドキュメント](https://docs.cursor.com/)

- [GitHub Copilot 機能紹介](https://github.com/features/copilot)

- [The Rise of "Vibe Coding" - Tech Community Discussions](https://twitter.com/search?q=vibe%20coding)

- [AI コーディングのベストプラクティスガイド](https://www.notion.so/ai-coding-guide)

---

💡 **まとめ**: バイブコーディングは開発の「障壁」を下げる強力なツールですが、**「AI に任せる」のではなく「AI と共に考える」**姿勢が成功の鍵です。適切なガードレールを設け、人間の判断力を組み合わせて活用することで、次世代の開発体験を実現できます。

ご質問や特定のツールの詳細についてお気軽にお知らせください! 🚀Claude Codeとの連携

Qwen3.6-PlusはAnthropicのAPIプロトコルにも対応しているため、Claude Codeのバックエンドとして使用できます。

以下の環境変数を設定してからclaudeコマンドを起動するだけで、Claude Codeの開発体験をQwen3.6-Plusで再現できます。

コマンドはこちら

# Claude Codeのインストール

npm install -g @anthropic-ai/claude-code

# 環境変数の設定

export ANTHROPIC_MODEL="qwen3.6-plus"

export ANTHROPIC_SMALL_FAST_MODEL="qwen3.6-plus"

export ANTHROPIC_BASE_URL=https://dashscope-intl.aliyuncs.com/apps/anthropic

export ANTHROPIC_AUTH_TOKEN=<your_api_key>

# Claude Codeの起動

claude元々Claude Codeを使っている方は一旦ログアウトする必要があるのでclaude /logoutを実行してからclaudeを実行すればOKです。

実際にClaude CodeでQwen3.6-Plusを使っている様子が下記です。

Qwen Codeの利用

Qwenシリーズ向けに最適化されたオープンソースのAIエージェント「Qwen Code」も利用できます。初回サインイン後は、認証済みユーザーに対して1日あたり1,000回の無料呼び出しが提供されます。

コマンドはこちら

# Node.js 20以上が必要

npm install -g @qwen-code/qwen-code@latest

# 起動(インタラクティブセッション)

qwen

# セッション内コマンド

/help # ヘルプ表示

/auth # 認証方法の切り替え実際に使っている様子は下記です。

【課題別】Qwen3.6-Plusが解決できること

ここまでQwen3.6-Plusの性能を見てきましたが、重要なのは「実務でどの課題に使えるのか」という点です。

従来のLLMでは、長文処理や継続的なタスク実行、業務フローへの組み込みといった領域に課題が残っていました。Qwen3.6-Plusはこうした実務上の制約に対して設計されたモデルです。

ここではQwen3.6-Plusが解決できることをいくつか紹介していきます。

大規模コードベースの理解・修正ができる

1Mトークンのコンテキストウィンドウにより、数万行規模のプロジェクトを一括して参照できます。

依存関係の複雑なリポジトリでも適切なファイルを特定して修正を行うことが可能で、SWE-bench Verifiedで78.8点を記録しています。

長期マルチステップタスクの自律実行ができる

preserve_thinkingを有効にすることで、長期エージェントタスクにおける思考の一貫性を保てます。

DeepPlanningで41.5点(Claude Opus 4.5: 33.9点)を記録しており、「調査→計画→実行→検証」のサイクルを繰り返す複雑なワークフローに適しているでしょう。

大量文書の処理・要約ができる

文書理解能力が高く、OCR・チャート解析・長文のドキュメント要約に対応しています。

OmniDocBench1.5で91.2点を記録しており、ビジネスレポート・契約書・研究論文など構造が複雑な文書の一括処理に適しています。例えば、複数のPDF資料を横断して要点を整理したり、契約書の重要条項を抽出するといった用途に活用できるでしょう。

オープンソース動画生成AIであるWan2.1について詳しく知りたい方は、以下の記事も参考にしてみてください。

Qwen3.6-Plusの活用事例

Qwen3.6-Plusを使用している事例についてX上をリサーチしてみました。

Xで確認すると日本語に翻訳されており、読めるのですが上記投稿者はQwen3.6-PlusをClaude Codeに繋いで使ったところ、期待以上のWebサイトが生成されたとのことです。

ちなみに下記の投稿ではQwen3.6-PlusよりもCodexの方が良かったと報告をしています。

一つ目の投稿ではデザインが良かったとのことなので、もしかしたらQwen3.6-Plusにデザインをさせて、それをベースにCodexで実装していくのが良いのかもしれません。

Qwen3.6-Plusのよくある質問

ここではQwen3.6-Plusに関するよくある質問に回答していきます。

Qwen3.6-Plusの活躍に期待!

Qwen3.6-Plusについて、概要から仕組み・特徴・料金・活用方法まで解説しました。

Qwen3.6-Plusはフラッグシップモデルであり、単なる性能向上にとどまらず「実務で使えるエージェントAI」として設計されている点が特徴です。

推論・記憶・実行を統合したアーキテクチャにより、従来のLLMでは難しかった長期タスクの自律実行や複雑な業務フローの自動化に対応しています。

AIエージェントの実務活用を検討しているエンジニアやチームにとって、Qwen3.6-Plusは有力な選択肢の一つです。既存のOpenAI・Anthropic互換ツールへの組み込みやすさを考えると、まずは小さなタスクから試してみるのが良いでしょう。

ぜひ本記事を参考にQwen3.6-Plusを使ってみてください!

最後に

いかがだったでしょうか?

Qwen3.6-Plusを活用することで、大規模コードベースの管理からUI生成・マルチステップエージェントタスクまで、AIによる開発支援の幅が大きく広がります。一方で、エージェントAIの導入は設計次第で効果に大きな差が出るため、実装経験のあるパートナーと進めることも重要な選択肢です。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、大規模言語モデル(LLM)を対象に、言語理解能力、生成能力、応答速度の各側面について比較・検証した資料も配布しております。この機会にぜひご活用ください。

Qwen3.6-PlusはAIエージェント特化の大規模言語モデルです。Terminal-Bench 2.0やDeepPlanningなどのエージェントベンチマークでClaude Opus 4.5を上回るスコアを記録。1Mトークンのコンテキストウィンドウと新機能「preserve_thinking」により、複雑な長期タスクも安定して処理できます。OpenAI・Anthropic両APIと互換性があり、Claude CodeやClineなど既存ツールへの組み込みも容易です。本記事では仕組み・特徴・料金・使い方を解説します。