生成AIの仕組みと学習方法を解説!メリットやデメリット、おすすめの生成AIもご紹介

生成AIは、学習させることでより精度の高い回答を出力してくれるようになりますが、肝心の学習方法がわからないという方は多いのではないでしょうか。

生成AIの学習方法を知っているのと知らないのとでは、業務の生産性に大きな差が出るといっても過言ではありません。また、生成AIに学習をさせる前に、まずは生成Aの仕組み(機械学習)について知ることも重要です。

そこで今回は、生成AIの仕組みや生成AIの学習方法などをわかりやすく解説していきます。

最後まで目を通していただくと、自身で生成AIに学習させてより効率的にタスクをこなせるようになるはずです。ぜひ最後までご覧ください!

\生成AIを活用して業務プロセスを自動化/

生成AIの仕組みと機械学習

生成AIの仕組みは、開発・学習の過程で膨大なデータを読み込んで分析・解析し、プロンプト(指示)に従ってそのデータから関連性があると思われるものを組み合わせて、新たなコンテンツやアイデアを生成します。

その「0から1を生み出す」性質から、今ではビジネスシーンや日常生活で幅広く活用されています。

「0から1を生み出す」ことを実現させるために欠かせないのが、「機械学習」です。機械学習は、AIが大量のデータからパターンやルールを学習し、学習したデータを基にAIが新しいコンテンツ(文章、画像、音楽など)を「創造」するための重要な技術です。

生成AIにおける機械学習には、主に以下の4つのパターンがあります。

- 教師あり学習(Supervised Learning)

- 教師なし学習(Unsupervised Learning)

- 強化学習(Reinforcement Learning)

- 深層学習(Deep Learning)

それぞれの学習パターンについてはのちほど詳しく解説します。

この機械学習がなければ生成AIは単なるデータの集まりに過ぎません。機械学習は、生成AIの「創造力」の源であり、AIが人間のように新しいものを生み出すことを可能にしているのです。

教師あり学習(Supervised Learning)

教師あり学習とは、「教師」となる正しいデータをAIに与えて、教師から答えを教えてもらいながら学習する方法です。

たとえば、AIに犬について学習させる場合に、「犬の画像」と「犬」というラベルを大量に与える役割を教師データが行います。正解(ラベル)付きのデータを用いることで、AIは間違いを修正しながらより正確に予測できるようになります。

教師あり学習は、画像認識(犬猫の区別など)や迷惑メールフィルタリング、病気の診断などさまざまな分野で活用されています。

教師なし学習(Unsupervised Learning)

上の「教師あり学習」の逆パターンが「教師なし学習」です。言葉通り、AIが教師(正解データ)なしで、学習データから特徴やパターンを自力で見つけ出す方法です。

たとえば、色々な種類の果物を学習させる場合に、ラベル(正解)は与えずに画像だけをAIに大量に与えます。AIは画像の特徴(形、色、大きさなど)から、似たもの同士をグループ分け(グルーピング)したりデータ全体の構造を把握したりします。

「教師あり学習」と違って正解データを使わないため、AIは自力でデータの規則性を見つけ出さなければいけません。ラベル(正解)がないため、必ずしも正しい答えになるとは限りませんが、データに隠された意外な関係性やパターンを発見できる可能性もあります。

また、繰り返しグルーピングすることで、明確な答えを与えなくても自動的に共通点を見つけられるようになります。

教師なし学習は、顧客のグループ分け(似た購買行動を取る人をまとめる)、異常検知(通常とは異なるデータを見つける)、レコメンドシステム(好みが似た人におすすめの商品を提示する)などに活用されています。

強化学習(Reinforcement Learning)

強化学習とは、AIが「試行錯誤」を通して最適な行動を学習する方法です。強化学習を行うことで、生成AIによる効率化や最適化が可能になります。

たとえば、ゲームで高得点を取れるようAIに学習させるとします。AIがゲーム内で様々な行動を試す中で、良い結果(敵を倒す、アイテムを獲得するなど)が得られたら「報酬」を与え、悪い結果(ゲームオーバーになるなど)になったら「罰」を与えます。AIは何度も試行錯誤を繰り返し、「報酬」を最大化するパターン、つまりゲームで高得点を取るための最適な戦略を学習していきます。

これは、人間が自転車の乗り方を練習するのに似ていますね。何度も転びながら、バランスの取り方やペダルの漕ぎ方を学習していくのと同じです。

強化学習は、囲碁や将棋の対戦AI、自動運転、株取引などさまざまな分野で応用されています。

深層学習(Deep Learning)

「ディープラーニング」と呼ばれる深層学習は、多層のニューラルネットワーク(人間の脳の神経回路に似た仕組み)を使って、AIが自ら大量のデータを学習し自動的に重要な要素を見つけ出す方法です。

たとえば、猫の画像データを大量に与えると、AIが画像の中から猫のさまざまな特徴を自動的に学習し、「これは猫だ」と認識できるようになります。人間が「猫はこういうものだ」とわざわざ教える必要がないのが大きな特徴で、他の学習方法と異なる点です。

従来の機械学習では人間がデータの特徴を教えてあげる必要がありましたが、ディープラーニングではコンピューター自身がデータから学習するため、より複雑なデータ(画像、音声、文章など)の認識や処理、予測、分析が可能となりました。

画像認識、音声認識、自然言語処理など、今では身近な生成AI技術の多くにディープラーニングが活用されており、機械学習に飛躍的な進展をもたらしています。

方法次第では生成AIに学習させることも可能

さきほどの機械学習のように、特別な技術や知識が必要な学習方法は開発者や技術者にしかできません。では、生成AIは開発者にしか学習させられないのかというと、実はそうではなく、方法次第では利用者側でも学習させられます。

まず、生成AIはディープラーニングと呼ばれる技術を使い、膨大なデータを基にパターンを学習しているのが特徴です。

その後、特定の目的に応じた調整が必要な場合にはファインチューニングが実施され、特定のタスクや領域に合わせた精度の高い生成が可能になります。

また、外部の知識ベースを参照して信頼性が高い情報を生成する、RAG(Retrieval-Augmented Generation)と呼ばれる学習方法も有用です。

それぞれの学習方法については、次項で解説します。

生成AIに学習・引用させる方法を紹介

生成AIに学習・引用させる方法には、以下の3つがあります。

- Few-Shotプロンプティング

- RAG

- ファインチューニング

それぞれの特徴や仕組みを紹介していくので、ぜひ参考にしてみてください。

Few-Shotプロンプティング

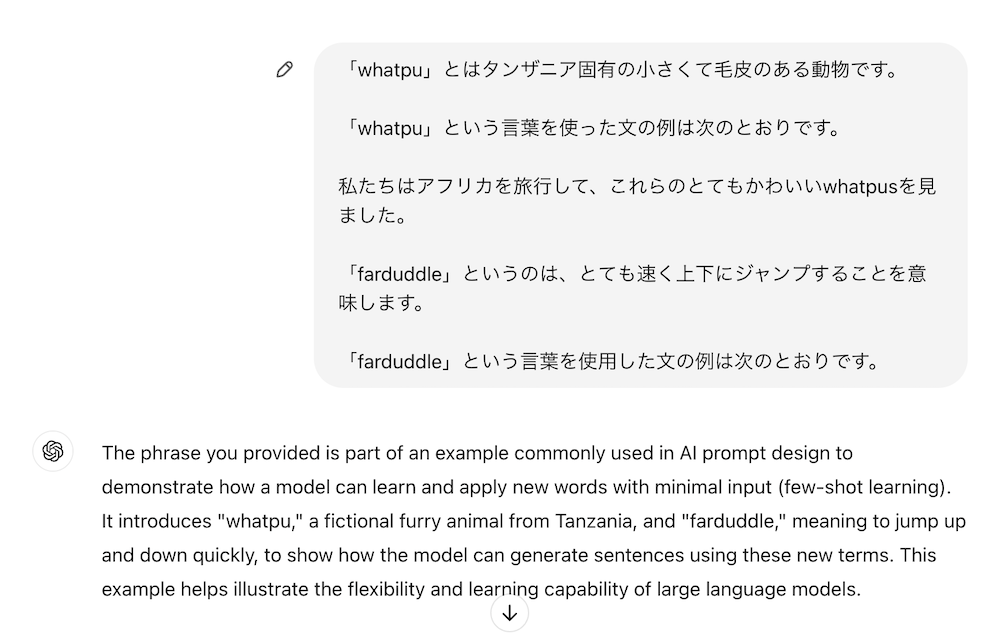

Few-Shotプロンプティングとは、LLMのプロンプトに学習範囲外の知識を挿入する手法のことです。生成AIから、より適切で精度の高い回答を引き出すテクニックであるプロンプトエンジニアリングの1種です。

Few-Shotプロンプティングを用いてLLMにいくつかの例を事前に提示することで、LLMが知らない単語についても回答を生成できるようになります。

CSVファイル・PDFファイル・URLの提示もこれに該当するので、知らずに実行している方も多いのではないでしょうか。

以下にChatGPTを使って具体的な例を挙げてみます。

今回の場合は英語で表示されてしまいましたが、「ゲームに勝ったとき、みんなでfarduddleを始めました。」という文章を出力してくれました。

非エンジニアにもできる簡単な方法ですが、この手法は厳密には学習ではなく一時的なもので、新しい会話には反映されません。また、1度の会話で入力できるデータ量に限りがあるため、たとえば社内データなど膨大な量のデータを学習させることには向いていませんので、覚えておきましょう。

RAG

RAGとは、外部のデータベースと連携してテキストを生成する技術のことです。ユーザーの質問(クエリ)に対して、関連する情報をデータベースから検索し、検索した情報を基に回答を生成してくれます。

最新の情報に基づいた回答も可能になるため、古くて間違った情報を出力してしまう心配もいりません。

なお、より高度な技術としてRAG Fusionというものも存在します。「LLMによる追加質問の生成」と「リランキング」の工程を加えることにより、さらに専門性の高い内容にも回答できるのが魅力です。

ファインチューニング

「ファインチューニング」とは、事前トレーニング済みのAIモデルに微調整を加えて、特定のタスクに特化した処理能力を向上させる手法です。LLMのモデルそのものに、知識や文体を学習させる方法ともいえます。

よくRAGと混同されがちですが、両者は生成AI自体に学習させるかどうかといった根本的な違いがあります。再トレーニングするファインチューニングに対し、RAGはデータベースだけ与えて生成AIに学習はさせていません。

なお、生成AIに自社データを学習させる方法について詳しく知りたい方は、下記の記事を合わせてご確認ください。

生成AIの各学習方法でできること・メリット

生成AIの各学習方法でできること・メリットを以下にまとめました。

- 学習範囲外の事実についての回答

- 特定のタスク・文体への特化

- ハルシネーションの軽減

それぞれの学習方法を取り入れることで、生成AIの精度や応用力が向上します。

以下でメリットを詳しく紹介するので、ぜひ参考にしてみてください。

学習範囲外の事実についての回答

Few-Shotプロンプティングを活用することで、生成AIは提示された例から新しい事実や概念を学習し、それに基づいて応答を生成できます。

学習範囲外のトピックに対する対応力が向上するので、予め学習されていない情報にも柔軟に対応できるのが魅力です。これにより、専門的な質問や新しいトピックへの迅速な対応が可能となるため、応用範囲が広がります。

特定のタスク・文体への特化

ファインチューニングにより、生成AIは特定のタスクや文体に適応します。特定分野の専門的な文章作成や、特定の書き方や表現スタイルに沿った生成が実現され、より精度の高い結果が得られるのがメリットです。

プラットフォームごとにそれぞれ適している文体は異なりますが、こういった問題に柔軟に対応できるのがポイントです。

ハルシネーションの軽減

ハルシネーションを軽減するためには、RAG技術が効果的です。外部データベースから正確な情報を取り込むことで、AIは信頼性の高い情報を提供して、誤った内容を含むリスクを低減できます。

なお、ハルシネーションとは、生成AIがまるで幻覚のように虚偽の情報を出力する現象のことです。生成AIを利用する際の課題として、しばしば取り上げられています。

生成AIの各学習方法の注意点・デメリット

生成AIに学習させると、多様なメリットがある一方で、速度・コスト・正確性に関するデメリットも存在します。

おもなデメリットを以下にまとめました。

- 回答速度の低下

- 開発・維持のコスト

- ハルシネーション

それぞれの注意点やデメリットを理解して、正しく対処しましょう。

回答速度の低下

生成AIは、学習モデルが複雑化するほど、処理に時間がかかり回答速度が遅くなる傾向があります。

とくに、ファインチューニングや大規模なデータ参照が必要なRAG(知識を検索して利用するプロセス)を利用する場合は、応答速度に影響が出るので注意しましょう。

学習させるデータ量が多すぎるのがおもな原因のため、本当に必要なデータに絞って学習させることが大切です。

開発・維持のコスト

生成AIのファインチューニングやRAGを実装・運用するには、高度な技術や大規模なデータセットが必要です。開発やモデルの維持には多大なコストがかかるため、小規模なプロジェクトには向きません。

なお、Few-Shotプロンプティングはプロンプトを工夫するだけなのでコストは発生しませんが、学習方法としては弱いです。本格的に生成AIを学習させる際は、ある程度予算に余裕を持ってプロジェクトを進めましょう。

ハルシネーション

RAGなどでハルシネーションを軽減できるとはいえ、完全になくなるわけではありません。とくに、学習データに偏りがある場合や、Few-Shotプロンプティングなどの簡易な方法では、誤った情報が生成される可能性があります。

あらかじめハルシネーションのリスクについて理解しておき、ファクトチェックを徹底するなどの対策が有効です。

全ての学習方法に対応した生成AI4選

ここでは、Few-Shotプロンプティング・RAG・ファインチューニングの全てに対応したLLMを紹介します。

今回紹介する生成AIは、以下の4つです。

- GPT-4o

- Gemini 1.0 Pro

- Claude 3 Haiku

- Llama3

それぞれの生成AIの特徴や学習方法に関連する情報を紹介するので、ぜひ参考にしてみてください。

GPT-4o

GPT-4oは、今や知らない人のほうが珍しいChatGPTに搭載されているAIモデルです。GPT-4の時点でFew-ShotプロンプティングとRAGに対応していたのですが、GPT-4oになってからファインチューニングもできるようになりました。

100万トークンあたり25ドルといった別料金が発生しますが、ChatGPTの精度を高めるためには最適な手段です。

すでに、DistylAIがGPT-4oをファインチューニングして利用しており、意図の分析や思考の連鎖などのタスクで高いパフォーマンスを発揮しています。

なお、GPT-4oについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

Gemini 1.5 Pro

Googleが提供しているGemini 1.5 Proも、Few-Shotプロンプティング・RAG・ファインチューニングの全てに対応しています。

Few-Shotプロンプティングをそのままチャットに入力するだけで対応可能で、RAGとファインチューニングに関してはAPIを利用することで対応可能です。

RAGとファインチューニングは、Google Colab上でGemini APIを呼び出して利用できるので、気になる方は試してみてください。

なお、Geminiについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

Claude 3 Haiku

Claude 3 Haikuは、Anthropicが提供しているLLMで、軽量ながらも高速なパフォーマンスを実現している点が特徴です。こちらのモデルもFew-Shotプロンプティング・RAG・ファインチューニングの全てに対応しています。

ほかのLLMと同様、Few-Shotプロンプティングは公式Webサイトのチャット上から利用できますが、RAGとファインチューニングに関してはAPIを通じて設定する必要があります。

なお、Claude 3について詳しく知りたい方は、下記の記事を合わせてご確認ください。

Llama3

Llama3は、Meta社が提供しているLLMです。8Bモデルと70Bモデルが公開されていますが、70Bの微調整モデルは、Gemini Pro 1.5をも凌ぐ性能を備えています。

なお、Llama3も本記事で紹介したすべての学習方法に対応しており、より専門性の高いタスクを実行できます。Python環境・外部のデータセット・ライブラリなどがあれば、RAGやファインチューニングも対応可能です。なお、最新モデルのLlama3.3について詳しく知りたい方は、下記の記事を合わせてご確認ください。

生成AIの学習における下準備の方法も紹介

生成AIに学習させる際は、以下の下準備が必要です。

- 前処理

- アノテーション

それぞれの下準備を実施するのとしないのとでは、RAGやファインチューニングを実施したあとのAIモデルのパフォーマンスが大きく変わってきます。

以下でそれぞれ紹介するので、この機会に覚えておきましょう。

前処理

前処理とは、統一感のないデータをAIにとって扱いやすい形に加工する工程のことです。回答精度や予測精度を高められるのがメリットのため、ファインチューニングやRAGを実施する際には欠かせません。

前処理にはいくつか種類がありますが、記号や重複箇所を削除するデータクレンジングや表記揺れを統一する正規化などがあります。

アノテーション

アノテーションとは、それぞれのデータに対して意味付けやラベル分けなどをする工程のことです。テキスト・画像・動画・音声など、さまざまな形式のデータに対応したアノテーション手法が存在します。

アノテーションを実施すると、AIモデルがビッグデータを効率的に管理・活用できるようになり、動作が安定するのがメリットです。ファインチューニングやRAGを実施する前にアノテーションをおこなうことで、より高精度なAIモデルが出来上がります。

なお、アノテーションについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

生成AIの学習方法を理解して業務の効率化を加速させよう!

生成AIを学習させれば、より精度が高まるほか、特定のタスクに特化した専門性の高いAIモデルに仕上げられます。

生成AIの学習方法として、よく利用されているのは以下の3つです。

- Few-Shotプロンプティング

- RAG

- ファインチューニング

各手法を取り入れて生成AIを学習させると、以下のようなメリットを受けられます。

- 学習範囲外の事実についての回答

- 特定のタスク・文体への特化

- ハルシネーションの軽減

反対に、以下のようなデメリット・注意点もあるので覚えておいてください。

- 回答速度の低下

- 開発・維持のコスト

- ハルシネーション

なお、生成AIに学習させたいと考えている方は、以下のAIモデルを利用するのがおすすめです。

- GPT-4o

- Gemini 1.0 Pro

- Claude 3 Haiku

- Llama3

これら4つのモデルはすべての学習方法に対応しているので、より広範囲のタスクに対応できるようになります。

AIモデルをそのまま使用していて回答の不正確さなどが気になる方は、一度生成AIの学習を試してみてください。

最後に

いかがだったでしょうか?

生成AIの学習方法を理解することで、貴社のプロジェクトの生産性を大幅に向上させることが可能です。効率的な学習戦略でAIを最大限に活用し、業務改善を加速させましょう。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。