ChatGPT活用で注目!Embedding(エンべディング)とは?ファインチューニングとの違いや活用事例を解説

WEELメディア事業部AIライターの2scです。

みなさん、ChatGPTを業務に活用する際に欠かせない技術「エンベディング」をご存知ですか?

弊社・株式会社WEELでは過去に、エンベディングとChatGPTの組み合わせで業務の工数を90%削減した開発事例があります。

また人気バーチャルタレントの分身を作る企画にも、このエンベディングが使われていて……

このように、ホットな技術なんです。

当記事では、そんなエンベディングの生成AI分野での活躍ぶりを紹介!そのしくみやメリット・デメリット、開発事例までをお伝えしていきます。

完読いただくと、ChatGPTで自動化できる業務の幅が広がるはずです。

ぜひ最後までお読みください!

\生成AIを活用して業務プロセスを自動化/

エンベディングとは?

「エンベディング / Embedding」とは、ベクトル空間上にデータを配置する技術です。

と、説明されてもその実態が掴みづらいですよね。

そこでベクトル空間を「図書館の本棚」、各データを「書籍」に例えて考えてみましょう。

まずベクトル空間の特性として……

● 似た者同士のデータでは距離が小さい

● 互いに無関係なデータでは距離が大きい

というものが挙げられます。

これを図書館の本棚で言い表すと、ジャンルごとに本棚が分けられている状態となります。

そこに各データ、すなわち書籍を入れていくわけですが……

- 昆虫図鑑と魚図鑑

- 純文学とプログラミングの技術書

であれば前者、生き物の図鑑同士のほうを近くに置きたいですよね。その方が書籍を探しやすくなるはずです!

このようにして、検索性を損ねずに膨大なデータを格納する技術こそがエンベディングなのです。

ちなみにエンベディングは和訳すると「埋め込み」になります。ベクトル空間上にデータを埋め込むという言い回しです。

エンベディングの身近な活用例

エンベディングは、あらゆる検索エンジンの基礎となる技術です。

入力内容に対して、ベクトル空間上で似ているデータを探して出力する、というのが検索エンジンの本質です。

身近な例を3つ挙げると……

- Googleのテキスト&画像検索

- Netflixのレコメンデーションシステム

- AIチャットボット

はすべて、エンベディングの上に成り立っています。(※1)

そう、みなさんがこの記事にたどり着いたのも、エンベディングのおかげなのです!

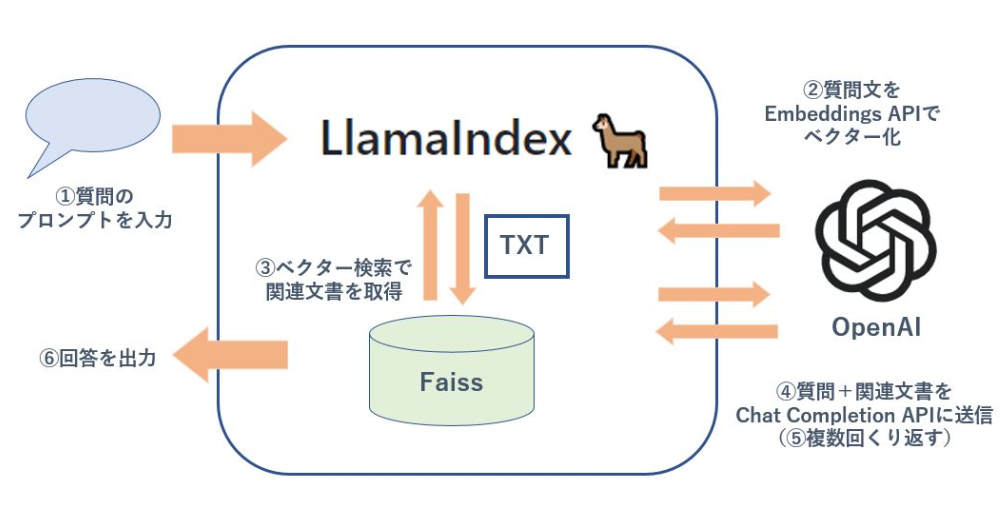

なお、エンベディングが使えるPythonライブラリ・Llamaindexについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

なお、エンベディングが使えるPythonライブラリ・Llamaindexについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

なぜ生成AIにエンベディングが必要なのか

先ほど紹介したとおり、エンベディングはAIチャットボットに欠かせない技術です。

ここではなぜ、エンベディングと生成AIを組み合わせるのか、その理由を解説します。

まずは生成AI側の致命的な欠点からみていきましょう!

大規模言語モデル(LLM)の限界

そもそもAIチャットボットには、ChatGPTなどの大規模言語モデル(LLM)が使われています。このLLMは人間さながらの文章が生成できるのですが……

● ハルシネーション(事実とは異なる回答)が生じてしまう

● 自社データや専門知識など、ニッチな事実を知らない

● プロンプト(入力文)で示せる事実には限りがある

といった、致命的な欠点を抱えています。チャットボットとして運用する場合、なにか「必要な事実だけをプロンプトに添えてくれる技術」を組み合わせないと使い物になりません。

LLMの欠点を補うエンベディング

この「必要な事実だけをプロンプトに添えてくれる技術」こそがエンベディングです。LLMとエンベディングを組み合わせたAIチャットボットでは……

AIチャットボットのしくみ

- ユーザーが質問する

- 質問に関連する事実をデータベースから検索する(RAG)

- 関連性の高い事実だけを質問に加筆する(Few-shot Learning)

- 事実に基づいた回答が生成される

というふうにして、回答の信ぴょう性を高めています。(※2)

実はこのエンベディング以外にも、生成AIに事実を学ばせる方法として「ファインチューニング / 追加学習」というものがあります。

次の見出しでRAGの概念を押さえた後、両者の違いを比較していきましょう!

そもそもRAGとは?エンベディングとの関係

RAG(Retrieval Augmented Generation:検索拡張生成)とは、生成AIが回答を生成する際に、外部データベースから関連情報を検索し、それをプロンプトに追加して回答精度を向上させる手法です!

エンベディング技術は、この検索プロセスに不可欠で、データをベクトル化して効率的に検索します。

そのため、RAGを活用したAIチャットボットでは、質問内容に最も近い情報だけを的確に提供することができるので、回答の信頼性が高まります。

一般企業でChatGPTを活用する際に課題となる「ハルシネーション(誤回答)」を減少させる効果もあるんです。

エンベディングとファインチューニングの違い

エンベディングもファインチューニングも、生成AIに事実を教えるための手法です。ただ、両者では……

【エンベディング】

データベースを生成AIに外付けする技術

【ファインチューニング】

データベースを生成AIのモデルそのものに取り込ませる技術

となっており、生成AIに対するアプローチが違います。結果として、下表のような具体的な違いがあらわれます。

| エンベディング | ファインチューニング | |

|---|---|---|

| 学ばせる内容 | 自社データや専門知識など、ニッチな事実 | 一般的な業界知識 |

| 変えられるもの | 回答の精度・信ぴょう性 | 回答の口調や概念理解 |

| 開発費用 | 比較的安価 | 高価(エンベディングの8倍程度) |

| 用途 | AIチャットボット / カスタマーサポート | デジタルクローン / クリエイターの絵柄を再現する画像生成AI |

両者のうち、高い精度が実現できて手軽なのはエンベディングのほうです。

対してファインチューニングは、業務上の用途には向いていません。

ファインチューニングの手順

ファインチューニングは、大規模言語モデル(LLM)に自社データを追加学習させることで、応答の正確性やトーンを組織向けに最適化するプロセスです。

ここでは OpenAI GPT‑3.5/GPT‑4 API を例に、クラウド環境での一般的な実施フローをステップバイステップで解説します。

1.目的定義

まずは追加したい知識領域と数値目標(例:FAQ 正答率 95%)を設定し、関係者と共有します。

2.データ収集

過去の問い合わせ履歴、ナレッジベース、チャットログなどを集め、1 ペア=1 質問&回答形式で抽出します。

3.データクリーニング

個人情報や機密情報をマスキングし、誤字脱字・重複を除去。1 サンプル 500 文字以内を目安に要約します。

4.データラベリング

JSONL 形式で {“prompt”:”質問”,”completion”:”模範回答”} に統一し、最低 500〜1,000 ペアを用意します。

5.フォーマット検証

openai tools fine_tunes.prepare_data -f data.jsonl で整形し、警告・エラーをゼロにします。

6.学習ジョブ実行

openai api fine_tunes.create -m gpt-3.5-turbo -t data_prepared.jsonl -n “proj_finetune_v1” を実行し、JOB_ID を控えます。

7.進行モニタリング

openai api fine_tunes.follow -i <JOB_ID> でログを確認し、完了通知を待ちます。

8.検証と微調整

テストセットで回答精度を測定し、基準を満たさなければデータを追加/ハイパーパラメータを調整して再学習します。

9.デプロイ

完了したモデル ID を本番システムから呼び出し、通常の ChatGPT API と同じ要領で利用開始します。

以上の流れを押さえておけば、社内のチームでも短期間かつ低リスクでチューニングを回すことができます。

まずは小規模データで試し、効果測定をしながら段階的に拡張してみてください。

運用後は定期的に誤答をレビューし、データセットを磨き続けることで精度がさらに向上します。

なお、ファインチューニングに関しては下記の記事を参照してください。

エンベディングを使うメリット3つ

ここではエンベディングと生成AIの組み合わせがもたらす、社内業務上のメリットを3つ紹介していきます!

社内データを回答に反映できる

エンベディングを使えば、本来LLMが知り得ないような事実まで回答に反映させられます。たとえば……

- 契約書

- 議事録

- カタログ

- マニュアル

- 機材の取扱説明書

といった社内データを扱う、AIツール・チャットボットが開発できるのです。これだけで、膨大な資料を人力で集める工程が省けますね。

回答の再現性が高められる

同じ命令を繰り返し入力した場合、素のLLMはその都度、回答をランダムに生成します。これでは再現性が低く、型が決まっている業務への応用が難しいですよね。

そこでエンベディングの出番です!エンベディングなら、LLMに社内文書や回答のテンプレートが示せます。さらに回答の参考元となったデータも表示できるのです。

ある程度ハルシネーションが抑えられる

LLMはしばしば、事実とは異なる回答つまり「ハルシネーション」を知ったかぶりで生成してしまいます。

一般企業において、生成AIの導入がなかなか進まない理由はこのハルシネーションにあります。

この厄介なハルシネーションをある程度抑えてくれるのが、エンベディングです。

社内データをプロンプト経由でLLMに示すことによって、その範囲内で正確な回答が生成されます。

なお、ハルシネーション等の生成AIのリスクについて詳しく知りたい方は、下記の記事を合わせてご確認ください。

エンベディングを使うデメリット3つ

エンベディングと生成AIの組み合わせには、デメリットも存在します。

ここからは、業務活用時に限定して、エンベディングのデメリットを3つ紹介!

まずは開発時のデメリットから、詳しくみていきましょう。

データ整形に手間がかかる

エンベディングを使って自社データをLLMに示す場合、データの品質が回答精度を左右します。そのため自社データの整形が必要なのです。

データの整形はExcelで完結するため、IT人材不在の一般企業でも取り組めます。ただ、その作業は以下のとおり煩雑です。

● 名寄せ:複数のデータを1つのファイルに統合する

● データクレンジング:データの表記を統一する

→重複の解消 / 空白の解消 / 全角半角の統一…etc.

● マニュアル作成:クレンジングのルールを定める

このようにエンベディングでは活用の前段階にて、時間的・経済的なコストがかかってしまうのです。

回答速度が低下する

エンベディングとLLMを組み合わせた場合、回答の速度が低下します。これは毎度プロンプトをLLMに送る前に、ネットワーク経由でデータベースを確認する工程が挟まるためです。物理的な問題であるため、これを解決する手段はありません。

チャットボットを社外に公開する際、回答速度については期待しないほうがよいでしょう。

ハルシネーションがなくなるわけではない

たとえエンベディングを駆使したとしても、ハルシネーションを完全になくすことはできません。

例を挙げると、ごみ出し案内業務にてChatGPTの活用を試みた香川県三豊市では……

● 目標の正答率99%にわずかに届かず、正答率が94%で止まってしまった

● わずかでもハルシネーションが混ざると、市民や収集業者に迷惑がかかる

● 結局のところ、職員が回答を確認することとなった

という理由から、ChatGPTの導入を見送っています。絶対に間違えてはいけない業務では、まだまだ生身の人間が必要なのです。(※3)

エンベディングを活用した開発事例3選!

ここからは、エンベディングを活用した開発事例を3つだけ紹介します。まずは、どの企業でも取り入れやすい社内業務での活用事例から、みていきましょう!

社内ヘルプデスク業務の自動化

エンベディングとLLMを組み合わせれば、社内のヘルプデスク業務の負担が減らせます。GMOのグループ研究開発部門の例をみていきましょう。

GMOでは、自社のVPSサービス「Conoha」のAPIについて答えてくれるQ&Aツールを試作しているのですが……

このように、エンベディング(Llamaindex)とChatGPTを駆使して、社内データを回答に反映させています。(※4)

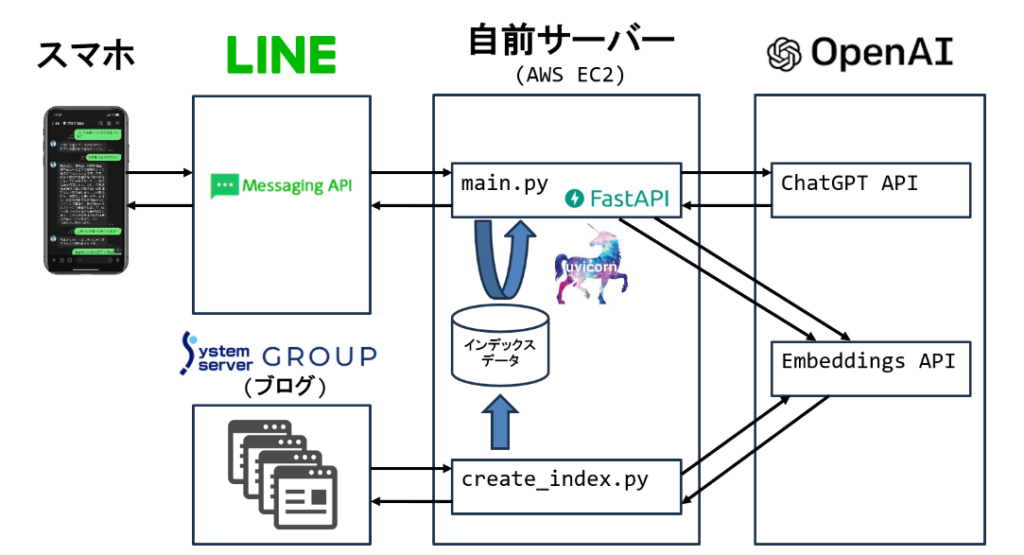

社外向けのQ&Aツール

社外向けのカスタマーサポート業務でも、エンベディングとLLMが活躍します!

株式会社システムサーバーが開発した、LINEアプリ上で自社ブログの内容について質疑応答ができるチャットボットについて、しくみをみてみると……

このように、自社ブログの内容をエンベディング(Llamaindex)でインデックスデータに格納しています。(※5)

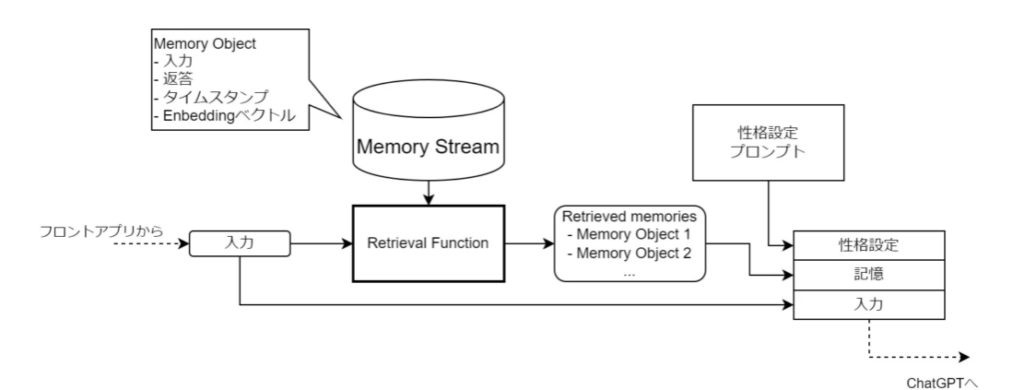

バーチャルタレントのデジタルクローン

エンターテイメント業界でも、エンベディングとLLMが活躍しています。今回取り上げるのは、大手VTuber事務所を運営しているカバー株式会社の事例です。

同社に所属する登録者数100万人超えの人気VTuber・博衣こよりさんの企画で、自身のデジタルクローン『AIこより』と対話するというものがあるのですが……

このように『AIこより』の記憶システムにも、エンベディングが活用されているんです!エンベディングによって、過去のやり取りの記憶を実現しています。(※6)

弊社のソリューション開発について

弊社・株式会社WEELでも、エンベディングとLLMを駆使したAIツールの開発を承っております!

弊社で扱っている開発サービスは、PoC開発とソリューション開発の2つです。各サービスでは……

【PoC開発】

● 業界特化知識をもったAIチャットボット

● 専門分野の試験問題を生成できるAIツール

【ソリューション開発】

● お問い合わせに自動で対応するAIツール

● 面談内容から人事評価を自動で行うAIツール

といったAIツールを、エンベディングとChatGPTの組み合わせで実現しております。どちらのサービスをご利用いただいても、業務の工数のうち最大90%まで削減が可能ですよ。

ちなみに各開発サービスのコンセプトや費用は、以下のとおりになります。

| PoC開発 | ソリューション開発 | |

|---|---|---|

| コンセプト | 既存のモデルを使って、社内向けAIツールを開発 | 生成AI搭載型のサービスやシステムを、基盤モデルから開発 |

| 期間 | 2〜4ヶ月 | 4ヶ月〜 |

| 内容 | ・データ処理・環境構築・プロトタイプ開発・検証・コードの提出・検証結果報告 | PoC開発の内容に加え、・システムの要件定義書作成・AIシステムの開発・社内システムとの連携・AIシステムの実装・運用 |

| 見積もり額 | ¥2,400,000〜4,800,000 | ¥13,200,000〜 |

まずは無料相談で、「どの業務に導入すれば効果が出るか」「開発費用は抑えられないか」といった課題をヒアリングいたします。ぜひ、貴社のお悩みをお聞かせください!

なお、AIチャットボットの開発方法について詳しく知りたい方は、下記の記事を合わせてご確認ください。

エンベディング×生成AIで業務を効率化しよう!

当記事では、生成AIの弱点を補ってくれる技術「エンベディング」について紹介しました。以下でもう一度、エンベディングの特徴を振り返っていきましょう!

【エンベディングの基本】

● 類似度を使って、データをベクトル空間に格納する

● エンベディングしたデータは検索性に優れている

【生成AI分野でのエンベディング】

● LLMに外付けする形で、AIツールやチャットボットを構成する

● LLMが知り得ない事実を補ってくれる

● 質問に関連する事実だけをLLMに示す

このような強みをもつエンベディングはしばしば、業務用のAIツールやチャットボットに組み込まれています。弊社でもエンベディングを使ったAIツール&チャットボットの開発を承っておりますので、お悩みの方はご相談いただけると幸いです。

最後に

いかがだったでしょうか?

事業に特化したAI活用は、エンベディング設計が鍵。成功事例と課題整理から導入の一歩をサポートします。

株式会社WEELは、自社・業務特化の効果が出るAIプロダクト開発が強みです!

開発実績として、

・新規事業室での「リサーチ」「分析」「事業計画検討」を70%自動化するAIエージェント

・社内お問い合わせの1次回答を自動化するRAG型のチャットボット

・過去事例や最新情報を加味して、10秒で記事のたたき台を作成できるAIプロダクト

・お客様からのメール対応の工数を80%削減したAIメール

・サーバーやAI PCを活用したオンプレでの生成AI活用

・生徒の感情や学習状況を踏まえ、勉強をアシストするAIアシスタント

などの開発実績がございます。

生成AIを活用したプロダクト開発の支援内容は、以下のページでも詳しくご覧いただけます。

➡︎株式会社WEELのサービスを詳しく見る。

まずは、「無料相談」にてご相談を承っておりますので、ご興味がある方はぜひご連絡ください。

➡︎生成AIを使った業務効率化、生成AIツールの開発について相談をしてみる。

「生成AIを社内で活用したい」「生成AIの事業をやっていきたい」という方に向けて、生成AI社内セミナー・勉強会をさせていただいております。

セミナー内容や料金については、ご相談ください。

また、サービス紹介資料もご用意しておりますので、併せてご確認ください。

- ※1:AI のマルチツールのご紹介: ベクトル エンベディング | Google Cloud 公式ブログ

- ※2:検索により強化された生成 (RAG) | Prompt Engineering Guide

- ※3:ChatGPTでの業務効率化を“断念”──正答率94%でも「ごみ出し案内」をAIに託せなかったワケ 三豊市と松尾研の半年間(1/2 ページ) – ITmedia NEWS

- ※4:Llamaindex を用いた社内文書の ChatGPT QA ツールをチューニングする – GMOインターネットグループ グループ研究開発本部

- ※5:ChatGPT API と LlamaIndex でブログのQ&A Chatbotを作ってみた

- ※6:AIこより爆誕!?の裏側

【監修者】田村 洋樹

株式会社WEELの代表取締役として、AI導入支援や生成AIを活用した業務改革を中心に、アドバイザリー・プロジェクトマネジメント・講演活動など多面的な立場で企業を支援している。

これまでに累計25社以上のAIアドバイザリーを担当し、企業向けセミナーや大学講義を通じて、のべ10,000人を超える受講者に対して実践的な知見を提供。上場企業や国立大学などでの登壇実績も多く、日本HP主催「HP Future Ready AI Conference 2024」や、インテル主催「Intel Connection Japan 2024」など、業界を代表するカンファレンスにも登壇している。